WO2025063768A1 - Encoder and decoder using compression of region of interest in feature map - Google Patents

Encoder and decoder using compression of region of interest in feature map Download PDFInfo

- Publication number

- WO2025063768A1 WO2025063768A1 PCT/KR2024/014241 KR2024014241W WO2025063768A1 WO 2025063768 A1 WO2025063768 A1 WO 2025063768A1 KR 2024014241 W KR2024014241 W KR 2024014241W WO 2025063768 A1 WO2025063768 A1 WO 2025063768A1

- Authority

- WO

- WIPO (PCT)

- Prior art keywords

- feature map

- unit

- feature

- vcm

- interest

- Prior art date

- Legal status (The legal status is an assumption and is not a legal conclusion. Google has not performed a legal analysis and makes no representation as to the accuracy of the status listed.)

- Pending

Links

Images

Classifications

-

- G—PHYSICS

- G06—COMPUTING OR CALCULATING; COUNTING

- G06N—COMPUTING ARRANGEMENTS BASED ON SPECIFIC COMPUTATIONAL MODELS

- G06N3/00—Computing arrangements based on biological models

- G06N3/02—Neural networks

- G06N3/04—Architecture, e.g. interconnection topology

- G06N3/045—Combinations of networks

-

- G—PHYSICS

- G06—COMPUTING OR CALCULATING; COUNTING

- G06N—COMPUTING ARRANGEMENTS BASED ON SPECIFIC COMPUTATIONAL MODELS

- G06N3/00—Computing arrangements based on biological models

- G06N3/02—Neural networks

- G06N3/04—Architecture, e.g. interconnection topology

- G06N3/045—Combinations of networks

- G06N3/0455—Auto-encoder networks; Encoder-decoder networks

-

- G—PHYSICS

- G06—COMPUTING OR CALCULATING; COUNTING

- G06N—COMPUTING ARRANGEMENTS BASED ON SPECIFIC COMPUTATIONAL MODELS

- G06N3/00—Computing arrangements based on biological models

- G06N3/02—Neural networks

- G06N3/04—Architecture, e.g. interconnection topology

- G06N3/0464—Convolutional networks [CNN, ConvNet]

-

- G—PHYSICS

- G06—COMPUTING OR CALCULATING; COUNTING

- G06N—COMPUTING ARRANGEMENTS BASED ON SPECIFIC COMPUTATIONAL MODELS

- G06N3/00—Computing arrangements based on biological models

- G06N3/02—Neural networks

- G06N3/04—Architecture, e.g. interconnection topology

- G06N3/048—Activation functions

-

- G—PHYSICS

- G06—COMPUTING OR CALCULATING; COUNTING

- G06V—IMAGE OR VIDEO RECOGNITION OR UNDERSTANDING

- G06V10/00—Arrangements for image or video recognition or understanding

- G06V10/20—Image preprocessing

- G06V10/25—Determination of region of interest [ROI] or a volume of interest [VOI]

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N19/00—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals

- H04N19/10—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding

- H04N19/102—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding characterised by the element, parameter or selection affected or controlled by the adaptive coding

- H04N19/124—Quantisation

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N19/00—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals

- H04N19/10—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding

- H04N19/134—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding characterised by the element, parameter or criterion affecting or controlling the adaptive coding

- H04N19/167—Position within a video image, e.g. region of interest [ROI]

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N19/00—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals

- H04N19/44—Decoders specially adapted therefor, e.g. video decoders which are asymmetric with respect to the encoder

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N19/00—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals

- H04N19/70—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals characterised by syntax aspects related to video coding, e.g. related to compression standards

Definitions

- the present disclosure relates to an encoder and decoder using region-of-interest compression within a feature map.

- HEVC is a next-generation video compression technology with a higher compression ratio and lower complexity than the previous H.264/AVC technology, and is a key technology for effectively compressing massive data of HD and UHD video.

- HEVC performs block-by-block encoding, like previous compression standards.

- the core encoding technologies included in the only profile of HEVC are in eight areas: hierarchical encoding structure technology, transformation technology, quantization technology, intra-picture prediction encoding technology, inter-picture motion prediction technology, entropy encoding technology, loop filter technology, and other technologies.

- VVC Versatile Video Coding

- VVC H.266

- H.265 H.265

- HEVC previous generation codec

- HEVC previous generation codec

- VVC was initially developed with resolutions over 4K in mind, but it was also developed for ultra-high-resolution image processing at a whopping 16K level to support 360-degree images due to the expansion of the VR market.

- the HDR market is gradually expanding due to the development of display technology, it supports 16-bit color depth as well as 10-bit color depth in order to respond to this, and supports brightness expressions of 1000 nits, 4000 nits, and 10000 nits.

- it since it is being developed with the VR and 360-degree image markets in mind, it supports partial frame rates in the range of 0 to 120 FPS.

- AI Artificial intelligence

- AI refers to artificially imitating human intelligence, that is, intelligence that can recognize, classify, infer, predict, and control/decision making.

- the present disclosure aims to provide an encoder and decoder that utilize compression of a region of interest within a feature map to enable effective performance of image analysis by a machine.

- a VCM encoding device is provided.

- An encoding device for a machine may include a feature map extraction unit for extracting one or more feature maps for an input image; a region of interest derivation unit for deriving one or more spatial regions of interest from the one or more feature maps; a feature map conversion unit for converting the feature map into a coding group unit including the one or more feature maps; and a feature map encoding unit for encoding the one or more feature maps or the converted feature map into a coding group unit and outputting a bitstream.

- the VCM decoding device may include a feature map decoding unit which receives a bitstream and restores one or more feature maps or feature map transform coefficients in units of coding groups; a feature map inverse transform unit which performs inverse transform by multiplying the restored feature map transform coefficients in units of coding groups by an inverse transform matrix in response to restoring the feature map transform coefficients; a feature map reconstruction unit which predicts an untransmitted feature map or a portion of a feature map based on the restored feature map to reconstruct an entire feature map; and a machine task analysis unit which performs a pre-requested machine task based on the restored entire feature map.

- a non-volatile computer-readable storage medium having instructions recorded thereon, wherein the instructions, when executed by one or more processors, cause the one or more processors to perform the steps of: extracting one or more feature maps for an input image; deriving one or more spatial regions of interest from the one or more feature maps; transforming the feature maps into coding group units including the one or more feature maps; and encoding the one or more feature maps or the transformed feature maps into coding group units and outputting a bitstream.

- Figure 3 is a drawing schematically illustrating the configuration of a video/image decoding device.

- FIG. 9a is an example of a single feature map extraction structure according to an embodiment of the present disclosure

- FIG. 9b is an example of a plurality of feature map extraction structures according to an embodiment of the present disclosure.

- FIG. 13 is an example of input values (a) and output values (b1, b2) of a coding group derivation unit (840) according to one embodiment of the present disclosure.

- FIG. 14 is a flowchart including a matrix multiplication-based feature map transformation process according to one embodiment of the present disclosure.

- FIG. 15 illustrates an example of a matrix multiplication-based feature map transformation according to an embodiment of the present disclosure.

- FIG. 16 illustrates an example of feature map transformation based on multiple convolutional layers according to an embodiment of the present disclosure.

- FIG. 17 is a block diagram including components of a VCM decoding device according to one embodiment of the present disclosure.

- FIG. 18 is a flowchart including an inverse transformation process of a feature map based on matrix multiplication according to an embodiment of the present disclosure.

- FIG. 19 illustrates an example of inverse transformation of a feature map based on matrix multiplication according to an embodiment of the present disclosure.

- FIG. 20 illustrates an example of inverse transformation of a feature map based on multiple convolutional layers according to an embodiment of the present disclosure.

- FIG. 21 is a flowchart illustrating a feature map reconstruction process according to an embodiment of the present disclosure.

- FIG. 22 is an example of combining a region of interest and a region of non-interest according to one embodiment of the present disclosure.

- FIG. 23 illustrates an example of feature map inverse transformation based on multiple convolutional layers according to one embodiment of the present disclosure.

- FIG. 24 illustrates a picture_parameter_set syntax including information about a region of interest according to one embodiment of the present disclosure.

- FIG. 25a illustrates a coding group header (coding_group_header) syntax according to one embodiment of the present disclosure.

- FIG. 25b illustrates the decryption reference attribute (is_intra_coded) syntax included in a coding group header according to one embodiment of the present disclosure.

- first and/or second may be used to describe various components, the components should not be limited by the terms. The terms are only intended to distinguish one component from another, for example, without departing from the scope of the rights according to the concept of the present disclosure, a first component may be referred to as a second component, and similarly, a second component may also be referred to as a first component.

- VVC Versatile Video Coding

- HEVC High Efficiency Video Coding

- EVC essential video coding

- video can mean a series of images over time.

- Picture generally means a unit representing one image from a specific time period

- slice/tile is a unit that constitutes part of a picture in coding.

- a slice/tile may contain one or more coding tree units (CTUs).

- a picture may consist of one or more slices/tiles.

- a picture may consist of one or more tile groups.

- a tile group may contain one or more tiles.

- a pixel or pel can mean the smallest unit that constitutes a picture (or image).

- a 'sample' can be used as a term corresponding to a pixel.

- a sample can generally represent a pixel or a pixel value, and can represent only a pixel/pixel value of a luma component, or only a pixel/pixel value of a chroma component.

- a sample can mean a pixel value in the spatial domain, or when such a pixel value is converted to the frequency domain, it can mean a transform coefficient in the frequency domain.

- a unit may represent a basic unit of image processing.

- a unit may include at least one of a specific region of a picture and information related to the region.

- a unit can contain one luma block and two chroma (e.g. cb, cr) blocks.

- the term unit may be used interchangeably with the terms block or area, depending on the case.

- an MxN block can contain a set (or array) of samples (or array of samples) or transform coefficients consisting of M columns and N rows.

- Figure 1 schematically illustrates an example of a video/image coding system.

- a video/image coding system may include a source device and a receiving device.

- the source device may transmit encoded video/image information or data to a receiving device via a digital storage medium or a network in the form of a file or streaming.

- the source device may include a video source, an encoding device, and a transmitter.

- the receiving device may include a receiving device, a decoding device, and a renderer.

- the above encoding device may be called a video/image encoding device, and the above decoding device may be called a video/image decoding device.

- the transmitter may be included in the encoding device.

- the receiver may be included in the decoding device.

- the renderer may include a display unit, and the display unit may be configured as a separate device or an external component.

- the video source can obtain the video/image through a process of capturing, compositing, or generating the video/image.

- the video source can include a video/image capture device and/or a video/image generation device.

- the video/image capture device can include, for example, one or more cameras, a video/image archive containing previously captured video/image, etc.

- the video/image generation device can include, for example, a computer, a tablet, a smart phone, etc., and can (electronically) generate the video/image.

- a virtual video/image can be generated through a computer, etc., in which case the video/image capture process can be replaced by a process in which related data is generated.

- the encoding device can encode input video/image.

- the encoding device can perform a series of procedures such as prediction, transformation, and quantization for compression and coding efficiency.

- the encoded data (encoded video/image information) can be output in the form of a bitstream.

- the transmission unit can transmit encoded video/image information or data output in the form of a bitstream to the reception unit of the receiving device through a digital storage medium or network in the form of a file or streaming.

- the digital storage medium can include various storage media such as USB, SD, CD, DVD, Blu-ray, HDD, SSD, etc.

- the transmission unit can include an element for generating a media file through a predetermined file format and can include an element for transmission through a broadcasting/communication network.

- the receiver can receive/extract the bitstream and transmit it to a decoding device.

- the decoding device can decode video/image by performing a series of procedures such as inverse quantization, inverse transformation, and prediction corresponding to the operation of the encoding device.

- the renderer can render the decoded video/image.

- the rendered video/image can be displayed through the display unit.

- Figure 2 is a drawing schematically illustrating the configuration of a video/image encoding device.

- video encoding device hereinafter may include a video encoding device.

- the encoding device (10a) may be configured to include an image partitioner (10a-10), a prediction unit (predictor) 10a-20, a residual processor (residual processor) 10a-30, an entropy encoder (entropy encoder) 10a-40, an adder (adder) 10a-50, a filter (filter) 10a-60, and a memory (memory) 10a-70.

- the prediction unit (10a-20) may include an inter prediction unit (10a-21) and an intra prediction unit (10a-22).

- the residual processing unit (10a-30) may include a transformer (10a-32), a quantizer (10a-33), a dequantizer (10a-34), and an inverse transformer (10a-35).

- the residual processing unit (10a-30) may further include a subtractor (10a-31).

- the adder (10a-50) may be called a reconstructor or a reconstructed block generator.

- the above-described image segmentation unit (10a-10), prediction unit (10a-20), residual processing unit (10a-30), entropy encoding unit (10a-40), adding unit (10a-50), and filtering unit (10a-60) may be configured by one or more hardware components (e.g., encoder chipset or processor) according to an embodiment.

- the memory (10a-70) may include a DPB (decoded picture buffer) and may be configured by a digital storage medium.

- the hardware component may further include the memory (10a-70) as an internal/external component.

- the image segmentation unit (10a-10) can segment an input image (or picture, frame) input to the encoding device (10a) into one or more processing units.

- the processing unit may be called a coding unit (CU).

- the coding unit may be recursively split from a coding tree unit (CTU) or a largest coding unit (LCU) according to a Quad-tree binary-tree ternary-tree (QTBTTT) structure.

- CTU coding tree unit

- LCU largest coding unit

- QTBTTT Quad-tree binary-tree ternary-tree

- one coding unit may be split into a plurality of coding units of deeper depth based on a quad-tree structure, a binary tree structure, and/or a ternary structure.

- the quad-tree structure may be applied first and the binary tree structure and/or the ternary structure may be applied later.

- the binary tree structure may be applied first.

- the coding procedure according to the present document may be performed based on the final coding unit that is not split any further.

- the maximum coding unit can be used as the final coding unit, or, if necessary, the coding unit can be recursively divided into coding units of lower depths, and the coding unit of the optimal size can be used as the final coding unit.

- the coding procedure may include procedures such as prediction, transformation, and restoration described below.

- the processing unit may further include a prediction unit (PU) or a transformation unit (TU). In this case, the prediction unit and the transformation unit may be divided or partitioned from the final coding unit described above, respectively.

- the prediction unit may be a unit of sample prediction

- the transformation unit may be a unit for deriving a transform coefficient and/or a unit for deriving a residual signal from a transform coefficient.

- an MxN block can represent a set of samples or transform coefficients consisting of M columns and N rows.

- a sample can generally represent a pixel or a pixel value, and may represent only a pixel/pixel value of a luma component, or only a pixel/pixel value of a chroma component.

- a sample can be used as a term corresponding to a pixel or pel in a picture (or image).

- the subtraction unit (10a-31) can subtract the prediction signal (predicted block, prediction samples, or prediction sample array) output from the prediction unit (10a-20) from the input image signal (original block, original samples, or original sample array) to generate a residual signal (residual block, residual samples, or residual sample array), and the generated residual signal is transmitted to the conversion unit (10a-32).

- the prediction unit (10a-20) can perform prediction on a block to be processed (hereinafter, referred to as a current block) and generate a predicted block including prediction samples for the current block.

- the prediction unit (10a-20) can determine whether intra prediction or inter prediction is applied to the current block or CU unit.

- the prediction unit can generate various information about prediction, such as prediction mode information, as described later in the description of each prediction mode, and transmit the information to the entropy encoding unit (10a-40).

- the information about prediction can be encoded in the entropy encoding unit (10a-40) and output in the form of a bitstream.

- the intra prediction unit (10a-22) can predict the current block by referring to samples within the current picture.

- the referenced samples may be located in the neighborhood of the current block or may be located away from it depending on the prediction mode.

- prediction modes can include multiple non-directional modes and multiple directional modes.

- Non-directional modes can include, for example, DC modes and planar modes.

- Directional modes can include, for example, 33 directional prediction modes or 65 directional prediction modes, depending on the granularity of the prediction direction.

- the intra prediction unit (10a-22) may also determine the prediction mode to be applied to the current block by using the prediction mode applied to the surrounding blocks.

- the inter prediction unit (10a-21) can derive a predicted block for a current block based on a reference block (reference sample array) specified by a motion vector on a reference picture.

- the motion information can be predicted in units of blocks, subblocks, or samples based on the correlation of motion information between neighboring blocks and the current block.

- the motion information can include a motion vector and a reference picture index.

- the motion information can further include information on an inter prediction direction (such as L0 prediction, L1 prediction, Bi prediction, etc.).

- the neighboring block can include a spatial neighboring block existing in the current picture and a temporal neighboring block existing in the reference picture.

- the reference picture including the reference block and the reference picture including the temporal neighboring block may be the same or different.

- the above temporal neighboring blocks may be called collocated reference blocks, collocated CUs (colCUs), etc., and a reference picture including the above temporal neighboring blocks may be called a collocated picture (colPic).

- the inter prediction unit (10a-21) may configure a motion information candidate list based on the neighboring blocks, and generate information indicating which candidate is used to derive the motion vector and/or reference picture index of the current block. Inter prediction may be performed based on various prediction modes, and for example, in the case of the skip mode and the merge mode, the inter prediction unit (10a-21) may use the motion information of the neighboring blocks as the motion information of the current block.

- a residual signal may not be transmitted.

- MVP motion vector prediction

- the prediction unit (10a-20) can generate a prediction signal based on various prediction methods described below.

- the prediction unit can apply intra prediction or inter prediction for prediction of one block, and can also apply intra prediction and inter prediction at the same time. This can be called combined inter and intra prediction (CIIP).

- the prediction unit can perform intra block copy (IBC) for prediction of a block.

- the intra block copy can be used for content image/video coding such as games, such as screen content coding (SCC).

- SCC screen content coding

- IBC basically performs prediction within the current picture, but can be performed similarly to inter prediction in that it derives a reference block within the current picture. That is, IBC can utilize at least one of the inter prediction techniques described in this document.

- the prediction signal generated through the inter prediction unit (10a-21) and/or the intra prediction unit (10a-22) may be used to generate a reconstructed signal or may be used to generate a residual signal.

- the transform unit (10a-32) may apply a transform technique to the residual signal to generate transform coefficients.

- the transform technique may include a Discrete Cosine Transform (DCT), a Discrete Sine Transform (DST), a Graph-Based Transform (GBT), or a Conditionally Non-linear Transform (CNT).

- DCT Discrete Cosine Transform

- DST Discrete Sine Transform

- GBT Graph-Based Transform

- CNT Conditionally Non-linear Transform

- GBT refers to a transform obtained from a graph when the relationship information between pixels is expressed as a graph.

- CNT refers to a transform obtained based on generating a prediction signal using all previously reconstructed pixels.

- the transform process may be applied to a pixel block having a square equal size,

- the quantization unit (10a-33) quantizes the transform coefficients and transmits them to the entropy encoding unit (10a-40), and the entropy encoding unit (10a-40) can encode the quantized signal (information about the quantized transform coefficients) and output it as a bitstream.

- the information about the quantized transform coefficients can be called residual information.

- the quantization unit (10a-33) can rearrange the quantized transform coefficients in the form of a block into a one-dimensional vector based on a coefficient scan order, and can also generate information about the quantized transform coefficients based on the quantized transform coefficients in the form of the one-dimensional vector.

- the entropy encoding unit (10a-40) can perform various encoding methods, such as, for example, exponential Golomb, context-adaptive variable length coding (CAVLC), and context-adaptive binary arithmetic coding (CABAC).

- the entropy encoding unit (10a-40) may encode, together or separately, information (e.g., values of syntax elements, etc.) necessary for video/image restoration in addition to quantized transform coefficients.

- the encoded information (e.g., encoded video/image information) may be transmitted or stored in the form of a bitstream in the form of a network abstraction layer (NAL) unit.

- the video/image information may further include information about various parameter sets, such as an adaptation parameter set (APS), a picture parameter set (PPS), a sequence parameter set (SPS), or a video parameter set (VPS).

- the video/image information may further include general constraint information.

- the signaling/transmitted information and/or syntax elements described later in this document may be encoded through the above-described encoding procedure and included in the bitstream.

- the bitstream may be transmitted through a network or stored in a digital storage medium.

- the network may include a broadcasting network and/or a communication network

- the digital storage medium may include various storage media such as USB, SD, CD, DVD, Blu-ray, HDD, SSD, etc.

- the signal output from the entropy encoding unit (10a-40) may be configured as an internal/external element of the encoding device (10a) by a transmitting unit (not shown) and/or a storing unit (not shown), or the transmitting unit may be included in the entropy encoding unit (10a-40).

- the quantized transform coefficients output from the quantization unit (10a-33) can be used to generate a prediction signal. For example, by applying inverse quantization and inverse transformation to the quantized transform coefficients through the inverse quantization unit (10a-34) and the inverse transform unit (10a-35), a residual signal (residual block or residual samples) can be reconstructed.

- the adding unit (10a-50) adds the reconstructed residual signal to the prediction signal output from the prediction unit (10a-20), so that a reconstructed signal (reconstructed picture, reconstructed block, reconstructed samples, or reconstructed sample array) can be generated.

- the predicted block can be used as a reconstructed block.

- the generated restoration signal can be used for intra prediction of the next target block within the current picture, and can also be used for inter prediction of the next picture after filtering as described below.

- LMCS luma mapping with chroma scaling

- the filtering unit (10a-60) can improve subjective/objective picture quality by applying filtering to a restoration signal.

- the filtering unit (10a-60) can apply various filtering methods to a restoration picture to generate a modified restoration picture, and store the modified restoration picture in the memory (10a-70), specifically, in the DPB of the memory (10a-70).

- the various filtering methods may include, for example, deblocking filtering, a sample adaptive offset (SAO), an adaptive loop filter, a bilateral filter, etc.

- the filtering unit (10a-60) can generate various information regarding filtering as described below in the description of each filtering method and transmit the information to the entropy encoding unit (10a-90).

- the information regarding filtering can be encoded by the entropy encoding unit (10a-90) and output in the form of a bitstream.

- the modified restored picture transmitted to the memory (10a-70) can be used as a reference picture in the inter prediction unit (10a-80).

- the encoding device can avoid prediction mismatch between the encoding device (10a) and the decoding device, and can also improve encoding efficiency.

- the DPB of the memory (10a-70) can store the modified restored picture to be used as a reference picture in the inter prediction unit (10a-21).

- the memory (10a-70) can store motion information of a block from which motion information in the current picture is derived (or encoded) and/or motion information of blocks in a picture that has already been restored.

- the stored motion information can be transferred to the inter prediction unit (10a-21) to be used as motion information of a spatial neighboring block or motion information of a temporal neighboring block.

- the memory (10a-70) can store restored samples of restored blocks in the current picture and transfer them to the intra prediction unit (10a-22).

- Figure 3 is a drawing schematically illustrating the configuration of a video/image decoding device.

- the decoding device (10b) may be configured to include an entropy decoder (10b-10), a residual processor (10b-20), a predictor (10b-30), an adder (10b-40), a filter (10b-50), and a memory (10b-60).

- the predictor (10b-30) may include an inter prediction unit (10b-31) and an intra prediction unit (10b-32).

- the residual processor (10b-20) may include a dequantizer (10b-21) and an inverse transformer (10b-21).

- the entropy decoding unit (10b-10), residual processing unit (10b-20), prediction unit (10b-30), adding unit (10b-40), and filtering unit (10b-50) described above may be configured by one hardware component (e.g., decoder chipset or processor) according to an embodiment.

- the memory (10b-60) may include a DPB (decoded picture buffer) and may be configured by a digital storage medium.

- the hardware component may further include the memory (10b-60) as an internal/external component.

- the decoding device (10b) can restore the image corresponding to the process in which the video/image information is processed in the encoding device of FIG. 2.

- the decoding device (10b) can derive units/blocks based on block division related information acquired from the bitstream.

- the decoding device (10b) can perform decoding using a processing unit applied in the encoding device. Therefore, the processing unit of the decoding can be, for example, a coding unit, and the coding unit can be divided from a coding tree unit or a maximum coding unit according to a quad tree structure, a binary tree structure, and/or a ternary tree structure.

- One or more transform units can be derived from the coding unit. Then, the restored image signal decoded and output by the decoding device (10b) can be reproduced through a reproduction device.

- the decoding device (10b) can receive a signal output from the encoding device of FIG. 2 in the form of a bitstream, and the received signal can be decoded through the entropy decoding unit (10b-10).

- the entropy decoding unit (10b-10) can parse the bitstream to derive information (e.g., video/image information) necessary for image restoration (or picture restoration).

- the video/image information may further include information on various parameter sets, such as an adaptation parameter set (APS), a picture parameter set (PPS), a sequence parameter set (SPS), or a video parameter set (VPS).

- the video/image information may further include general constraint information.

- the decoding device can decode the picture further based on the information about the parameter set and/or the general restriction information.

- the signaling/received information and/or syntax elements described later in this document can be decoded and obtained from the bitstream through the decoding procedure.

- the entropy decoding unit (10b-10) can decode information in the bitstream based on a coding method such as exponential Golomb coding, CAVLC or CABAC, and output values of syntax elements necessary for image restoration and quantized values of transform coefficients for the residual.

- the CABAC entropy decoding method receives a bin corresponding to each syntax element from a bitstream, determines a context model by using information of a syntax element to be decoded and decoding information of surrounding and decoding target blocks or information of symbols/bins decoded in a previous step, and predicts an occurrence probability of a bin according to the determined context model to perform arithmetic decoding of the bin to generate a symbol corresponding to the value of each syntax element.

- the CABAC entropy decoding method can update the context model by using information of the decoded symbol/bin for the context model of the next symbol/bin after determining the context model.

- Information regarding prediction among the information decoded by the entropy decoding unit (10b-10) is provided to the prediction unit (10b-30), and information regarding the residual on which entropy decoding has been performed by the entropy decoding unit (10b-10), i.e., quantized transform coefficients and related parameter information, can be input to the inverse quantization unit (10b-21).

- information regarding filtering among the information decoded by the entropy decoding unit (10b-10) may be provided to the filtering unit (10b-50).

- a receiving unit (not shown) that receives a signal output from an encoding device may be further configured as an internal/external element of the decoding device (10b), or the receiving unit may be a component of the entropy decoding unit (10b-10).

- the decoding device according to this document may be called a video/video/picture decoding device, and the decoding device may be divided into an information decoder (video/video/picture information decoder) and a sample decoder (video/video/picture sample decoder).

- the above information decoder may include the entropy decoding unit (10b-10), and the sample decoder may include at least one of the inverse quantization unit (10b-21), the inverse transformation unit (10b-22), the prediction unit (10b-30), the addition unit (10b-40), the filtering unit (10b-50), and the memory (10b-60).

- the inverse quantization unit (10b-21) can inverse quantize the quantized transform coefficients and output the transform coefficients.

- the inverse quantization unit (10b-21) can rearrange the quantized transform coefficients into a two-dimensional block form. In this case, the rearrangement can be performed based on the coefficient scan order performed in the encoding device.

- the inverse quantization unit (10b-21) can perform inverse quantization on the quantized transform coefficients using quantization parameters (e.g., quantization step size information) and obtain transform coefficients.

- the transform coefficients are inversely transformed to obtain a residual signal (residual block, residual sample array).

- the prediction unit can perform a prediction for the current block and generate a predicted block including prediction samples for the current block.

- the prediction unit can determine whether intra prediction or inter prediction is applied to the current block based on the information about the prediction output from the entropy decoding unit (10b-10), and can determine a specific intra/inter prediction mode.

- the prediction unit can generate a prediction signal based on various prediction methods described below.

- the prediction unit can apply intra prediction or inter prediction for prediction of one block, and can also apply intra prediction and inter prediction at the same time. This can be called combined inter and intra prediction (CIIP).

- the prediction unit can perform intra block copy (IBC) for prediction of a block.

- the intra block copy can be used for content image/video coding such as game, such as screen content coding (SCC).

- SCC screen content coding

- IBC basically performs prediction within the current picture, but can be performed similarly to inter prediction in that it derives a reference block within the current picture. That is, IBC can utilize at least one of the inter prediction techniques described in this document.

- the intra prediction unit (10b-32) can predict the current block by referring to samples within the current picture.

- the referenced samples may be located in the neighborhood of the current block or may be located away from it depending on the prediction mode.

- prediction modes may include multiple non-directional modes and multiple directional modes.

- the intra prediction unit (10b-32) may determine the prediction mode to be applied to the current block by using the prediction mode applied to the surrounding blocks.

- the inter prediction unit (10b-31) can derive a predicted block for a current block based on a reference block (reference sample array) specified by a motion vector on a reference picture.

- the motion information can be predicted in units of blocks, subblocks, or samples based on the correlation of motion information between surrounding blocks and the current block.

- the motion information can include a motion vector and a reference picture index.

- the motion information can further include information on an inter prediction direction (L0 prediction, L1 prediction, Bi prediction, etc.).

- the neighboring blocks may include spatial neighboring blocks existing in the current picture and temporal neighboring blocks existing in the reference picture.

- the inter prediction unit (10b-31) may configure a motion information candidate list based on the neighboring blocks, and derive a motion vector and/or a reference picture index of the current block based on the received candidate selection information.

- Inter prediction may be performed based on various prediction modes, and the information about the prediction may include information indicating a mode of inter prediction for the current block.

- the addition unit (10b-40) can generate a restoration signal (restored picture, restored block, restored sample array) by adding the acquired residual signal to the prediction signal (predicted block, predicted sample array) output from the prediction unit (10b-30).

- the predicted block can be used as the restoration block.

- the addition unit (10b-40) may be called a restoration unit or a restoration block generation unit.

- the generated restoration signal can be used for intra prediction of the next processing target block within the current picture, can be output after filtering as described below, or can be used for inter prediction of the next picture.

- LMCS luma mapping with chroma scaling

- the filtering unit (10b-50) can improve subjective/objective image quality by applying filtering to the restoration signal.

- the filtering unit (10b-50) can apply various filtering methods to the restoration picture to generate a modified restoration picture, and transmit the modified restoration picture to the memory (60), specifically, the DPB of the memory (10b-60).

- the various filtering methods can include, for example, deblocking filtering, sample adaptive offset, adaptive loop filter, bilateral filter, etc.

- the (corrected) reconstructed picture stored in the DPB of the memory (10b-60) can be used as a reference picture in the inter prediction unit (10b-31).

- the memory (10b-60) can store motion information of a block from which motion information in the current picture is derived (or decoded) and/or motion information of blocks in a picture that has already been reconstructed.

- the stored motion information can be transferred to the inter prediction unit (10b-31) to be used as motion information of a spatial neighboring block or motion information of a temporal neighboring block.

- the memory (10b-60) can store reconstructed samples of reconstructed blocks in the current picture and transfer them to the intra prediction unit (10b-32).

- the embodiments described in the prediction unit (10b-30), the inverse quantization unit (10b-21), the inverse transformation unit (10b-22), and the filtering unit (10b-50) of the decoding device (10b) may be applied identically or correspondingly to the prediction unit (10a-20), the inverse quantization unit (10a-34), the inverse transformation unit (10a-35), and the filtering unit (10a-60) of the encoding device (10a).

- a predicted block including prediction samples for a current block which is a coding target block

- the predicted block includes prediction samples in a spatial domain (or pixel domain).

- the predicted block is derived identically by an encoding device and a decoding device, and the encoding device can increase image coding efficiency by signaling information (residual information) about a residual between the original block and the predicted block, rather than the original sample value of the original block itself, to a decoding device.

- the decoding device can derive a residual block including residual samples based on the residual information, and generate a reconstructed block including reconstructed samples by combining the residual block and the predicted block, and can generate a reconstructed picture including the reconstructed blocks.

- the above residual information can be generated through transformation and quantization procedures.

- the encoding device can derive a residual block between the original block and the predicted block, perform a transform procedure on residual samples (residual sample array) included in the residual block to derive transform coefficients, perform a quantization procedure on the transform coefficients to derive quantized transform coefficients, and signal related residual information to a decoding device (via a bitstream).

- the residual information can include information such as value information, position information, transform technique, transform kernel, and quantization parameter of the quantized transform coefficients.

- the decoding device can perform an inverse quantization/inverse transform procedure based on the residual information and derive residual samples (or residual block).

- the decoding device can generate a reconstructed picture based on the predicted block and the residual block.

- the encoding device can also inverse quantize/inverse transform the quantized transform coefficients to derive a residual block for reference for inter prediction of a subsequent picture, and generate a reconstructed picture based on the residual block.

- the traditional image compression method currently in use is a technology developed by considering the characteristics of the vision perceived by the viewer (human vision), so it includes unnecessary information and is inefficient for performing machine tasks. For example, the resolution of the image based on the viewer's vision may be higher than that of the image (e.g., feature map) based on the machine's data consumption time. Therefore, research on video codec technology for efficiently compressing feature maps for performing machine tasks is required.

- VCM Video Coding for Machines

- Figures 4a to 4d are examples showing a VCM encoder and a VCM decoder.

- VCM encoder (100a) and a VCM decoder (100b) are shown.

- a VCM decoder (100b) When a VCM encoder (100a) encodes a video and/or a feature map and transmits it as a bitstream, a VCM decoder (100b) can decode and output the bitstream. At this time, the VCM decoder (100b) can output one or more videos and/or feature maps. For example, the VCM decoder (100b) can output a first feature map for analysis using a machine, and can output a first image for viewing by a user. The first image can have a higher resolution than the first feature map.

- a feature extractor for extracting a feature map may be connected to the front end of the VCM encoder (100a).

- the VCM encoder (100a) may include a feature encoder.

- the VCM decoder (100b) may include a feature decoder and a video reconstructor.

- the feature decoder may decode a feature map from a bitstream and output a first feature map for machine-based analysis.

- the video reconstructor may regenerate and output a first video from the bitstream for viewing by a user.

- a feature extractor for extracting a feature map is connected to the front end of the VCM encoder (100).

- the VCM encoder (100a) may include a feature encoder.

- the VCM decoder (100b) may include a feature decoder.

- the feature decoder may decode a feature map from a bitstream and output a first feature map for analysis using a machine. That is, the bitstream may be encoded only as a feature map, not as an image.

- the feature map may be data including information about features for processing a specific task of a machine based on an image.

- a feature extractor may be connected to the front end of the VCM encoder (100a).

- the VCM encoder (100a) may include a feature converter and a video encoder.

- the video encoder may be the encoding device (10a) illustrated in FIG. 2.

- the VCM decoder (100b) illustrated in FIG. 4d may include a video decoder and an inverse converter.

- the video decoder may be the decoding device (10b) illustrated in FIG. 3.

- FIG. 5 is an exemplary diagram showing an example of a VCM encoder that compresses a feature map and then transmits it as a bitstream, and a VCM decoder that restores a received bitstream, according to an example

- FIG. 6 is an exemplary diagram showing an example of generating feature maps P2 to P5 shown in FIG. 5

- FIG. 7 is an exemplary diagram showing in detail the MSFF execution unit shown in FIG. 5.

- the VCM encoder (100a) (or transmitter) may include an MSFF (Multi-scale feature fusion) performing unit (100a-1) and an SSFC (Singlestream feature codec) encoder (100a-2).

- the VCM decoder (100b) (or receiver) may include an SSFC decoder (100b-1) and an MSFR (Multi-Scale Feature Reconstruction) performing unit (100b-2).

- the above MSFF execution unit (100a-1) aligns and then concatenates the feature maps P2 to P5 of the P layer.

- Feature maps P2 to P5 of the above P layer can be generated as shown in Fig. 6.

- feature maps P2 to P5 can be generated using a combination of a first artificial neural network model, for example, ResNet, and a second artificial neural network model, for example, a Feature Pyramid Network (FPN).

- the first artificial neural network model may be called a backbone

- the second artificial neural network model may be called a neck or a head.

- the first artificial neural network model e.g., ResNet

- Convolution may be performed on outputs from each stage of the first artificial neural network model (e.g., ResNet), so that feature maps C2 to C5 of the C layer may be generated.

- the above second artificial neural network model e.g., FPN

- FPN can receive feature maps C2 to C5 of the C layer as input and accumulate them in a top-down manner to generate feature maps M2 to M5 of the M layer.

- feature maps P2 to P5 of the P layer can be generated.

- the MSFF performing unit (100a-1) aligns and then concatenates the feature maps P2 to P5 of the P layer. Specifically, the MSFF performing unit (100a-1) downsamples the sizes of the feature maps P2 to P4 to match the size of the feature map P5 and then concatenates them.

- the MSFF execution unit (100a-1) performs pooling on each of the feature maps P2 to P5.

- each of the feature maps P2 to P5 can be reduced to a specific size, for example, a size of 64 x 64 or a size of 32 x 32.

- the feature map P5 having the smallest size among the feature maps P2 to P5 can be used as a reference for the remaining feature maps (i.e., feature maps P2, feature maps P3, and P4) to have the same size. That is, pooling can be performed on each of the remaining feature maps (i.e., feature maps P2, feature maps P3, and P4) to make them the same size as the feature map P5.

- the MSFF execution unit (100a-1) can concatenate the feature maps P2 to P5. For example, if each of the feature maps P2 to P5 is in the shape of a cube with a size of 64 x 64 and 256 channels, after concatenation, they can become a cube shape with a size of 64 x 64 and 1024 channels.

- the above concatenated feature maps can pass through SEblock.

- the SEBlock is a processing operation by SE (Squeeze-and-Excitation), calculates channel-wise weights of a feature map, and multiplies the weights by the output feature map of the residual unit.

- the MSFF performing unit can perform channel-wise reduction on the output of the SEBlock using convolution.

- the MSFF performing unit can finally transfer the output F to the SSFC encoder (100a-2).

- the above SSFC encoder (100a-2) can reduce the number of channels and transmit a bitstream after receiving the output F from the MSFF performing unit (100a-1).

- the SSFC encoder (100a-2) may include convolution, batch normalization, and Tanh function.

- the above VCM decoder (100b) (i.e., the receiving end) may include an MSFR performing unit (100b-1) and an SSFC decoder (100b-2).

- the SSFC decoder (100b-2) receives the bitstream, it may generate an output F'*.

- the SSFC decoder (100b-2) may include convolution, batch normalization, PReLu, etc.

- the MSFR performing unit (100b-1) of the above VCM decoder (100b) can restore the feature map P2' to the feature map P5' of the P' layer from the output F'* from the SSFC decoder (100b-2). To this end, the MSFR performing unit (100b-1) can perform upsampling/downsampling and accumulation, etc.

- a VCM encoding device (100a) can extract a feature map from an input image, encode the feature map, and output a bitstream.

- the VCM encoding device (100a) can include a feature map extraction and selection unit (810), a region of interest derivation unit (820), a region of interest extraction unit (830), a coding group derivation unit (840), a feature map conversion unit (850), and a feature map encoding unit (860).

- the feature map extraction and selection unit (810) can extract one or more feature maps from an image or video, select a feature map to be encoded from among the one or more feature maps, and further scale the selected feature map.

- the region of interest derivation unit (820) can derive a region of interest in a spatial axis or channel axis from a feature map.

- the feature map extraction and selection unit (810) of the VCM encoding device (100a) can extract one or more feature maps from a frame input to the feature map encoder and select and scale one or more feature maps to be encoded.

- a single feature map extraction structure may be composed of one or more convolution layers, and may have a structure such as, for example, FIG. 9A.

- the feature map extraction and selection unit (810) may sequentially perform one or more convolution layers on an input image (one frame or multiple frames) to derive one feature map.

- the structure for extracting multiple feature maps may be composed of one or more convolution layers, and may have a structure as in FIG. 9b, for example.

- the feature map extraction and selection unit (810) may perform a form in which one or more convolution layers are combined in series or in parallel on an input image to derive multiple feature maps.

- the multiple extracted feature maps may have different spatial resolutions and different channel lengths.

- the multiple extracted feature maps may all have the same channel length and the spatial resolution may increase linearly.

- four feature maps (feature maps 0 to 3) extracted from the input image have the same channel length c, and the height h and the width w increase linearly from feature map 3 to feature map 0.

- the VCM encoding device (100a) can transmit information related to feature map extraction to the VCM decoding device (100b).

- the information related to feature map extraction includes an index of a layer from which a feature map is extracted, the total number of extracted feature maps, the number of selected feature maps, the index/width/height/channel length of each selected feature map, etc., and the corresponding information can be transmitted to the VCM decoding device (100b) at a higher level of a sequence or frame group or frame level.

- the feature map extraction and selection unit (810) can perform spatial resolution scaling on the feature map selected in the feature map selection step.

- a syntax indicating whether spatial resolution scaling is performed can be transmitted at the sequence level, the frame group level, or the frame level.

- a parameter indicating a scale degree for changing the spatial resolution can be transmitted at the sequence level, the frame group level, or the frame level.

- a method for deriving and a method for expressing a parameter indicating the scale degree can be, for example, as follows.

- the scaling value for each feature map can be derived from a specific fixed value, a user-specified value, or a specific algorithm on a sequence/frame group/frame basis.

- the specific algorithm can be, for example, an algorithm for deriving a scale parameter for downsampling all feature maps to have the same spatial resolution as the smallest feature map, or an algorithm for deriving a scaling parameter based on the size of objects existing in the current frame or frame group.

- the width and height of the feature map can be used by sharing a single scale parameter, or can use and transmit separate scale parameters for the width and height respectively.

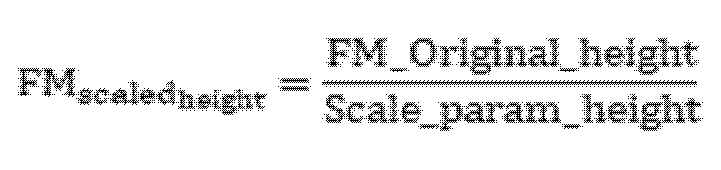

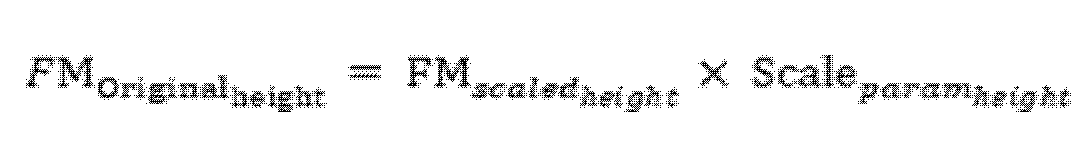

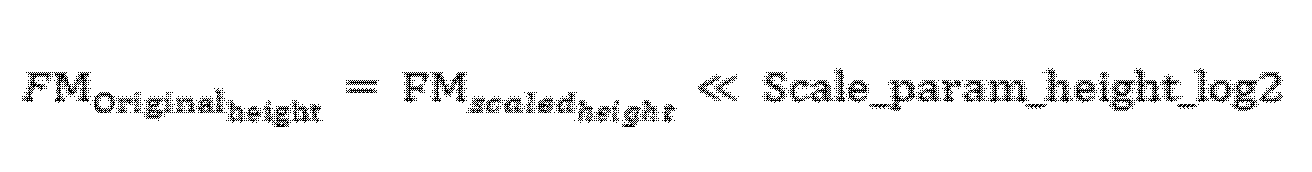

- the equations for calculating the spatial resolution width and height (FM_scaled_width, FM_scaled_height) after scaling the feature map can be as shown in Equations 1 to 6.

- Equations 1 and 2 can be cases where the original values of the scale parameters are transmitted

- Equations 3 and 4 can be cases where the values obtained by performing a log2 operation on the scale parameters are transmitted

- Equations 5 and 6 can be cases where the indexes of the scale parameters to be used in the scale parameter table are transmitted.

- the scale parameter table can be in the form of a vector in which a plurality of scale parameters are listed.

- Method 2 for deriving parameters A single scaling value commonly applied to multiple feature maps can be transmitted as a specific fixed value, a user-specified value, or a value derived through a specific algorithm on a sequence/frame group/frame basis.

- the process of deriving the scaled spatial resolution width and height using the scaling parameter can be the same as Method 1.

- FIG. 10 is an example of a spatial region of interest according to an embodiment of the present disclosure.

- the region of interest derivation unit (820) of the VCM encoding device (100a) can derive one or more spatial regions of interest from a feature map.

- the region of interest may be an arbitrary-shaped region composed of a continuous set of unit regions (NxM).

- the region of interest may be defined by location and size information of a region of interest map or polygon.

- the region of interest map can be a two-dimensional map of the spatial resolution size of the feature map and can be as shown in (a) of Fig. 10.

- the values of pixels included in the region of interest and the values of pixels included in the non-region of interest can be different values.

- the values of pixels included in the region of interest can be set to 1, and the values of pixels not included in the region of interest can be set to 0.

- the region of interest can be defined by the location and size information of the polygon and can be as in (b) of Fig. 10. If the polygon is, for example, a rectangle, the region of interest can be defined by the upper left coordinate, width, and height of the rectangle.

- the VCM encoding device (100a) can transmit information syntax about a region of interest to the VCM decoding device (100b).

- the region of interest information syntax can be included in picture_parameter_set and transmitted to the VCM decoding device (100b).

- the picture_parameter_set syntax can be defined as shown in FIG. 24.

- the region of interest information syntax can include a width (N) and a height (M) of a unit region of the region of interest. If the region of interest is defined as a region of interest map, the region of interest map can be transmitted by downsampling it to the width and height of the unit region, respectively. If the region of interest is defined as a rectangle, the upper left coordinate of the rectangle, the width and height values of the rectangle, and the scale parameter can be transmitted as values that are downscaled to the width and height of the unit region, respectively.

- Regions of interest can be derived one or more times using neural network-based or non-neural network-based methods, or the user can specify regions of interest on a sequence or frame-by-frame basis.

- Fig. 11 is a flowchart showing a process of extracting a region of interest according to an embodiment of the present disclosure.

- Fig. 12 shows examples of input values (a) of a region of interest extraction unit and output values (b) of a region of interest extraction unit.

- the region of interest extraction unit (830) of the VCM encoding device (100a) can extract a portion of a region from a feature map according to a region of interest derived from the region of interest derivation unit (820) and can be performed in the order of FIG. 11. Each step of FIG. 11 can be selectively performed.

- the region of interest extraction unit (830) can receive a feature map to be encoded and select a feature map to be extracted. When there are multiple feature maps, the region of interest extraction unit (830) can select one or more feature maps for performing region of interest extraction. The following steps S1102 and S1103 can be performed for each feature map selected as a region of interest extraction target. The number of feature maps from which regions of interest are extracted and each index can be included in picture_parameter_set and transmitted to the VCM decoding device (100b).

- the region of interest extraction unit (830) can scale the spatial resolution scale of the region of interest to be the same as the spatial resolution scale of the feature map from which the region of interest is to be extracted. For example, when the scale of the region of interest is the scale of the feature map having the smallest spatial resolution among the feature maps to be encoded, and the width and height of the current feature map to be extracted are a and b times larger in spatial resolution than the smallest feature map, the width and height of the region of interest can be scaled by multiplying a and b, respectively.

- the scaling can be performed by calculating a predetermined formula, or downsampling or upsampling based on a neural network can be performed.

- the region of interest extraction unit (830) can extract a set of elements whose spatial axis coordinates are included in the region of interest among the elements in the feature map.

- Fig. 12 (a) may represent an input of the region of interest extraction unit (830)

- Fig. 12 (b) may represent an output of the region of interest extraction unit (830).

- feature maps 0 to 3 may not extract regions of interest

- feature map 0 may represent an example in which two regions of interest are extracted.

- the coding group derivation unit (840) can group one or more feature maps to be encoded into one or more coding groups.

- the coding group can be an execution unit of the feature map conversion unit (850) or feature map encoding unit (860) of FIG. 8, or a transmission unit.

- the coding group derivation unit (840) can group feature maps into coding groups according to the following criteria.

- Criterion 1 All feature maps to be encoded can be grouped into one coding group.

- Criterion 2 Full-resolution feature maps from which the region of interest is not extracted and feature maps from which only the region of interest is extracted can be grouped into different coding groups.

- Criterion 3 Full-resolution feature maps from which regions of interest are not extracted can be grouped into one coding group.

- Criterion 4 Regions of interest with the same region of interest index can be grouped into one coding group.

- FIG. 13 is an example of an input value (a) and output values (b1, b2) of a coding group derivation unit (840) according to an embodiment of the present disclosure.

- the input value (a) of the coding group derivation unit (840) is a feature map to be encoded.

- the output value (b1) of the coding group derivation unit (840) exemplifies a result grouped according to the grouping criterion 1.

- the output value (b2) of the coding group derivation unit (840) exemplifies a result grouped according to the grouping criteria 2, 3, and 4.

- Coding group information may be included in the header (coding_group_header) of each coding group and transmitted to the VCM decoding device (100b).

- the coding_group_header syntax may be defined as in Fig. 25a.

- Coding group information may include a coding group index, the number of feature maps included in the coding group, an index of each feature map, and an ROI index if the feature map is ROI extracted.

- the feature map transformation unit (850) can perform transformation on feature maps within a coding group in units of coding groups.

- the type of transformation may be, for example, matrix multiplication-based transformation, multi-convolution layer-based transformation, etc.

- FIG. 15 illustrates an example of matrix multiplication-based feature map transformation according to an embodiment of the present disclosure

- FIG. 16 illustrates an example of multi-convolution layer-based feature map transformation according to an embodiment of the present disclosure.

- the reference attribute or type of transformation may be included in the coding_group_header and transmitted to the VCM decoding device (100b).

- the reference attribute of the transformation may mean whether only information within the feature map is used when performing transformation on an arbitrary feature map or whether information of another feature map is also used.

- the type of transformation may mean the type of algorithm that performs the transformation.

- FIG. 14 is a flowchart including a matrix multiplication-based feature map transformation process according to an embodiment of the present disclosure.

- the process of FIG. 14 can be performed by the feature map transformation unit (850), and each step of FIG. 14 can be selectively performed.

- FIG. 15 is an example of a matrix multiplication-based feature map transformation according to an embodiment of the present disclosure, in which (a) represents an input feature map, (b) represents a scale-transformed feature map, and (c) represents each example of a transformation unit.

- the feature map conversion unit (850) can perform spatial resolution scaling on each feature map in the coding group.

- the feature map conversion unit (850) can specify a degree of spatial resolution scaling for each feature map, and the scaling parameter can be included in the coding_group_header and transmitted to the VCM decoding device (100b).

- the feature map conversion unit (850) can fixedly use a method of downscaling each feature map to the spatial resolution of the feature map with the smallest spatial resolution in the conversion group.

- FIG. 15 (a) shows a coding group including a plurality of feature maps (feature maps 1 to 3) as an input value of the feature map conversion unit (850).

- FIG. 15 (b) can show an example of performing downsampling on each feature map (feature map 1, feature map 2) to the spatial resolution of feature map 3 with the smallest spatial resolution.

- the feature map transformation unit (850) can divide each feature map into transformation units (transformation units) and list them.

- the transformation unit can be data divided into a size of w_tu x h_tu x c_tu that does not overlap the feature map.

- Each of w_tu, h_tu, and c_tu can have a value of a divisor of a minimum width, a minimum height, and a minimum channel length among the scaled feature maps, respectively.

- FIG. 15 (c) is an example in which, when the scaled feature maps have the same width, height, and channel length, they are divided into transformation units having sizes of feature map width/2, feature map height/2, and 1, respectively.

- the w_tu, h_tu, and c_tu of the transformation unit can represent a case in which they are feature map width/2, feature map height/2, and 1, respectively. In this case, since the width and height of each feature map are reduced by 1/2, channel length * 4 transformation units per feature map can be derived.

- the feature map transformation unit (850) can perform matrix multiplication-based transformation for each derived transformation unit. For each transformation unit, a multiplication operation can be performed with matrix_num matrices to derive matrix_num transformation coefficients.

- FIG. 16 shows an example of feature map transformation based on multiple convolution layers according to an embodiment of the present disclosure.

- the feature map transformation unit (850) can perform multiple convolution layers that adjust the spatial resolution of one or more feature maps in a coding group to be the same, combine them into a channel axis, and then encapsulate them into a channel axis.

- the feature map transformation unit (850) can receive a coding group including feature maps 1 to 3, and adjust the spatial resolution to be the same based on feature map 3 having the smallest spatial resolution.

- the feature map transformation unit (850) can downscale the spatial resolutions of feature maps 1 and 2 to be the same as the spatial resolution of feature map 3.

- the feature map conversion unit (850) can combine feature maps 1 to 3 with the same spatial resolution along a channel axis, and then perform a multi-convolution layer that encapsulates the feature maps along the channel axis to output a feature map in which feature maps 1 to 3 are combined and converted.

- the feature map encoding unit (860) of the VCM encoding device (100a) can encode a transformed feature map output from the feature map conversion unit (850) or a feature map on which transformation has not been performed (a feature map output from the region of interest derivation unit (820)) in groups to output a bitstream.

- the feature map encoding unit (860) determines an encoding method to be used for feature map encoding among various encoding methods, and a syntax indicating the determined encoding method can be included in the coding_group_header and transmitted to the VCM decoding device (100b).

- the encoding method that can be used in the feature map encoding unit (860) may depend on the encoding reference attribute.

- the encoding reference attribute may mean whether only information inside the feature map is used when encoding an arbitrary feature map or whether information of another feature map is also used.

- the encoding reference attribute syntax may be included in the coding_group_header and transmitted to the VCM decoding device (100b), or may not be transmitted and the same value as the transformation reference attribute may be used.

- the feature map encoding unit (860) may transmit an index of an encoding algorithm to be used among encoding algorithms that can be performed on the encoding reference attribute of the current frame.

- the encoding method when the encoding reference attribute is intra, the encoding method may be an entropy coding-based method.

- the encoding method when the encoding reference attribute is inter, the encoding method may be a video-based non-deep learning method, a video-based deep learning method, etc. If the encoded reference attribute information is not transmitted, the same value as the converted reference attribute information may be used.

- the encoding process may be composed of stages such as prediction, transformation, quantization, and entropy coding, and each stage may be omitted.

- the prediction, transformation, and quantization stages may be omitted and only the entropy coding stage may be performed.

- the feature map encoding unit (860) may perform encoding after reconstructing the feature map or the transformed feature map within the coding group in the form of a one-dimensional array, a two-dimensional frame, or a three-dimensional matrix before performing feature map encoding.

- the feature map encoding unit (860) may designate local quantization parameters within the frame based on the region of interest received from the region of interest derivation unit (820).

- the feature map encoding unit (860) may designate different quantization parameters for the region of interest and the non-region of interest. For example, the feature map encoding unit (860) can designate a low quantization parameter for a region of interest and a high quantization parameter for a region of no interest.

- the feature map encoding unit (860) can perform encoding using a neural network structure composed of multiple convolution layers.

- FIG. 17 is a block diagram including components of a VCM decoding device according to one embodiment of the present disclosure.

- a VCM decoding device (100b) can receive a bitstream in which a feature map is compressed, restore the feature map, perform machine task analysis, and output the analysis result.

- the VCM decoding device (100b) can include a feature map decoding unit (1710), a feature map inverse transformation unit (1720), a feature map reconstruction unit (1730), and a machine task analysis unit (1740). Each component can be selectively performed at a sequence or frame level.

- the feature map decoding unit (1710) can restore a feature map or feature map transform coefficients by coding group unit from the received bitstream.

- the feature map inverse transform unit (1720) can perform inverse transform on feature map transform coefficients restored in units of coding groups.

- the feature map reconstruction unit (1730) can restore the number and size of feature maps initially extracted by the feature map extraction and selection unit (810) of the VCM encoding device (100a) by generating a feature map or a portion of a feature map that has not been transmitted or restored based on the restored feature map.

- the machine task analysis unit (1740) can perform machine tasks such as object detection, region segmentation, object tracking, action recognition, and situation interpretation using the restored feature map.

- the structure of the machine task analysis unit (1740) can be composed of multiple convolution layers and can include multiple convolution layers in front of the feature map extraction and selection unit (810) of the VCM encoding device (100a) that extracts the feature map.

- the machine task analysis unit (1740) can induce which layer among the multiple convolution layers of the machine task analysis unit (1740) will input the restored feature map to perform machine analysis based on the feature map extraction layer position (FM_extract_layer_idx) received from the picture level parameter set (picture_parameter_set).

- the feature map decoding unit (1710) can restore a feature map or a feature map transformation coefficient from the transmitted bitstream in units of coding groups. If a decoding reference attribute exists, the value transmitted in the coding group header (coding_group_header) can be parsed (is_intra_coded) or derived to a value equal to the transformation reference attribute value.

- the is_intra_coded syntax can be defined as in FIG. 25b.

- an index (intra_coding_method_idx, inter_coding_method_idx) indicating a decoding method to be used among the possible decoding methods can be parsed from the coding group header (coding_group_header). If the decoding reference attribute does not exist, the index (coding_method_idx) indicating the decoding method can be parsed independently.

- the feature map decoding unit (1710) may be performed using a neural network-based or non-neural network-based method. If performed using a non-neural network-based method, the decoding process may consist of steps such as prediction, transformation, quantization, and entropy coding, and each step may be omitted.

- the restored feature map or transformed feature map in the feature map decoding unit (1710) may be in a reconstructed form, and data restored to the original form of the feature map may be reversely reconstructed.

- the reconstructed form may be in the form of, for example, a one-dimensional array, a two-dimensional frame, or a three-dimensional matrix.

- the feature map inverse transformation unit (1720) can perform inverse transformation on feature map transformation coefficients within a coding group by coding group unit.

- the type of inverse transformation may be, for example, inverse transformation based on matrix multiplication, inverse transformation based on performing multiple convolution layers, etc.

- the feature map inverse transformation unit (1720) can perform inverse transformation corresponding to an inverse transformation method index (transform_method_idx) included in a coding group header (coding_group_header).

- the feature map inverse transformation unit (1720) can first parse a transformation reference attribute (is_intra_transformed) in the coding group header (coding_group_header), and when it is a parsed reference attribute, can parse an inverse transformation type index (intra_transform_method_idx, inter_transform_method_idx) to be used among possible inverse transformation methods.

- the feature map inverse transformation unit (1720) can parse the intra_transform_method_idx syntax as the inverse transformation type index when the transformation reference attribute (is_intra_transformed) is true, and can parse the inter_transform_method_idx syntax as the inverse transformation type index when the transformation reference attribute (is_intra_transformed) is false.

- the inverse transformation can be performed by a predefined inverse transformation method mapped to the value of intra_transform_method_idx or inter_transform_method_idx.

- the feature map inverse transformation unit (1720) can parse only the inverse transformation type index (transform_method_idx) when the transformation reference attribute (is_intra_transformed) syntax does not exist.

- the inverse transformation type of the feature map inverse transformation unit (1720) is a matrix multiplication-based method, it can be performed by the process of Fig. 18.

- FIG. 18 is a flowchart including a process of inverse transformation of a feature map based on matrix multiplication according to an embodiment of the present disclosure.

- FIG. 19 shows an example of inverse transformation of a feature map based on matrix multiplication according to an embodiment of the present disclosure.

- the feature map inverse transform unit (1720) can perform inverse transformation by multiplying the feature map transform coefficients of each inverse transform unit by an inverse transform matrix.

- An inverse transform matrix that matches the width and height (TU_width, TU_height) of the inverse transform unit transmitted in the coding group header (coding_group_header) is selected, and inverse transformation is performed to derive feature values of the size of the inverse transform unit.

- Fig. 19 (a) can represent result data in which inverse transformation is performed for each inverse transform unit for an arbitrary coding group.

- step S1802 the feature map inverse transformation unit (1720) can combine the inversely transformed data into the original feature map form.

- Fig. 19 (b) can represent the result of rearranging the inversely transformed data to the inverse transformation unit position in the original feature map.

- the feature map inverse transformation unit (1720) can perform inverse scaling on the inversely transformed feature map.