WO2020185005A1 - 변환에 기반한 영상 코딩 방법 및 그 장치 - Google Patents

변환에 기반한 영상 코딩 방법 및 그 장치 Download PDFInfo

- Publication number

- WO2020185005A1 WO2020185005A1 PCT/KR2020/003449 KR2020003449W WO2020185005A1 WO 2020185005 A1 WO2020185005 A1 WO 2020185005A1 KR 2020003449 W KR2020003449 W KR 2020003449W WO 2020185005 A1 WO2020185005 A1 WO 2020185005A1

- Authority

- WO

- WIPO (PCT)

- Prior art keywords

- block

- information

- transform

- current block

- height

- Prior art date

Links

Images

Classifications

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N19/00—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals

- H04N19/70—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals characterised by syntax aspects related to video coding, e.g. related to compression standards

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N19/00—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals

- H04N19/10—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding

- H04N19/102—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding characterised by the element, parameter or selection affected or controlled by the adaptive coding

- H04N19/132—Sampling, masking or truncation of coding units, e.g. adaptive resampling, frame skipping, frame interpolation or high-frequency transform coefficient masking

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N19/00—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals

- H04N19/10—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding

- H04N19/102—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding characterised by the element, parameter or selection affected or controlled by the adaptive coding

- H04N19/12—Selection from among a plurality of transforms or standards, e.g. selection between discrete cosine transform [DCT] and sub-band transform or selection between H.263 and H.264

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N19/00—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals

- H04N19/10—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding

- H04N19/102—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding characterised by the element, parameter or selection affected or controlled by the adaptive coding

- H04N19/13—Adaptive entropy coding, e.g. adaptive variable length coding [AVLC] or context adaptive binary arithmetic coding [CABAC]

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N19/00—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals

- H04N19/10—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding

- H04N19/134—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding characterised by the element, parameter or criterion affecting or controlling the adaptive coding

- H04N19/136—Incoming video signal characteristics or properties

- H04N19/137—Motion inside a coding unit, e.g. average field, frame or block difference

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N19/00—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals

- H04N19/10—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding

- H04N19/134—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding characterised by the element, parameter or criterion affecting or controlling the adaptive coding

- H04N19/136—Incoming video signal characteristics or properties

- H04N19/14—Coding unit complexity, e.g. amount of activity or edge presence estimation

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N19/00—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals

- H04N19/10—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding

- H04N19/134—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding characterised by the element, parameter or criterion affecting or controlling the adaptive coding

- H04N19/167—Position within a video image, e.g. region of interest [ROI]

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N19/00—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals

- H04N19/10—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding

- H04N19/169—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding characterised by the coding unit, i.e. the structural portion or semantic portion of the video signal being the object or the subject of the adaptive coding

- H04N19/17—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding characterised by the coding unit, i.e. the structural portion or semantic portion of the video signal being the object or the subject of the adaptive coding the unit being an image region, e.g. an object

- H04N19/176—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding characterised by the coding unit, i.e. the structural portion or semantic portion of the video signal being the object or the subject of the adaptive coding the unit being an image region, e.g. an object the region being a block, e.g. a macroblock

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N19/00—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals

- H04N19/10—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding

- H04N19/169—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding characterised by the coding unit, i.e. the structural portion or semantic portion of the video signal being the object or the subject of the adaptive coding

- H04N19/18—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding characterised by the coding unit, i.e. the structural portion or semantic portion of the video signal being the object or the subject of the adaptive coding the unit being a set of transform coefficients

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N19/00—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals

- H04N19/10—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding

- H04N19/189—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding characterised by the adaptation method, adaptation tool or adaptation type used for the adaptive coding

- H04N19/196—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding characterised by the adaptation method, adaptation tool or adaptation type used for the adaptive coding being specially adapted for the computation of encoding parameters, e.g. by averaging previously computed encoding parameters

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N19/00—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals

- H04N19/60—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using transform coding

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N19/00—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals

- H04N19/60—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using transform coding

- H04N19/625—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using transform coding using discrete cosine transform [DCT]

Definitions

- This document relates to an image coding technique, and more particularly, to a transform-based image coding method and apparatus thereof in an image coding system.

- VR Virtual Reality

- AR Artificial Realtiy

- high-efficiency video/video compression technology is required in order to effectively compress, transmit, store, and reproduce information of high-resolution, high-quality video/video having various characteristics as described above.

- the technical problem of this document is to provide a method and apparatus for increasing image coding efficiency.

- Another technical problem of this document is to provide a method and apparatus for increasing the efficiency of residual coding.

- Another technical problem of this document is to provide a method and apparatus for improving coding efficiency for the last non-zero transform coefficient position.

- Another technical problem of this document is to provide a method and apparatus for enhancing residual coding efficiency by coding a transform coefficient based on high frequency zeroing.

- Another technical problem of this document is to provide a method and apparatus for coding position information of a last significant coefficient in a current block (or a current transform block) based on high frequency zeroing.

- Another technical problem of this document is when coding transform coefficients for the current block (or current transform block) based on high frequency zeroing, the last effective transform based on the size of the region to which the high frequency zeroing is not applied in the current block. It is to provide a method and apparatus for deriving a maximum value of suffix information for a position of a coefficient.

- Another technical task of this document is to derive a context model for the position information of the last effective transform coefficient based on the current block size when coding transform coefficients for the current block (or current transform block) based on high frequency zeroing. It is to provide a method and apparatus.

- a video decoding method performed by a decoding apparatus includes deriving a residual sample, and the deriving the residual sample comprises: deriving a zero-out block for a current block; Deriving a context model for the position information of the last effective coefficient based on the width or height of the current block; Deriving a value of a last significant coefficient position based on the context model; And deriving a last significant coefficient position based on the value of the last significant coefficient position information and the width or height of the zero-out block.

- the width of the zero-out block may be smaller than the width of the current block.

- the height of the zero-out block may be smaller than the height of the current block.

- the last significant coefficient position information includes last significant coefficient prefix information and last significant coefficient suffix information

- the last significant coefficient prefix information includes x-axis prefix information and y It includes axis prefix information

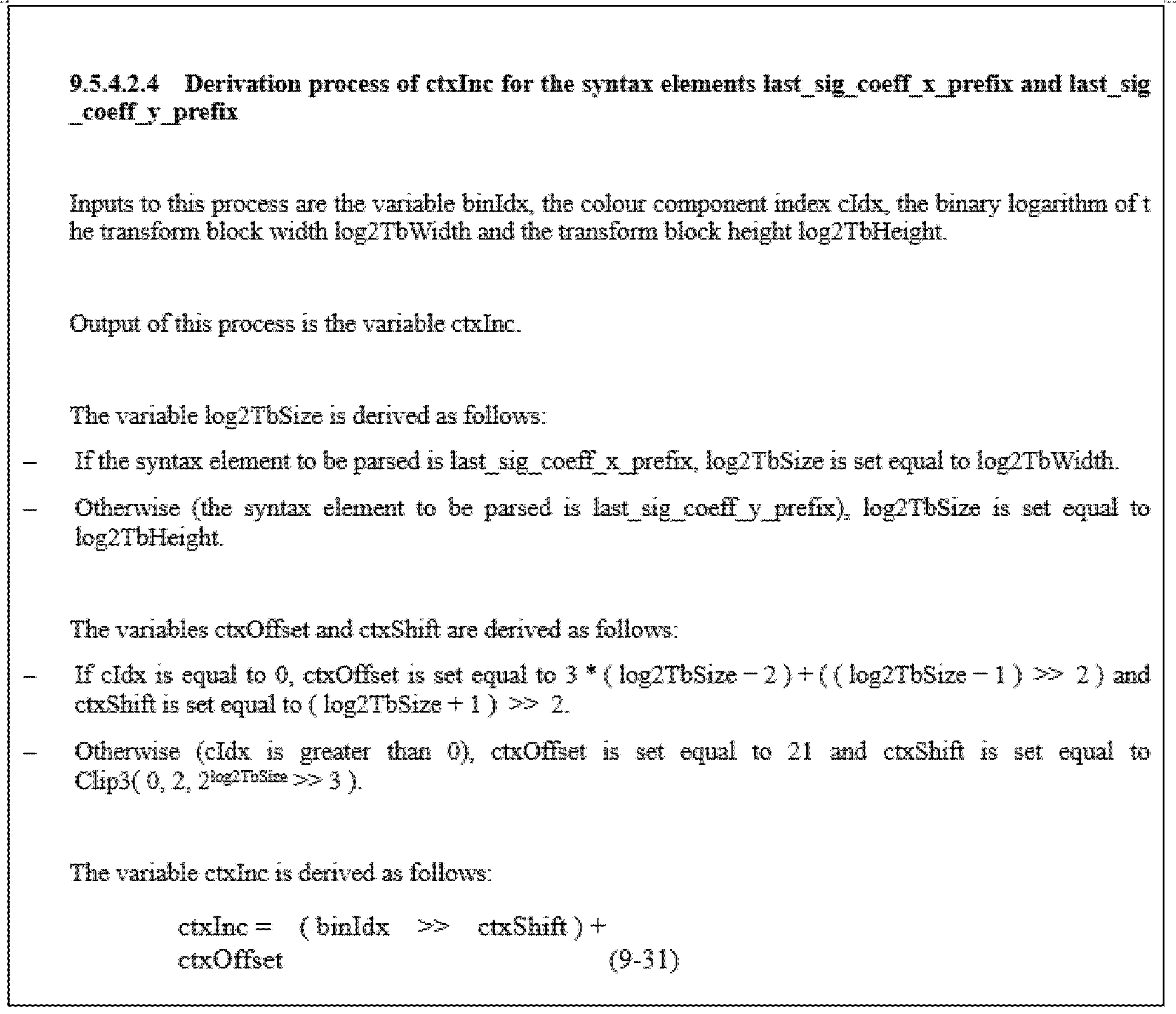

- context increments for the x-axis prefix information and the y-axis prefix information may be derived based on the width or height of the current block.

- the maximum value that the last significant coefficient prefix information may have may be derived based on the size of the zero-out block.

- the width or height of the zero-out block may be derived based on the width or height of the current block.

- the width of the zero-out block is set to 16, and if the width of the current block is not 32 or the height of the current block is 64 or more, The width of the zero-out block may be set to a smaller value of 32 and the width of the current block.

- the height of the zero-out block is set to 16, and if the height of the current block is not 32 or the width of the current block is 64 or more, the The height of the zero-out block may be set to a smaller value among the height of the current block and 32.

- a video encoding method performed by an encoding device includes encoding residual information, the encoding step of deriving a zero-out block for a current block; Deriving a last significant coefficient position based on the width or height of the zero-out block; Deriving a context model for the location information of the last effective coefficient based on the width or height of the current block; It may include encoding the last significant coefficient position information based on the context model.

- a digital storage medium in which image data including a bitstream and encoded image information generated according to an image encoding method performed by an encoding apparatus is stored may be provided.

- a digital storage medium in which image data including encoded image information and a bitstream causing the decoding apparatus to perform the image decoding method are stored may be provided.

- a residual coding efficiency may be improved by coding a transform coefficient based on high frequency zeroing (or high frequency zero-out).

- image coding efficiency may be improved by coding position information of a last effective transform coefficient in a current block (or current transform block) based on high frequency zeroing.

- Another technical task of this document is when coding transform coefficients for the current block (or current transform block) based on high frequency zeroing, by deriving a context model for the position information of the last effective transform coefficient based on a predetermined block size. Image coding efficiency can be improved.

- FIG. 1 schematically shows an example of a video/video coding system to which this document can be applied.

- FIG. 2 is a diagram schematically illustrating a configuration of a video/video encoding apparatus to which this document can be applied.

- FIG. 3 is a diagram schematically illustrating a configuration of a video/video decoding apparatus to which the present document can be applied.

- 5 is a diagram for describing a 32-point zero-out according to an example of this document.

- FIG. 6 is a diagram illustrating division of a residual block according to an example of the present document.

- FIG. 7 is a flowchart illustrating an operation of a video decoding apparatus according to an embodiment of the present document.

- FIG. 8 is a block diagram showing the configuration of a decoding apparatus according to an embodiment of the present document.

- FIG. 9 is a flowchart illustrating a process of deriving a residual sample according to an embodiment of the present document.

- FIG. 10 is a flowchart illustrating an operation of a video encoding apparatus according to an embodiment of the present document.

- FIG. 11 is a block diagram showing the configuration of an encoding apparatus according to an embodiment of the present document.

- FIG. 12 is a flowchart illustrating a process of encoding residual information according to an embodiment of the present document.

- FIG. 13 exemplarily shows a structure diagram of a content streaming system to which this document is applied.

- each of the components in the drawings described in this document is independently illustrated for convenience of description of different characteristic functions, and does not mean that each component is implemented as separate hardware or separate software.

- two or more of the configurations may be combined to form one configuration, or one configuration may be divided into a plurality of configurations.

- Embodiments in which each configuration is integrated and/or separated are also included in the scope of the rights of this document, unless departing from the essence of this document.

- VVC Very Video Coding

- HEVC High Efficiency Video Coding

- EMC essential video coding

- video may mean a set of images over time.

- a picture generally refers to a unit representing one image in a specific time period, and a slice/tile is a unit constituting a part of a picture in coding.

- a slice/tile may include one or more coding tree units (CTU).

- CTU coding tree units

- One picture may be composed of one or more slices/tiles.

- One picture may consist of one or more tile groups.

- One tile group may include one or more tiles.

- a pixel or pel may mean a minimum unit constituting one picture (or image).

- sample' may be used as a term corresponding to a pixel.

- a sample may generally represent a pixel or a value of a pixel, may represent only a pixel/pixel value of a luma component, or may represent only a pixel/pixel value of a chroma component.

- the sample may mean a pixel value in the spatial domain, and when such a pixel value is converted to the frequency domain, it may mean a transform coefficient in the frequency domain.

- a unit may represent a basic unit of image processing.

- the unit may include at least one of a specific area of a picture and information related to the corresponding area.

- One unit may include one luma block and two chroma (ex. cb, cr) blocks.

- the unit may be used interchangeably with terms such as a block or an area depending on the case.

- the MxN block may include samples (or sample arrays) consisting of M columns and N rows, or a set (or array) of transform coefficients.

- A/B may mean “A and/or B.”

- A, B may mean “A and/or B.”

- A/B/C may mean “at least one of A, B, and/or C.”

- A/B/C may mean “ at least one of A, B, and/or C.”

- At least one of A and B may mean “only A”, “only B”, or “both A and B”.

- the expression “at least one of A or B” or “at least one of A and/or B” means “at least one It can be interpreted the same as "at least one of A and B”.

- At least one of A, B and C means “only A”, “only B”, “only C”, or “A, B and C Can mean any combination of A, B and C”.

- at least one of A, B or C or “at least one of A, B and/or C” means It can mean “at least one of A, B and C”.

- parentheses used in the present specification may mean "for example”. Specifically, when indicated as “prediction (intra prediction)”, “intra prediction” may be proposed as an example of “prediction”. In other words, “prediction” in the present specification is not limited to “intra prediction”, and “intra prediction” may be suggested as an example of “prediction”. In addition, even when displayed as “prediction (ie, intra prediction)”, “intra prediction” may be proposed as an example of “prediction”.

- FIG. 1 schematically shows an example of a video/video coding system to which this document can be applied.

- a video/image coding system may include a source device and a reception device.

- the source device may transmit the encoded video/image information or data in a file or streaming form to the receiving device through a digital storage medium or a network.

- the source device may include a video source, an encoding device, and a transmission unit.

- the receiving device may include a receiving unit, a decoding device, and a renderer.

- the encoding device may be referred to as a video/image encoding device, and the decoding device may be referred to as a video/image decoding device.

- the transmitter may be included in the encoding device.

- the receiver may be included in the decoding device.

- the renderer may include a display unit, and the display unit may be configured as a separate device or an external component.

- the video source may acquire a video/image through a process of capturing, synthesizing, or generating a video/image.

- the video source may include a video/image capturing device and/or a video/image generating device.

- the video/image capture device may include, for example, one or more cameras, a video/image archive including previously captured video/images, and the like.

- the video/image generating device may include, for example, a computer, a tablet and a smartphone, and may (electronically) generate a video/image.

- a virtual video/image may be generated through a computer or the like, and in this case, a video/image capturing process may be substituted as a process of generating related data.

- the encoding device may encode the input video/video.

- the encoding apparatus may perform a series of procedures such as prediction, transformation, and quantization for compression and coding efficiency.

- the encoded data (encoded video/video information) may be output in the form of a bitstream.

- the transmission unit may transmit the encoded video/video information or data output in the form of a bitstream to the reception unit of the receiving device through a digital storage medium or a network in a file or streaming form.

- Digital storage media may include various storage media such as USB, SD, CD, DVD, Blu-ray, HDD, and SSD.

- the transmission unit may include an element for generating a media file through a predetermined file format, and may include an element for transmission through a broadcast/communication network.

- the receiver may receive/extract the bitstream and transmit it to the decoding device.

- the decoding device may decode the video/image by performing a series of procedures such as inverse quantization, inverse transformation, and prediction corresponding to the operation of the encoding device.

- the renderer can render the decoded video/video.

- the rendered video/image may be displayed through the display unit.

- the video encoding device may include an image encoding device.

- the encoding device 200 includes an image partitioner 210, a predictor 220, a residual processor 230, an entropy encoder 240, and It may be configured to include an adder 250, a filter 260, and a memory 270.

- the prediction unit 220 may include an inter prediction unit 221 and an intra prediction unit 222.

- the residual processing unit 230 may include a transform unit 232, a quantizer 233, an inverse quantizer 234, and an inverse transformer 235.

- the residual processing unit 230 may further include a subtractor 231.

- the addition unit 250 may be referred to as a reconstructor or a recontructged block generator.

- the image segmentation unit 210, the prediction unit 220, the residual processing unit 230, the entropy encoding unit 240, the addition unit 250, and the filtering unit 260 described above may include one or more hardware components (for example, it may be configured by an encoder chipset or a processor).

- the memory 270 may include a decoded picture buffer (DPB), and may be configured by a digital storage medium.

- the hardware component may further include the memory 270 as an internal/external component.

- the image segmentation unit 210 may divide an input image (or picture, frame) input to the encoding apparatus 200 into one or more processing units.

- the processing unit may be referred to as a coding unit (CU).

- the coding unit is recursively divided according to the QTBTTT (Quad-tree binary-tree ternary-tree) structure from a coding tree unit (CTU) or a largest coding unit (LCU).

- QTBTTT Quad-tree binary-tree ternary-tree

- CTU coding tree unit

- LCU largest coding unit

- one coding unit may be divided into a plurality of coding units of a deeper depth based on a quad tree structure, a binary tree structure, and/or a ternary structure.

- a quad tree structure may be applied first, and a binary tree structure and/or a ternary structure may be applied later.

- the binary tree structure may be applied first.

- the coding procedure according to this document may be performed based on the final coding unit that is no longer divided. In this case, based on the coding efficiency according to the image characteristics, the maximum coding unit can be directly used as the final coding unit, or if necessary, the coding unit is recursively divided into coding units of lower depth to be optimal. A coding unit of the size of may be used as the final coding unit.

- the coding procedure may include a procedure such as prediction, transformation, and restoration described later.

- the processing unit may further include a prediction unit (PU) or a transform unit (TU).

- the prediction unit and the transform unit may be divided or partitioned from the above-described final coding unit, respectively.

- the prediction unit may be a unit of sample prediction

- the transform unit may be a unit for inducing a transform coefficient and/or a unit for inducing a residual signal from the transform coefficient.

- the unit may be used interchangeably with terms such as a block or an area depending on the case.

- the MxN block may represent a set of samples or transform coefficients consisting of M columns and N rows.

- a sample may represent a pixel or a value of a pixel, may represent only a pixel/pixel value of a luminance component, or may represent only a pixel/pixel value of a saturation component.

- a sample may be used as a term corresponding to one picture (or image) as a pixel or pel.

- the subtraction unit 231 subtracts the prediction signal (predicted block, prediction samples, or prediction sample array) output from the prediction unit 220 from the input image signal (original block, original samples, or original sample array) to make a residual.

- a signal residual block, residual samples, or residual sample array

- the prediction unit 220 may perform prediction on a block to be processed (hereinafter referred to as a current block) and generate a predicted block including prediction samples for the current block.

- the predictor 220 may determine whether intra prediction or inter prediction is applied in units of a current block or CU.

- the prediction unit may generate various information related to prediction, such as prediction mode information, as described later in the description of each prediction mode, and transmit it to the entropy encoding unit 240.

- the information on prediction may be encoded by the entropy encoding unit 240 and output in the form of a bitstream.

- the intra prediction unit 222 may predict the current block by referring to samples in the current picture.

- the referenced samples may be located in the vicinity of the current block or may be located apart according to the prediction mode.

- prediction modes may include a plurality of non-directional modes and a plurality of directional modes.

- the non-directional mode may include, for example, a DC mode and a planar mode (Planar mode).

- the directional mode may include, for example, 33 directional prediction modes or 65 directional prediction modes according to a detailed degree of the prediction direction. However, this is an example, and more or less directional prediction modes may be used depending on the setting.

- the intra prediction unit 222 may determine a prediction mode applied to the current block by using the prediction mode applied to the neighboring block.

- the inter prediction unit 221 may derive a predicted block for the current block based on a reference block (reference sample array) specified by a motion vector on the reference picture.

- motion information may be predicted in units of blocks, subblocks, or samples based on correlation between motion information between neighboring blocks and the current block.

- the motion information may include a motion vector and a reference picture index.

- the motion information may further include inter prediction direction (L0 prediction, L1 prediction, Bi prediction, etc.) information.

- the neighboring block may include a spatial neighboring block existing in the current picture and a temporal neighboring block existing in the reference picture.

- the reference picture including the reference block and the reference picture including the temporal neighboring block may be the same or different.

- the temporal neighboring block may be referred to by a name such as a collocated reference block, a colCU, or the like, and a reference picture including the temporal neighboring block may be referred to as a collocated picture (colPic).

- a collocated picture colPic

- the inter prediction unit 221 constructs a motion information candidate list based on neighboring blocks, and provides information indicating which candidate is used to derive a motion vector and/or a reference picture index of the current block. Can be generated. Inter prediction may be performed based on various prediction modes.

- the inter prediction unit 221 may use motion information of a neighboring block as motion information of a current block.

- a residual signal may not be transmitted.

- MVP motion vector prediction

- the motion vector of the current block is calculated by using the motion vector of the neighboring block as a motion vector predictor and signaling a motion vector difference. I can instruct.

- the prediction unit 220 may generate a prediction signal based on various prediction methods to be described later.

- the prediction unit may apply intra prediction or inter prediction for prediction of one block, as well as simultaneously apply intra prediction and inter prediction. This can be called combined inter and intra prediction (CIIP).

- the prediction unit may perform intra block copy (IBC) to predict a block.

- the intra block copy may be used for content image/video coding such as a game, for example, screen content coding (SCC).

- SCC screen content coding

- IBC basically performs prediction in the current picture, but can be performed similarly to inter prediction in that it derives a reference block in the current picture. That is, the IBC may use at least one of the inter prediction techniques described in this document.

- the prediction signal generated by the inter prediction unit 221 and/or the intra prediction unit 222 may be used to generate a reconstructed signal or may be used to generate a residual signal.

- the transform unit 232 may generate transform coefficients by applying a transform technique to the residual signal.

- the transformation technique may include Discrete Cosine Transform (DCT), Discrete Sine Transform (DST), Graph-Based Transform (GBT), or Conditionally Non-linear Transform (CNT).

- DCT Discrete Cosine Transform

- DST Discrete Sine Transform

- GBT Graph-Based Transform

- CNT Conditionally Non-linear Transform

- GBT refers to the transformation obtained from this graph when the relationship information between pixels is expressed in a graph.

- CNT refers to a transformation obtained based on generating a prediction signal using all previously reconstructed pixels.

- the conversion process may be applied to a pixel block having the same size of a square, or may be applied to a block having a variable size other

- the quantization unit 233 quantizes the transform coefficients and transmits it to the entropy encoding unit 240, and the entropy encoding unit 240 encodes the quantized signal (information on quantized transform coefficients) and outputs it as a bitstream. have.

- the information on the quantized transform coefficients may be called residual information.

- the quantization unit 233 may rearrange the quantized transform coefficients in the form of blocks into a one-dimensional vector form based on a coefficient scan order, and the quantized transform coefficients in the form of the one-dimensional vector It is also possible to generate information about transform coefficients.

- the entropy encoding unit 240 may perform various encoding methods such as exponential Golomb, context-adaptive variable length coding (CAVLC), and context-adaptive binary arithmetic coding (CABAC).

- the entropy encoding unit 240 may encode together or separately information necessary for video/image reconstruction (eg, values of syntax elements) in addition to quantized transform coefficients.

- the encoded information (eg, encoded video/video information) may be transmitted or stored in a bitstream format in units of network abstraction layer (NAL) units.

- the video/video information may further include information on various parameter sets, such as an adaptation parameter set (APS), a picture parameter set (PPS), a sequence parameter set (SPS), or a video parameter set (VPS).

- the video/video information may further include general constraint information.

- Signaling/transmitted information and/or syntax elements described later in this document may be encoded through the above-described encoding procedure and included in the bitstream.

- the bitstream may be transmitted through a network or may be stored in a digital storage medium.

- the network may include a broadcasting network and/or a communication network

- the digital storage medium may include various storage media such as USB, SD, CD, DVD, Blu-ray, HDD, and SSD.

- a transmission unit for transmitting and/or a storage unit (not shown) for storing may be configured as an internal/external element of the encoding apparatus 200, or the transmission unit It may be included in the entropy encoding unit 240.

- the quantized transform coefficients output from the quantization unit 233 may be used to generate a prediction signal.

- a residual signal residual block or residual samples

- the addition unit 250 may generate a reconstructed signal (a reconstructed picture, a reconstructed block, reconstructed samples, or a reconstructed sample array) by adding the reconstructed residual signal to the prediction signal output from the prediction unit 220 .

- the predicted block may be used as a reconstructed block.

- the generated reconstructed signal may be used for intra prediction of the next processing target block in the current picture, and may be used for inter prediction of the next picture through filtering as described later.

- LMCS luma mapping with chroma scaling

- the filtering unit 260 may improve subjective/objective image quality by applying filtering to the reconstructed signal.

- the filtering unit 260 may apply various filtering methods to the reconstructed picture to generate a modified reconstructed picture, and the modified reconstructed picture may be converted to the memory 270, specifically, the DPB of the memory 270. Can be saved on.

- the various filtering methods may include, for example, deblocking filtering, sample adaptive offset (SAO), adaptive loop filter, bilateral filter, and the like.

- the filtering unit 260 may generate a variety of filtering information and transmit it to the entropy encoding unit 290 as described later in the description of each filtering method.

- the filtering information may be encoded by the entropy encoding unit 290 and output in the form of a bitstream.

- the modified reconstructed picture transmitted to the memory 270 may be used as a reference picture in the inter prediction unit 280.

- the encoding device may avoid prediction mismatch between the encoding device 200 and the decoding device, and may improve encoding efficiency.

- the DPB of the memory 270 may store the modified reconstructed picture to be used as a reference picture in the inter prediction unit 221.

- the memory 270 may store motion information of a block from which motion information in a current picture is derived (or encoded) and/or motion information of blocks in a picture that have already been reconstructed.

- the stored motion information may be transferred to the inter prediction unit 221 in order to be used as motion information of spatial neighboring blocks or motion information of temporal neighboring blocks.

- the memory 270 may store reconstructed samples of reconstructed blocks in the current picture, and may be transmitted to the intra prediction unit 222.

- FIG. 3 is a diagram schematically illustrating a configuration of a video/video decoding apparatus to which the present document can be applied.

- the decoding apparatus 300 includes an entropy decoder 310, a residual processor 320, a predictor 330, an adder 340, and a filtering unit. It may be configured to include (filter, 350) and memory (memoery) 360.

- the prediction unit 330 may include an inter prediction unit 331 and an intra prediction unit 332.

- the residual processing unit 320 may include a dequantizer 321 and an inverse transformer 321.

- the entropy decoding unit 310, the residual processing unit 320, the prediction unit 330, the addition unit 340, and the filtering unit 350 described above are one hardware component (for example, a decoder chipset or a processor). ) Can be configured.

- the memory 360 may include a decoded picture buffer (DPB), and may be configured by a digital storage medium.

- the hardware component may further include the memory 360 as an internal/external component.

- the decoding apparatus 300 may reconstruct an image in response to a process in which the video/image information is processed by the encoding apparatus of FIG. 2. For example, the decoding apparatus 300 may derive units/blocks based on block division related information obtained from the bitstream.

- the decoding device 300 may perform decoding using a processing unit applied in the encoding device.

- the processing unit of decoding may be, for example, a coding unit, and the coding unit may be divided from a coding tree unit or a maximum coding unit along a quad tree structure, a binary tree structure and/or a ternary tree structure.

- One or more transform units may be derived from the coding unit.

- the reconstructed image signal decoded and output through the decoding device 300 may be reproduced through the playback device.

- the decoding apparatus 300 may receive a signal output from the encoding apparatus of FIG. 2 in the form of a bitstream, and the received signal may be decoded through the entropy decoding unit 310.

- the entropy decoding unit 310 may parse the bitstream to derive information (eg, video/video information) necessary for image restoration (or picture restoration).

- the video/video information may further include information on various parameter sets, such as an adaptation parameter set (APS), a picture parameter set (PPS), a sequence parameter set (SPS), or a video parameter set (VPS).

- the video/video information may further include general constraint information.

- the decoding apparatus may further decode the picture based on the information on the parameter set and/or the general restriction information.

- Signaled/received information and/or syntax elements described later in this document may be decoded through the decoding procedure and obtained from the bitstream.

- the entropy decoding unit 310 decodes information in the bitstream based on a coding method such as exponential Golomb coding, CAVLC, or CABAC, and a value of a syntax element required for image restoration, a quantized value of a transform coefficient related to a residual. Can be printed.

- the CABAC entropy decoding method receives a bin corresponding to each syntax element in a bitstream, and includes information on a syntax element to be decoded and information on a neighboring and decoding target block or information on a symbol/bin decoded in a previous step.

- a context model is determined using the context model, and a symbol corresponding to the value of each syntax element can be generated by performing arithmetic decoding of the bin by predicting the probability of occurrence of a bin according to the determined context model.

- the CABAC entropy decoding method may update the context model using information of the decoded symbol/bin for the context model of the next symbol/bin after the context model is determined.

- information on prediction is provided to the prediction unit 330, and information on the residual on which entropy decoding is performed by the entropy decoding unit 310, that is, quantized transform coefficients, and Related parameter information may be input to the inverse quantization unit 321.

- information about filtering among information decoded by the entropy decoding unit 310 may be provided to the filtering unit 350.

- a receiver (not shown) for receiving a signal output from the encoding device may be further configured as an inner/outer element of the decoding device 300, or the receiver may be a component of the entropy decoding unit 310.

- the decoding apparatus according to this document may be called a video/video/picture decoding apparatus, and the decoding apparatus can be divided into an information decoder (video/video/picture information decoder) and a sample decoder (video/video/picture sample decoder). May be.

- the information decoder may include the entropy decoding unit 310, and the sample decoder includes the inverse quantization unit 321, an inverse transform unit 322, a prediction unit 330, an addition unit 340, and a filtering unit ( 350) and at least one of the memory 360 may be included.

- the inverse quantization unit 321 may inverse quantize the quantized transform coefficients and output transform coefficients.

- the inverse quantization unit 321 may rearrange the quantized transform coefficients in a two-dimensional block shape. In this case, the rearrangement may be performed based on the coefficient scan order performed by the encoding device.

- the inverse quantization unit 321 may perform inverse quantization on quantized transform coefficients by using a quantization parameter (for example, quantization step size information) and obtain transform coefficients.

- a quantization parameter for example, quantization step size information

- the inverse transform unit 322 obtains a residual signal (residual block, residual sample array) by inverse transforming the transform coefficients.

- the prediction unit may perform prediction on the current block and generate a predicted block including prediction samples for the current block.

- the prediction unit may determine whether intra prediction or inter prediction is applied to the current block based on the information about the prediction output from the entropy decoding unit 310, and may determine a specific intra/inter prediction mode.

- the prediction unit may generate a prediction signal based on various prediction methods to be described later. For example, the prediction unit may apply intra prediction or inter prediction for prediction of one block, as well as simultaneously apply intra prediction and inter prediction. This can be called combined inter and intra prediction (CIIP).

- the prediction unit may perform intra block copy (IBC) to predict a block.

- the intra block copy may be used for content image/video coding such as a game, for example, screen content coding (SCC).

- SCC screen content coding

- IBC basically performs prediction in the current picture, but can be performed similarly to inter prediction in that it derives a reference block in the current picture. That is, the IBC may use at least one of the inter prediction techniques described in this document.

- the intra prediction unit 332 may predict the current block by referring to samples in the current picture.

- the referenced samples may be located in the vicinity of the current block or may be located apart according to the prediction mode.

- prediction modes may include a plurality of non-directional modes and a plurality of directional modes.

- the intra prediction unit 332 may determine a prediction mode applied to the current block by using the prediction mode applied to the neighboring block.

- the inter prediction unit 331 may derive a predicted block for the current block based on a reference block (reference sample array) specified by a motion vector on the reference picture.

- motion information may be predicted in units of blocks, subblocks, or samples based on correlation between motion information between neighboring blocks and the current block.

- the motion information may include a motion vector and a reference picture index.

- the motion information may further include inter prediction direction (L0 prediction, L1 prediction, Bi prediction, etc.) information.

- the neighboring block may include a spatial neighboring block existing in the current picture and a temporal neighboring block existing in the reference picture.

- the inter prediction unit 331 may construct a motion information candidate list based on neighboring blocks, and derive a motion vector and/or a reference picture index of the current block based on the received candidate selection information.

- Inter prediction may be performed based on various prediction modes, and the information about the prediction may include information indicating a mode of inter prediction for the current block.

- the addition unit 340 adds the obtained residual signal to the prediction signal (predicted block, prediction sample array) output from the prediction unit 330 to generate a reconstructed signal (restored picture, reconstructed block, reconstructed sample array). I can. When there is no residual for a block to be processed, such as when the skip mode is applied, the predicted block may be used as a reconstructed block.

- the addition unit 340 may be referred to as a restoration unit or a restoration block generation unit.

- the generated reconstructed signal may be used for intra prediction of the next processing target block in the current picture, may be output through filtering as described later, or may be used for inter prediction of the next picture.

- LMCS luma mapping with chroma scaling

- the filtering unit 350 may improve subjective/objective image quality by applying filtering to the reconstructed signal.

- the filtering unit 350 may apply various filtering methods to the reconstructed picture to generate a modified reconstructed picture, and the modified reconstructed picture may be converted to the memory 60, specifically, the DPB of the memory 360. Can be transferred to.

- the various filtering methods may include, for example, deblocking filtering, sample adaptive offset, adaptive loop filter, bilateral filter, and the like.

- the (modified) reconstructed picture stored in the DPB of the memory 360 may be used as a reference picture in the inter prediction unit 331.

- the memory 360 may store motion information of a block from which motion information in a current picture is derived (or decoded) and/or motion information of blocks in a picture that have already been reconstructed.

- the stored motion information may be transmitted to the inter prediction unit 331 to be used as motion information of spatial neighboring blocks or motion information of temporal neighboring blocks.

- the memory 360 may store reconstructed samples of reconstructed blocks in the current picture, and may be transmitted to the intra prediction unit 332.

- the embodiments described in the prediction unit 330, the inverse quantization unit 321, the inverse transform unit 322, and the filtering unit 350 of the decoding apparatus 300 are each a prediction unit ( 220), the inverse quantization unit 234, the inverse transform unit 235, and the filtering unit 260 may be applied in the same or corresponding manner.

- a predicted block including prediction samples for a current block as a coding target block may be generated.

- the predicted block includes prediction samples in the spatial domain (or pixel domain).

- the predicted block is derived equally from the encoding device and the decoding device, and the encoding device decodes information (residual information) about the residual between the original block and the predicted block, not the original sample value of the original block itself.

- Video coding efficiency can be improved by signaling to the device.

- the decoding apparatus may derive a residual block including residual samples based on the residual information, and generate a reconstructed block including reconstructed samples by summing the residual block and the predicted block. A reconstructed picture to be included can be generated.

- the residual information may be generated through transformation and quantization procedures.

- the encoding apparatus derives a residual block between the original block and the predicted block, and derives transform coefficients by performing a transformation procedure on residual samples (residual sample array) included in the residual block. And, by performing a quantization procedure on the transform coefficients, quantized transform coefficients may be derived, and related residual information may be signaled to a decoding apparatus (via a bitstream).

- the residual information may include information such as value information of the quantized transform coefficients, position information, a transform technique, a transform kernel, and a quantization parameter.

- the decoding apparatus may perform an inverse quantization/inverse transform procedure based on the residual information and derive residual samples (or residual blocks).

- the decoding apparatus may generate a reconstructed picture based on the predicted block and the residual block.

- the encoding apparatus may also inverse quantize/inverse transform quantized transform coefficients for reference for inter prediction of a picture to derive a residual block, and generate a reconstructed picture based on this.

- the transform unit may correspond to the transform unit in the encoding apparatus of FIG. 2 described above, and the inverse transform unit may correspond to the inverse transform unit in the encoding apparatus of FIG. 2 or the inverse transform unit in the decoding apparatus of FIG. 3. .

- the transform unit may derive (first-order) transform coefficients by performing first-order transform based on the residual samples (residual sample array) in the residual block (S410).

- This primary transform may be referred to as a core transform.

- the first-order transformation may be based on multiple transformation selection (MTS), and when multiple transformation is applied as the first-order transformation, it may be referred to as a multiple core transformation.

- MTS multiple transformation selection

- the multiple core transformation may indicate a method of additionally using Discrete Cosine Transform (DST) type 2, Discrete Sine Transform (DST) type 7, DCT type 8, and/or DST type 1. That is, the multi-core transform is based on a plurality of transform kernels selected from among the DCT type 2, the DST type 7, the DCT type 8, and the DST type 1, based on the residual signal (or residual block) in the spatial domain in the frequency domain.

- a transform method of transforming into transform coefficients (or first-order transform coefficients) of may be represented.

- the first-order transform coefficients may be referred to as temporary transform coefficients from the perspective of the transform unit.

- transformation coefficients can be generated by applying a transformation from a spatial domain to a frequency domain for a residual signal (or a residual block) based on DCT type 2.

- Transform to may be applied to generate transform coefficients (or first order transform coefficients).

- DCT type 2, DST type 7, DCT type 8, and DST type 1 may be referred to as a transform type, a transform kernel, or a transform core.

- a vertical transformation kernel and a horizontal transformation kernel for a target block may be selected from among the transformation kernels, and a vertical transformation for the target block is performed based on the vertical transformation kernel, and the Horizontal transformation may be performed on the target block based on the horizontal transformation kernel.

- the horizontal transformation may represent transformation of horizontal components of the target block

- the vertical transformation may represent transformation of vertical components of the target block.

- the vertical transform kernel/horizontal transform kernel may be adaptively determined based on a prediction mode and/or a transform index of a target block (CU or subblock) including a residual block.

- mapping relationship can be set. For example, if the horizontal direction conversion kernel is represented by trTypeHor and the vertical direction conversion kernel is represented by trTypeVer, the value of trTypeHor or trTypeVer is set to DCT2, the value of trTypeHor or trTypeVer is set to DST7, and the value of trTypeHor or trTypeVer is 2 May be set to DCT8.

- MTS index information may be encoded and signaled to a decoding device to indicate any one of a plurality of transform kernel sets. For example, if the MTS index is 0, it indicates that both trTypeHor and trTypeVer values are 0, if the MTS index is 1, it indicates that both trTypeHor and trTypeVer values are 1, and if the MTS index is 2, the trTypeHor value is 2 and the trTypeVer value Is 1, if the MTS index is 3, the trTypeHor value is 1 and the trTypeVer value is 2, and if the MTS index is 4, it may indicate that both trTypeHor and trTypeVer values are 2.

- a conversion kernel set according to MTS index information is shown in a table as follows.

- trTypeHor and trTypeVer when representing trTypeHor and trTypeVer according to MTS index information (mts_idx[ x ][ y ]) and a prediction mode (CuPredMode[ x ][ y ]) for a current block (eg, a current coding block) It is as follows.

- the transform unit may derive modified (second-order) transform coefficients by performing a second-order transform based on the (first-order) transform coefficients (S420).

- the first-order transform is a transform from a spatial domain to a frequency domain

- the second-order transform refers to transforming into a more compressive expression using a correlation existing between (first-order) transform coefficients.

- the second-order transform may include a non-separable transform.

- the second transform may be referred to as a non-separable secondary transform (NSST) or a mode-dependent non-separable secondary transform (MDNSST).

- the non-separated quadratic transform is a second-order transform of the (first-order) transform coefficients derived through the first-order transform based on a non-separable transform matrix, and modified transform coefficients for a residual signal. It may represent a transform that produces (or quadratic transform coefficients).

- the non-separated quadratic transform does not separate the vertical and horizontal components of the (first-order) transform coefficients, and for example, two-dimensional signals (transform coefficients) are in a specific direction (e.g., row-first). ) Direction or column-first direction), and then generating the modified transform coefficients (or quadratic transform coefficients) based on the non-separated transform matrix.

- the row priority order is to arrange the first row, the second row, ..., the Nth row for the MxN block in a row

- the column priority order is the first column, the second column for the MxN block. It is arranged in a row in the order of the column, ..., the Mth column.

- the non-separated quadratic transform may be applied to a top-left region of a block (hereinafter, referred to as a transform coefficient block) composed of (first-order) transform coefficients.

- a transform coefficient block composed of (first-order) transform coefficients.

- an 8 ⁇ 8 non-separated quadratic transform may be applied to the upper left 8 ⁇ 8 area of the transform coefficient block.

- both the width (W) and the height (H) of the transform coefficient block are 4 or more, and the width (W) or height (H) of the transform coefficient block is less than 8

- 4 ⁇ 4 non-separated secondary A transform may be applied to the upper left min(8,W) ⁇ min(8,H) area of the transform coefficient block.

- embodiments are not limited thereto, and for example, even if only the condition that the width (W) or the height (H) of the transform coefficient block is 4 or more is satisfied, the 4 ⁇ 4 non-separated quadratic transform is the upper left corner of the transform coefficient block. It can also be applied to the min(8,W) ⁇ min(8,H) area.

- the transform unit may perform the non-separated quadratic transform based on the selected transform kernels and obtain modified (quaternary) transform coefficients.

- the modified transform coefficients may be derived as quantized transform coefficients through a quantization unit as described above, and may be encoded and transmitted to a signaling and inverse quantization/inverse transform unit in an encoding device.

- the (first-order) transform coefficients which are the outputs of the first-order (separate) transform, can be derived as quantized transform coefficients through the quantization unit as described above, and are encoded. It may be transmitted to a decoding device to an inverse quantization/inverse transform unit in a signaling and encoding device.

- the inverse transform unit may perform a series of procedures in the reverse order of the procedure performed by the above-described transform unit.

- the inverse transform unit receives (inverse quantized) transform coefficients, performs a second-order (inverse) transform to derive (first-order) transform coefficients (S450), and performs a first-order (inverse) for the (first-order) transform coefficients.

- a residual block (residual samples) may be obtained by performing transformation (S460).

- the first-order transform coefficients may be referred to as modified transform coefficients from the standpoint of the inverse transform unit.

- the encoding apparatus and the decoding apparatus may generate a reconstructed block based on the residual block and the predicted block, and generate a reconstructed picture based on the residual block.

- the decoding apparatus may further include a second-order inverse transform determining unit (or an element determining whether to apply a second-order inverse transform) and a second-order inverse transform determining unit (or a second-order inverse transform determining element).

- Whether to apply the second-order inverse transform may determine whether to apply the second-order inverse transform.

- the second-order inverse transform may be NSST or RST, and the second-order inverse transform application determining unit may determine whether to apply the second-order inverse transform based on the second-order transform flag parsed from the bitstream.

- the determining unit whether to apply the second-order inverse transform may determine whether to apply the second-order inverse transform based on a transform coefficient of the residual block.

- the second-order inverse transform determiner may determine a second-order inverse transform.

- the second-order inverse transform determiner may determine a second-order inverse transform applied to the current block based on an NSST (or RST) transform set designated according to the intra prediction mode.

- a second-order transform determination method may be determined depending on a first-order transform determination method.

- Various combinations of the first-order transform and the second-order transform may be determined according to the intra prediction mode.

- the inverse quadratic transform determiner may determine a region to which the inverse quadratic transform is applied based on the size of the current block.

- a residual block (residual samples) may be obtained by receiving the (inverse quantized) transform coefficients and performing the first-order (separation) inverse transform.

- the encoding apparatus and the decoding apparatus may generate a reconstructed block based on the residual block and the predicted block, and generate a reconstructed picture based on the residual block.

- a reduced secondary transform (RST) with a reduced size of a transform matrix (kernel) can be applied from the concept of NSST in order to reduce the amount of computation and memory required for the non-separated quadratic transform.

- a transform kernel, a transform matrix, and a coefficient constituting the transform kernel matrix described in this document may be expressed in 8 bits. This may be a condition to be implemented in the decoding device and the encoding device, and it is possible to reduce the amount of memory required for storing the conversion kernel while accompanied by a performance degradation that can be reasonably accommodated compared to the existing 9-bit or 10-bit. .

- a small multiplier can be used, and it can be more suitable for a single instruction multiple data (SIMD) instruction used for optimal software implementation.

- RST may mean transformation performed on residual samples for a target block based on a transform matrix whose size is reduced according to a simplification factor.

- the amount of computation required for transformation may be reduced due to a reduction in the size of the transformation matrix. That is, the RST can be used to solve an issue of computational complexity that occurs when transforming a large block or non-separated transforming.

- RST may be referred to in various terms such as reduced transform, reduced transform, reduced transform, reduced secondary transform, reduction transform, simplified transform, simple transform, etc., and the name to which RST may be referred to is not limited to the listed examples.

- RST since RST is mainly performed in a low frequency region including a non-zero coefficient in a transform block, it may be referred to as a Low-Frequency Non-Separable Transform (LFNST).

- LNNST Low-Frequency Non-Separable Transform

- the inverse transform unit 235 of the encoding device 200 and the inverse transform unit 322 of the decoding device 300 are transformed based on the inverse RST of the transform coefficients.

- the inverse first-order transform means the inverse transform of the first-order transform applied to the residual.

- deriving a transform coefficient based on a transform may mean deriving a transform coefficient by applying a corresponding transform.

- RMTS reduced adaptive (or explicit) multiple transform selection (or set)

- a simplification factor may be determined based on the corresponding first-order transform.

- the first-order transform is DCT2

- the computational amount is relatively simple compared to other first-order transforms, so a reduced transform is not used for a small block, or a decrease in coding performance is minimized by using a relatively large R value. can do.

- different simplification factors can be used as follows.

- the transform size is not changed when the size of the block to be transformed is 8X8 or 16X16, and if it is 32X32 or more, the reduced transform size is limited to 32X32.

- the flag value indicating whether MTS is applied is 0 (that is, when DCT-2 conversion is applied for both the horizontal and vertical directions), in both directions (horizontal or vertical)

- the high-frequency component may be configured to be zero-out, that is, set to 0 (zero-out embodiment 1).

- the transform coefficient remains only in the upper left 32x32 region

- the transform coefficient remains only in the upper left 32x16 region

- the transform coefficient remains only in the upper left 8x32 region.

- the transform coefficients exist only up to a maximum length of 32 in both the width and the height.

- Such a zero-out method may be applied only to a residual signal to which intra prediction is applied, or to a residual signal to which inter prediction is applied. Alternatively, it may be applied to both a residual signal to which intra prediction is applied and a residual signal to which inter prediction is applied.

- the change in the size of the transform block which can be represented by zero out or high frequency zeroing described above, is a constant value in the (transform) block having the first horizontal size (or length) W1 and the first vertical size (or length) H1.

- This refers to a process of zeroing (ie, determining 0) the transform coefficients related to the high frequency.

- the transform coefficient values of the transform coefficients outside the low-frequency transform coefficient region configured based on the second horizontal size W2 and the second vertical size H2 among the transform coefficients in the (transform) block are all zeros.

- Can be determined (set). Outside of the low frequency transform coefficient region may be referred to as a high frequency transform coefficient region.

- the low frequency transform coefficient region may be a rectangular region positioned from the upper left of the (transform) block.

- high frequency zeroing is performed when the horizontal x coordinate value of the current TB (transform block) is set to 0 and the vertical y coordinate value is set to 0 (and the x coordinate increases from left to right and the y coordinate When is increasing from top to bottom), high-frequency zeroing may be defined as setting all values of the transform coefficients for locations where x coordinates are N or more or y coordinates are M or more to 0.

- the transform coefficients related to a frequency higher than a certain value are zeroed.

- the process is defined as “high frequency zeroing”, the region in which zeroing is performed through the high frequency zeroing is defined as a “high frequency transform coefficient region”, and the region in which zeroing is not performed is defined as a “low frequency transform coefficient region”.

- a second horizontal size (or length) W2 and a second vertical size (or length) H2 are used to indicate the size of the low frequency transform coefficient region.

- high frequency zeroing can be replaced with various terms such as high frequency zeroing, high frequency zeroing, high frequency zeroing, high frequency zero-out, and zero out

- the “high frequency conversion coefficient region” is a high frequency zeroing application region.

- a high frequency zeroing region, a high frequency region, a high frequency coefficient region, a high frequency zero out region, a zero out region, etc., and the “low frequency conversion coefficient region” refers to a region where high frequency zeroing is not applied, a low frequency region, and a low frequency coefficient region.

- the low-frequency transform coefficient region is a region remaining after high-frequency zeroing is performed, and an effective transform coefficient remains, and may be referred to as a zero out region or a zero out block.

- a flag value indicating whether MTS is applied is 1, that is, for a horizontal direction and a vertical direction

- other conversions DST-7 or DCT-8 other than DCT-2 are performed.

- the transform coefficient may be left only in the upper left area and the remaining areas may be zeroed out as follows (Zero-Out Embodiment 2).

- the transform coefficient can be left only for the length w/2 p from the left, and the remainder can be zero-out.

- the conversion factor can be left only for h/2 q length from the top and the rest can be zero-out.

- the m, n, p, and q values may be integers greater than or equal to 0, and specifically may be as follows.

- Such a zero-out method may be applied only to a residual signal to which intra prediction is applied, or to a residual signal to which inter prediction is applied. Alternatively, it may be applied to both a residual signal to which intra prediction is applied and a residual signal to which inter prediction is applied.

- the transform coefficient may be left only in the upper left area and the remaining area may be zeroed out as follows (Zero Out Embodiment 3).

- the vertical direction is reduced (h/2 p ), but the horizontal direction may be reduced (w/2 q ).

- the m, n, p, and q values may be integers greater than or equal to 0, and specifically may be as follows.

- Such a zero-out method may be applied only to a residual signal to which intra prediction is applied, or to a residual signal to which inter prediction is applied. Alternatively, it may be applied to both a residual signal to which intra prediction is applied and a residual signal to which inter prediction is applied.

- the transform coefficient region is limited when the flag value indicating whether the MTS is applied is 0 or the flag value indicating whether the MTS is applied is 1. According to one example, a combination of these is possible.

- the zero-out method may be applied only to a residual signal to which intra prediction is applied, or to a residual signal to which inter prediction is applied. Alternatively, it may be applied to both a residual signal to which intra prediction is applied and a residual signal to which inter prediction is applied. Accordingly, when the MTS flag is 1, the configuration as shown in the following table is possible (the zero-out embodiment 1 can be applied when the MTS flag is 0).

- a region bound to have a value of 0 in the TU is clearly defined. That is, the rest are zeroed out with a value of 0 except for the upper left area in which the existence of the transform coefficient is allowed. Accordingly, according to an embodiment, when entropy coding for a residual signal, a region in which a transform coefficient is certain to have a value of 0 may be configured to bypass without performing residual coding. For example, the following configuration is possible.

- subblock_flag a flag indicating whether a non-zero transform coefficient exists in one CG (it can be 4x4 or 2x2 blocks depending on the shape of the coefficient group, sub-block, TU block and luma component/chroma component) Coded (subblock_flag). As long as subblock_flag is 1, the inside of the CG is scanned and coefficient level values are coded. Accordingly, for CGs belonging to a region that is zeroed out with a value of 0, subblock_flag is not coded and may be set to a value of 0 by default.

- the position of the last coefficient in the forward scan order (last_coefficient_position_x in the X direction and last_coefficient_position_y in the Y direction) is first coded.

- the maximum values of the values that last_coefficient_position_x and last_coefficient_position_y can have are the (width-1) and (height-1) values of the TU, respectively, but when the area in which a non-zero coefficient can exist is limited by the zero-out, last_coefficient_position_x The maximum value of the values that and last_coefficient_position_y can have are also limited.

- last_coefficient_position_x and last_coefficient_position_y may be limited in consideration of zero-out and then coded. For example, if the binarization method applied to last_coefficient_position_x and last_coefficient_position_y is truncated unary, the maximum length of the truncated unary code (the code word length that last_coefficient_position_x and last_coefficient_position_y can have) is based on the adjusted maximum value. Can be reduced.

- the upper left 32x32 area is a low-frequency transform coefficient area (hereinafter, it may be referred to as 32 point Reduced MTS or RMTS32), not only the case where the MTS technique is applied, but also the 32-point area Applicable in all cases where DST-7 or 32-point DCT-8 is applied.

- 5 is a diagram for describing a 32-point zero-out according to an example of this document.

- DST-7 or DCT-8 may be applied to each side, and a transform pair applied to the horizontal and vertical directions Is not limited to the example shown in FIG. 5.

- the width and height of the entire block are represented by w and h, respectively, and the width and height of the block to which the actual separable transform is applied are (w1, h) when expressed as a pair of (width, height) or (w, h1).

- w1 may be 1/2 or 1/4 of w

- h1 may also be 1/2 or 1/4 of h.

- the block to which the transformation is applied may be located on the left or right side or above or below the entire block as shown in FIG. 5.

- the block of FIG. 5 may be a residual signal generated by inter prediction.

- a flag indicating whether to apply transformation to only one sub-block can be signaled by dividing the corresponding residual signal as shown in FIG. 5, and when the corresponding flag is 1, a flag indicating whether it is vertically divided or horizontally divided as shown in FIG. It can also be set through signaling.

- a flag indicating whether the block A to which the actual transformation is applied is located to the left or right within the entire block, or a flag indicating whether the block A is located above or below the entire block may also be signaled.

- each of the horizontal and vertical directions If the length of the side is 32, each of the RMTS32 proposed above can be applied. For example, in the case of vertical division in FIG. 5, if the height of the block A is 32, zero-out may be applied to the vertical direction. More specifically, when the A block is 16x32, the upper left 16x16 block becomes a zero-out block, so that an effective coefficient may exist only in a corresponding size area. In the case of the RMTS32, residual coding may be omitted for a region that is zero-out, or residual coding may be performed by scanning only a region that is not zero-out.

- FIG. 6 is a diagram illustrating division of a residual block according to an example of the present document.

- the partition for the residual block can be implemented as shown in FIG. 6, and the width and height of the block A to which the actual transformation is applied are w/4 and h respectively for the width (w) and height (h) of the original transform block.

- RMTS32 can be applied to any block to which the transformation is applied, if DST-7 or DCT-8 having a length of 32 for each of the horizontal and vertical directions is applicable. Whether DST-7 or DCT-8 of length 32 is applied may be determined through preset signaling or may be determined without signaling according to a predetermined coding condition.

- Spec text describing zero-out according to the embodiment of FIGS. 5 and 6 may be represented in a table below.

- the transform may be applied to a residual signal generated through inter prediction, and may be described as a Sub-Block Transform (SBT). Due to the SBT, the residual signal block is divided into two divided blocks, and a separate transform may be applied to only one of the divided blocks.

- SBT Sub-Block Transform

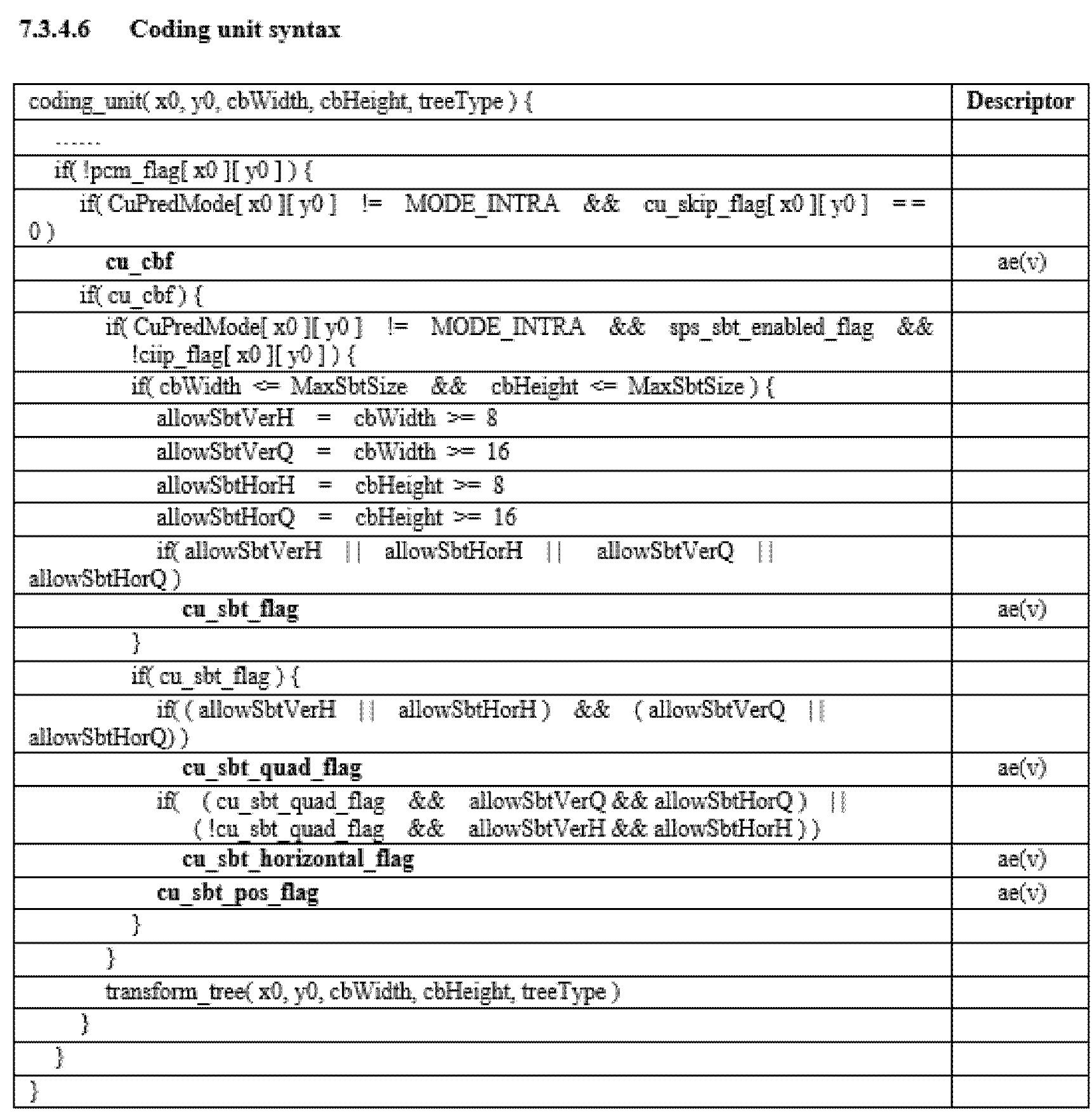

- Table 6 shows the syntax for a CU to which inter prediction is applied, and a split shape to which the SBT is applied may be determined by the four syntax elements of Table 6.

- cu_sbt_flag indicates whether SBT is applied to the corresponding CU

- the CU is horizontally partitioned, and if the cu_sbt_horizontal_flag value is 0, the CU is vertically partitioned.

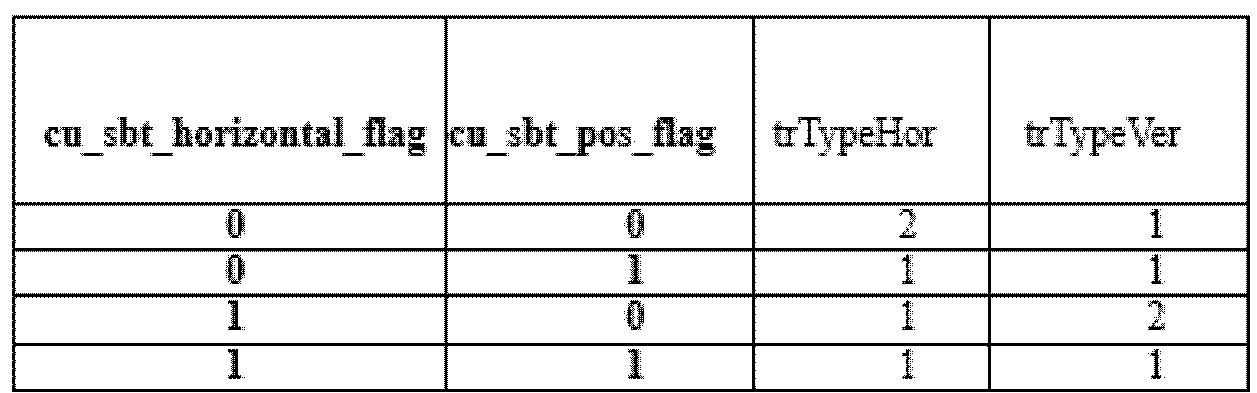

- the following table shows trTypeHor and trTypeVer according to cu_sbt_horizontal_flag and cu_sbt_pos_flag.

- the trTypeHor or trTypeVer value 0 is set to DCT2

- trTypeHor or trTypeVer value 1 is set to DST7

- trTypeHor or trTypeVer value 2 can be set to DCT8. Therefore, when the length of at least one side of the corresponding partition to which the transform is applied is 64 or more, DCT-2 is applied in both the horizontal and vertical directions, otherwise DST-7 or DCT-8 may be applied.

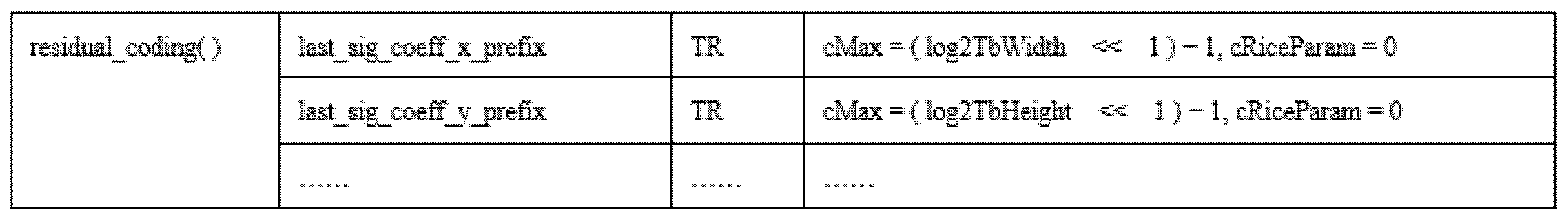

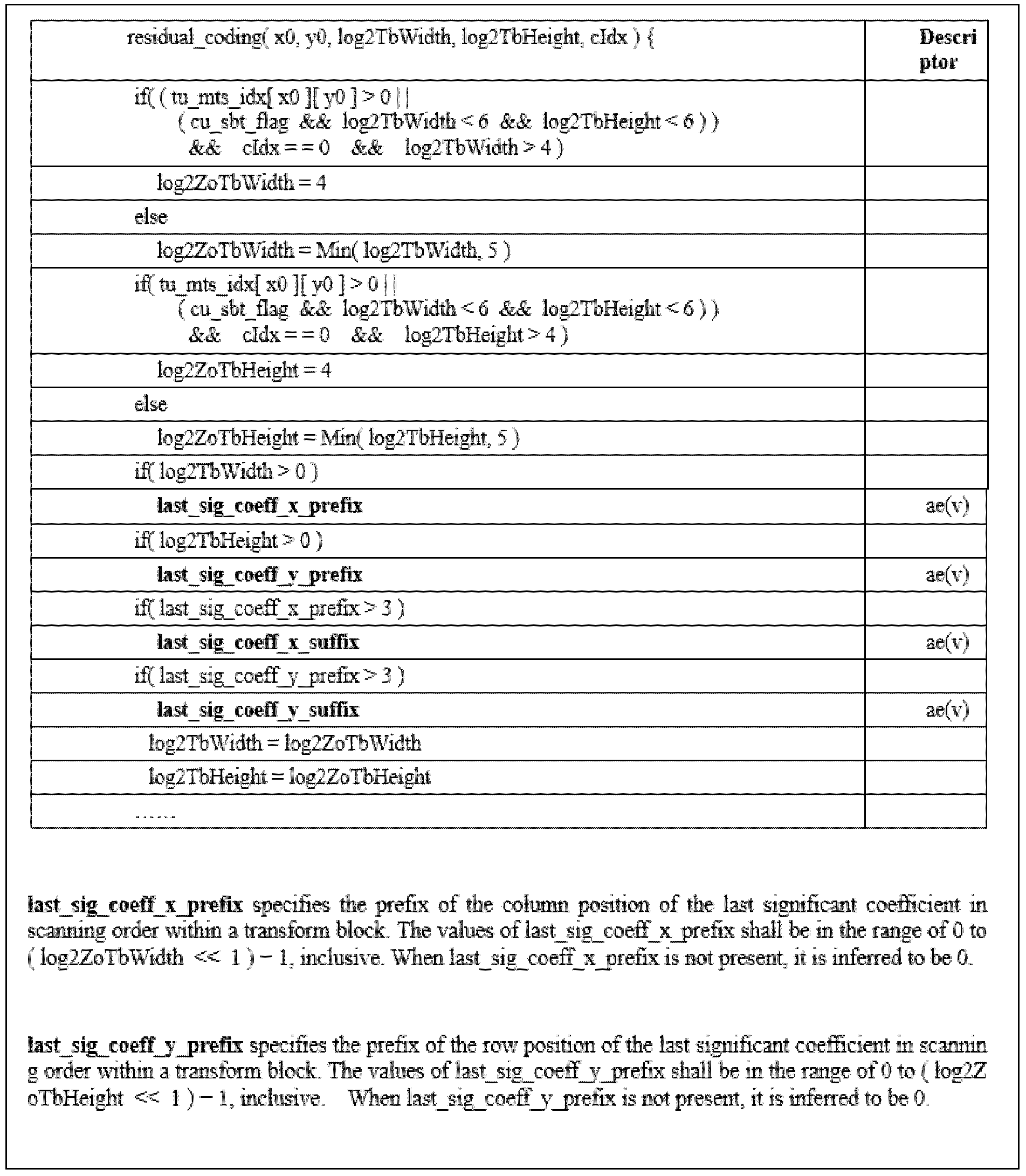

- Table 8 shows a part of the TU syntax according to an example, and Table 9 shows a part of the residual coding syntax.

- tu_mts_idx[x0][y0] represents an MTS index applied to a transform block

- trTypeHor and trTypeVer may be determined according to the MTS index as shown in Table 1.

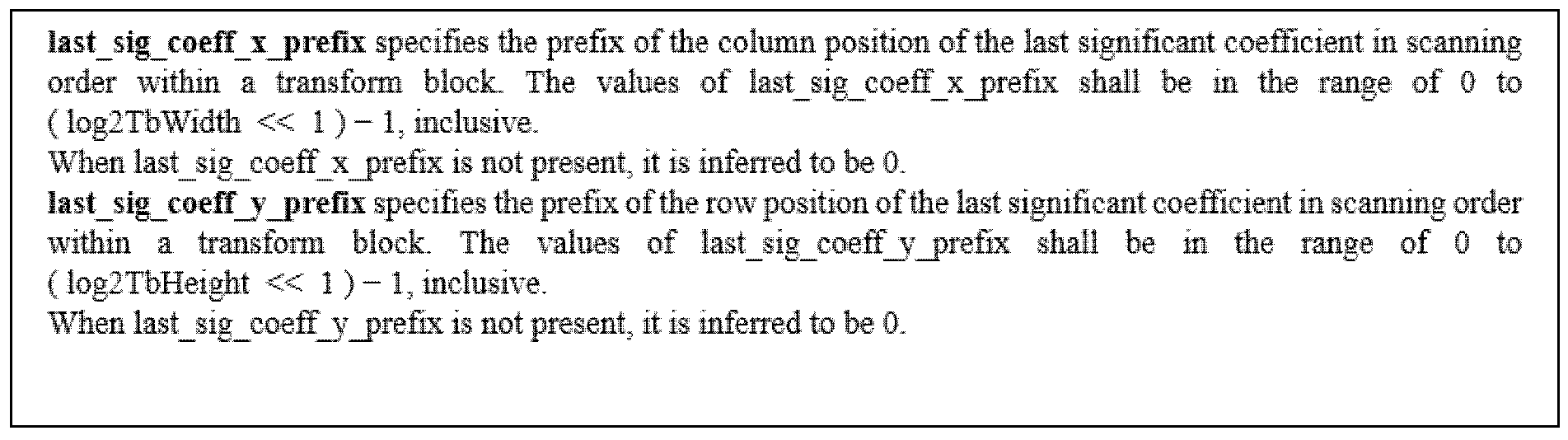

- last_sig_coeff_x_prefix, last_sig_coeff_y_prefix, last_sig_coeff_x_suffix, and last_sig_coeff_y_suffix of Table 9 indicate (x, y) position information of the last non-zero transform coefficient in the transform block.

- last_sig_coeff_x_prefix represents the prefix of the column position of the last significant coefficient in the scanning order in the transform block

- last_sig_coeff_y_prefix is the scan in the transform block

- last_sig_coeff_x_suffix is the last in the scanning order in the transform block.