RU2751759C2 - Software and hardware complex of the training system with automatic assessment of the student's emotions - Google Patents

Software and hardware complex of the training system with automatic assessment of the student's emotions Download PDFInfo

- Publication number

- RU2751759C2 RU2751759C2 RU2020100190A RU2020100190A RU2751759C2 RU 2751759 C2 RU2751759 C2 RU 2751759C2 RU 2020100190 A RU2020100190 A RU 2020100190A RU 2020100190 A RU2020100190 A RU 2020100190A RU 2751759 C2 RU2751759 C2 RU 2751759C2

- Authority

- RU

- Russia

- Prior art keywords

- student

- actions

- computer

- server

- educational

- Prior art date

Links

Images

Classifications

-

- G—PHYSICS

- G06—COMPUTING OR CALCULATING; COUNTING

- G06F—ELECTRIC DIGITAL DATA PROCESSING

- G06F17/00—Digital computing or data processing equipment or methods, specially adapted for specific functions

Landscapes

- Engineering & Computer Science (AREA)

- Physics & Mathematics (AREA)

- Theoretical Computer Science (AREA)

- Data Mining & Analysis (AREA)

- Databases & Information Systems (AREA)

- Mathematical Physics (AREA)

- Software Systems (AREA)

- General Engineering & Computer Science (AREA)

- General Physics & Mathematics (AREA)

- Management, Administration, Business Operations System, And Electronic Commerce (AREA)

- Electrically Operated Instructional Devices (AREA)

Abstract

Description

Изобретение предназначено для контроля и управления процессом индивидуального или группового обучения детей с ограниченными возможностями здоровья, школьников или студентов с контролем эмоционального состояния обучаемых и оценкой результатов обучения.The invention is intended for control and management of the process of individual or group education of children with disabilities, schoolchildren or students with control of the emotional state of the trainees and the assessment of learning outcomes.

Известны программно-аппаратные комплексы, широко применяемые в учебном процессе для обучения детей, школьников и студентов [1, 2]. Обучение с их помощью осуществляется за счет использования учебных материалов на машинных носителях информации и средств тестирования уровня освоения изучаемого предмета.Known software and hardware systems are widely used in the educational process for teaching children, schoolchildren and students [1, 2]. Learning with their help is carried out through the use of training materials on computer media and means of testing the level of mastering the subject under study.

В образовательных системах, использующих представление учебных материалов на машинных носителях, отсутствуют контроля и оценки поведения обучаемых.In educational systems that use the presentation of educational materials on machine media, there is no control and assessment of the behavior of students.

Современные средства образовательной техники направлены на поддержку педагога в выполнении рутинных функций. Одной из важнейших из них является контроль состояния учащихся с целью раннего выявления потенциальных отклонений от планового хода учебного процесса, в том числе и опасных для здоровья самих обучаемых. Наблюдаемое в последние годы нарастание дифференциации учащихся образовательных заведений, как по состоянию здоровья, так и по уровню подготовки, создает дополнительные трудности для педагога в организации и проведении учебного процесса в учебном классе. Все больше внимания приходится уделять контролю состояния учащихся. При этом можно выделить целый спектр целей проведения указанного контроля. В частности, к ним можно отнести: оценка степени активности при выполнении учебных заданий, оценка степени глубины и адекватности результатов выполнения учебных заданий, оценка текущего эмоционального состояния здоровья учащихся и т.д. Как следствие, педагог вынужден все большую часть своего внимания уделять решению, казалось бы, второстепенных задач. При этом очевидно, что именно негативные виды эмоционального состояния обучаемого в наибольшей степени оказывают влияние на снижение эффективности образовательного процесса. Выполнить одновременно оценку эмоционального состояния каждого обучаемого в учебной группе педагогу, очевидно, затруднительно.Modern means of educational technology are aimed at supporting the teacher in performing routine functions. One of the most important of them is monitoring the state of students in order to identify early potential deviations from the planned course of the educational process, including those that are dangerous to the health of the students themselves. The growing differentiation of students of educational institutions observed in recent years, both in terms of health and in terms of training, creates additional difficulties for the teacher in organizing and conducting the educational process in the classroom. More and more attention has to be paid to monitoring the condition of students. At the same time, it is possible to distinguish a whole range of purposes for carrying out this control. In particular, these include: assessment of the degree of activity during the performance of educational tasks, assessment of the degree of depth and adequacy of the results of the performance of educational tasks, assessment of the current emotional state of students' health, etc. As a result, the teacher is forced to devote more and more of his attention to the solution of seemingly secondary tasks. At the same time, it is obvious that it is precisely the negative types of the student's emotional state that have the greatest impact on reducing the effectiveness of the educational process. It is obviously difficult for a teacher to simultaneously assess the emotional state of each student in the training group.

Это обусловлено тем, что для выявления отклонений показателей эмоционального состояния, оказывающих влияние на когнитивные процессы учащегося, требуется постоянное наблюдение за состоянием каждого обучаемого учебной группы, что практически не может быть осуществлено педагогом в процессе выполнения учебного плана урока. Для решения проблемы распознавания эмоционального состояния человека все чаще используются различные технические средства, позволяющие осуществлять анализ и оценку состояния каждого обучаемого учебной группы в автоматическом режиме при полном отсутствии фактора субъективности.This is due to the fact that in order to identify deviations in the indicators of the emotional state that affect the cognitive processes of the student, constant monitoring of the state of each student of the study group is required, which practically cannot be carried out by the teacher in the process of completing the lesson curriculum. To solve the problem of recognizing the emotional state of a person, various technical means are increasingly being used, which make it possible to analyze and assess the state of each student in the training group in an automatic mode in the complete absence of the factor of subjectivity.

При этом наиболее распространенными исходными данными являются фотовидеоизображения лица обучаемого. В связи с этим наиболее востребованной является задача идентификации эмоционального состояния на основе исследования фотовидеоизображения лица оператора. В процессе исследования эмоционального состояния используются различные критерии, такие как двигательные единицы и двигательные дескрипторы в следующих группах: основные коды, коды движений головы, коды движений глаз, коды видимости и коды общего поведения. Каждый критерий оценивается не только по интенсивности, но и по симметричности. Известные подсистемы распознавания эмоций представляют собой совокупность программного и информационного обеспечения в виде программных модулей и структур данных, предназначенных для решения задачи распознавания эмоций людей на основе анализа, как видеоизображений, так и статичных фотоизображений [3, 4].In this case, the most common initial data are photo and video images of the student's face. In this regard, the most popular problem is the identification of the emotional state based on the study of the photo and video image of the operator's face. In the process of investigating the emotional state, various criteria are used, such as motor units and motor descriptors in the following groups: basic codes, head movement codes, eye movement codes, visibility codes and codes of general behavior. Each criterion is assessed not only in terms of intensity, but also in terms of symmetry. Known emotion recognition subsystems are a combination of software and information support in the form of software modules and data structures designed to solve the problem of recognizing human emotions based on the analysis of both video images and static photographs [3, 4].

В целях поддержки деятельности педагога создаются программно-аппаратных комплексы, получившие обобщенное название «образовательная робототехника». Образовательный робототехнический комплекс призван выполнять часть рутинных образовательных процедур, осуществлять контроль состояния активности, вовлеченности в учебный процесс. Исследования показывают, что дети демонстрируют хорошую реакцию на роботизированные системы, уделяют больше внимания роботу, а не человеку. Задания с повторениями выполняются лучше при участии робота. При этом познавательные способности детей одинаковы как при обучении роботом, так и человеком [5, 6].In order to support the activities of the teacher, software and hardware complexes are created, which have received the generalized name "educational robotics". The educational robotic complex is designed to perform part of the routine educational procedures, to monitor the state of activity, involvement in the educational process. Research shows that children show a good response to robotic systems, paying more attention to the robot than to the person. Repetition tasks are better performed with the participation of the robot. At the same time, the cognitive abilities of children are the same both when learning by a robot and a person [5, 6].

Известна автоматизированная система [7] для обучения и контроля знаний, содержащая пульт управления, устройство ввода ответов и реакций обучаемого, блоки ввода информации, блок предъявления информации, отличающаяся тем, что в качестве пульта управления использован процессор персонального компьютера и его программное обеспечение, в качестве устройства ввода ответов и реакций обучаемого использована клавиатура персонального компьютера, в качестве одного блока ввода информации использован видеоадаптер, а другой блок ввода информации выполнен в виде платы, подключенной к разъему системной шины персонального компьютера и содержащей дешифратор управляющих сигналов, буфер данных, устройство управления и синхронизации, счетчик адреса, блок памяти, цифроаналоговый преобразователь и аналоговый мультиплексор, причем входы дешифратора управляющих сигналов и буфера данных подключены к системной шине, выходы дешифратора управляющих сигналов подключены к устройству управления и синхронизации, выходы которого подключены к управляющим входам буфера данных, счетчика адреса, блока памяти и аналогового мультиплексора; выход буфера данных подключен к блоку памяти, адресный вход которого подключен к выходу счетчика адреса, а выход соединен с входом цифроаналогового преобразователя, один вход аналогового мультиплексора соединен с выходом цифроаналогового преобразователя, а второй вход соединен с аналоговым выходом видеоадаптера, а второй вход соединен с аналоговым выходом видеоадаптера, а выход аналогового мультиплексора подключен к аналоговому входу видеомонитора, синхровходы которого подключены к выходам устройства управления и синхронизации, синхровходы устройства управления и синхронизации подключены к синхровыходам видеоадаптераKnown automated system [7] for teaching and control of knowledge, containing a control panel, a device for inputting answers and reactions of a student, blocks for inputting information, a block for presenting information, characterized in that a personal computer processor and its software are used as a control panel, as the device for inputting answers and reactions of the student used the keyboard of a personal computer, a video adapter was used as one block for inputting information, and the other block for inputting information is made in the form of a board connected to the system bus connector of a personal computer and containing a decoder of control signals, a data buffer, a control and synchronization device , address counter, memory block, digital-to-analog converter and analog multiplexer, and the inputs of the control signal decoder and the data buffer are connected to the system bus, the outputs of the control signal decoder are connected to the control and synchronization device, the outputs which are connected to the control inputs of the data buffer, address counter, memory block and analog multiplexer; the output of the data buffer is connected to the memory block, the address input of which is connected to the output of the address counter, and the output is connected to the input of the digital-to-analog converter, one input of the analog multiplexer is connected to the output of the digital-to-analog converter, and the second input is connected to the analog output of the video adapter, and the second input is connected to the analog the output of the video adapter, and the output of the analog multiplexer is connected to the analog input of the video monitor, the sync inputs of which are connected to the outputs of the control and synchronization device, the sync inputs of the control and synchronization devices are connected to the sync outputs of the video adapter

К недостаткам такой автоматизированной системы для обучения и контроля знаний в первую очередь следует отнести отсутствие использования результатов анализа данных о состоянии обучаемого для адаптации учебного процесса к уровню подготовленности и текущего состояния обучаемого, что не позволяет повысить эффективность образовательного процесса в целом.The disadvantages of such an automated system for teaching and control of knowledge, first of all, include the lack of using the results of analyzing data on the state of the student to adapt the educational process to the level of preparedness and the current state of the student, which does not allow increasing the efficiency of the educational process as a whole.

Известна более совершенная конструкция программно-аппаратного комплекса обучающей системы [8], содержащая сервер, терминал обучаемого, соединенный с указанным сервером через вычислительную сеть, при этом сервер включает средство хранения учебного материала; средство передачи учебного материала на терминал обучаемого с использованием вычислительной сети, терминал обучаемого включает средство получения указанного учебного материала от сервера, с использованием сети, средство демонстрации полученного учебного материала обучаемому; средство распознавания действий обучаемого во время демонстрации учебного материала; средство передачи указанных распознанных действий обучаемого на сервер; сервер дополнительно содержит средство получения распознанных действий обучаемого от терминала обучаемого через вычислительную сеть; средство оценки отношения обучаемого к обучению на основе вышеуказанных действий; средство распознавания содержит средства получения изображения обучаемого, средства получения звуков голоса обучаемого и средства контроля вводимой обучаемым информации на устройство ввода-вывода, соединенных с терминалом обучаемого.Known more advanced design of the hardware and software complex of the training system [8], containing a server, a student's terminal, connected to the specified server through a computer network, while the server includes a means of storing educational material; means for transmitting training material to the student's terminal using a computer network, the student's terminal includes means for receiving said training material from the server using the network; means for demonstrating the received training material to the student; means for recognizing the actions of the student during the demonstration of educational material; means for transmitting the said recognized actions of the student to the server; the server additionally contains means for receiving recognized actions of the student from the terminal of the student through the computer network; means for assessing the student's attitude to learning based on the above actions; the recognition means contains means for obtaining an image of the student, means for receiving the sounds of the student's voice and means for monitoring the information input by the student to the input-output device, connected to the student's terminal.

Недостатком такой конструкции является невозможность в процессе мониторинга учебного процесса обучаемого при автоматической оценке степени понимания им учебного материала учитывать эмоциональное состояние обучаемого, управлять вниманием обучаемого, стимулировать обучаемого, что снижает эффективность обучения. А при работе с детьми с ограниченными возможностями здоровья подобная система не может использоваться и для решения такой важной задачи, как выявление эмоциональных проблем у подростков и их корректировки.The disadvantage of this design is the impossibility of taking into account the emotional state of the student, controlling the student's attention, and stimulating the student in the process of monitoring the student's educational process when automatically assessing the degree of understanding of the educational material, which reduces the effectiveness of training. And when working with children with disabilities, such a system cannot be used to solve such an important task as identifying emotional problems in adolescents and correcting them.

Технической проблемой изобретения является необходимость повышения эффективности образовательного процесса на основе оценки результатов выполнения обучаемым учебного задания, оценки его эмоционального состояния, а затем на их основе автоматического определения адекватного уровня представления учебного задания и действий программно-аппаратного комплекса поддержки действий педагога для управления вниманием обучаемого, стимулирования и оказания помощи в правильном выполнении учебных заданий.The technical problem of the invention is the need to improve the efficiency of the educational process based on assessing the results of the student's performance of the educational task, assessing his emotional state, and then, on their basis, automatically determining the adequate level of presentation of the educational task and the actions of the software and hardware complex to support the teacher's actions to control the student's attention, stimulate and assisting in the correct execution of educational assignments.

Указанная проблема решается тем, что на основе оценки текущего состояния обучаемого, автоматически формируемой средством анализа состояния обучаемого, использующим показатели эмоционального состояния обучаемого, определяемые средством исследования видеосигнала с фронтальным изображением лица обучаемого, получаемого в режиме реального времени с помощью видеокамеры, показатели соответствия результатов выполнения обучаемым требований учебного задания, формируемые средством анализа действий обучаемого, автоматически определяется процедура действий, включающая действия по управлению вниманием обучаемого, действия по стимулированию обучаемого к выполнению учебных заданий, действия по оказанию помощи обучаемому в правильном выполнении учебных заданий, действия по предъявлению обучаемому нового учебного задания, действия по поощрению обучаемого. Управление вниманием обучаемого, стимулирование и оказание помощи в правильном выполнении учебных заданий производится роботом антропоморфного типа, выступающим в качестве помощника педагога.This problem is solved by the fact that, based on the assessment of the current state of the student, automatically generated by the means of analyzing the state of the student, using indicators of the emotional state of the student, determined by the means of studying the video signal with the frontal image of the student's face, obtained in real time using a video camera, the indicators of the correspondence of the results of the student's performance the requirements of the educational task, formed by the tool for analyzing the student's actions, an action procedure is automatically determined, including actions to control the student's attention, actions to stimulate the student to complete educational tasks, actions to assist the student in the correct execution of educational tasks, actions to present the student with a new educational task, actions to encourage the learner. Controlling the student's attention, stimulating and assisting in the correct execution of educational tasks is performed by an anthropomorphic robot acting as a teacher's assistant.

Управление вниманием обучаемого может осуществляться посредством приближения робота к столу обучаемого, жестов, выполняемых манипуляторами робота, звуковых сигналов (речи), воспроизводимых акустическими системами робота и/или учебного компьютера обучаемого, демонстрацией видеоизображений на мониторе робота и/или учебного компьютера обучаемого.The control of the trainee's attention can be carried out by bringing the robot closer to the trainee's table, gestures performed by the robot's manipulators, sound signals (speech) reproduced by the acoustic systems of the robot and / or the trainee's training computer, demonstrating video images on the robot's monitor and / or the trainee's training computer.

Стимулирование обучаемого к выполнению учебных заданий может включать напоминание о возможных поощрениях для успешно выполняющих учебные задания, например, демонстрацию любимого мультфильма.Encouraging the learner to complete learning assignments may include reminders of possible rewards for successful learners, such as showing a favorite cartoon.

Оказание помощи обучаемому в выполнении учебных заданий может заключаться в неоднократной, при необходимости, демонстрации роботом правильной последовательности действий при выполнении учебного задания.Assisting the trainee in completing educational tasks may consist in repeated, if necessary, demonstration by the robot of the correct sequence of actions when performing the educational task.

Технический результат изобретения заключается в создании технической возможности повышения эффективности образовательного процесса за счет автоматического определения в режиме реального времени оценки эмоционального состояния обучаемого, оценки результатов выполнения обучаемым учебного задания и определения на их основе адекватного уровня представления учебного задания, автоматического определения процедуры (последовательности действий) автономного антропоморфного робота помощника педагога по управлению вниманием обучаемого, стимулирования и оказания помощи в правильном выполнении учебных заданий.The technical result of the invention is to create a technical possibility of increasing the efficiency of the educational process by automatically determining in real time the assessment of the emotional state of the student, assessing the results of the student's performance of the educational task and determining on their basis an adequate level of presentation of the educational task, automatically determining the procedure (sequence of actions) of the autonomous anthropomorphic robot of the teacher's assistant for managing the student's attention, stimulating and assisting in the correct implementation of educational tasks.

Антропоморфный робот может быть полезен детям с ограниченными возможностями по здоровью, дополняя педагога в выполнении типовых действий в рамках учебного процесса. Он может быть полезен как в работе педагога с детьми с задержкой психического развития, так и с детьми-аутистами, помогая прививать навыки социального общения. Здесь могут быть эффективны методы анализа видеосигналов от видеокамеры фронтального изображения лица обучаемого, позволяющие уточнить эмоциональное состояние ребенка, концентрацию его внимания, а, следовательно, определить стратегию действий робота как активного компонента программно-аппаратного комплекса поддержки действий педагога.An anthropomorphic robot can be useful for children with disabilities, complementing the teacher in performing typical actions within the educational process. It can be useful both in the work of a teacher with children with mental retardation and with autistic children, helping to instill social communication skills. Here, methods of analyzing video signals from a video camera of the frontal image of the student's face can be effective, which make it possible to clarify the emotional state of the child, the concentration of his attention, and, therefore, to determine the strategy of the robot's actions as an active component of the software and hardware complex for supporting the teacher's actions.

Конструктивная схема программно-аппаратного комплекса для оценки эмоций обучаемого в поддержку действий педагога показана на чертеже - фиг. Позициями на чертеже обозначены: 1 - видеокамера на рабочем столе (компьютере) обучаемого; 2 -микрофон на рабочем столе (компьютере) обучаемого; 3 - компьютер обучаемого; 4 -дисплей компьютера обучаемого; 5 - громкоговоритель на компьютере обучаемого; 6 -клавиатура компьютера обучаемого; 7 - устройство ввода информации "мышь" компьютера обучаемого; 8 - сервер; 9 - устройство Wi-Fi на сервере; 10 - маршрутизатор; 11 - робот; 12 - видеокамера на роботе; 13 - устройство Wi-Fi на компьютере робота; 14 - микрофон на роботе; 15 - громкоговоритель на роботе; 16 - дисплей на роботе; 17 -компьютер педагога.The structural diagram of the hardware and software complex for assessing the emotions of the student in support of the teacher's actions is shown in the drawing - Fig. Positions in the drawing indicate: 1 - video camera on the student's desktop (computer); 2 - a microphone on the student's desktop (computer); 3 - student's computer; 4 -display of the student's computer; 5 - loudspeaker on the student's computer; 6 - keyboard of the student's computer; 7 - device for inputting information "mouse" of the student's computer; 8 - server; 9 - Wi-Fi device on the server; 10 - router; 11 - robot; 12 - video camera on the robot; 13 - Wi-Fi device on the robot's computer; 14 - microphone on the robot; 15 - loudspeaker on the robot; 16 - display on the robot; 17 - teacher's computer.

Программно-аппаратный комплекс для оценки эмоций обучаемого в поддержку действий педагога содержит компьютер обучаемого 3, соединенный с сервером 8 через маршрутизатор 10 посредством вычислительной сети и включающий средство получения учебного материала от сервера 8 через маршрутизатор 10 посредством вычислительной сети, средство демонстрации полученного от сервера 8 учебного материала на дисплее 4 с возможным звуковым сопровождением с помощью громкоговорителя компьютера обучаемого 3, средство распознавания действий обучаемого в течение учебного занятия на основе анализа ответов (реакции) обучаемого, вводимых в виде символьной (текстовой) информации через клавиатуру 6, задаваемых обучаемым в виде указательной информации с использованием устройства 7 типа "мышь", подаваемых обучаемым в виде звуковых сигналов (речи) с использованием микрофона 2, средство передачи распознанных действий обучаемого на сервер 8, средство распознавания изображения лица обучаемого на основе анализа видеоизображения, получаемого с видеокамеры 1, средство оценки эмоционального состояния обучаемого по данным видеосигнала видеокамеры 1, средство передачи оценки эмоционального состояния обучаемого на сервер 8; сервер 8, содержащий средство передачи учебного материала на дисплей 4 компьютера 3 обучаемого через маршрутизатор 10 посредством вычислительной сети, средство получения данных о распознанных действиях обучаемого от компьютера 3 обучаемого через маршрутизатор 10 посредством вычислительной сети, средство получения и обработки данных об эмоциональном состоянии обучаемого, средство выбора (планирования) программы действий программно-аппаратного комплекса для оценки эмоций обучаемого в поддержку действий педагога, средство управления исполнением программы действий программно-аппаратного комплекса поддержки действий педагога; автономный робот 11 антропоморфного типа, соединенный через устройство 13 беспроводной связи Wi-Fi с сервером 8 и включающий средство ориентации с использованием стереоскопической видеокамеры и других устройств (лазерный дальномер, гироскоп, акселерометр, компас и т.д.), средство отображения текстовой и графической информации на дисплей 16, средство воспроизведения звуковой (голосовой) информации с использованием громкоговорителя 15, средство получения с использованием микрофона 14 голосовых команд педагога и ответов обучаемого на вопросы педагога и/или робота, средство управления исполнением действий в соответствии с заданной командой/процедурой; компьютер 17 педагога, соединенный с сервером 8 через маршрутизатор 10 посредством вычислительной сети.The software and hardware complex for assessing the emotions of the student in support of the teacher's actions contains the student's

Программно-аппаратный комплекс работает следующим образом.The hardware and software complex works as follows.

Педагог посылает через компьютер 17, маршрутизатор 10 на сервер 8 команду передачи обучаемому учебного задания, которое средством передачи учебного материала от сервера через маршрутизатор 10 посредством вычислительной сети передает учебные материалы средству получения учебного материала компьютера 3 обучаемого, которое передает полученную информацию средству демонстрации учебного материала, которое отображает учебные материалы на дисплее 4 с возможным звуковым сопровождением с помощью громкоговорителя 5 компьютера 3 обучаемого.The teacher sends through the

В процессе выполнения задания обучаемый дает ответы на учебные задания (вводит результаты выполнения задания) в символьном виде с помощью клавиатуры 6, в виде указательной информации (выбора объектов на экране дисплея) с помощью устройства типа «мышь» 7, в виде звуковых сигналов (речи), воспринимаемых с помощью микрофона 2.In the process of completing the task, the student gives answers to educational tasks (enters the results of the task) in symbolic form using the

Средство распознавания действий обучаемого непрерывно в течение учебного занятия на основе анализа полученных ответов (реакции) обучаемого формирует оценку соответствия действий обучаемого требованиям учебного задания.The means of recognizing the student's actions continuously during the training session, based on the analysis of the received answers (reactions) of the student, forms an assessment of the compliance of the student's actions with the requirements of the training task.

Средство передачи распознанных действий обучаемого передает полученные данные через маршрутизатор 10 посредством вычислительной сети средству получения данных о распознанных действиях обучаемого на сервере 8.The means for transmitting the recognized actions of the student transmits the received data through the

Средство распознавания изображения лица обучаемого непрерывно на основе анализа видеоизображения, получаемого с видеокамеры 6, осуществляет выделение фрагмента изображения, соответствующего лицу обучаемого и передает его средству оценки эмоционального состояния.The means for recognizing the image of the student's face continuously, based on the analysis of the video image obtained from the

Средство оценки эмоционального состояния обучаемого по полученным данным изображения лица обучаемого непрерывно формирует текущее значение оценки и передает его средству передачи оценки психического и эмоционального состояния обучаемого.The means for assessing the emotional state of the student on the basis of the obtained data of the image of the student's face continuously forms the current value of the assessment and transfers it to the means of transferring the assessment of the mental and emotional state of the student.

Средство передачи оценки эмоционального состояния обучаемого передает полученное значение через маршрутизатор 10 посредством вычислительной сети средству получения и обработки данных о эмоциональном состоянии обучаемого на сервере 8.The means for transmitting the assessment of the emotional state of the student transmits the obtained value through the

Средство оценки соответствия действий обучаемого требованиям учебного задания на основе анализа полученных данных о распознанных действиях и эмоциональном состоянии обучаемого формирует оценку соответствия действий обучаемого требованиям учебного задания, передаваемую средству выбора (планирования) программы действий программно-аппаратного комплекса в поддержку действий педагога, которая средством управления исполнением построенной программы действий через устройства 9 и 13 беспроводной связи Wi-Fi передается средству управления исполнением действий робота в соответствии с заданной командой/процедурой.The tool for assessing the compliance of the student's actions with the requirements of the educational task based on the analysis of the data obtained about the recognized actions and the emotional state of the student forms an assessment of the compliance of the student's actions with the requirements of the educational task, which is transmitted to the choice (planning) tool of the program of actions of the software and hardware complex in support of the teacher's actions, which is a means of execution control of the constructed program of actions through the

Средство управления исполнением действий с использованием средства ориентации управляет выполнением действий (движений) робота в соответствии с заданной командой/процедурой, а также с помощью средства отображения текстовой и графической информации и с помощью средства воспроизведения звуковой информации управляет передачей обучаемому стимулирующей, поощряющей, помогающей в выполнении учебного задания и поясняющей действия робота информации.The control tool for the execution of actions using the orientation tool controls the execution of actions (movements) of the robot in accordance with a given command / procedure, as well as with the help of the means for displaying text and graphic information and with the help of the means for reproducing sound information, controls the transmission of stimulating, rewarding, and helping to the trainee training assignment and information explaining the actions of the robot.

В результате совокупных действий педагога, программно-аппаратного комплекса и обучаемого изменяются результаты выполнения обучаемым учебного задания и его эмоциональное состояние. В случае успешного решения обучаемым учебного задания педагог дает команду серверу на переход к следующему заданию. В противном случае выбирается иная, из множества предварительно подготовленных форм представления невыполненного учебного задания, более адекватная текущему состоянию (уровню подготовки) обучаемого.As a result of the combined actions of the teacher, the hardware-software complex and the student, the results of the student's fulfillment of the educational task and his emotional state change. In case of successful solution of the educational task by the trainee, the teacher gives the command to the server to proceed to the next task. Otherwise, a different one is selected, from a set of previously prepared forms of presentation of an unfulfilled educational task, more adequate to the current state (level of training) of the student.

Осуществление изобретенияImplementation of the invention

Далее описывается вариант осуществления изобретения в соответствии с реализацией, осуществленной в Саратовском государственном техническом университете имени Гагарина Ю.А. (далее СГТУ имени Гагарина Ю.А.).The following describes an embodiment of the invention in accordance with the implementation carried out at the Saratov State Technical University named after Gagarin Yu.A. (hereinafter SSTU named after Gagarin Yu.A.).

Обозначения компонентов, используемых в описании, соответствуют обозначениям, принятым на Фиг. 1.The designations of the components used in the description correspond to the designations adopted in FIG. one.

В СГТУ имени Гагарина Ю.А. в качестве сервера 5 используется НРС 6050, в качестве компьютеров обучаемого 3 и педагога 13 использованы персональные компьютеры на базе AMD А12-9800 в стандартной комплектации (клавиатура, мышь), дополнительно оснащенные HD-видеокамерой и акустическими стерео громкоговорителями.In SSTU named after Gagarin Yu.A. HPC 6050 is used as

Сервер 5, компьютеры обучаемого 3 и педагога 13 функционируют под управлением операционной системы Linux Ubuntu 18.04 и объединены в Ethernet-сеть с использованием коммутатора D-Link DGs-1210-52MP.

В качестве робота 12 антропоморфного типа в СГТУ использован робот AR600 производства НПО «Андроидная техника» [http://www.npo-at.com].As a

Антропоморфный робот AR600 снабжен манипуляторами с пятипалыми кистевыми схватами, головным блоком с видеокамерой, центральным блоком (туловищем) с установленными в нем лазерным дальномером, микрофоном, акустической системой, педипуляторным блоком, вычислительной системой под управлением операционной системы Linux Ubuntu, необходимым программным обеспечением для решения различных задач (навигации, ориентации, планирования траектории движения, обработки видеоизображений, обработки звуковых сигналов/речи, управление манипуляторами для работы с объектами, управление педипуляторами (ногами) в процессе двуногой ходьбы, специализированного командного языка для внешнего управления с использованием беспроводной связи Wi-Fi, голосового взаимодействия с людьми, включая выполнение голосовых команд).The anthropomorphic robot AR600 is equipped with manipulators with five-fingered wrist grips, a head unit with a video camera, a central unit (body) with a laser rangefinder installed in it, a microphone, a tasks (navigation, orientation, trajectory planning, video image processing, audio / speech processing, manipulator control for working with objects, pedipulator (legs) control during bipedal walking, specialized command language for external control using Wi-Fi wireless communication, voice interaction with people, including performing voice commands).

Для обмена информацией (передача команд управления и данных) робота с сервером 5 используется беспроводная сеть Wi-Fi.To exchange information (transfer control commands and data) between the robot and the

Формирование оценки соответствия действий обучаемого требованиям учебного задания в зависимости от требуемых учебным заданием вида и формы действий (ответов) обучаемого включает следующие варианты:The formation of an assessment of the compliance of the student's actions with the requirements of the educational task, depending on the type and form of the student's actions (answers) required by the educational task, includes the following options:

- для заданий множественного выбора, предполагающих указание номера правильного ответа осуществляется сравнение указанного обучаемым номера ответа (целое число от 1 до 5) с номером (целое число от 1 до 5) правильного ответа, предусмотренным учебным заданием;- for tasks of multiple choice, involving the indication of the number of the correct answer, the comparison of the number of the answer indicated by the trainee (an integer from 1 to 5) with the number (an integer from 1 to 5) of the correct answer provided for by the educational task is carried out;

- для заданий множественного выбора, предполагающих указание правильного ответа из списка представленного на экране монитора компьютера обучаемого осуществляется сравнение варианта ответа, указанного обучаемым с помощью манипулятора «мышь» компьютера обучаемого с правильным вариантом ответа, предусмотренным учебным заданием;- for tasks of multiple choice, involving the indication of the correct answer from the list presented on the monitor of the student's computer, a comparison of the answer option indicated by the student using the "mouse" manipulator of the student's computer with the correct answer option provided by the educational task is carried out;

- для заданий, требующих выполнения обучаемым вычислительных операций (результатом вычисления является число) осуществляется сравнение варианта ответа введенного обучаемым с клавиатуры компьютера обучаемого с правильным вариантом ответа, предусмотренным учебным заданием;- for tasks requiring the trainee to perform computational operations (the result of the calculation is a number), a comparison of the answer option entered by the trainee from the student's computer keyboard with the correct answer option provided by the training task is carried out;

- и т.д. в зависимости от вида учебного занятия и в соответствии с предварительно подготовленными методистом и педагогом сценариями проведения учебных занятий.- etc. depending on the type of training session and in accordance with the scripts for conducting training sessions previously prepared by the methodologist and teacher.

Управление вниманием обучаемого осуществляется посредством выполнения одного или некоторой последовательности из предопределенных (предварительно запрограммированых) действий: приближения робота к столу обучаемого, жестов, выполняемых манипуляторами робота, звуковых сигналов (речи), воспроизводимых акустическими системами робота и/или учебного компьютера обучаемого, демонстрацией видеоизображений на мониторе робота и/или учебного компьютера обучаемого.The trainee's attention is controlled by performing one or some sequence of predetermined (preprogrammed) actions: approaching the robot to the trainee's table, gestures performed by the robot's manipulators, sound signals (speech) reproduced by the acoustic systems of the robot and / or the trainee's training computer, demonstrating video images on the monitor of the robot and / or the student's training computer.

Стимулирование обучаемого к выполнению учебных заданий осуществляется посредством выполнения одного или некоторой последовательности из предопределенных (предварительно запрограммированых) действий: напоминание в форме речи, воспроизводимых акустическими системами робота и/или учебного компьютера обучаемого, демонстрацией видеоизображений на мониторе робота и/или учебного компьютера обучаемого о возможных поощрениях для успешно выполняющих учебные задания, например, демонстрацию любимого мультфильма.The student is stimulated to perform educational tasks by performing one or some sequence of predetermined (preprogrammed) actions: a reminder in the form of speech reproduced by the acoustic systems of the robot and / or the student's training computer, demonstrating video images on the monitor of the robot and / or the training computer of the student about possible rewards for those who successfully complete educational tasks, for example, a demonstration of their favorite cartoon.

Оказание помощи обучаемому в выполнении учебных заданий осуществляется посредством выполнения одного или некоторой последовательности из предопределенных (предварительно запрограммированых) действий, например, в неоднократной, при необходимости, демонстрации роботом правильной последовательности действий при выполнении учебного задания, осуществляемой в форме речи (например, правильного произнесения изучаемых фраз), воспроизводимой акустическими системами робота и/или учебного компьютера обучаемого, демонстрации видеоизображений на мониторе робота и/или учебного компьютера обучаемого, выполнении манипуляторами робота необходимых манипуляций, например, с учебными макетами в соответствии с требованиями учебного задания.Assisting the trainee in performing educational tasks is carried out by performing one or some sequence of predefined (preprogrammed) actions, for example, in repeated, if necessary, the robot demonstrates the correct sequence of actions when performing an educational task, carried out in the form of speech (for example, the correct pronunciation of the studied phrases) reproduced by the acoustic systems of the robot and / or the training computer of the student, demonstration of video images on the monitor of the robot and / or the training computer of the student, performing the necessary manipulations with the robot manipulators, for example, with training models in accordance with the requirements of the training task.

Для получения информации о текущем эмоциональном состоянии обучаемого используется видеоизображение лица обучаемого, получаемое с помощью HD видеокамеры, установленной на рабочем столе обучаемого. Видеоизображение проходит обработку, например, специализированным программным обеспечением [«Программа распознавания эмоций «EmotionDetector»», Свидетельство Роспатента о регистрации программы для ЭВМ №2019666123 от 05.12.2019 г., заявка №2019665022 от 25.11.2019, Правообладатель: Федеральное государственное бюджетное образовательное учреждение высшего образования «Саратовский государственный технический университет имени Гагарина Ю.А.» (СГТУ имени Гагарина Ю.А.) (RU)]. Результаты обработки передаются с компьютера обучаемого 3 на сервер 5 с использованием сети Ethernet для дальнейшей обработки.To obtain information about the current emotional state of the student, a video image of the student's face is used, obtained using an HD video camera installed on the student's desktop. The video image is processed, for example, with specialized software ["EmotionDetector" Emotion Recognition Program ", Certificate of Rospatent of registration of a computer program No. 2019666123 dated 05.12.2019, application No. 2019665022 dated 25.11.2019, Copyright holder: Federal State Budgetary Educational Institution higher education "Saratov State Technical University named after Gagarin Yu.A." (SSTU named after Y. Gagarin) (RU)]. The processing results are transmitted from the computer of

Далее приводится справочная информация о применяемом в указанной программе методе распознавания эмоций, опубликованная в статье [9].Below is the background information on the emotion recognition method used in this program, published in the article [9].

Методы компьютерного распознавания эмоций людей по видеоизображению пока недостаточно хорошо разработаны. В силу многокритериальности и сложности задачи распознавания эмоций часто в качестве математического аппарата находят применение сверточные нейронные сети [3], [4], [10], [11].Methods for computer recognition of human emotions from video images are not yet well developed. Due to the multicriteria and complexity of the emotion recognition problem, convolutional neural networks are often used as a mathematical apparatus [3], [4], [10], [11].

В 1978 году Пол Экман [12] предложил систему «кодирования лицевых движений» (сокращенно FACS, «Facial Action Coding System»), на которой основываются многие разработки в области автоматического распознавания эмоций. Были разработаны универсальные критерии для описания состояния лица человека, выделено около 90 базовых признаков, а также введен набор из семи базовых эмоций: радость, удивление, печаль, гнев, отвращение, страх, презрение [13]. Система кодирования изложена на более чем 500 страницах и представляет собой подробнейшее описание базовых единиц, признаков и дескрипторов. Для определения эмоций используются такие критерии, как двигательные единицы ДЕ и двигательные дескрипторы ДД в следующих группах: основные коды, коды движений головы, коды движений глаз, коды видимости и коды общего поведения. Каждый критерий оценивается не только по интенсивности, но и по симметричности. Сложность системы кодов Экмана еще раз указывает на то, что задача распознавания эмоций многокритериальная и весьма трудно формализуемая.In 1978, Paul Ekman [12] proposed the Facial Action Coding System (FACS for short), on which many developments in the field of automatic emotion recognition are based. Universal criteria were developed to describe the state of a person's face, about 90 basic features were identified, and a set of seven basic emotions was introduced: joy, surprise, sadness, anger, disgust, fear, contempt [13]. The coding system is presented on more than 500 pages and is a detailed description of the basic units, characteristics and descriptors. To define emotions, criteria such as motor units MU and motor descriptors DD are used in the following groups: basic codes, codes of head movements, codes of eye movements, codes of visibility and codes of general behavior. Each criterion is assessed not only in terms of intensity, but also in terms of symmetry. The complexity of the Ekman code system once again indicates that the problem of emotion recognition is multicriteria and very difficult to formalize.

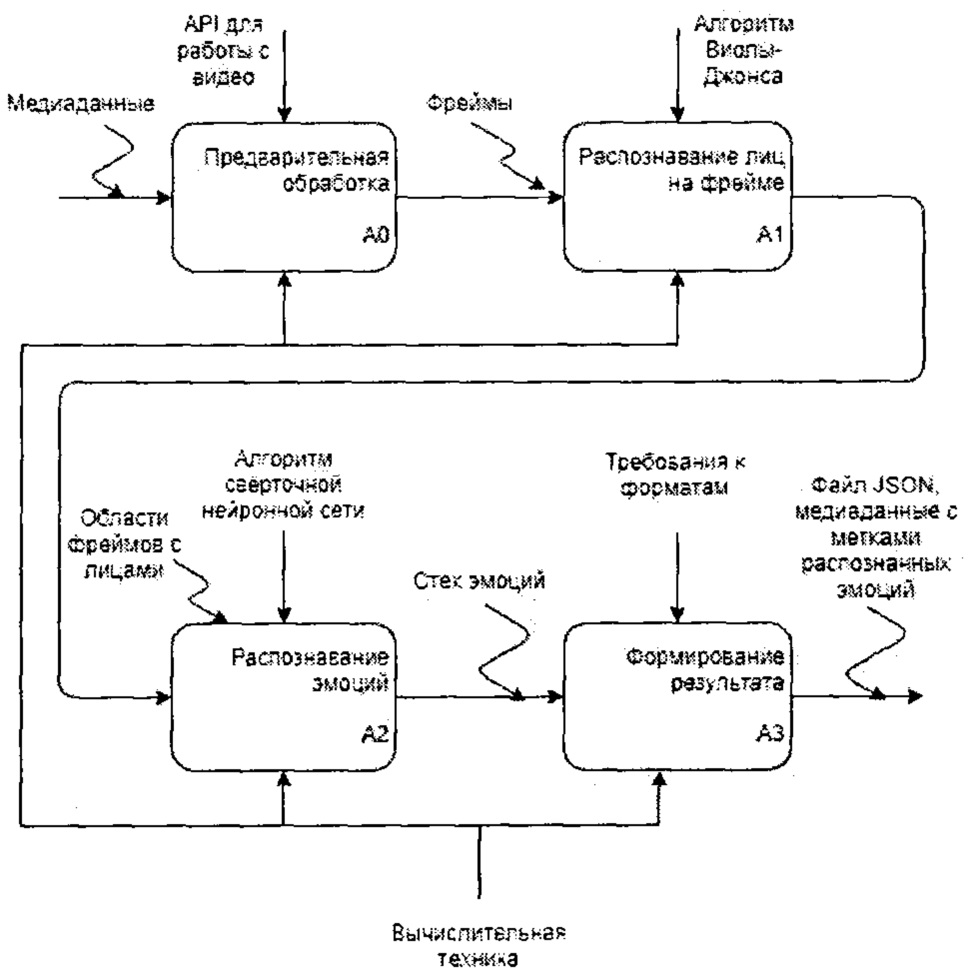

Разрабатываемая в Саратовском государственном техническом университете имени Гагарина Ю.А. подсистема распознавания эмоций программно-аппаратного комплекса для оценки эмоций обучаемого [14] представляет собой совокупность программного и информационного обеспечения в виде программных модулей и структур данных, предназначенных для решения задачи распознавания эмоций людей на основе анализа как видеоизображений, так статичных фотоизображений. Функциональная модель подсистемы распознавания эмоций представлена на рисунке 1. Под медиаданными здесь понимаются видеофрагменты, которые либо получены с видеокамеры, либо прочитаны из файла, а под фреймами - отдельные статичные изображения - кадры.Developed at the Saratov State Technical University named after Gagarin Yu.A. the emotion recognition subsystem of the hardware-software complex for evaluating the emotions of the student [14] is a set of software and information support in the form of software modules and data structures designed to solve the problem of recognizing human emotions based on the analysis of both video images and static photographs. The functional model of the emotion recognition subsystem is shown in Figure 1. Media data here means video fragments that are either received from a video camera or read from a file, and frames - separate static images - frames.

Подсистема распознавания эмоций программно-аппаратного комплекса для оценки эмоций обучаемого разработана с использованием кроссплатформенных технологий Java и форматов данных (JSON [15]).The emotion recognition subsystem of the hardware-software complex for assessing the student's emotions is developed using cross-platform Java technologies and data formats (JSON [15]).

Рисунок 1 - Функциональная модель подсистемы распознавания эмоций Блок предварительной обработки АО представляет собой стандартный комплекс программных компонентов, выполняющий следующие подготовительные преобразования:Figure 1 - Functional model of the emotion recognition subsystem The AO preprocessing unit is a standard complex of software components that performs the following preparatory transformations:

• конвертация изображений,• converting images,

• изменение размера изображения,• resizing the image,

• выравнивание гистограммы изображения,• alignment of the image histogram,

• выравнивание яркости изображения,• equalization of the brightness of the image,

• чтение фреймов видео с камеры или из файла.• reading video frames from a camera or from a file.

Блок А1 определения изображений лиц на фрейме реализует достаточно известный в литературе и хорошо разработанный алгоритм Виолы-Джонса [16]. Данный алгоритм основан на интегральном преобразовании исходной матрицы изображений, при котором каждый компонент матрицы содержит в себе сумму интенсивностей всех пикселей, которые находятся выше и левее данного элемента. Элементы матрицы рассчитываются с помощью формулы:Block A1 for determining the images of faces on the frame implements the well-known and well-developed Viola-Jones algorithm [16]. This algorithm is based on the integral transformation of the original matrix of images, in which each component of the matrix contains the sum of the intensities of all pixels that are above and to the left of this element. Matrix elements are calculated using the formula:

где I (i, j) - яркость пикселя с координатами i и j первоначального изображения.where I (i, j) is the brightness of the pixel with coordinates i and j of the original image.

Затем вычисляются признаки Хаара (рисунок 2), значения которых равняются разности суммы пикселей в белом прямоугольнике и в черном прямоугольнике при последовательном наложении паттернов (битовых масок) на исходное изображение, с дальнейшим применением «жадного» классификатора AdaBoost [17].Then the Haar features are calculated (Figure 2), the values of which are equal to the difference between the sum of pixels in the white rectangle and in the black rectangle with the sequential imposition of patterns (bit masks) on the original image, with further application of the “greedy” classifier AdaBoost [17].

Помимо обнаружения лиц на изображении, блок А1 отвечает за графическое обозначение обнаруженных лиц рамками с добавленными метками распознанных эмоций.In addition to detecting faces in the image, block A1 is responsible for graphically marking the detected faces with frames with added labels of recognized emotions.

В качестве математического аппарата, применяемого на стадии распознавания эмоции после этапа сегментирования и выделения лиц алгоритмом Виолы-Джонса, выступает сверточная нейронная сеть [18]. Сеть строится по каскадному принципу и состоит из набора чередующихся сверточных и субдискретизирующих слоев. Сверточные слои выполняют вычисления:A convolutional neural network acts as a mathematical apparatus used at the stage of emotion recognition after the stage of segmentation and face extraction by the Viola-Jones algorithm [18]. The network is built on a cascade principle and consists of a set of alternating convolutional and downsampling layers. Convolutional layers perform calculations:

где xl - выход (результат) слоя l, ƒ - функция активации, b - коэффициент сдвига, символом * обозначается операция свертки [19]; - карта признаков j (выход слоя l), ƒ - функция активации, - коэффициент сдвига для карты признаков j, - ядро свертки номер j, - карты признаков предыдущего слоя (l-1).where x l is the output (result) of layer l, ƒ is the activation function, b is the shift coefficient, the symbol * denotes the convolution operation [19]; - feature map j (output of layer l), ƒ - activation function, is the shift factor for the feature map j, - kernel of convolution number j, - feature maps of the previous layer (l-1).

Работа субдискретизирующих слоев формально может быть описана:The work of subsampling layers can be formally described:

где ƒ - функция активации, subsample- операция выборки локальных наибольших значений, xl - результат (выход) слоя l, a, b - настроечные коэффициенты.where ƒ is the activation function, subsample is the operation of sampling the local maximum values, x l is the result (output) of layer l, a, b are tuning coefficients.

После каскада сверточных и субдискретизирующих слоев работает многослойная нейронная сеть, которая производит окончательную классификацию обрабатываемого образа:After the cascade of convolutional and downsampling layers, a multilayer neural network works, which produces the final classification of the processed image:

где w - матрица весовых коэффициентов, b - коэффициент сдвига, xl - выход слоя l, ƒ - функция активации нейронов (сигмоидная функция вида где α - масштабный коэффициент).where w is the matrix of weight coefficients, b is the shift coefficient, x l is the output of layer l, ƒ is the neuron activation function (sigmoid function of the form where α is the scale factor).

Нейронная сеть обучалась по методу обратного распространения ошибки с целевой функциейThe neural network was trained using the backpropagation method with an objective function

где р - количество примеров в обучающем множестве, М - количество выходных нейронов (классов), yi - полученное значение на выходе i, di - ожидаемое значение на выходе i.where p is the number of examples in the training set, M is the number of output neurons (classes), y i is the received value at the output i, d i is the expected value at the output i.

Для обучения использовался набор обучающих примеров, состоящий из 40072 изображений, взятых из открытых источников в сети Интернет [20-23]. Например, на рисунке 3 приведены некоторые изображения из выборки, представленной в [21].For training, a set of training examples was used, consisting of 40072 images taken from open sources on the Internet [20-23]. For example, Figure 3 shows some images from the sample presented in [21].

Тестовая выборка была сформирована путем выделения 20% выбранных случайных образом примеров из всей имеющейся совокупности.The test sample was formed by selecting 20% randomly selected examples from the entire available population.

Первая попытка обучения не дала полезных результатов и показала необходимость кардинальной предварительной обработки набора из-за его недостаточного качества, особенно в части изображений в классах «Злость», «Страх» и «Печаль». После проведенной вручную предобработки изображений удалость достичь точности распознавания до 85% на тестовой выборке. Количество эпох обучения составило 1296. Обучение производилось на IBM-совместимом персональном компьютере и продлилось порядка 12 часов. На рисунках 4 и 5 приведены графики изменения точности распознавания эмоции по ходу процесса обучения по каждому классу эмоций. По горизонтальной оси отражены стадии процесса обучения в % от общего количества эпох, а по вертикальной - достигнутая доля правильно распознанных примеров из тестового множества по каждому классу эмоций отдельно. The first attempt at teaching did not give useful results and showed the need for cardinal preprocessing of the set due to its insufficient quality, especially in terms of images in the "Anger", "Fear" and "Sadness" classes. After manual preprocessing of images, it was possible to achieve recognition accuracy of up to 85% on the test sample. The number of training epochs was 1296. Training was carried out on an IBM-compatible personal computer and lasted about 12 hours. Figures 4 and 5 show graphs of changes in the accuracy of emotion recognition during the learning process for each class of emotions. The horizontal axis reflects the stages of the learning process in% of the total number of epochs, and the vertical axis shows the achieved share of correctly recognized examples from the test set for each class of emotions separately.

По графикам, представленным на рисунках 4 и 5 видно, что процесс обучения связан с увеличением точности распознавания, которая достигла значения от 73% для класса «гнев» до 85% для класса «печаль». При этом начальные значения точности принимают значения от 11% для класса «отвращение» до 41% для класса «гнев». На рисунке 6 представлена диаграмма, отображающая количество верно распознанных примеров по отношению к общему количеству примеров из тестового множества по каждому классу распознаваемых эмоций.The graphs presented in Figures 4 and 5 show that the learning process is associated with an increase in the recognition accuracy, which reached values from 73% for the "anger" class to 85% for the "sadness" class. In this case, the initial values of accuracy take values from 11% for the class "disgust" to 41% for the class "anger". Figure 6 presents a diagram showing the number of correctly recognized examples in relation to the total number of examples from the test set for each class of recognized emotions.

Блок подготовки результата распознавания A3 на данном этапе развития программного продукта реализован в виде метода, использующего возможности сериализации объектов из библиотек языка Java.The unit for preparing the A3 recognition result at this stage of the development of the software product is implemented as a method that uses the capabilities of serializing objects from the Java language libraries.

Подсистема распознавания эмоций реализована в виде веб-службы и выполняется на сервере программно-аппаратного комплекса [14].The emotion recognition subsystem is implemented as a web service and runs on the server of the hardware and software complex [14].

Следует отметить, что указанные в вышеприведенном описании компоненты и устройства, включая вычислительные устройства, например, сервер 5, компьютер педагога 13 и компьютер обучаемого 3, их штатные и дополнительные компоненты (клавиатуры, манипуляторы «мышь», микрофоны, громкоговорители, видеокамеры), робототехнический комплекс, его исполнительные механизмы и устройства управления (вычислительные узлы, датчики, дальномеры, видеокамеры, громкоговорители и др.) могут быть выполнены в различном исполнении, что не изменяет сути данного изобретения.It should be noted that the components and devices indicated in the above description, including computing devices, for example,

Вышеописанный вариант выполнения изобретения и его преимущества приведены только в качестве примера и не должны рассматриваться как ограничение данного изобретения.The above-described embodiment of the invention and its advantages are given by way of example only and should not be construed as limiting the present invention.

ИСТОЧНИКИ ИНФОРМАЦИИSOURCES OF INFORMATION

1. Роберт И.В. Современные информационные технологии в образовании: дидактические проблемы; перспективы использования. - М.: ИИОРАО, 2010.-140 с.1. Robert I.V. Modern information technologies in education: didactic problems; prospects of use. - M .: IIORAO, 2010.-140 p.

2. Джаджа В.П. Мультимедийные технологии обучения: Учебное пособие. - Самара: СФ ГБОУ ВПО МГПУ, 2013. - 98 с.2. Judzha V.P. Multimedia Teaching Technologies: Textbook. - Samara: SF GBOU VPO MGPU, 2013 .-- 98 p.

3. Tatarenkov D.A. Analysis of methods for detecting faces in an image // Engineering. Young scientist. 2015. No 4. pp. 270-276.3. Tatarenkov D.A. Analysis of methods for detecting faces in an image // Engineering. Young scientist. 2015. No 4.pp. 270-276.

4. Facial expression recognition software FaceReader // Noldus -Innovative solutions for behavioral research: [Электронный ресурс].4. Facial expression recognition software FaceReader // Noldus -Innovative solutions for behavioral research: [Electronic resource].

5. Williams, A.B. The qualitative impact of using LEGO MINDSTORMS robots to teach computer engineering. IEEE Trans. Educ. 2003, 46, 206.5. Williams, A.B. The qualitative impact of using LEGO MINDSTORMS robots to teach computer engineering. IEEE Trans. Educ. 2003, 46, 206.

6. Ahmad, M.I.; Mubin, O.; Orlando, J. Understanding behaviours and roles for social and adaptive robots in education: teacher's perspective. In Proceedings of the Fourth International Conference on Human Agent Interaction, Singapore, 4-7 October 2016; pp. 297-304.6. Ahmad, M.I .; Mubin, O .; Orlando, J. Understanding behaviors and roles for social and adaptive robots in education: teacher's perspective. In Proceedings of the Fourth International Conference on Human Agent Interaction, Singapore, 4-7 October 2016; pp. 297-304.

7. Патент SU 2 110 095, 27.04.1998.7.

8. Патент SU 2 262 738, 20.10.2005.8.

9. Stepanov, M.F., Kuzmin, A.K., Dolinina, O.N. Hardware and Software System of an Android Assistant for Teachers: Student emotion recognition sybsystem. 2019 International Multi-Conference on Industrial Engineering and Modern Technologies (FarEastCon). DOI: 10.1109/FarEastCon.2019.89343249. Stepanov, M.F., Kuzmin, A.K., Dolinina, O.N. Hardware and Software System of an Android Assistant for Teachers: Student emotion recognition sybsystem. 2019 International Multi-Conference on Industrial Engineering and Modern Technologies (FarEastCon). DOI: 10.1109 / FarEastCon.2019.8934324

10. Y. LeCun, B. Boser, J.S. Denker, D. Henderson, R.E. Howard, W. Hubbard and L.D. Jackel: Backpropagation Applied to Handwritten Zip Code Recognition // Neural Computation, 1(4):541-551, Winter 1989.10. Y. LeCun, B. Boser, J.S. Denker, D. Henderson, R.E. Howard, W. Hubbard and L.D. Jackel: Backpropagation Applied to Handwritten Zip Code Recognition // Neural Computation, 1 (4): 541-551, Winter 1989.

11. Zhao W., Chellappa R., Phillips P., Rosenfeld A. Face recognition: A literature survey // ACM Computing Surveys (CSUR). 2003. V. 35. №4. C. 399-458.11. Zhao W., Chellappa R., Phillips P., Rosenfeld A. Face recognition: A literature survey // ACM Computing Surveys (CSUR). 2003. V. 35. No. 4. S. 399-458.

12. Ekman P., Friesen W. Facial Action Coding System: A Technique for the Measurement of Facial Movement // Consulting Psychologists Press, Palo Alto, 1978.12. Ekman P., Friesen W. Facial Action Coding System: A Technique for the Measurement of Facial Movement // Consulting Psychologists Press, Palo Alto, 1978.

13. Kohn R. Facial Action Coding System; M.: Эксмо, 2013. 103 с.13. Kohn R. Facial Action Coding System; M .: Eksmo, 2013.103 p.

14. Stepanov M.F. Architectural features of the cyberphysical control system of the hardware-software complex of the assistant robot for the teacher / M.F. Stepanov, V.Y. Musatov, I.V. Egorov, S.V. Pchelintseva, A.M. Stepanov // Mathematical methods in engineering and technology: Proceedings of the International Scientific Conference in 12 volumes, Vol.12. / edited by Bolshakov A.A. - St. Petersburg.: Polytechnic University Publishing, 2019. - pp. 25 - 35.14. Stepanov M.F. Architectural features of the cyberphysical control system of the hardware-software complex of the assistant robot for the teacher / M.F. Stepanov, V.Y. Musatov, I.V. Egorov, S.V. Pchelintseva, A.M. Stepanov // Mathematical methods in engineering and technology: Proceedings of the International Scientific Conference in 12 volumes, Vol. 12. / edited by Bolshakov A.A. - St. Petersburg .: Polytechnic University Publishing, 2019. - pp. 25 - 35.

15. D. Crockford The Application/Json Media Type for JavaScript Object Notation (JSON) - Internet Engineering Task Force, 2006. - 10 p.15. D. Crockford The Application / Json Media Type for JavaScript Object Notation (JSON) - Internet Engineering Task Force, 2006 .-- 10 p.

16. Viola P., Jones M. Robust Real-time Object Detection // International Journal of Computer Vision, Second International Workshop On Statistical And Computational Theories Of Vision - Modeling, Learning, Computing And Sampling, Vancouver, Canada, July 200116. Viola P., Jones M. Robust Real-time Object Detection // International Journal of Computer Vision, Second International Workshop On Statistical And Computational Theories Of Vision - Modeling, Learning, Computing And Sampling, Vancouver, Canada, July 2001

17. Sochman J., Matas J. AdaBoost. Center for Machine Perception; M.: Czech Technical University, 2010. 55 c.17. Sochman J., Matas J. AdaBoost. Center for Machine Perception; M .: Czech Technical University, 2010.55 p.

18. Y. LeCun, B. Boser, J. S. Denker, D. Henderson, R. E. Howard, W. Hubbard and L. D. Jackel: Backpropagation Applied to Handwritten Zip Code Recognition // Neural Computation, 1(4):541-551, Winter 1989.18. Y. LeCun, B. Boser, JS Denker, D. Henderson, RE Howard, W. Hubbard and LD Jackel: Backpropagation Applied to Handwritten Zip Code Recognition // Neural Computation, 1 (4): 541-551, Winter 1989 ...

19. Kolmogorov A.N., Fomin S.V. Elements of the theory of functions and functional analysis, - M.: Nauka, 2004 (7th ed.).19. Kolmogorov A.N., Fomin S.V. Elements of the theory of functions and functional analysis, - M .: Nauka, 2004 (7th ed.).

20. Challenges in Representation Learning: Facial Expression Recognition Challenge: [Electronic resource]. 2019. Access mode: https://www.kaggle.com/c/challenges-in-representation-learning-facial-expression-recognition-challenge/data, 21.04.2019.20. Challenges in Representation Learning: Facial Expression Recognition Challenge: [Electronic resource]. 2019. Access mode: https://www.kaggle.com/c/challenges-in-representation-learning-facial-expression-recognition-challenge/data, 21.04.2019.

21. Emotion and identity detection from face images: [Electronic resource]. 2019. Access mode: https://www.kaggle.eom/c/facial-keypoints-detector, 22.04.2019.21. Emotion and identity detection from face images: [Electronic resource]. 2019. Access mode: https: //www.kaggle.eom/c/facial-keypoints-detector, 22.04.2019.

22. The Japanese Female Facial Expression (JAFFE) Database: [Electronic resource]. 2019. Access mode: http://www.kasrl.org/jaffe.html, 25.04.2019.22. The Japanese Female Facial Expression (JAFFE) Database: [Electronic resource]. 2019. Access mode: http://www.kasrl.org/jaffe.html, 25.04.2019.

23. Cohn-Kanade (CK and CK+) database: [Electronic resource]. 2019. Access mode: http://www.consortium.ri.cmu.edu/ckagree/, 27.04.2019.23. Cohn-Kanade (CK and CK +) database: [Electronic resource]. 2019. Access mode: http://www.consortium.ri.cmu.edu/ckagree/, 27.04.2019.

Claims (1)

Priority Applications (1)

| Application Number | Priority Date | Filing Date | Title |

|---|---|---|---|

| RU2020100190A RU2751759C2 (en) | 2019-12-31 | 2019-12-31 | Software and hardware complex of the training system with automatic assessment of the student's emotions |

Applications Claiming Priority (1)

| Application Number | Priority Date | Filing Date | Title |

|---|---|---|---|

| RU2020100190A RU2751759C2 (en) | 2019-12-31 | 2019-12-31 | Software and hardware complex of the training system with automatic assessment of the student's emotions |

Publications (3)

| Publication Number | Publication Date |

|---|---|

| RU2020100190A3 RU2020100190A3 (en) | 2021-06-30 |

| RU2020100190A RU2020100190A (en) | 2021-06-30 |

| RU2751759C2 true RU2751759C2 (en) | 2021-07-16 |

Family

ID=76742557

Family Applications (1)

| Application Number | Title | Priority Date | Filing Date |

|---|---|---|---|

| RU2020100190A RU2751759C2 (en) | 2019-12-31 | 2019-12-31 | Software and hardware complex of the training system with automatic assessment of the student's emotions |

Country Status (1)

| Country | Link |

|---|---|

| RU (1) | RU2751759C2 (en) |

Families Citing this family (1)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| CN115936944B (en) * | 2023-01-31 | 2023-10-13 | 西昌学院 | Virtual teaching management method and device based on artificial intelligence |

Citations (4)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| US20030139654A1 (en) * | 2002-01-23 | 2003-07-24 | Samsung Electronics Co., Ltd. | System and method for recognizing user's emotional state using short-time monitoring of physiological signals |

| WO2006090371A2 (en) * | 2005-02-22 | 2006-08-31 | Health-Smart Limited | Methods and systems for physiological and psycho-physiological monitoring and uses thereof |

| US20120052476A1 (en) * | 2010-08-27 | 2012-03-01 | Arthur Carl Graesser | Affect-sensitive intelligent tutoring system |

| US20140324749A1 (en) * | 2012-03-21 | 2014-10-30 | Alexander Peters | Emotional intelligence engine for systems |

-

2019

- 2019-12-31 RU RU2020100190A patent/RU2751759C2/en active

Patent Citations (4)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| US20030139654A1 (en) * | 2002-01-23 | 2003-07-24 | Samsung Electronics Co., Ltd. | System and method for recognizing user's emotional state using short-time monitoring of physiological signals |

| WO2006090371A2 (en) * | 2005-02-22 | 2006-08-31 | Health-Smart Limited | Methods and systems for physiological and psycho-physiological monitoring and uses thereof |

| US20120052476A1 (en) * | 2010-08-27 | 2012-03-01 | Arthur Carl Graesser | Affect-sensitive intelligent tutoring system |

| US20140324749A1 (en) * | 2012-03-21 | 2014-10-30 | Alexander Peters | Emotional intelligence engine for systems |

Also Published As

| Publication number | Publication date |

|---|---|

| RU2020100190A3 (en) | 2021-06-30 |

| RU2020100190A (en) | 2021-06-30 |

Similar Documents

| Publication | Publication Date | Title |

|---|---|---|

| Alam | Improving learning outcomes through predictive analytics: Enhancing teaching and learning with educational data mining | |

| US11307667B2 (en) | Systems and methods for facilitating accessible virtual education | |

| Cukurova et al. | The NISPI framework: Analysing collaborative problem-solving from students' physical interactions | |

| Richert et al. | Educating engineers for industry 4.0: Virtual worlds and human-robot-teams: Empirical studies towards a new educational age | |

| Rho et al. | An experiential learning approach to learning manual communication through a virtual reality environment | |

| Richert et al. | Digital transformation of engineering education-empirical insights from virtual worlds and human-robot-collaboration | |

| Villegas-Ch et al. | Identification of emotions from facial gestures in a teaching environment with the use of machine learning techniques | |

| Alqarni | COMPARISON OF AUGMENTED REALITY AND CONVENTIONAL TEACHING ON SPECIAL NEEDS STUDENTS'ATTITUDES TOWARDS SCIENCE AND THEIR LEARNING OUTCOMES | |

| Gil | Short project-based learning with MATLAB applications to support the learning of video-image processing | |

| Pise et al. | Estimation of learning affects experienced by learners: an approach using relational reasoning and adaptive mapping | |

| Adamson et al. | Why we should build robots that both teach and learn | |

| CN119293722A (en) | A method for constructing digital portraits of classroom teaching based on time-domain multimodal data fusion | |

| Okawa et al. | Proposal of learning support model for teacher-type robot supporting learning according to learner’s perplexed facial expressions | |

| US20220309947A1 (en) | System and method for monitoring and teaching children with autistic spectrum disorders | |

| RU2751759C2 (en) | Software and hardware complex of the training system with automatic assessment of the student's emotions | |

| Trabelsi et al. | Behavioral-based real-time cheating detection in academic exams using deep learning techniques | |

| Khairy et al. | An algorithm for providing adaptive behavior to humanoid robot in oral assessment | |

| Flores-Castro et al. | The construction of knowledge for the teaching of sciences: A reflection seen from the pedagogical content knowledge (PCK) | |

| KR20220053441A (en) | Method, apparatus and computer program for evaluating lecture video using neural network | |

| Yawar et al. | The Use of Artificial Intelligence in Teaching History and its Effects on Community Leadership | |

| Yaseen et al. | Analyzing Future Trends and Emerging Technologies in ODL (Distance Learning) | |

| Yablochnikov et al. | The Use of Computer Training Systems in Distance Learning | |

| Singh et al. | POGIL (Process Oriented Guided Enquiry Learning)-Innovative Teaching Method Based on Constructivism and Its Effect on Problem-solving Ability of Middle-stage Students | |

| Wang et al. | Teaching feedback system based on VIT expression recognition in distance education | |

| Arunoda et al. | Deep learning-based e-learning solution for identifying and bridging the knowledge gap in primary education |

Legal Events

| Date | Code | Title | Description |

|---|---|---|---|

| QB4A | Licence on use of patent |

Free format text: LICENCE FORMERLY AGREED ON 20211118 Effective date: 20211118 |