KR20240124152A - Wearable device for performing rendering regarding virtual object based on external light and method thereof - Google Patents

Wearable device for performing rendering regarding virtual object based on external light and method thereof Download PDFInfo

- Publication number

- KR20240124152A KR20240124152A KR1020230036145A KR20230036145A KR20240124152A KR 20240124152 A KR20240124152 A KR 20240124152A KR 1020230036145 A KR1020230036145 A KR 1020230036145A KR 20230036145 A KR20230036145 A KR 20230036145A KR 20240124152 A KR20240124152 A KR 20240124152A

- Authority

- KR

- South Korea

- Prior art keywords

- wearable device

- virtual

- light source

- display

- virtual space

- Prior art date

- Legal status (The legal status is an assumption and is not a legal conclusion. Google has not performed a legal analysis and makes no representation as to the accuracy of the status listed.)

- Pending

Links

Images

Classifications

-

- G—PHYSICS

- G06—COMPUTING OR CALCULATING; COUNTING

- G06F—ELECTRIC DIGITAL DATA PROCESSING

- G06F3/00—Input arrangements for transferring data to be processed into a form capable of being handled by the computer; Output arrangements for transferring data from processing unit to output unit, e.g. interface arrangements

- G06F3/01—Input arrangements or combined input and output arrangements for interaction between user and computer

- G06F3/011—Arrangements for interaction with the human body, e.g. for user immersion in virtual reality

-

- G—PHYSICS

- G06—COMPUTING OR CALCULATING; COUNTING

- G06F—ELECTRIC DIGITAL DATA PROCESSING

- G06F1/00—Details not covered by groups G06F3/00 - G06F13/00 and G06F21/00

- G06F1/16—Constructional details or arrangements

- G06F1/1613—Constructional details or arrangements for portable computers

- G06F1/163—Wearable computers, e.g. on a belt

-

- G—PHYSICS

- G06—COMPUTING OR CALCULATING; COUNTING

- G06F—ELECTRIC DIGITAL DATA PROCESSING

- G06F3/00—Input arrangements for transferring data to be processed into a form capable of being handled by the computer; Output arrangements for transferring data from processing unit to output unit, e.g. interface arrangements

- G06F3/002—Specific input/output arrangements not covered by G06F3/01 - G06F3/16

- G06F3/005—Input arrangements through a video camera

-

- G—PHYSICS

- G06—COMPUTING OR CALCULATING; COUNTING

- G06F—ELECTRIC DIGITAL DATA PROCESSING

- G06F3/00—Input arrangements for transferring data to be processed into a form capable of being handled by the computer; Output arrangements for transferring data from processing unit to output unit, e.g. interface arrangements

- G06F3/01—Input arrangements or combined input and output arrangements for interaction between user and computer

- G06F3/048—Interaction techniques based on graphical user interfaces [GUI]

- G06F3/0481—Interaction techniques based on graphical user interfaces [GUI] based on specific properties of the displayed interaction object or a metaphor-based environment, e.g. interaction with desktop elements like windows or icons, or assisted by a cursor's changing behaviour or appearance

-

- G—PHYSICS

- G06—COMPUTING OR CALCULATING; COUNTING

- G06F—ELECTRIC DIGITAL DATA PROCESSING

- G06F3/00—Input arrangements for transferring data to be processed into a form capable of being handled by the computer; Output arrangements for transferring data from processing unit to output unit, e.g. interface arrangements

- G06F3/01—Input arrangements or combined input and output arrangements for interaction between user and computer

- G06F3/048—Interaction techniques based on graphical user interfaces [GUI]

- G06F3/0484—Interaction techniques based on graphical user interfaces [GUI] for the control of specific functions or operations, e.g. selecting or manipulating an object, an image or a displayed text element, setting a parameter value or selecting a range

- G06F3/04842—Selection of displayed objects or displayed text elements

-

- G—PHYSICS

- G06—COMPUTING OR CALCULATING; COUNTING

- G06T—IMAGE DATA PROCESSING OR GENERATION, IN GENERAL

- G06T15/00—3D [Three Dimensional] image rendering

Landscapes

- Engineering & Computer Science (AREA)

- Theoretical Computer Science (AREA)

- General Engineering & Computer Science (AREA)

- Physics & Mathematics (AREA)

- General Physics & Mathematics (AREA)

- Human Computer Interaction (AREA)

- Computer Hardware Design (AREA)

- Computer Graphics (AREA)

- Multimedia (AREA)

- User Interface Of Digital Computer (AREA)

Abstract

Description

본 개시(present disclosure)는 외부 광에 기반하여 가상 객체에 대한 렌더링을 수행하기 위한 웨어러블 장치 및 그 방법에 관한 것이다. The present disclosure relates to a wearable device and method for performing rendering of a virtual object based on external light.

강화된(enhanced) 사용자 경험(user experience)을 제공하기 위해, 실제 세계(real-world) 내 외부 객체와 연계하여 컴퓨터에 의해 생성된 정보를 표시하는 증강 현실(augmented reality, AR) 서비스를 제공하는 전자 장치가 개발되고 있다. 상기 전자 장치는, 사용자에 의해 착용될 수 있는 웨어러블 장치일 수 있다. 예를 들면, 상기 전자 장치는, AR 안경(glasses), 및/또는 머리 착용형 장치(head-mounted device, HMD)일 수 있다.In order to provide an enhanced user experience, electronic devices are being developed that provide augmented reality (AR) services that display computer-generated information in conjunction with external objects in the real world. The electronic devices may be wearable devices that can be worn by a user. For example, the electronic devices may be AR glasses and/or a head-mounted device (HMD).

상술한 정보는 본 개시에 대한 이해를 돕기 위한 목적으로 하는 배경 기술(related art)로 제공될 수 있다. 상술한 내용 중 어느 것도 본 개시와 관련된 종래 기술(prior art)로서 적용될 수 있는지에 대하여 어떠한 주장이나 결정이 제기되지 않는다.The above information may be provided as related art for the purpose of assisting in understanding the present disclosure. No claim or determination is made as to whether any of the above is applicable as prior art related to the present disclosure.

일 실시예(an embodiment)에 따른, 웨어러블 장치(wearable device)는, 카메라, 디스플레이 및 프로세서를 포함할 수 있다. 상기 프로세서는, 상기 카메라로부터 획득된 이미지를 이용하여, 적어도 하나의 실제 광원과 관련된 정보를 획득하도록, 구성될 수 있다. 상기 프로세서는, 상기 디스플레이에 상기 카메라로부터 획득된 이미지의 적어도 일부분을 표시한 동안, 상기 디스플레이에 가상 공간을 표시하기 위한 입력을 수신하도록, 구성될 수 있다. 상기 프로세서는, 상기 입력에 기반하여, 상기 정보를 이용하여, 상기 가상 공간에서 적어도 하나의 가상 광원의 위치를 결정하도록, 구성될 수 있다. 상기 프로세서는, 상기 가상 공간에 포함된 가상 객체 및 상기 웨어러블 장치에 대응하는 상기 가상 공간의 위치 사이의 거리에 기반하여, 상기 디스플레이에 상기 적어도 하나의 가상 광원에 대한 시각 효과가 적용된 상기 가상 객체를 표시하도록, 구성될 수 있다.In one embodiment, a wearable device may include a camera, a display, and a processor. The processor may be configured to acquire information related to at least one real light source using an image acquired from the camera. The processor may be configured to receive an input for displaying a virtual space on the display while displaying at least a portion of the image acquired from the camera on the display. The processor may be configured to determine a location of at least one virtual light source in the virtual space using the information based on the input. The processor may be configured to display a virtual object to which a visual effect for the at least one virtual light source is applied on the display based on a distance between a virtual object included in the virtual space and a location of the virtual space corresponding to the wearable device.

일 실시예에 따른, 웨어러블 장치의 방법은, 상기 웨어러블 장치의 카메라로부터 획득된 이미지를 이용하여, 적어도 하나의 실제 광원과 관련된 정보를 획득하는 동작을 포함할 수 있다. 상기 방법은, 상기 웨어러블 장치의 디스플레이에 상기 카메라로부터 획득된 이미지의 적어도 일부분을 표시한 동안, 상기 디스플레이에 가상 공간을 표시하기 위한 입력을 수신하는 동작을 포함할 수 있다. 상기 방법은, 상기 입력에 기반하여, 상기 정보를 이용하여, 상기 가상 공간에서 적어도 하나의 가상 광원의 위치를 결정하는 동작을 포함할 수 있다. 상기 방법은, 상기 가상 공간에 포함된 가상 객체 및 상기 웨어러블 장치에 대응하는 상기 가상 공간의 위치 사이의 거리에 기반하여, 상기 디스플레이에 상기 적어도 하나의 가상 광원에 대한 시각 효과가 적용된 상기 가상 객체를 표시하는 동작을 포함할 수 있다.In one embodiment, a method of a wearable device may include an operation of acquiring information related to at least one real light source using an image acquired from a camera of the wearable device. The method may include an operation of receiving an input for displaying a virtual space on a display of the wearable device while displaying at least a portion of the image acquired from the camera on the display of the wearable device. The method may include an operation of determining a location of at least one virtual light source in the virtual space using the information based on the input. The method may include an operation of displaying a virtual object to which a visual effect for the at least one virtual light source is applied on the display based on a distance between a virtual object included in the virtual space and a location of the virtual space corresponding to the wearable device.

일 실시예에 따른, 웨어러블 장치(wearable device)는, 카메라, 디스플레이 및 프로세서를 포함할 수 있다. 상기 프로세서는, 상기 카메라를 이용하여, 상기 웨어러블 장치를 포함하는 외부 공간에 배치된 실제 광원과 관련된 정보를 획득하도록, 구성될 수 있다. 상기 프로세서는, 상기 정보에 기반하여, 상기 실제 광원에 대응하는 가상 광원과 연동된 가상 공간의 제1 영역을 식별하도록, 구성될 수 있다. 상기 프로세서는, 상기 디스플레이에, 상기 외부 공간과 구분되는 가상 공간을 표시하는 상태에서, 상기 가상 공간에 포함된 복수의 가상 객체들 중에서, 상기 제1 영역에 포함된 제1 가상 객체에 대한 렌더링을, 상기 가상 광원과 관련된 시각 효과에 기반하여 수행하도록, 구성될 수 있다. 상기 프로세서는, 상기 디스플레이에, 상기 복수의 가상 객체들 중에서, 상기 제1 영역과 상이한 제2 영역에 포함된 제2 가상 객체에 대한 렌더링을, 상기 시각 효과와 독립적으로 수행하도록, 구성될 수 있다. According to one embodiment, a wearable device may include a camera, a display, and a processor. The processor may be configured to obtain information related to a real light source disposed in an external space including the wearable device using the camera. The processor may be configured to identify a first area of a virtual space linked with a virtual light source corresponding to the real light source based on the information. The processor may be configured to perform rendering for a first virtual object included in the first area among a plurality of virtual objects included in the virtual space, while the display displays a virtual space distinct from the external space, based on a visual effect related to the virtual light source. The processor may be configured to perform rendering for a second virtual object included in a second area different from the first area among the plurality of virtual objects, independently of the visual effect, on the display.

일 실시예에 따른, 웨어러블 장치의 방법은, 상기 웨어러블 장치의 카메라를 이용하여, 상기 웨어러블 장치를 포함하는 외부 공간에 배치된 실제 광원과 관련된 정보를 획득하는 동작을 포함할 수 있다. 상기 방법은, 상기 정보에 기반하여, 상기 실제 광원에 대응하는 가상 광원과 연동된 가상 공간의 제1 영역을 식별하는 동작을 포함할 수 있다. 상기 방법은, 상기 웨어러블 장치의 디스플레이에, 상기 외부 공간과 구분되는 가상 공간을 표시하는 상태에서, 상기 가상 공간에 포함된 복수의 가상 객체들 중에서, 상기 제1 영역에 포함된 제1 가상 객체에 대한 렌더링을, 상기 가상 광원과 관련된 시각 효과에 기반하여 수행하는 동작을 포함할 수 있다. 상기 방법은, 상기 디스플레이에, 상기 복수의 가상 객체들 중에서, 상기 제1 영역과 상이한 제2 영역에 포함된 제2 가상 객체에 대한 렌더링을, 상기 시각 효과와 독립적으로 수행하는 동작을 포함할 수 있다.In one embodiment, a method of a wearable device may include an operation of acquiring information related to a real light source disposed in an external space including the wearable device by using a camera of the wearable device. The method may include an operation of identifying a first area of a virtual space linked with a virtual light source corresponding to the real light source based on the information. The method may include an operation of performing rendering for a first virtual object included in the first area among a plurality of virtual objects included in the virtual space, while displaying a virtual space distinct from the external space on a display of the wearable device, based on a visual effect related to the virtual light source. The method may include an operation of performing rendering for a second virtual object included in a second area different from the first area among the plurality of virtual objects, on the display, independently of the visual effect.

도 1a 내지 도 1b는, 일 실시예에 따른, 웨어러블 장치에 의해 표시된 화면의 일 예를 도시한다.

도 2는, 일 실시예에 따른, 웨어러블 장치의 블록도의 일 예를 도시한다.

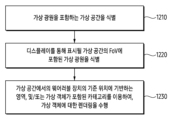

도 3a 내지 도 3b는, 일 실시예에 따른, 웨어러블 장치의 흐름도의 일 예를 도시한다.

도 4는, 복수의 이미지들에 기반하여 실제 광원의 위치를 결정하는 웨어러블 장치의 동작의 일 예를 도시한다.

도 5는, 일 실시예에 따른, 웨어러블 장치의 흐름도의 일 예를 도시한다.

도 6은, 일 실시예에 따른, 웨어러블 장치의 흐름도의 일 예를 도시한다.

도 7은, 일 실시예에 따른, 웨어러블 장치의 흐름도의 일 예를 도시한다.

도 8은, 외부 공간의 실제 광원을 식별하는 웨어러블 장치의 동작의 일 예를 도시한다.

도 9는, 일 실시예에 따른, 웨어러블 장치의 흐름도의 일 예를 도시한다.

도 10a 내지 도 10b는, 외부 공간의 실제 광원과 관련된 정보에 기반하여, 가상 공간에 대한 렌더링을 수행하는 웨어러블 장치의 동작의 일 예를 도시한다.

도 11a 내지 도 11b는, 외부 공간의 실제 광원과 관련된 정보에 기반하여, 가상 공간에 포함된 가상 객체에 대한 렌더링을 수행하는 웨어러블 장치의 동작의 일 예를 도시한다.

도 12는, 일 실시예에 따른, 웨어러블 장치의 흐름도의 일 예를 도시한다.

도 13은, 실제 광원의 이동에 기반하여, 가상 공간에 대한 렌더링을 수행하는 웨어러블 장치의 동작의 일 예를 도시한다.

도 14는, 외부 공간의 밝기 분포에 기반하여, 가상 공간에 대한 렌더링을 수행하는 웨어러블 장치의 동작의 일 예를 도시한다.

도 15는, 일 실시예에 따른, 웨어러블 장치의 흐름도의 일 예를 도시한다.

도 16a는, 일 실시예에 따른, 웨어러블 장치의 사시도(prospective view)의 일 예를 도시한다.

도 16b는, 일 실시예에 따른, 웨어러블 장치 내에 배치된 하나 이상의 하드웨어들의 일 예를 도시한다.

도 17a 내지 도 17b는, 일 실시예에 따른, 웨어러블 장치의 외관의 일 예를 도시한다.

도 18은, 메타버스 서비스와 관련된 네트워크 환경에 대한 예시도이다.FIGS. 1A and 1B illustrate examples of screens displayed by a wearable device according to one embodiment.

FIG. 2 illustrates an example block diagram of a wearable device, according to one embodiment.

FIGS. 3A and 3B illustrate an example of a flow diagram of a wearable device according to one embodiment.

Figure 4 illustrates an example of the operation of a wearable device that determines the location of an actual light source based on multiple images.

FIG. 5 illustrates an example of a flow diagram of a wearable device according to one embodiment.

FIG. 6 illustrates an example of a flow diagram of a wearable device according to one embodiment.

FIG. 7 illustrates an example of a flow diagram of a wearable device according to one embodiment.

Figure 8 illustrates an example of the operation of a wearable device that identifies an actual light source in external space.

FIG. 9 illustrates an example of a flow diagram of a wearable device according to one embodiment.

Figures 10a and 10b illustrate an example of the operation of a wearable device that performs rendering for a virtual space based on information related to actual light sources in external space.

FIGS. 11A and 11B illustrate an example of the operation of a wearable device that performs rendering for a virtual object included in a virtual space based on information related to an actual light source in an external space.

FIG. 12 illustrates an example of a flow diagram of a wearable device according to one embodiment.

Figure 13 illustrates an example of the operation of a wearable device that performs rendering of a virtual space based on the movement of an actual light source.

Figure 14 illustrates an example of the operation of a wearable device that performs rendering for a virtual space based on the brightness distribution of an external space.

FIG. 15 illustrates an example of a flow diagram of a wearable device according to one embodiment.

FIG. 16A illustrates an example of a perspective view of a wearable device, according to one embodiment.

FIG. 16b illustrates an example of one or more hardware elements positioned within a wearable device, according to one embodiment.

FIGS. 17A and 17B illustrate examples of the appearance of a wearable device according to one embodiment.

Figure 18 is an example diagram of a network environment related to a metaverse service.

이하, 본 문서의 다양한 실시예들이 첨부된 도면을 참조하여 설명된다.Below, various embodiments of this document are described with reference to the attached drawings.

본 문서의 다양한 실시 예들 및 이에 사용된 용어들은 본 문서에 기재된 기술을 특정한 실시 형태에 대해 한정하려는 것이 아니며, 해당 실시 예의 다양한 변경, 균등물, 및/또는 대체물을 포함하는 것으로 이해되어야 한다. 도면의 설명과 관련하여, 유사한 구성요소에 대해서는 유사한 참조 부호가 사용될 수 있다. 단수의 표현은 문맥상 명백하게 다르게 뜻하지 않는 한, 복수의 표현을 포함할 수 있다. 본 문서에서, "A 또는 B", "A 및/또는 B 중 적어도 하나", "A, B 또는 C" 또는 "A, B 및/또는 C 중 적어도 하나"와 같은 표현은 함께 나열된 항목들의 모든 가능한 조합을 포함할 수 있다. "제 1", "제 2", "첫째" 또는 "둘째"와 같은 표현들은 해당 구성요소들을, 순서 또는 중요도에 상관없이 수식할 수 있고, 한 구성요소를 다른 구성요소와 구분하기 위해 사용될 뿐 해당 구성요소들을 한정하지 않는다. 어떤(예: 제 1) 구성요소가 다른(예: 제 2) 구성요소에 "(기능적으로 또는 통신적으로) 연결되어" 있다거나 "접속되어" 있다고 언급된 때에는, 상기 어떤 구성요소가 상기 다른 구성요소에 직접적으로 연결되거나, 다른 구성요소(예: 제 3 구성요소)를 통하여 연결될 수 있다.The various embodiments of this document and the terminology used herein are not intended to limit the technology described in this document to the specific embodiments, but should be understood to encompass various modifications, equivalents, and/or substitutes of the embodiments. In connection with the description of the drawings, similar reference numerals may be used for similar components. The singular expressions may include plural expressions unless the context clearly indicates otherwise. In this document, expressions such as "A or B", "at least one of A and/or B", "A, B, or C" or "at least one of A, B and/or C" can include all possible combinations of the items listed together. Expressions such as "first", "second", "first" or "second" can modify the corresponding components, regardless of order or importance, and are only used to distinguish one component from another and do not limit the corresponding components. When it is said that a certain (e.g., a first) component is "(functionally or communicatively) connected" or "connected" to another (e.g., a second) component, said certain component may be directly connected to said other component, or may be connected through another component (e.g., a third component).

본 문서에서 사용된 용어 "모듈"은 하드웨어, 소프트웨어 또는 펌웨어로 구성된 유닛을 포함하며, 예를 들면, 로직, 논리 블록, 부품, 또는 회로와 같은 용어와 상호 호환적으로 사용될 수 있다. 모듈은, 일체로 구성된 부품 또는 하나 또는 그 이상의 기능을 수행하는 최소 단위 또는 그 일부가 될 수 있다. 예를 들면, 모듈은 ASIC(application-specific integrated circuit)으로 구성될 수 있다.The term "module" as used in this document includes a unit composed of hardware, software or firmware, and may be used interchangeably with terms such as logic, logic block, component, or circuit, for example. A module may be an integrally composed component or a minimum unit or part thereof that performs one or more functions. For example, a module may be composed of an application-specific integrated circuit (ASIC).

도 1a 내지 도 1b는, 일 실시예에 따른, 웨어러블 장치(101)에 의해 표시된 화면의 일 예를 도시한다. 일 실시예에서, 웨어러블 장치(101)는 사용자(110)의 머리에 착용 가능한(wearable on) HMD(head-mounted display)를 포함할 수 있다. 비록 안경의 형태를 가지는 웨어러블 장치(101)의 외형이 도시되지만, 실시예가 이에 제한되는 것은 아니다. 웨어러블 장치(101) 내에 포함된 하나 이상의 하드웨어들의 일 예가, 도 2를 참고하여 예시적으로 설명된다. 사용자(110)의 머리에 착용가능한 웨어러블 장치(101)의 구조의 일 예가, 도 16a 내지 도 16b 및/또는 도 17a 내지 도 17b를 참고하여 설명된다. 웨어러블 장치(101)는 전자 장치로 지칭될(referred) 수 있다. 예를 들어, 전자 장치는, 사용자의 머리에 부착되기 위한 액세서리와 결합되어, HMD를 형성할 수 있다.FIGS. 1A to 1B illustrate an example of a screen displayed by a wearable device (101) according to an embodiment. In an embodiment, the wearable device (101) may include a head-mounted display (HMD) wearable on a head of a user (110). Although the external appearance of the wearable device (101) in the form of glasses is illustrated, the embodiment is not limited thereto. An example of one or more hardwares included in the wearable device (101) is exemplarily described with reference to FIG. 2. An example of a structure of the wearable device (101) wearable on the head of a user (110) is described with reference to FIGS. 16A to 16B and/or FIGS. 17A to 17B. The wearable device (101) may be referred to as an electronic device. For example, an electronic device may be combined with an accessory to attach to a user's head to form an HMD.

일 실시예에 따른, 웨어러블 장치(101)는 VST(video see-through) 및/또는 가상 현실(virtual reality, VR)과 관련된 기능을 실행할 수 있다. 사용자(110)가 웨어러블 장치(101)를 착용한 상태 내에서, 일 실시예에 따른, 웨어러블 장치(101)는 사용자(110)의 눈을 덮는 하우징을 포함할 수 있다. 웨어러블 장치(101)는, 상기 상태 내에서, 상기 눈을 향하는 상기 하우징의 제1 면에 배치된 디스플레이를 포함할 수 있다. 웨어러블 장치(101)는 상기 제1 면과 반대인 제2 면 상에 배치된 카메라를 포함할 수 있다. 상기 카메라를 이용하여, 웨어러블 장치(101)는 주변 광(ambient light)이 포함된 이미지들을 획득할 수 있다. 웨어러블 장치(101)는 상기 제1 면에 배치된 디스플레이 내에, 상기 이미지들을 순차적으로(sequentially) 출력하여, 사용자(110)가 상기 디스플레이를 통해 상기 주변 광을 인식하게 할 수 있다. 상기 제1 면에 배치된 디스플레이의 표시 영역은, 상기 디스플레이에 포함된 하나 이상의 픽셀들에 의해 형성될 수 있다. 웨어러블 장치(101)는 상기 디스플레이를 통해 출력되는 프레임들 내에 가상 객체를 합성하여, 사용자(110)가 주변 광에 의해 인식되는 실제 객체와 함께 상기 가상 객체를 인식하게 할 수 있다.In one embodiment, a wearable device (101) can perform functions related to video see-through (VST) and/or virtual reality (VR). In a state where a user (110) wears the wearable device (101), in one embodiment, the wearable device (101) can include a housing that covers an eye of the user (110). In the state, the wearable device (101) can include a display disposed on a first side of the housing facing the eye. The wearable device (101) can include a camera disposed on a second side opposite to the first side. Using the camera, the wearable device (101) can acquire images including ambient light. The wearable device (101) can sequentially output the images within the display arranged on the first surface, so that the user (110) can recognize the ambient light through the display. The display area of the display arranged on the first surface can be formed by one or more pixels included in the display. The wearable device (101) can synthesize a virtual object within frames output through the display, so that the user (110) can recognize the virtual object together with a real object recognized by the ambient light.

일 실시예에 따른, 웨어러블 장치(101)는 증강 현실(augmented reality, AR) 및/또는 혼합 현실(mixed reality, MR)과 관련된 기능을 실행할 수 있다. 도 1a 내지 도 1b의 도시에서(as shown in), 사용자(110)가 웨어러블 장치(101)를 착용한 상태 내에서, 웨어러블 장치(101)는 사용자(110)의 눈에 인접하게 배치된 적어도 하나의 렌즈를 포함할 수 있다. 웨어러블 장치(101)는 렌즈를 통과하는 주변 광에, 웨어러블 장치(101)의 디스플레이로부터 방사된 광을 결합할 수 있다. 상기 디스플레이의 표시 영역은, 주변 광이 통과되는 렌즈 내에서 형성될 수 있다. 웨어러블 장치(101)가 상기 주변 광 및 상기 디스플레이로부터 방사된 상기 광을 결합하기 때문에, 사용자(110)는 상기 주변 광에 의해 인식되는 실제 객체(real object) 및 상기 디스플레이로부터 방사된 상기 광에 의해 형성된 가상 객체(virtual object)가 혼합된 상(image)을 볼 수 있다.In one embodiment, the wearable device (101) may perform functions related to augmented reality (AR) and/or mixed reality (MR). As shown in FIGS. 1A and 1B , when a user (110) wears the wearable device (101), the wearable device (101) may include at least one lens positioned adjacent to an eye of the user (110). The wearable device (101) may combine ambient light passing through the lens with light emitted from a display of the wearable device (101). A display area of the display may be formed within the lens through which the ambient light passes. Since the wearable device (101) combines the ambient light and the light emitted from the display, the user (110) can see an image that is a mixture of a real object recognized by the ambient light and a virtual object formed by the light emitted from the display.

도 1a를 참고하면, 상이한 모드들에서 웨어러블 장치(101)에 의해 표시되는 화면들(131, 132)이 도시된다. 도 1a를 참고하면, 웨어러블 장치(101)는 VST 모드로 지칭되는 제1 지정된 모드에서, 화면(131)을 표시할 수 있다. VST 모드에서, 웨어러블 장치(101)는 카메라를 통해 획득된 이미지 및/또는 비디오를 포함하는 화면(131)을 표시할 수 있다. VST 모드에서, 웨어러블 장치(101)를 착용한 사용자(110)는, 사용자(110)의 두 눈들에 덮인 하우징과 독립적으로, 화면(131)을 통해 웨어러블 장치(101)를 포함하는 외부 공간을 인식할 수 있다. VST 모드에서, 웨어러블 장치(101)는 화면(131)에서, 외부 공간에 대한 이미지 및/또는 비디오와 함께, 하나 이상의 가상 객체들(예, 가상 객체들(180, 181))을 표시할 수 있다. 예를 들어, 웨어러블 장치(101)는 패널의 형태를 가지는 가상 객체(180)에, 어플리케이션을 표현하는 아이콘의 형태를 가지는 가상 객체(181)를 표시할 수 있다. 일 실시예에서, 가상 객체(180)는 어플리케이션 트레이(또는 앱 트레이)로 지칭될 수 있다. 가상 객체(181)를 선택하는 입력에 응답하여, 웨어러블 장치(101)는 상기 어플리케이션을 실행하고, 상기 어플리케이션으로부터 제공된 화면(132)을 표시할 수 있다.Referring to FIG. 1A, screens (131, 132) displayed by the wearable device (101) in different modes are illustrated. Referring to FIG. 1A, the wearable device (101) can display the screen (131) in a first designated mode referred to as the VST mode. In the VST mode, the wearable device (101) can display the screen (131) including images and/or videos acquired through a camera. In the VST mode, a user (110) wearing the wearable device (101) can recognize an external space including the wearable device (101) through the screen (131), independently of the housing covering both eyes of the user (110). In VST mode, the wearable device (101) can display one or more virtual objects (e.g., virtual objects (180, 181)) on the screen (131) together with images and/or videos of external space. For example, the wearable device (101) can display a virtual object (181) having a form of an icon representing an application on a virtual object (180) having a form of a panel. In one embodiment, the virtual object (180) can be referred to as an application tray (or app tray). In response to an input for selecting the virtual object (181), the wearable device (101) can execute the application and display a screen (132) provided from the application.

도 1a를 참고하면, 웨어러블 장치(101)는 VR 모드로 지칭되는 제2 지정된 모드에서, 화면(132)을 표시할 수 있다. VR 모드에서, 웨어러블 장치(101)는 가상 공간(140)의 적어도 일부분을 표현한 화면(132)을 표시할 수 있다. VR 모드에서, 일 실시예에 따른, 웨어러블 장치(101)는, 가상 공간(140)에 형성된 FoV(field-of-view)에 기반하여, 화면(132)을 표시할 수 있다. 도 1a를 참고하면, 웨어러블 장치(101)는 가상 공간(140)의 FoV에 포함된 가상 객체들(161, 162)을, 화면(132)에 표시할 수 있다. 화면(132)에서, 웨어러블 장치(101)는 양안 시차(binocular disparity)를 이용하여, 원근감을 가지는 가상 객체들(161, 162)을 표시할 수 있다. 화면(132)에 포함된 가상 객체들(161, 162)은, 웨어러블 장치(101)에 의해 실행되는 프로그램(예, 소프트웨어 어플리케이션)으로부터 제공된 그래픽 객체(graphical object), 윈도우(예, 액티비티(activity)) 및/또는 위젯(또는 가젯)을 포함할 수 있다. 도 1a를 참고하면, 웨어러블 장치(101)는 입체 도형의 형태를 가지는 가상 객체(161) 및 윈도우의 형태를 가지는 가상 객체(162)가 예시적으로 도시되지만, 실시예가 이에 제한되는 것은 아니다.Referring to FIG. 1A, the wearable device (101) can display a screen (132) in a second designated mode referred to as a VR mode. In the VR mode, the wearable device (101) can display a screen (132) representing at least a portion of a virtual space (140). In the VR mode, the wearable device (101) according to one embodiment can display the screen (132) based on a field-of-view (FoV) formed in the virtual space (140). Referring to FIG. 1A, the wearable device (101) can display virtual objects (161, 162) included in the FoV of the virtual space (140) on the screen (132). On the screen (132), the wearable device (101) can display virtual objects (161, 162) having a sense of perspective by utilizing binocular disparity. The virtual objects (161, 162) included in the screen (132) may include graphical objects, windows (e.g., activities), and/or widgets (or gadgets) provided from a program (e.g., software application) executed by the wearable device (101). Referring to FIG. 1A, the wearable device (101) is exemplarily illustrated as a virtual object (161) having a three-dimensional shape and a virtual object (162) having a window shape, but the embodiment is not limited thereto.

일 실시예에 따른, 웨어러블 장치(101)는, 외부 공간에서, 적어도 하나의 실제 광원(real light source)(예, 플로어 램프(120))을 인식할 수 있다. 웨어러블 장치(101)가 실제 광원을 인식하는 것은, 외부 공간에서의 상기 실제 광원의 위치, 상기 실제 광원으로부터 방사되는 광의 색상 또는 밝기 중 적어도 하나를 식별하는 동작을 포함할 수 있다. 도 1a를 참고하면, 실제 광원의 일 예인 플로어 램프(120)에 인접한 웨어러블 장치(101)가 예시적으로 도시된다. VST 모드에서 동작하는 웨어러블 장치(101)는, 웨어러블 장치(101)를 착용한 사용자(110)의 전 방(front direction)을 향하는 카메라를 이용하여, 플로어 램프(120)를 식별할 수 있다. 일 실시예에 따른, 웨어러블 장치(101)는, 카메라로부터 획득된 이미지를 이용하여, 적어도 하나의 실제 광원과 관련된 정보를 획득할 수 있다. 일 실시예에 따른, 웨어러블 장치(101)가 실제 광원을 인식하는 동작이, 도 4 내지 도 9를 참고하여 설명된다.In one embodiment, the wearable device (101) can recognize at least one real light source (e.g., a floor lamp (120)) in an external space. The wearable device (101) recognizing the real light source can include an operation of identifying at least one of a location of the real light source in the external space, a color or brightness of light radiating from the real light source. Referring to FIG. 1A, a wearable device (101) adjacent to a floor lamp (120), which is an example of a real light source, is exemplarily illustrated. The wearable device (101) operating in a VST mode can identify the floor lamp (120) using a camera facing a front direction of a user (110) wearing the wearable device (101). In one embodiment, the wearable device (101) can obtain information related to at least one real light source using an image obtained from the camera. According to one embodiment, an operation of a wearable device (101) recognizing an actual light source is described with reference to FIGS. 4 to 9.

일 실시예에 따른, 웨어러블 장치(101)는, 화면(131)과 같이, 디스플레이에 카메라로부터 획득된 이미지의 적어도 일부분을 표시한 동안, 상기 디스플레이에 가상 공간을 표시하기 위한 입력을 식별할 수 있다. 상기 입력은, 가상 공간(140)을 제공하기 위한 어플리케이션을 표현한 아이콘의 형태를 가지는 가상 객체(181)를 선택하는 입력을 포함할 수 있다. 실시예가 이에 제한되는 것은 아니며, 상기 입력은, 웨어러블 장치(101)에 연결된 리모트 컨트롤러, 웨어러블 장치(101)에 포함된 버튼 또는 사용자(110)의 보이스 커맨드(예, 가상 공간(140)의 표시를 촉발하는(triggering) 발언) 중 적어도 하나를 포함할 수 있다.According to one embodiment, the wearable device (101) may identify an input for displaying a virtual space on the display while displaying at least a portion of an image acquired from a camera on a display, such as a screen (131). The input may include an input for selecting a virtual object (181) having a form of an icon representing an application for providing the virtual space (140). The embodiment is not limited thereto, and the input may include at least one of a remote controller connected to the wearable device (101), a button included in the wearable device (101), or a voice command of a user (110) (e.g., an utterance triggering the display of the virtual space (140).

일 실시예에 따른, 웨어러블 장치(101)는 상기 입력에 기반하여, 상기 정보를 이용하여, 가상 공간(140)에서 적어도 하나의 가상 광원(150)의 위치를 결정하거나 또는 식별할 수 있다. 웨어러블 장치(101)가 플로어 램프(120)를 식별한 도 1a의 예시적인 케이스에서, 웨어러블 장치(101)는 플로어 램프(120) 및 웨어러블 장치(101) 사이의 위치 관계에 기반하여, 가상 공간(140)에서, 실제 광원인 플로어 램프(120)에 대응하는 가상 광원(150)의 위치(P1)를 결정할 수 있다. 상기 위치 관계는, 플로어 램프(120) 및 웨어러블 장치(101) 사이의 거리, 또는 웨어러블 장치(101)에 대한 플로어 램프(120)의 방위 각(azimuth angle) 중 적어도 하나를 포함할 수 있다. 일 실시예에서, VST를 위한 제1 지정된 모드로부터, 가상 공간(140)과 관련된 VR을 위한 제2 지정된 모드로 전환하기 위한 상기 입력에 기반하여, 웨어러블 장치(101)는 실제 광원인 플로어 램프(120)에 대응하는 가상 광원(150)의 가상 공간(140)에서의 위치를 결정할 수 있다.According to one embodiment, the wearable device (101) may determine or identify a location of at least one virtual light source (150) in the virtual space (140) based on the input and using the information. In the exemplary case of FIG. 1A in which the wearable device (101) identifies a floor lamp (120), the wearable device (101) may determine a location (P1) of a virtual light source (150) corresponding to the floor lamp (120), which is an actual light source, in the virtual space (140) based on a positional relationship between the floor lamp (120) and the wearable device (101). The positional relationship may include at least one of a distance between the floor lamp (120) and the wearable device (101), or an azimuth angle of the floor lamp (120) with respect to the wearable device (101). In one embodiment, based on the input for switching from the first designated mode for VST to the second designated mode for VR associated with the virtual space (140), the wearable device (101) can determine the location in the virtual space (140) of a virtual light source (150) corresponding to the actual light source, the floor lamp (120).

일 실시예에 따른, 웨어러블 장치(101)는 실제 광원(예, 플로어 램프(120))에 대응하는 가상 광원(150)을 이용하여, 상기 가상 광원(150)을 포함하는 가상 공간(140)에 대한 렌더링을 수행할 수 있다. 실시예가 이에 제한되는 것은 아니며, 웨어러블 장치(101)는, 실제 광원에 기반하여 가상 공간(140) 내 조도를 조절할 수 있다. 예를 들어, 실제 광원에 대응하는 가상 광원(150)과 독립적으로, 전자 장치(101)는 상기 실제 광원과 관련된 조도 및/또는 색상을 가지는 가상 공간(140)에 대한 렌더링을 수행할 수 있다. 이하에서, 렌더링은, 가상 공간(140)을 표현한 이미지 및/또는 비디오(예, 화면(132))을 표시하기 위한 하나 이상의 기능들을 포함할 수 있다. 가상 공간(140)의 위치(P2)가 웨어러블 장치(101)에 대응하는 경우, 웨어러블 장치(101) 및 플로어 램프(120)의 위치 관계는, 가상 공간(140)의 위치(P2) 및 가상 광원(150)의 위치(P1)의 위치 관계에 매칭될 수 있다. 예를 들어, VST 모드의 화면(131)을 통해 보이는 실제 광원(예, 플로어 램프(120))의 위치는, VR 모드의 화면(132)에 렌더링된 가상 광원(150)의 위치에 매핑될 수 있다. 일 실시예에 따른, 웨어러블 장치(101)는 실제 광원(예, 플로어 램프(120))로부터 방사되는 광(이하, 실제 광)의 색상, 밝기(brightness) 및/또는 세기(intensity)(또는 강도)에 기반하여, 가상 광원(150)으로부터 방사되는 광(이하, 가상 광)과 관련된 렌더링을 수행할 수 있다. 일 실시예에 따른, 적어도 하나의 실제 광원에 대응하는 적어도 하나의 가상 광원에 기반하는 렌더링을 수행하는 웨어러블 장치(101)의 동작이, 도 10a 내지 도 10b, 도 11a 내지 도 11b, 도 12 내지 도 15를 참고하여 설명된다. According to one embodiment, the wearable device (101) may perform rendering for a virtual space (140) including a virtual light source (150) corresponding to an actual light source (e.g., a floor lamp (120)). The embodiment is not limited thereto, and the wearable device (101) may adjust the illuminance in the virtual space (140) based on the actual light source. For example, independently of the virtual light source (150) corresponding to the actual light source, the electronic device (101) may perform rendering for a virtual space (140) having illuminance and/or color related to the actual light source. Hereinafter, the rendering may include one or more functions for displaying an image and/or video (e.g., a screen (132)) representing the virtual space (140). When the position (P2) of the virtual space (140) corresponds to the wearable device (101), the positional relationship between the wearable device (101) and the floor lamp (120) may match the positional relationship between the position (P2) of the virtual space (140) and the position (P1) of the virtual light source (150). For example, the position of an actual light source (e.g., a floor lamp (120)) seen through the screen (131) of the VST mode may be mapped to the position of a virtual light source (150) rendered on the screen (132) of the VR mode. According to one embodiment, the wearable device (101) may perform rendering related to light (hereinafter, virtual light) emitted from the virtual light source (150) based on the color, brightness, and/or intensity (or strength) of light (hereinafter, actual light) emitted from the actual light source (e.g., the floor lamp (120)). The operation of a wearable device (101) performing rendering based on at least one virtual light source corresponding to at least one real light source according to one embodiment is described with reference to FIGS. 10A to 10B, FIGS. 11A to 11B, and FIGS. 12 to 15.

일 실시예에 따른, 웨어러블 장치(101)는, 가상 공간(140)에 포함된 가상 객체(예, 가상 객체들(161, 162)) 및 웨어러블 장치(101)에 대응하는 가상 공간(140)의 위치(P2) 사이의 거리에 기반하여, 상기 가상 객체로 적어도 하나의 가상 광원(150)에 대한 시각 효과를 적용할 수 있다. 웨어러블 장치(101)가 상기 가상 객체를 표시하는 것은, 상기 가상 객체 및/또는 상기 가상 객체를 포함하는 가상 공간(140)에 대한 렌더링을 수행하는 동작을 포함할 수 있다. 웨어러블 장치(101)가 가상 광원(150)에 대한 시각 효과를 적용하는 것은, 상기 가상 광원(150)으로부터 방사되는 가상의 광에 기반하여, 가상 객체의 색상 및/또는 밝기를 적어도 부분적으로 변경하는 동작, 또는 상기 가상 객체로부터 연장된 그림자를 표시하는 동작 중 적어도 하나를 포함할 수 있다. 도 1a를 참고하면, 웨어러블 장치(101)는, 가상 객체(161)로부터, 가상 광원(150)에서 가상 객체(161)로 향하는 방향(D1)을 따라 연장된 그림자를 표현하는 시각적 객체(170)를 표시할 수 있다. 일 실시예에 따른, 웨어러블 장치(101)는, 위치(P2)로부터 지정된 임계치를 초과하는 거리만큼 이격된 가상 객체(161)에 대한 렌더링을, 가상 광원(150)에 대한 시각 효과를 이용하여 수행할 수 있다.According to one embodiment, the wearable device (101) may apply a visual effect to at least one virtual light source (150) to a virtual object included in a virtual space (140) based on a distance between the virtual object (e.g., virtual objects (161, 162)) and a location (P2) of the virtual space (140) corresponding to the wearable device (101). The wearable device (101) displaying the virtual object may include an operation of performing rendering on the virtual object and/or the virtual space (140) including the virtual object. The wearable device (101) applying the visual effect to the virtual light source (150) may include at least one of an operation of at least partially changing a color and/or brightness of the virtual object based on virtual light radiated from the virtual light source (150), or an operation of displaying a shadow extended from the virtual object. Referring to FIG. 1A, the wearable device (101) may display a visual object (170) that represents a shadow extending from a virtual object (161) along a direction (D1) from a virtual light source (150) to the virtual object (161). According to one embodiment, the wearable device (101) may perform rendering for a virtual object (161) that is spaced apart from a location (P2) by a distance exceeding a specified threshold, using a visual effect for the virtual light source (150).

일 실시예에 따른, 웨어러블 장치(101)는, 가상 공간(140)에서의 가상 광원(150)의 위치(P1), 가상 객체의 위치, 카테고리 또는 가상 공간(140)에서 웨어러블 장치(101)에 대응하는 위치(P2) 중 적어도 하나를 이용하여, 상기 가상 객체로 상기 가상 광원(150)과 관련된 시각 효과를 적용할 수 있다. 예를 들어, 가상 객체가 웨어러블 장치(101)를 착용한 사용자(110)와 상호작용(interaction)하기 위한 지정된 카테고리에 포함되었는지 여부에 기반하여, 웨어러블 장치(101)는 상기 가상 객체로 상기 시각 효과를 적용할지 여부를 식별 및/또는 결정할 수 있다. 상기 지정된 카테고리는, 윈도우로 지칭되는 2 차원 평면의 형태를 가지는 패널을 포함할 수 있다. 실시예가 이에 제한되는 것은 아니며, 상기 지정된 카테고리는, 텍스트, 이미지, 아이콘, 비디오, 버튼, 체크박스, 라디오버튼, 텍스트 박스, 슬라이더, 타임 피커, 프로그레스 바, 및/또는 테이블과 같이, 정보의 송신 및/또는 상호작용(interaction)을 위해 화면(132) 및/또는 가상 공간(140) 내에 배치될 수 있는(deployable) 가상 객체를 포함할 수 있다. 도 1a를 참고하면, 사용자(110)와 상호작용하기 위한 윈도우인 가상 객체(162)를 표시하는 상태에서, 웨어러블 장치(101)는 가상 객체(162)로, 가상 광원(150)과 관련된 시각 효과를 적용하는 것을 중단할 수 있다. 예를 들어, 웨어러블 장치(101)는 가상 객체(162)에 대한 렌더링을, 가상 광원(150)과 관련된 시각 효과와 독립적으로 수행할 수 있다.According to one embodiment, the wearable device (101) may apply a visual effect related to the virtual light source (150) to the virtual object by using at least one of the position (P1) of the virtual light source (150) in the virtual space (140), the position, category of the virtual object, or the position (P2) corresponding to the wearable device (101) in the virtual space (140). For example, the wearable device (101) may identify and/or determine whether to apply the visual effect to the virtual object based on whether the virtual object is included in a designated category for interaction with a user (110) wearing the wearable device (101). The designated category may include a panel having a form of a two-dimensional plane referred to as a window. The embodiments are not limited thereto, and the above-mentioned categories may include virtual objects deployable within the screen (132) and/or virtual space (140) for transmitting and/or interacting with information, such as text, images, icons, videos, buttons, checkboxes, radio buttons, text boxes, sliders, time pickers, progress bars, and/or tables. Referring to FIG. 1A, while displaying a virtual object (162) as a window for interacting with a user (110), the wearable device (101) may stop applying visual effects associated with the virtual light source (150) to the virtual object (162). For example, the wearable device (101) may perform rendering for the virtual object (162) independently from the visual effects associated with the virtual light source (150).

상술한 바와 같이, 일 실시예에 따른, 웨어러블 장치(101)는, 웨어러블 장치(101)를 포함하는 환경(예, 웨어러블 장치(101)를 포함하는 외부 공간)에 대한 정보에 기반하여, VR을 위한 가상 공간(140)에 대한 렌더링을 수행할 수 있다. 예를 들어, 웨어러블 장치(101)는 외부 공간에 포함된 실제 광원(예, 플로어 램프(120))에 대응하는 가상 광원(150)을, 가상 공간(140)에 배치할 수 있다. 가상 공간(140)에 배치된 가상 광원(150)에 기반하여, 웨어러블 장치(101)는 가상 공간(140)에 포함된 하나 이상의 가상 객체들(161, 162)에 대한 렌더링을 수행할 수 있다. 예를 들어, VST 모드에 기반하여 실제 광원인 플로어 램프(120)를 포함하는 화면(131)을 표시하는 웨어러블 장치(101)는, 상기 VST 모드로부터 VR 모드로 전환한 이후, 상기 플로어 램프(120)에 대응하는 가상 광원(150)에 기반하여 렌더링된 화면(132)을 표시할 수 있다. 플로어 램프(120)에 대응하는 가상 광원(150)을 이용하여, 웨어러블 장치(101)는 VST 모드로부터 VR 모드로 전환하는 동안, 연속적인(continuous) 사용자 경험을 제공할 수 있다.As described above, according to one embodiment, the wearable device (101) may perform rendering for a virtual space (140) for VR based on information about an environment including the wearable device (101) (e.g., an external space including the wearable device (101)). For example, the wearable device (101) may place a virtual light source (150) corresponding to an actual light source included in the external space (e.g., a floor lamp (120)) in the virtual space (140). Based on the virtual light source (150) placed in the virtual space (140), the wearable device (101) may perform rendering for one or more virtual objects (161, 162) included in the virtual space (140). For example, a wearable device (101) displaying a screen (131) including a floor lamp (120), which is a real light source, based on a VST mode can display a screen (132) rendered based on a virtual light source (150) corresponding to the floor lamp (120) after switching from the VST mode to a VR mode. By using the virtual light source (150) corresponding to the floor lamp (120), the wearable device (101) can provide a continuous user experience while switching from the VST mode to the VR mode.

도 1b를 참고하면, VST 모드 및/또는 VR 모드 내 웨어러블 장치(101)에 의해 표시되는 화면들(131, 133, 134)이 예시적으로 도시된다. 도 1b를 참고하면, VST 모드에 기반하는 화면(131)을 표시하는 상태에서, 웨어러블 장치(101)는 모드의 변경을 위한 옵션들을 포함하는 가상 객체(180)를 표시할 수 있다. 가상 객체(180) 내에, 웨어러블 장치(101)는, 상기 VST 모드와 상이한 모드(예, VR 모드)에서 구동되는 어플리케이션을 표현하는 아이콘(예, 가상 객체들(181, 182))을 표시할 수 있다.Referring to FIG. 1b, screens (131, 133, 134) displayed by the wearable device (101) in the VST mode and/or the VR mode are exemplarily illustrated. Referring to FIG. 1b, in a state of displaying the screen (131) based on the VST mode, the wearable device (101) may display a virtual object (180) including options for changing the mode. Within the virtual object (180), the wearable device (101) may display an icon (e.g., virtual objects (181, 182)) representing an application running in a mode (e.g., VR mode) different from the VST mode.

도 1b를 참고하면, VR 모드에 기반하는 화면(133)의 표시를 나타내는 입력에 응답하여, 웨어러블 장치(101)는 상기 어플리케이션으로부터 제공된 화면(133)을 표시할 수 있다. 예를 들어, 가상 객체(181)의 선택을 나타내는 입력을 식별하는 것에 기반하여, 웨어러블 장치(101)는 화면(133)을 표시할 수 있다. 웨어러블 장치(101)에 의해 표시되는 화면(133)은, VR 모드에 기반하는 지정된 화면(예, 홈 화면)을 포함할 수 있다. 상기 지정된 화면은, 웨어러블 장치(101)에 의해 지원되는 하나 이상의 기능들 중 적어도 하나를 실행하기 위한 객체(예, 아이콘)를 포함할 수 있다. 화면(133)을 표시하는 상태에서, 웨어러블 장치(101)는 플로어 램프(120)와 같은 실제 광원에 대응하는 가상 광원(150)을, 가상 공간에 배치할 수 있다. 상기 가상 공간에 배치된 가상 광원(150)에 기반하여, 웨어러블 장치(101)는 상기 가상 광원(150)과 관련된 시각 효과가 적용된 화면(133)을 표시할 수 있다.Referring to FIG. 1B, in response to an input indicating display of a screen (133) based on a VR mode, the wearable device (101) may display a screen (133) provided from the application. For example, based on identifying an input indicating selection of a virtual object (181), the wearable device (101) may display the screen (133). The screen (133) displayed by the wearable device (101) may include a designated screen (e.g., a home screen) based on the VR mode. The designated screen may include an object (e.g., an icon) for executing at least one of one or more functions supported by the wearable device (101). In a state of displaying the screen (133), the wearable device (101) may place a virtual light source (150) corresponding to an actual light source, such as a floor lamp (120), in the virtual space. Based on the virtual light source (150) placed in the above virtual space, the wearable device (101) can display a screen (133) to which a visual effect related to the virtual light source (150) is applied.

도 1b를 참고하면, VR 모드를 위한 어플리케이션의 실행을 나타내는 입력에 응답하여, 웨어러블 장치(101)는 상기 어플리케이션으로부터 제공된 화면(133)을 표시할 수 있다. 예를 들어, 가상 객체(182)의 선택을 나타내는 입력을 식별하는 것에 기반하여, 웨어러블 장치(101)는 화면(133)을 표시할 수 있다. 가상 객체(182)는 몰입형 가상 현실을 제공하기 위한 어플리케이션의 아이콘을 포함할 수 있다. 웨어러블 장치(101)는 가상 객체(182)에 대응하는 어플리케이션을 실행하여, 몰입형 가상 현실에 기반하는 화면(134)을 표시할 수 있다. 비디오를 재생하기 위한 가상 객체(185)를 포함하는 화면(134)을 표시하는 상태에서, 웨어러블 장치(101)는 실제 광원에 대응하는 가상 광원에 기반하는 렌더링을 적어도 일시적으로 중단할 수 있다. 예를 들어, 몰입형 가상 현실에 기반하는 사용자 경험을 개선하기 위하여, 웨어러블 장치(101)는 상기 가상 광원에 기반하는 렌더링을 제한할 수 있다.Referring to FIG. 1b, in response to an input indicating execution of an application for VR mode, the wearable device (101) may display a screen (133) provided from the application. For example, based on identifying an input indicating selection of a virtual object (182), the wearable device (101) may display the screen (133). The virtual object (182) may include an icon of an application for providing immersive virtual reality. The wearable device (101) may execute an application corresponding to the virtual object (182) to display a screen (134) based on immersive virtual reality. While displaying the screen (134) including a virtual object (185) for playing a video, the wearable device (101) may at least temporarily suspend rendering based on a virtual light source corresponding to an actual light source. For example, to improve user experience based on immersive virtual reality, the wearable device (101) may limit rendering based on the virtual light source.

이하에서는, 도 2를 참고하여, 도 1a 내지 도 1b의 웨어러블 장치(101)에 포함된 하나 이상의 하드웨어들 및/또는 소프트웨어의 일 예가 설명된다.Hereinafter, with reference to FIG. 2, an example of one or more hardware and/or software included in the wearable device (101) of FIGS. 1a and 1b is described.

도 2는, 일 실시예에 따른, 웨어러블 장치(101)의 블록도의 일 예를 도시한다. 도 2의 웨어러블 장치(101)는, 도 1a 내지 도 1b의 웨어러블 장치(101)를 포함할 수 있다.FIG. 2 illustrates an example of a block diagram of a wearable device (101) according to one embodiment. The wearable device (101) of FIG. 2 may include the wearable device (101) of FIGS. 1A to 1B.

일 실시예에 따른, 웨어러블 장치(101)는, 프로세서(210), 메모리(215), 디스플레이(220), 카메라(225), 센서(230), 또는 통신 회로(240) 중 적어도 하나를 포함할 수 있다. 프로세서(210), 메모리(215), 디스플레이(220), 카메라(225), 센서(230), 및 통신 회로(240)는 통신 버스(202)와 같은 전자 부품(electronical component)에 의해 서로 전기적으로 및/또는 작동적으로 연결될 수 있다(electronically and/or operably coupled with each other). 이하에서, 하드웨어들이 작동적으로 결합된 것은, 하드웨어들 중 제1 하드웨어에 의해 제2 하드웨어가 제어되도록, 하드웨어들 사이의 직접적인 연결, 또는 간접적인 연결이 유선으로, 또는 무선으로 수립된 것을 의미할 수 있다. 상이한 블록들에 기반하여 도시되었으나, 실시예가 이에 제한되는 것은 아니며, 도 2의 하드웨어들 중 일부분(예, 프로세서(210), 메모리(215), 및 통신 회로(240)의 적어도 일부분)이 SoC(system on a chip)와 같이 단일 집적 회로(single integrated circuit)에 포함될 수 있다. 웨어러블 장치(101)에 포함된 하드웨어의 타입 및/또는 개수는 도 2에 도시된 바에 제한되지 않는다. 예를 들어, 웨어러블 장치(101)는 도 2에 도시된 하드웨어 컴포넌트 중 일부만 포함할 수 있다.According to one embodiment, the wearable device (101) may include at least one of a processor (210), a memory (215), a display (220), a camera (225), a sensor (230), or a communication circuit (240). The processor (210), the memory (215), the display (220), the camera (225), the sensor (230), and the communication circuit (240) may be electronically and/or operably coupled with each other by an electronic component such as a communication bus (202). Hereinafter, operably coupled hardware may mean that a direct connection or an indirect connection is established between the hardwares, either wired or wireless, such that a second hardware is controlled by a first hardware among the hardwares. Although illustrated based on different blocks, the embodiment is not limited thereto, and some of the hardware of FIG. 2 (e.g., at least a portion of the processor (210), the memory (215), and the communication circuit (240)) may be included in a single integrated circuit, such as a system on a chip (SoC). The type and/or number of hardware included in the wearable device (101) is not limited to that illustrated in FIG. 2. For example, the wearable device (101) may include only some of the hardware components illustrated in FIG. 2.

일 실시예에서, 웨어러블 장치(101)의 프로세서(210)는, 하나 이상의 인스트럭션들에 기반하여 데이터를 처리하기 위한 하드웨어를 포함할 수 있다. 데이터를 처리하기 위한 상기 하드웨어는, 예를 들어, ALU(arithmetic and logic unit), FPU(floating point unit), FPGA(field programmable gate array), CPU(central processing unit), 및/또는 AP(application processor)를 포함할 수 있다. 프로세서(210)는, 싱글-코어 프로세서의 구조를 가지거나, 또는 듀얼 코어(dual core), 쿼드 코어(quad core), 헥사 코어(hexa core)와 같은 멀티-코어 프로세서의 구조를 가질 수 있다.In one embodiment, the processor (210) of the wearable device (101) may include hardware for processing data based on one or more instructions. The hardware for processing data may include, for example, an arithmetic and logic unit (ALU), a floating point unit (FPU), a field programmable gate array (FPGA), a central processing unit (CPU), and/or an application processor (AP). The processor (210) may have a structure of a single-core processor, or a structure of a multi-core processor such as a dual core, a quad core, or a hexa core.

일 실시예에서, 웨어러블 장치(101)의 메모리(215)는, 웨어러블 장치(101)의 프로세서(210)에 입력 및/또는 출력되는 데이터 및/또는 인스트럭션을 저장하기 위한 하드웨어 컴포넌트를 포함할 수 있다. 메모리(215)는, 예를 들어, RAM(random-access memory)과 같은 휘발성 메모리(volatile memory) 및/또는 ROM(read-only memory)과 같은 비휘발성 메모리(non-volatile memory)를 포함할 수 있다. 휘발성 메모리는, 예를 들어, DRAM(dynamic RAM), SRAM(static RAM), Cache RAM, PSRAM (pseudo SRAM) 중 적어도 하나를 포함할 수 있다. 비휘발성 메모리는, 예를 들어, PROM(programmable ROM), EPROM (erasable PROM), EEPROM (electrically erasable PROM), 플래시 메모리, 하드디스크, 컴팩트 디스크, SSD(solid state drive), eMMC(embedded multi media card) 중 적어도 하나를 포함할 수 있다.In one embodiment, the memory (215) of the wearable device (101) may include hardware components for storing data and/or instructions input and/or output to the processor (210) of the wearable device (101). The memory (215) may include, for example, volatile memory, such as random-access memory (RAM), and/or non-volatile memory, such as read-only memory (ROM). The volatile memory may include, for example, at least one of dynamic RAM (DRAM), static RAM (SRAM), Cache RAM, and pseudo SRAM (PSRAM). The non-volatile memory may include, for example, at least one of programmable ROM (PROM), erasable PROM (EPROM), electrically erasable PROM (EEPROM), flash memory, hard disk, compact disc, solid state drive (SSD), and embedded multi media card (eMMC).

일 실시예에서, 웨어러블 장치(101)의 디스플레이(220)는 사용자(예, 도 1a 내지 도 1b의 사용자(110))에게 시각화된 정보(예를 들어, 도 1a 내지 도 1b, 도 10a 내지 도 10b 내지 도 11a 내지 도 11b, 및/또는 도 13 내지 도 14의 화면)를 출력할 수 있다. 예를 들어, 디스플레이(220)는, GPU(graphic processing unit)와 같은 회로를 포함하는 프로세서(210)에 의해 제어되어, 사용자에게 시각화된 정보(visualized information)를 출력할 수 있다. 디스플레이(220)는 FPD(flat panel display) 및/또는 전자 종이(electronic paper)를 포함할 수 있다. 상기 FPD는 LCD(liquid crystal display), PDP(plasma display panel) 및/또는 하나 이상의 LED(light emitting diode)를 포함할 수 있다. 상기 LED는 OLED(organic LED)를 포함할 수 있다. 도 2의 디스플레이(220)는, 도 16a 내지 도 16b, 및/또는 도 17a 내지 도 17b를 참고하여 후술될, 적어도 하나의 디스플레이(1650, 1750)를 포함할 수 있다.In one embodiment, a display (220) of a wearable device (101) can output visualized information (e.g., the screens of FIGS. 1A-1B , 10A-10B-11A-11B , and/or 13-14 ) to a user (e.g., the user (110) of FIGS. 1A-1B ). For example, the display (220) can be controlled by a processor (210) including a circuit such as a graphic processing unit (GPU) to output visualized information to the user. The display (220) can include a flat panel display (FPD) and/or electronic paper. The FPD can include a liquid crystal display (LCD), a plasma display panel (PDP), and/or one or more light emitting diodes (LEDs). The LEDs can include organic LEDs (OLEDs). The display (220) of FIG. 2 may include at least one display (1650, 1750), which will be described later with reference to FIGS. 16a to 16b and/or FIGS. 17a to 17b.

일 실시예에서, 웨어러블 장치(101)의 카메라(225)는 빛의 색상 및/또는 밝기를 나타내는 전기 신호를 생성하는 하나 이상의 광 센서들(예, CCD(charged coupled device) 센서, CMOS(complementary metal oxide semiconductor) 센서)을 포함할 수 있다. 카메라(225)에 포함된 복수의 광 센서들은 2차원 격자(2 dimensional array)의 형태로 배치될 수 있다. 카메라(225)는 복수의 광 센서들 각각의 전기 신호들을 실질적으로 동시에 획득하여, 2차원 격자의 광 센서들에 도달한 빛에 대응하는 2차원 프레임 데이터를 생성할 수 있다. 예를 들어, 카메라(225)를 이용하여 캡쳐한 사진 데이터는 카메라(225)로부터 획득한 하나의(a) 2차원 프레임 데이터를 의미할 수 있다. 예를 들어, 카메라(225)를 이용하여 캡쳐한 비디오 데이터는, 프레임 율(frame rate)을 따라 카메라(225)로부터 획득된, 복수의 2차원 프레임 데이터의 시퀀스(sequence)를 의미할 수 있다. 카메라(225)는, 카메라(225)가 광을 수신하는 방향을 향하여 배치되고, 상기 방향을 향하여 광을 출력하기 위한 플래시 라이트를 더 포함할 수 있다.In one embodiment, the camera (225) of the wearable device (101) may include one or more optical sensors (e.g., a charged coupled device (CCD) sensor, a complementary metal oxide semiconductor (CMOS) sensor) that generate electrical signals representing the color and/or brightness of light. The plurality of optical sensors included in the camera (225) may be arranged in the form of a two-dimensional array. The camera (225) may acquire electrical signals of each of the plurality of optical sensors substantially simultaneously to generate two-dimensional frame data corresponding to light reaching the optical sensors of the two-dimensional array. For example, photographic data captured using the camera (225) may mean one (a) two-dimensional frame data acquired from the camera (225). For example, video data captured using the camera (225) may mean a sequence of a plurality of two-dimensional frame data acquired from the camera (225) according to a frame rate. The camera (225) may further include a flash light positioned toward the direction in which the camera (225) receives light and outputs light toward the direction.

일 실시예에 따른, 웨어러블 장치(101)의 센서(230)는, 웨어러블 장치(101)와 관련된 비-전기적 정보(non-electronic information)로부터, 웨어러블 장치(101)의 프로세서(210) 및/또는 메모리(215)에 의해 처리될 수 있는 전기적 정보를 생성할 수 있다. 상기 정보는, 센서 데이터로 지칭될 수 있다. 상기 센서(230)는, 웨어러블 장치(101)의 지리적 위치(geographic location)를 탐지하기 위한 GPS(global positioning system) 센서, 이미지 센서, 조도 센서 및/또는 ToF(time-of-flight) 센서, 웨어러블 장치(101)의 물리적인 모션을 탐지하기 위한 IMU(inertial measurement unit)를 포함할 수 있다. 일 실시예에서, IMU는, 가속도 센서, 자이로 센서 또는 중력 센서 중 적어도 하나를 포함할 수 있다. 상기 IMU를 이용하여, 웨어러블 장치(101)의 프로세서(210)는, 6 자유도(degree of freedom, DoF)에 기반하는 웨어러블 장치(101)의 모션을 식별할 수 있다. 6 자유도에 기반하는 웨어러블 장치(101)의 모션은, 서로 수직인 3 개의 축들(예, x 축, y 축, 및 z 축)에서의 웨어러블 장치(101)의 이동 및 회전(예, 롤(roll), 피치(pitch), 및 요(yaw))을 포함할 수 있다.According to one embodiment, a sensor (230) of a wearable device (101) may generate electrical information that may be processed by a processor (210) and/or a memory (215) of the wearable device (101) from non-electronic information related to the wearable device (101). The information may be referred to as sensor data. The sensor (230) may include a global positioning system (GPS) sensor, an image sensor, an ambient light sensor, and/or a time-of-flight (ToF) sensor for detecting a geographic location of the wearable device (101), and an inertial measurement unit (IMU) for detecting a physical motion of the wearable device (101). In one embodiment, the IMU may include at least one of an acceleration sensor, a gyro sensor, and a gravity sensor. Using the above IMU, the processor (210) of the wearable device (101) can identify the motion of the wearable device (101) based on six degrees of freedom (DoF). The motion of the wearable device (101) based on six degrees of freedom can include translation and rotation (e.g., roll, pitch, and yaw) of the wearable device (101) along three axes (e.g., x-axis, y-axis, and z-axis) that are perpendicular to each other.

일 실시예에서, 웨어러블 장치(101)의 통신 회로(240)는, 웨어러블 장치(101), 및 외부 전자 장치(예, 웨어러블 장치(101)에 연결된 리모트 컨트롤러) 사이의 전기 신호의 송신 및/또는 수신을 지원하기 위한 하드웨어 부품을 포함할 수 있다. 통신 회로(240)는, 예를 들어, 모뎀(MODEM), 안테나, O/E(optic/electronic) 변환기 중 적어도 하나를 포함할 수 있다. 통신 회로(240)는, 이더넷(ethernet), LAN(local area network), WAN(wide area network), WiFi(wireless fidelity), Bluetooth, BLE(bluetooth low energy), ZigBee, LTE(long term evolution), 5G NR(new radio) 및/또는 6G와 같은 다양한 타입의 프로토콜에 기반하여 전기 신호의 송신 및/또는 수신을 지원할 수 있다.In one embodiment, the communication circuit (240) of the wearable device (101) may include hardware components for supporting transmission and/or reception of electrical signals between the wearable device (101) and an external electronic device (e.g., a remote controller connected to the wearable device (101)). The communication circuit (240) may include, for example, at least one of a modem (MODEM), an antenna, and an optic/electronic (O/E) converter. The communication circuit (240) may support transmission and/or reception of electrical signals based on various types of protocols, such as Ethernet, a local area network (LAN), a wide area network (WAN), wireless fidelity (WiFi), Bluetooth, Bluetooth low energy (BLE), ZigBee, long term evolution (LTE), 5G NR (new radio), and/or 6G.

비록 도시되지 않았지만, 일 실시예에 따른, 웨어러블 장치(101)는 정보를 시각화한 형태 외에 다른 형태로 출력하기 위한 출력 수단을 포함할 수 있다. 예를 들어, 웨어러블 장치(101)는 음성 신호(acoustic signal)를 출력하기 위한 스피커를 포함할 수 있다. 예를 들어, 웨어러블 장치(101)는 진동에 기반하는 햅틱 피드백을 제공하기 위한 모터를 포함할 수 있다.Although not shown, according to one embodiment, the wearable device (101) may include output means for outputting information in a form other than a visualized form. For example, the wearable device (101) may include a speaker for outputting an acoustic signal. For example, the wearable device (101) may include a motor for providing haptic feedback based on vibration.

도 2를 참고하면, 일 실시예에 따른, 웨어러블 장치(101)의 메모리(215) 내에서, 웨어러블 장치(101)의 프로세서(210)가 데이터에 수행할 연산, 및/또는 동작을 나타내는 하나 이상의 인스트럭션들(또는 명령어들)이 저장될 수 있다. 하나 이상의 인스트럭션들의 집합은, 프로그램, 펌웨어, 운영 체제, 프로세스, 루틴, 서브-루틴 및/또는 어플리케이션으로 참조될 수 있다. 이하에서, 어플리케이션이 전자 장치(예, 웨어러블 장치(101)) 내에 설치되었다는 것은, 어플리케이션의 형태로 제공된 하나 이상의 인스트럭션들이 메모리(215) 내에 저장된 것으로써, 상기 하나 이상의 어플리케이션들이 전자 장치의 프로세서에 의해 실행 가능한(executable) 포맷(예, 웨어러블 장치(101)의 운영 체제에 의해 지정된 확장자를 가지는 파일)으로 저장된 것을 의미할 수 있다. 일 실시예에 따른, 웨어러블 장치(101)는 메모리(215)에 저장된 하나 이상의 인스트럭션들을 실행하여, 도 3a 내지 도 3b, 도 5 내지 도 7, 도 9, 도 12 및/또는 도 15의 동작을 수행할 수 있다.Referring to FIG. 2, according to one embodiment, one or more instructions (or commands) representing operations and/or actions to be performed on data by a processor (210) of the wearable device (101) may be stored in the memory (215) of the wearable device (101). A set of one or more instructions may be referred to as a program, firmware, an operating system, a process, a routine, a sub-routine, and/or an application. Hereinafter, when an application is installed in an electronic device (e.g., the wearable device (101)), it may mean that one or more instructions provided in the form of an application are stored in the memory (215), and that the one or more applications are stored in a format executable by the processor of the electronic device (e.g., a file having an extension specified by the operating system of the wearable device (101)). According to one embodiment, the wearable device (101) may execute one or more instructions stored in the memory (215) to perform the operations of FIGS. 3A to 3B, FIGS. 5 to 7, FIG. 9, FIG. 12, and/or FIG. 15.

도 2를 참고하면, 웨어러블 장치(101)에 설치된 프로그램들은, 타겟에 기반하여, 어플리케이션 계층(260), 프레임워크 계층(270) 및/또는 하드웨어 추상화 계층(hardware abstraction layer, HAL)(250)을 포함하는 상이한 계층들 중 어느 한 계층으로 분류될 수 있다. 예를 들어, 하드웨어 추상화 계층(250) 내에, 웨어러블 장치(101)의 하드웨어(예, 디스플레이(220), 카메라(225), 센서(230) 및/또는 통신 회로(240))를 타겟으로 설계된 프로그램들(예, 드라이버)이 분류될 수 있다. 예를 들어, 프레임워크 계층(270) 내에, 하드웨어 추상화 계층(250) 및/또는 어플리케이션 계층(260) 중 적어도 하나를 타겟으로 설계된 프로그램들(예, 시선 추적기(271), 제스쳐 추적기(272), 모션 추적기(273), 실제 광원 식별기(274), 가상 광원 생성기(275) 및/또는 가상 공간 매니저(276))이 분류될 수 있다. 프레임워크 계층(270)으로 분류되는 프로그램들은, 다른 프로그램에 기반하여 실행가능한 API(application programming interface)를 제공할 수 있다.Referring to FIG. 2, programs installed in the wearable device (101) may be classified into one of different layers, including an application layer (260), a framework layer (270), and/or a hardware abstraction layer (HAL) (250), based on a target. For example, programs (e.g., drivers) designed to target the hardware (e.g., display (220), camera (225), sensor (230), and/or communication circuit (240)) of the wearable device (101) may be classified within the hardware abstraction layer (250). For example, within the framework layer (270), programs designed to target at least one of the hardware abstraction layer (250) and/or the application layer (260) (e.g., an eye tracker (271), a gesture tracker (272), a motion tracker (273), a real light source identifier (274), a virtual light source generator (275), and/or a virtual space manager (276)) may be classified. The programs classified into the framework layer (270) may provide an executable API (application programming interface) based on other programs.

도 2를 참고하면, 어플리케이션 계층(260) 내에, 웨어러블 장치(101)를 제어하는 사용자(예, 도 1a 내지 도 1b의 사용자(110))를 타겟으로 설계된 프로그램이 분류될 수 있다. 예를 들어, 어플리케이션 계층(260)으로 분류되는 프로그램은, 비디오의 재생 및/또는 스트리밍을 위한 어플리케이션(261), 화상 회의를 위한 어플리케이션(262), 메모리(215)의 미디어 콘텐트(예, 이미지 및/또는 비디오)를 열람하기 위한 어플리케이션(263), 또는 호 연결을 위한 어플리케이션(264) 중 적어도 하나를 포함할 수 있다. 실시예가 이에 제한되는 것은 아니다. 예를 들어, 어플리케이션 계층(260)으로 분류되는 프로그램은, API를 호출하여, 프레임워크 계층(270)으로 분류되는 프로그램들에 의해 지원되는 기능의 실행을 야기할 수 있다.Referring to FIG. 2, a program designed to target a user (e.g., a user (110) of FIGS. 1A to 1B) controlling a wearable device (101) may be classified within the application layer (260). For example, a program classified within the application layer (260) may include at least one of an application (261) for playing and/or streaming a video, an application (262) for a video conference, an application (263) for viewing media content (e.g., images and/or videos) of a memory (215), or an application (264) for a call connection. The embodiment is not limited thereto. For example, a program classified within the application layer (260) may call an API to cause execution of a function supported by programs classified within the framework layer (270).

도 2를 참고하면, 일 실시예에 따른, 웨어러블 장치(101)는 프레임워크 계층(270) 내 시선 추적기(271)의 실행에 기반하여, 웨어러블 장치(101)를 착용한 사용자의 시선과 관련된 정보를 처리할 수 있다. 예를 들어, 웨어러블 장치(101)는, 사용자에 의해 착용된 상태에서, 상기 사용자의 눈을 향하여 배치된 제1 카메라로부터, 상기 사용자의 눈을 포함하는 이미지를 획득할 수 있다. 상기 이미지 내에 포함된 동공의 위치 및/또는 방향에 기반하여, 웨어러블 장치(101)는 사용자의 시선의 방향을 식별할 수 있다. Referring to FIG. 2, according to one embodiment, the wearable device (101) may process information related to the gaze of a user wearing the wearable device (101) based on the execution of the gaze tracker (271) in the framework layer (270). For example, the wearable device (101), when worn by the user, may obtain an image including the user's eye from a first camera positioned toward the user's eye. Based on the position and/or direction of the pupil included in the image, the wearable device (101) may identify the direction of the user's gaze.

도 2를 참고하면, 일 실시예에 따른, 웨어러블 장치(101)는 프레임워크 계층(270) 내 제스쳐 추적기(272)의 실행에 기반하여, 손을 포함하는 지정된 신체 부위의 모션을 식별할 수 있다. 예를 들어, 웨어러블 장치(101)는 제2 카메라로부터 상기 신체 부위를 포함하는 이미지 및/또는 비디오를 획득할 수 있다. 상기 이미지 및/또는 비디오에 의해 나타나는, 상기 지정된 신체 부위의 모션 및/또는 자세에 기반하여, 웨어러블 장치(101)는 상기 지정된 신체 부위에 의해 수행된 제스쳐를 식별할 수 있다. Referring to FIG. 2, according to one embodiment, the wearable device (101) can identify a motion of a designated body part including a hand based on the execution of a gesture tracker (272) within the framework layer (270). For example, the wearable device (101) can obtain an image and/or video including the body part from a second camera. Based on the motion and/or posture of the designated body part represented by the image and/or video, the wearable device (101) can identify a gesture performed by the designated body part.

도 2를 참고하면, 일 실시예에 따른, 웨어러블 장치(101)는 프레임워크 계층(270) 내 모션 추적기(273)의 실행에 기반하여, 웨어러블 장치(101)의 모션을 식별할 수 있다. 웨어러블 장치(101)가 사용자에 의해 착용된 상태 내에서, 웨어러블 장치(101)의 모션은, 상기 사용자의 머리의 모션과 관련될 수 있다. 예를 들어, 웨어러블 장치(101)는, 상기 머리의 방향과 실질적으로 일치하는, 웨어러블 장치(101)의 방향을 식별할 수 있다. 웨어러블 장치(101)는 IMU를 포함하는 센서(230)의 센서 데이터에 기반하여, 웨어러블 장치(101)의 모션을 식별할 수 있다. Referring to FIG. 2, according to one embodiment, the wearable device (101) can identify the motion of the wearable device (101) based on the execution of the motion tracker (273) within the framework layer (270). Within a state where the wearable device (101) is worn by a user, the motion of the wearable device (101) can be related to the motion of the user's head. For example, the wearable device (101) can identify the direction of the wearable device (101) that substantially coincides with the direction of the head. The wearable device (101) can identify the motion of the wearable device (101) based on sensor data of a sensor (230) including an IMU.

도 2를 참고하면, 일 실시예에 따른, 웨어러블 장치(101)는 프레임워크 계층(270) 내 실제 광원 식별기(274)의 실행에 기반하여, 웨어러블 장치(101)가 포함되거나, 또는 웨어러블 장치(101)에 인접한 외부 공간에 대한 정보를 획득할 수 있다. 예를 들어, 웨어러블 장치(101)는 카메라(225)를 이용하여, 웨어러블 장치(101)를 포함하는 외부 공간에 배치된 실제 광원(예, 도 1a 내지 도 1b의 플로어 램프(120))과 관련된 정보를 획득할 수 있다. 실시예가 이에 제한되는 것은 아니며, 웨어러블 장치(101)는 센서(230)(예, 조도 센서)를 이용하여, 상기 정보를 획득할 수 있다. 실제 광원 식별기(274)의 실행에 기반하여 획득된 상기 정보는, 적어도 하나의 실제 광원에 대한 위치(예, 외부 공간에서 실제 광원의 3 차원 위치), 밝기 및/또는 색상을 포함할 수 있다. 일 실시예에 따른, 웨어러블 장치(101)의 프로세서(210)는, 메모리(215)에, 실제 광원 식별기(274)의 실행에 기반하여 획득된 상기 정보를 저장할 수 있다. 일 실시예에 따른, 웨어러블 장치(101)는, 실제 광원 식별기(274)의 실행에 기반하여, 외부 공간에 포함된 적어도 하나의 실제 광원을 모니터링할 수 있다.Referring to FIG. 2, according to one embodiment, the wearable device (101) may obtain information about an external space in which the wearable device (101) is included or adjacent to the wearable device (101) based on the execution of the actual light source identifier (274) in the framework layer (270). For example, the wearable device (101) may obtain information related to an actual light source (e.g., a floor lamp (120) of FIGS. 1A and 1B) disposed in an external space including the wearable device (101) by using the camera (225). The embodiment is not limited thereto, and the wearable device (101) may obtain the information by using a sensor (230) (e.g., a light sensor). The information obtained based on the execution of the real light source identifier (274) may include a location (e.g., a three-dimensional location of the real light source in external space), brightness, and/or color of at least one real light source. In one embodiment, the processor (210) of the wearable device (101) may store the information obtained based on the execution of the real light source identifier (274) in the memory (215). In one embodiment, the wearable device (101) may monitor at least one real light source included in external space based on the execution of the real light source identifier (274).

도 2를 참고하면, 일 실시예에 따른, 웨어러블 장치(101)는 프레임워크 계층(270) 내 가상 광원 생성기(275)의 실행에 기반하여, 실제 광원 식별기(274)에 의해 획득된 상기 정보에 기반하여, 가상 공간(예, 도 1a의 가상 공간(140))에 적어도 하나의 가상 광원을 배치할 수 있다. 실시예가 이에 제한되는 것은 아니며, 웨어러블 장치(101)는 가상 공간에서의 밝기 분포에 기반하여, 적어도 하나의 가상 광원을 간접적으로 배치할 수 있다. 가상 광원 생성기(275)가 실행된 상태에서, 웨어러블 장치(101)는 실제 광원 식별기(274)에 의해 획득된 상기 정보에 기반하여 가상 공간에, 상기 정보에 의해 나타나는 실제 광원의 색상, 밝기를 가지는, 가상 광원을 배치할 수 있다. Referring to FIG. 2, according to one embodiment, the wearable device (101) may place at least one virtual light source in a virtual space (e.g., the virtual space (140) of FIG. 1A) based on the information acquired by the real light source identifier (274) based on the execution of the virtual light source generator (275) in the framework layer (270). The embodiment is not limited thereto, and the wearable device (101) may indirectly place at least one virtual light source based on the brightness distribution in the virtual space. In a state where the virtual light source generator (275) is executed, the wearable device (101) may place a virtual light source having a color and brightness of an real light source represented by the information in the virtual space based on the information acquired by the real light source identifier (274).

도 2를 참고하면, 일 실시예에 따른, 웨어러블 장치(101)는 프레임워크 계층(270) 내 가상 공간 매니저(276)의 실행에 기반하여, 가상 공간에 대한 렌더링을 수행할 수 있다. 가상 공간 매니저(276)가 실행된 상태에서, 웨어러블 장치(101)는 가상 광원 생성기(275)에 기반하여 배치된 적어도 하나의 가상 광원을 포함하는 가상 공간에 대한 렌더링을 수행할 수 있다. 일 실시예에서, 웨어러블 장치(101)는 가상 공간 매니저(276)에 기반하여, 외부 공간에 매핑된 가상 공간을 식별할 수 있다. 웨어러블 장치(101)는 센서(230)의 데이터에 기반하여 식별된, 외부 공간에서의 웨어러블 장치(101)의 위치 및/또는 방향에 기반하여, FoV(예, 도 1a 내지 도 1b의 FoV)를 형성하기 위한 가상 공간의 기준 위치(예, 도 1a의 위치(P2))를 결정할 수 있다. 상기 기준 위치는, 상기 가상 공간에서의 웨어러블 장치(101)의 위치에 대응할 수 있다. 일 실시예에서, 웨어러블 장치(101)는, 외부 공간의 인식, 및 상기 외부 공간 내에서의 웨어러블 장치(101)의 위치를 인식하기 위한, SLAM(simultaneous localization and mapping)을 수행할 수 있다.Referring to FIG. 2, according to one embodiment, the wearable device (101) may perform rendering for a virtual space based on the execution of the virtual space manager (276) in the framework layer (270). With the virtual space manager (276) executed, the wearable device (101) may perform rendering for a virtual space including at least one virtual light source arranged based on the virtual light source generator (275). In one embodiment, the wearable device (101) may identify a virtual space mapped to an external space based on the virtual space manager (276). The wearable device (101) may determine a reference position (e.g., position (P2) of FIG. 1A) of the virtual space for forming a FoV (e.g., FoV of FIGS. 1A to 1B) based on the position and/or direction of the wearable device (101) in the external space identified based on the data of the sensor (230). The above reference position may correspond to the position of the wearable device (101) in the virtual space. In one embodiment, the wearable device (101) may perform SLAM (simultaneous localization and mapping) to recognize external space and the position of the wearable device (101) within the external space.

상술한 바와 같이, 일 실시예에 따른, 웨어러블 장치(101)는 실제 광원 식별기(274)를 이용하여, 웨어러블 장치(101)가 포함된 외부 공간에서의 적어도 하나의 실제 광원을 식별할 수 있다. 웨어러블 장치(101)는 VST 모드(또는 AR 모드)에서, 실제 광원 식별기(274)에 기반하여 상기 적어도 하나의 실제 광원에 대한 정보를 획득할 수 있다. 일 실시예에 따른, 웨어러블 장치(101)는, VST 모드로부터 VR 모드로 전환하는 것에 기반하여, 상기 정보에 기반하여 가상 공간에 적어도 하나의 가상 광원을 배치하고, 상기 적어도 하나의 가상 광원을 이용하여 상기 가상 공간에 대한 렌더링을 수행할 수 있다. 일 실시예에 따른, 웨어러블 장치(101)는 상기 적어도 하나의 가상 광원에 기반하는 시각 효과를, 상기 가상 공간에 포함된 복수의 가상 객체들에게 선택적으로 적용할 수 있다. 예를 들어, 웨어러블 장치(101)는, 가상 광원이 가상 공간의 FoV에 포함되는 경우, 상기 FoV에 포함된 가상 객체의 위치에 따라, 상기 시각 효과를 적용하는 것을 제한할 수 있다. 예를 들어, 상기 FoV에 포함된 상기 가상 광원에 의해 상기 가상 객체에 대한 역광(counter light) 및/또는 상기 가상 광원에 의해 상기 가상 객체에서 야기된 그림자를 방지하기 위하여, 웨어러블 장치(101)는 상기 시각 효과를 적용하는 것을 제한할 수 있다. 웨어러블 장치(101)가 가상 객체에 대한 시각 효과를 적용할지 여부를, 가상 광원과 연동된 가상 공간 내 영역, 및/또는 상기 시각 효과가 적용될 가상 객체의 카테고리에 결정할 수 있다.As described above, according to one embodiment, the wearable device (101) can identify at least one real light source in an external space including the wearable device (101) by using the real light source identifier (274). The wearable device (101) can obtain information about the at least one real light source based on the real light source identifier (274) in a VST mode (or an AR mode). According to one embodiment, the wearable device (101) can place at least one virtual light source in a virtual space based on the information, and perform rendering on the virtual space by using the at least one virtual light source, based on switching from the VST mode to the VR mode. According to one embodiment, the wearable device (101) can selectively apply a visual effect based on the at least one virtual light source to a plurality of virtual objects included in the virtual space. For example, the wearable device (101) may restrict application of the visual effect depending on the position of the virtual object included in the FoV when the virtual light source is included in the FoV of the virtual space. For example, in order to prevent backlighting of the virtual object by the virtual light source included in the FoV and/or a shadow caused by the virtual light source on the virtual object, the wearable device (101) may restrict application of the visual effect. The wearable device (101) may determine whether to apply the visual effect to the virtual object, depending on the area in the virtual space linked with the virtual light source and/or the category of the virtual object to which the visual effect is to be applied.

이하에서는, 도 3a 내지 도 3b를 참고하여, 도 1a 내지 도 1b, 및/또는 도 2의 웨어러블 장치(101)의 동작이 설명된다.Hereinafter, the operation of the wearable device (101) of FIGS. 1A to 1B and/or FIG. 2 is described with reference to FIGS. 3A to 3B.

도 3a 내지 도 3b는, 일 실시예에 따른, 웨어러블 장치의 흐름도의 일 예를 도시한다. 도 1a 내지 도 1b, 및/또는 도 2의 웨어러블 장치(101)는 도 3a 내지 도 3b의 웨어러블 장치를 포함할 수 있다. 도 3a 내지 도 3b의 동작들 중 적어도 하나는, 도 2의 웨어러블 장치(101) 및/또는 프로세서(210)에 의해 수행될 수 있다.FIGS. 3A and 3B illustrate an example of a flow diagram of a wearable device according to one embodiment. The wearable device (101) of FIGS. 1A and 1B and/or 2 may include the wearable device of FIGS. 3A and 3B. At least one of the operations of FIGS. 3A and 3B may be performed by the wearable device (101) of FIG. 2 and/or the processor (210).

이하 실시예에서 각 동작들은 순차적으로 수행될 수도 있으나, 반드시 순차적으로 수행되는 것은 아니다. 예를 들어, 각 동작들의 순서가 변경될 수도 있으며, 적어도 두 동작들이 병렬적으로 수행될 수도 있다.In the following embodiments, the operations may be performed sequentially, but are not necessarily performed sequentially. For example, the order of the operations may be changed, and at least two operations may be performed in parallel.

도 3a를 참고하면, 동작(310)에서, 일 실시예에 따른, 웨어러블 장치는, 외부 공간에 포함된 적어도 하나의 실제 광원을 식별할 수 있다. 일 실시예에 따른, 웨어러블 장치는, 도 2의 실제 광원 식별기(274)의 실행에 기반하여, 적어도 하나의 실제 광원을 식별할 수 있다. 웨어러블 장치는 카메라(예, 도 2의 카메라(225))로부터 획득된 복수의 이미지들을 조합하여, 상기 복수의 이미지들에 공통적으로 캡쳐된(commonly captured) 실제 광원을 식별할 수 있다. 웨어러블 장치가 복수의 이미지들 전부에 포함된 실제 광원의 위치를 결정하거나 또는 식별하는 동작이, 도 4를 참고하여 설명된다.Referring to FIG. 3A, in operation (310), the wearable device according to one embodiment may identify at least one real light source included in an external space. According to one embodiment, the wearable device may identify at least one real light source based on the execution of the real light source identifier (274) of FIG. 2. The wearable device may combine multiple images acquired from a camera (e.g., the camera (225) of FIG. 2) to identify a real light source commonly captured in the multiple images. An operation of the wearable device determining or identifying a location of a real light source included in all of the multiple images is described with reference to FIG. 4.

도 3a를 참고하면, 동작(320)에서, 일 실시예에 따른, 웨어러블 장치는, 적어도 하나의 실제 광원에 대한 정보를 저장할 수 있다. 웨어러블 장치는 메모리(예, 도 2의 메모리(215))에, 상기 정보를 저장할 수 있다. 웨어러블 장치에 의해 저장되는 상기 정보는, 웨어러블 장치에 의해 식별된 실제 광원의 외부 공간 내 위치, 상기 실제 광원의 색상, 조도, 밝기 또는 세기(intensity) 중 적어도 하나를 포함할 수 있다. 동작(320)에 기반하여 웨어러블 장치에 저장된 상기 정보는, 가상 공간에서 실제 광원에 대응하는 가상 광원을 재구성하기 위한 하나 이상의 파라미터들을 포함할 수 있다. 동작(320)의 상기 정보는, 적어도 하나의 실제 광원에 대한 특성 정보(characteristic information)로 지칭될 수 있다.Referring to FIG. 3A, in operation (320), according to one embodiment, a wearable device may store information about at least one real light source. The wearable device may store the information in a memory (e.g., memory (215) of FIG. 2). The information stored by the wearable device may include at least one of a location of the real light source identified by the wearable device in an external space, a color, illuminance, brightness, or intensity of the real light source. The information stored in the wearable device based on operation (320) may include one or more parameters for reconstructing a virtual light source corresponding to the real light source in a virtual space. The information of operation (320) may be referred to as characteristic information about at least one real light source.

도 3a를 참고하면, 동작(330)에서, 일 실시예에 따른, 웨어러블 장치는, VR(virtual reality)을 위한 가상 공간을 표시하기 위한 이벤트를 식별할 수 있다. 상기 이벤트는, 어플리케이션을 실행하기 위한 입력(예, 도 1a 내지 도 1b의 가상 객체(181)의 선택을 나타내는 입력)에 의해 발생될 수 있다. 상기 이벤트는, 도 2의 시선 추적기(271), 제스쳐 추적기(272) 및/또는 모션 추적기(273)에 의해 식별된 지정된 제스쳐(예, 웨어러블 장치를 지정된 횟수만큼 두드리는(tapping) 제스쳐)에 의해 발생될 수 있다. 상기 이벤트는, 지정된 발언(예, "VR 모드로 전환하자")을 포함하는 보이스 커맨드의 식별에 기반하여 발생될 수 있다. 실시예가 이에 제한되는 것은 아니다.Referring to FIG. 3A, in operation (330), according to one embodiment, a wearable device may identify an event for displaying a virtual space for VR (virtual reality). The event may be generated by an input for executing an application (e.g., an input indicating selection of a virtual object (181) of FIGS. 1A and 1B). The event may be generated by a designated gesture (e.g., a gesture of tapping the wearable device a designated number of times) identified by the eye tracker (271), the gesture tracker (272), and/or the motion tracker (273) of FIG. 2. The event may be generated based on the identification of a voice command including a designated utterance (e.g., "Switch to VR mode"). The embodiment is not limited thereto.

도 3a를 참고하면, 동작(340)에서, 일 실시예에 따른, 웨어러블 장치는, 저장된 정보에 기반하여, 가상 공간에 적어도 하나의 가상 광원을 생성하고, 생성된 적어도 하나의 가상 광원에 기반하여, 가상 공간의 적어도 일부분에 대한 렌더링을 수행할 수 있다. 웨어러블 장치는 동작(330)의 이벤트를 식별하는 것에 응답하여, 동작(340)을 수행할 수 있다. 일 실시예에 따른, 웨어러블 장치는 동작(320)에 기반하여 저장된 정보에 기반하여, 적어도 하나의 실제 광원에 대응하는 적어도 하나의 가상 광원을 포함하는 가상 공간을 생성할 수 있다. 웨어러블 장치는 도 2의 가상 공간 매니저(276)의 실행에 기반하여, 동작(340)을 수행할 수 있다. 일 실시예에 따른, 웨어러블 장치는 상기 정보에 의해 나타나는 상기 적어도 하나의 실제 광원의 외부 공간에서의 위치에 기반하여, 가상 공간에서 적어도 하나의 가상 광원의 위치를 결정할 수 있다. 예를 들어, 상기 적어도 하나의 가상 광원은 월드 락(world-lock)에 기반하여, 가상 공간에서 고정된 좌표를 가질 수 있다.Referring to FIG. 3A, in operation (340), according to one embodiment, the wearable device may generate at least one virtual light source in a virtual space based on the stored information, and perform rendering on at least a portion of the virtual space based on the generated at least one virtual light source. In response to identifying the event of operation (330), the wearable device may perform operation (340). According to one embodiment, the wearable device may generate a virtual space including at least one virtual light source corresponding to at least one real light source based on the stored information based on operation (320). The wearable device may perform operation (340) based on execution of the virtual space manager (276) of FIG. 2. According to one embodiment, the wearable device may determine a location of at least one virtual light source in the virtual space based on a location of the at least one real light source in an external space indicated by the information. For example, the at least one virtual light source may have fixed coordinates in the virtual space based on world-lock.

일 실시예에 따른, 웨어러블 장치는 상기 정보에 기반하여 가상 공간에 배치된 적어도 하나의 가상 광원에 기반하여, 상기 가상 공간에 대한 렌더링을 수행할 수 있다. 상기 렌더링에 기반하여, 웨어러블 장치는 상기 적어도 하나의 가상 광원으로부터 방사된(emitted from) 가상의 광을 표현하는(representing) 화면(예, 도 1a의 화면(132))을 획득할 수 있다. 웨어러블 장치는 디스플레이(예, 도 2의 디스플레이(220))에 획득된 화면을 표시하여, 웨어러블 장치를 착용한 사용자에게 실제 광원에 대응하는 가상 광원을 포함하는 VR을 제공할 수 있다. 웨어러블 장치가 상기 가상의 광을 표현하는 화면을 획득하는 것은, 레이 트레이싱(ray tracing)과 같이, 상기 가상의 광의 경로를 추적하기 위한 알고리즘에 기반하여 수행될 수 있다.According to one embodiment, the wearable device can perform rendering of the virtual space based on at least one virtual light source arranged in the virtual space based on the information. Based on the rendering, the wearable device can obtain a screen (e.g., screen (132) of FIG. 1A) representing virtual light emitted from the at least one virtual light source. The wearable device can display the obtained screen on a display (e.g., display (220) of FIG. 2) to provide a VR including a virtual light source corresponding to an actual light source to a user wearing the wearable device. The wearable device can obtain the screen representing the virtual light based on an algorithm for tracing a path of the virtual light, such as ray tracing.

일 실시예에 따른, 웨어러블 장치는, 동작(320)에 기반하여 저장된, 적어도 하나의 실제 광원에 대한 정보를 이용하여 가상 공간의 조도를 조절할 수 있다. 예를 들어, 웨어러블 장치는 가상 광원(예, 동작(340)의 적어도 하나의 가상 광원)을 생성하지 않고, 적어도 하나의 실제 광원과 관련된 조도, 색상 및/또는 밝기를 가지는 가상 공간을 획득할 수 있다. 실제 광원에 대응하는 가상 광원을 포함하지 않는 가상 공간을 생성하는 일 실시예에서, 웨어러블 장치는 동작(320)의 정보를 이용하여, 실제 광원과 관련된 외부 공간의 모습(appearance)에 기반하는 상기 가상 공간을 획득할 수 있다. 상기 가상 공간에 기반하여, 웨어러블 장치는 상기 가상 광원과 독립적으로, 사용자에게 상기 외부 공간의 모습에 기반하는 가상 현실을 제공할 수 있다. 예를 들어, 웨어러블 장치는 동작(320)의 정보를 이용하여 가상 공간에 대한 렌더링을 수행하여, 실제 광원의 위치, 색상, 조도 및/또는 밝기에 기반하는 가상 공간을 획득할 수 있다. 일 실시예에서, 웨어러블 장치가 상기 가상 공간을 획득하는 것은, 동작(340)의 적어도 하나의 가상 광원과 독립적으로 수행될 수 있다.In one embodiment, the wearable device can adjust the illumination of the virtual space using information about at least one real light source stored based on the operation (320). For example, the wearable device can obtain a virtual space having an illumination, color, and/or brightness associated with at least one real light source without generating a virtual light source (e.g., at least one virtual light source of operation (340)). In one embodiment that generates a virtual space that does not include a virtual light source corresponding to a real light source, the wearable device can obtain the virtual space based on the appearance of an external space associated with the real light source using the information of operation (320). Based on the virtual space, the wearable device can provide a virtual reality based on the appearance of the external space to the user independently of the virtual light source. For example, the wearable device can perform rendering on the virtual space using the information of operation (320) to obtain the virtual space based on the location, color, illumination, and/or brightness of the real light source. In one embodiment, the wearable device's acquisition of the virtual space may be performed independently of at least one virtual light source of operation (340).