KR102809452B1 - Robot-friendly building, method and system for collaboration using multiple robots - Google Patents

Robot-friendly building, method and system for collaboration using multiple robots Download PDFInfo

- Publication number

- KR102809452B1 KR102809452B1 KR1020240018733A KR20240018733A KR102809452B1 KR 102809452 B1 KR102809452 B1 KR 102809452B1 KR 1020240018733 A KR1020240018733 A KR 1020240018733A KR 20240018733 A KR20240018733 A KR 20240018733A KR 102809452 B1 KR102809452 B1 KR 102809452B1

- Authority

- KR

- South Korea

- Prior art keywords

- robot

- task

- information

- building

- robots

- Prior art date

- Legal status (The legal status is an assumption and is not a legal conclusion. Google has not performed a legal analysis and makes no representation as to the accuracy of the status listed.)

- Active

Links

Images

Classifications

-

- B—PERFORMING OPERATIONS; TRANSPORTING

- B25—HAND TOOLS; PORTABLE POWER-DRIVEN TOOLS; MANIPULATORS

- B25J—MANIPULATORS; CHAMBERS PROVIDED WITH MANIPULATION DEVICES

- B25J9/00—Programme-controlled manipulators

- B25J9/16—Programme controls

- B25J9/1679—Programme controls characterised by the tasks executed

- B25J9/1682—Dual arm manipulator; Coordination of several manipulators

-

- B—PERFORMING OPERATIONS; TRANSPORTING

- B25—HAND TOOLS; PORTABLE POWER-DRIVEN TOOLS; MANIPULATORS

- B25J—MANIPULATORS; CHAMBERS PROVIDED WITH MANIPULATION DEVICES

- B25J11/00—Manipulators not otherwise provided for

- B25J11/0045—Manipulators used in the food industry

-

- B—PERFORMING OPERATIONS; TRANSPORTING

- B25—HAND TOOLS; PORTABLE POWER-DRIVEN TOOLS; MANIPULATORS

- B25J—MANIPULATORS; CHAMBERS PROVIDED WITH MANIPULATION DEVICES

- B25J11/00—Manipulators not otherwise provided for

- B25J11/008—Manipulators for service tasks

-

- B—PERFORMING OPERATIONS; TRANSPORTING

- B25—HAND TOOLS; PORTABLE POWER-DRIVEN TOOLS; MANIPULATORS

- B25J—MANIPULATORS; CHAMBERS PROVIDED WITH MANIPULATION DEVICES

- B25J13/00—Controls for manipulators

- B25J13/08—Controls for manipulators by means of sensing devices, e.g. viewing or touching devices

-

- B—PERFORMING OPERATIONS; TRANSPORTING

- B25—HAND TOOLS; PORTABLE POWER-DRIVEN TOOLS; MANIPULATORS

- B25J—MANIPULATORS; CHAMBERS PROVIDED WITH MANIPULATION DEVICES

- B25J19/00—Accessories fitted to manipulators, e.g. for monitoring, for viewing; Safety devices combined with or specially adapted for use in connection with manipulators

- B25J19/02—Sensing devices

- B25J19/021—Optical sensing devices

- B25J19/023—Optical sensing devices including video camera means

-

- B—PERFORMING OPERATIONS; TRANSPORTING

- B25—HAND TOOLS; PORTABLE POWER-DRIVEN TOOLS; MANIPULATORS

- B25J—MANIPULATORS; CHAMBERS PROVIDED WITH MANIPULATION DEVICES

- B25J5/00—Manipulators mounted on wheels or on carriages

-

- B—PERFORMING OPERATIONS; TRANSPORTING

- B25—HAND TOOLS; PORTABLE POWER-DRIVEN TOOLS; MANIPULATORS

- B25J—MANIPULATORS; CHAMBERS PROVIDED WITH MANIPULATION DEVICES

- B25J5/00—Manipulators mounted on wheels or on carriages

- B25J5/007—Manipulators mounted on wheels or on carriages mounted on wheels

-

- B—PERFORMING OPERATIONS; TRANSPORTING

- B25—HAND TOOLS; PORTABLE POWER-DRIVEN TOOLS; MANIPULATORS

- B25J—MANIPULATORS; CHAMBERS PROVIDED WITH MANIPULATION DEVICES

- B25J9/00—Programme-controlled manipulators

- B25J9/16—Programme controls

-

- B—PERFORMING OPERATIONS; TRANSPORTING

- B25—HAND TOOLS; PORTABLE POWER-DRIVEN TOOLS; MANIPULATORS

- B25J—MANIPULATORS; CHAMBERS PROVIDED WITH MANIPULATION DEVICES

- B25J9/00—Programme-controlled manipulators

- B25J9/16—Programme controls

- B25J9/1656—Programme controls characterised by programming, planning systems for manipulators

- B25J9/1661—Programme controls characterised by programming, planning systems for manipulators characterised by task planning, object-oriented languages

-

- B—PERFORMING OPERATIONS; TRANSPORTING

- B25—HAND TOOLS; PORTABLE POWER-DRIVEN TOOLS; MANIPULATORS

- B25J—MANIPULATORS; CHAMBERS PROVIDED WITH MANIPULATION DEVICES

- B25J9/00—Programme-controlled manipulators

- B25J9/16—Programme controls

- B25J9/1656—Programme controls characterised by programming, planning systems for manipulators

- B25J9/1664—Programme controls characterised by programming, planning systems for manipulators characterised by motion, path, trajectory planning

-

- B—PERFORMING OPERATIONS; TRANSPORTING

- B25—HAND TOOLS; PORTABLE POWER-DRIVEN TOOLS; MANIPULATORS

- B25J—MANIPULATORS; CHAMBERS PROVIDED WITH MANIPULATION DEVICES

- B25J9/00—Programme-controlled manipulators

- B25J9/16—Programme controls

- B25J9/1656—Programme controls characterised by programming, planning systems for manipulators

- B25J9/1669—Programme controls characterised by programming, planning systems for manipulators characterised by special application, e.g. multi-arm co-operation, assembly, grasping

-

- G—PHYSICS

- G05—CONTROLLING; REGULATING

- G05D—SYSTEMS FOR CONTROLLING OR REGULATING NON-ELECTRIC VARIABLES

- G05D1/00—Control of position, course, altitude or attitude of land, water, air or space vehicles, e.g. using automatic pilots

-

- G—PHYSICS

- G05—CONTROLLING; REGULATING

- G05D—SYSTEMS FOR CONTROLLING OR REGULATING NON-ELECTRIC VARIABLES

- G05D1/00—Control of position, course, altitude or attitude of land, water, air or space vehicles, e.g. using automatic pilots

- G05D1/02—Control of position or course in two dimensions

-

- G—PHYSICS

- G05—CONTROLLING; REGULATING

- G05D—SYSTEMS FOR CONTROLLING OR REGULATING NON-ELECTRIC VARIABLES

- G05D1/00—Control of position, course, altitude or attitude of land, water, air or space vehicles, e.g. using automatic pilots

- G05D1/20—Control system inputs

- G05D1/24—Arrangements for determining position or orientation

- G05D1/244—Arrangements for determining position or orientation using passive navigation aids external to the vehicle, e.g. markers, reflectors or magnetic means

-

- G—PHYSICS

- G05—CONTROLLING; REGULATING

- G05D—SYSTEMS FOR CONTROLLING OR REGULATING NON-ELECTRIC VARIABLES

- G05D1/00—Control of position, course, altitude or attitude of land, water, air or space vehicles, e.g. using automatic pilots

- G05D1/60—Intended control result

- G05D1/69—Coordinated control of the position or course of two or more vehicles

- G05D1/692—Coordinated control of the position or course of two or more vehicles involving a plurality of disparate vehicles

Landscapes

- Engineering & Computer Science (AREA)

- Mechanical Engineering (AREA)

- Robotics (AREA)

- Remote Sensing (AREA)

- Physics & Mathematics (AREA)

- General Physics & Mathematics (AREA)

- Automation & Control Theory (AREA)

- Radar, Positioning & Navigation (AREA)

- Aviation & Aerospace Engineering (AREA)

- Human Computer Interaction (AREA)

- Life Sciences & Earth Sciences (AREA)

- Food Science & Technology (AREA)

- Manipulator (AREA)

- Multimedia (AREA)

Abstract

본 발명에 따른 복수의 로봇들을 이용한 협업 방법은, 제1 기능을 수행하는 제1 로봇에 대해 특정 임무가 할당되고, 상기 제1 로봇에서 상기 특정 임무와 연관된 제1 작업이 수행되는 단계, 상기 제1 로봇에서, 상기 제1 로봇 주변에 위치한, 상기 제1 기능과 다른 제2 기능을 수행하는 제2 로봇을 센싱하는 단계, 상기 제1 로봇에서 상기 제2 로봇이 센싱되는 것에 근거하여, 상기 제2 로봇이, 상기 제1 로봇과 상기 특정 임무에 대하여 협업을 수행할 협업 대상 로봇으로서 특정되는 단계, 상기 제1 로봇 및 상기 제2 로봇 간의 데이터 통신에 근거하여, 상기 제1 로봇 및 상기 제2 로봇들에 의해서, 상기 특정 임무와 관련된 제2 작업이 수행되는 단계 및 상기 제2 작업이 완료되는 것에 근거하여, 상기 제2 로봇에서 상기 특정 임무와 관련된 제3 작업이 수행될 수 있다. A collaboration method using a plurality of robots according to the present invention comprises the steps of: assigning a specific task to a first robot performing a first function, and performing a first task related to the specific task in the first robot; sensing, in the first robot, a second robot located around the first robot and performing a second function different from the first function; specifying, based on the sensing of the second robot by the first robot, the second robot as a collaboration target robot that will collaborate with the first robot on the specific task; performing, based on data communication between the first robot and the second robot, a second task related to the specific task by the first robot and the second robot; and performing, based on the completion of the second task, a third task related to the specific task in the second robot.

Description

본 발명은 로봇 간 협업을 위한 방법 및 시스템에 관한 것이다. 보다 구체적으로 본 발명은 오프라인 상황에서도 로봇 간 협업 임무가 가능하도록 로봇 간 통신을 수행하는 방법에 관한 것이다. The present invention relates to a method and system for collaboration between robots. More specifically, the present invention relates to a method for performing communication between robots so as to enable collaborative tasks between robots even in an offline situation.

나아가, 본 발명은 로봇 친화형 건물에 적용될 수 있는 로봇 간 협업 임무를 위한 방법 및 시스템에 관한 것이다Furthermore, the present invention relates to a method and system for robot-to-robot collaborative tasks applicable to robot-friendly buildings.

기술이 발전함에 따라, 다양한 서비스 디바이스들이 나타나고 있으며, 특히 최근에는 다양한 작업 또는 서비스를 수행하는 로봇에 대한 기술 개발이 활발하게 이루어지고 있다.As technology advances, various service devices are appearing, and in particular, technology development for robots that perform various tasks or services is actively underway recently.

나아가 최근에는, 인공 지능 기술, 클라우드 기술 등이 발전함에 따라, 로봇을 보다 정밀하고, 안전하게 제어하는 것이 가능해지고 있으며, 이에 따라 로봇의 활용도가 점차적으로 높아지고 있다. 특히, 기술의 발전으로 인하여, 로봇은 실내 공간에서 인간과 안전하게 공존할 수 있을 정도의 수준에 이르렀다.Furthermore, with the recent development of artificial intelligence technology, cloud technology, etc., it is becoming possible to control robots more precisely and safely, and accordingly, the utilization of robots is gradually increasing. In particular, due to the development of technology, robots have reached a level where they can safely coexist with humans in indoor spaces.

이에, 최근에는 로봇이 인간의 업무 또는 작업을 대체하고 있으며, 특히 실내 공간에서 사람을 대상으로 로봇이 직접 서비스를 제공하는 다양한 방법들이 활발하게 연구되고 있다. Accordingly, robots are recently replacing human work or tasks, and various methods for robots to directly provide services to people, especially in indoor spaces, are being actively studied.

예를 들어, 공항, 역사, 백화점 등 공공 장소에서는 로봇들이 길안내 서비스를 제공하고 있으며, 음식점에서는 로봇들이 서빙 서비스를 제공하고 있다. 나아가, 오피스 공간, 공동 주거 공간 등에서는 로봇들이 우편물, 택배 등을 배송하는 배송 서비스를 제공하고 있다. 이 밖에도 로봇들은 청소 서비스, 방범 서비스, 물류 처리 서비스 등 다양한 서비스들을 제공하고 있으며, 로봇이 제공하는 서비스의 종류 및 범위는 앞으로도 기하급수적으로 늘어날 것이며, 서비스 제공 수준 또한 계속적으로 발전할 것으로 기대된다.For example, in public places such as airports, stations, and department stores, robots provide guidance services, and in restaurants, robots provide serving services. Furthermore, in office spaces and shared living spaces, robots provide delivery services, delivering mail and packages. In addition, robots provide various services such as cleaning services, security services, and logistics processing services, and the types and scope of services provided by robots are expected to increase exponentially in the future, and the level of service provision is also expected to continue to develop.

이러한, 로봇들은 실외 공간 뿐만 아니라, 사무실, 아파트, 백화점, 학교, 병원, 놀이시설 등과 같은 건물(또는 빌딩(building))의 실내 공간 내에서 다양한 서비스를 제공하고 있으며, 이 경우, 로봇들은 건물의 실내 공간을 이동하며 다양한 서비스들을 제공하도록 제어되고 있다.These robots provide various services not only in outdoor spaces but also in indoor spaces of buildings (or premises) such as offices, apartments, department stores, schools, hospitals, and amusement facilities. In this case, the robots are controlled to move around the indoor spaces of the buildings and provide various services.

한편, 로봇들이 실내 공간에서 양한 서비스를 제공하거나, 생활하기 위해서는 로봇들은, 협업을 수행하여야 하며, 경우에 따라 네트워크가 부재하는 오프라인 상황에서도 로봇간 협업을 수행해야 하는 니즈가 존재한다. Meanwhile, in order for robots to provide various services or live in indoor spaces, they must collaborate, and in some cases, there is a need for robots to collaborate with each other even in offline situations where there is no network.

이에, 건물 내에서 로봇을 이용한 보다 수준 높은 서비스를 제공하기 위해서는 네트워크가 존재하는 상황에서의 로봇 제어 기술에 대한 연구 뿐만 아니라, 오프라인 상황에서도 로봇간 협업을 통해 서비스를 제공할 수 있는 방법에 대해서 본질적인 연구가 필요하다.Accordingly, in order to provide higher-level services using robots in buildings, not only research on robot control technology in situations where a network exists, but also fundamental research on methods for providing services through collaboration between robots even in offline situations is necessary.

본 발명에 따른 로봇 협업 방법 및 시스템은 오프라인 상황에서도 로봇간 협업이 가능한 프로세스를 제공하기 위한 것이다. The robot collaboration method and system according to the present invention are intended to provide a process that enables collaboration between robots even in offline situations.

보다 구체적으로, 본 발명에 따른 로봇 협업 방법 및 시스템은 시각적 수단을 이용하여 로봇간 통신을 수행함으로써, 네트워크 부재 상황에서도 로봇간 협업이 가능한 프로세스를 제공하기 위한 것이다. More specifically, the robot collaboration method and system according to the present invention provides a process in which robot collaboration is possible even in the absence of a network by performing robot-to-robot communication using visual means.

나아가, 본 발명은 로봇과 사람이 함께 공존하며, 사람에게 유용한 서비스를 제공하는 로봇 친화형 건물을 제공하기 위한 것이다.Furthermore, the present invention provides a robot-friendly building in which robots and people coexist and provide useful services to people.

나아가, 본 발명에 따른 로봇 친화형 건물은, 로봇이 이용 가능한 로봇 친화형의 다양한 설비 인프라를 제공함으로써, 로봇이 제공할 수 있는 서비스의 종류 및 범위를 확장할 수 있다.Furthermore, the robot-friendly building according to the present invention can expand the types and scope of services that robots can provide by providing various robot-friendly facility infrastructures that can be used by robots.

나아가, 본 발명에 따른 로봇 친화형 건물은 다수의 로봇과 연동하는 클라우드 시스템을 이용하여, 다수의 로봇 및 설비 인프라를 유기적으로 제어함으로써, 보다 체계적으로 서비스를 제공하는 로봇의 주행을 관리할 수 있다. 이를 통해, 본 발명에 따른 로봇 친화형 건물은, 보다 안전하고, 신속하게, 그리고 정확하게 사람들에게 다양한 서비스를 제공할 수 있다.Furthermore, the robot-friendly building according to the present invention can manage the operation of robots that provide services more systematically by organically controlling a plurality of robots and facility infrastructure using a cloud system that is linked to a plurality of robots. Through this, the robot-friendly building according to the present invention can provide various services to people more safely, quickly, and accurately.

나아가, 본 발명에 따른 건물에 적용된 로봇은 클라우드 서버에 의해 제어되는 브레인리스(brainless) 형식으로 구현될 수 있으며, 이에 의하면, 건물에 배치되는 다수의 로봇을 값비싼 센서 없이 저렴하게 제조할 수 있을 뿐만 아니라, 고성능/고정밀로 제어할 수 있다.Furthermore, the robot applied to the building according to the present invention can be implemented in a brainless format controlled by a cloud server, and according to this, not only can a large number of robots placed in the building be manufactured inexpensively without expensive sensors, but they can also be controlled with high performance/high precision.

본 발명에 따른 복수의 로봇들을 이용한 협업 방법은, 제1 기능을 수행하는 제1 로봇에 대해 특정 임무가 할당되고, 상기 제1 로봇에서 상기 특정 임무와 연관된 제1 작업이 수행되는 단계, 상기 제1 로봇에서, 상기 제1 로봇 주변에 위치한, 상기 제1 기능과 다른 제2 기능을 수행하는 제2 로봇을 센싱하는 단계, 상기 제1 로봇에서 상기 제2 로봇이 센싱되는 것에 근거하여, 상기 제2 로봇이, 상기 제1 로봇과 상기 특정 임무에 대하여 협업을 수행할 협업 대상 로봇으로서 특정되는 단계, 상기 제1 로봇 및 상기 제2 로봇 간의 데이터 통신에 근거하여, 상기 제1 로봇 및 상기 제2 로봇들에 의해서, 상기 특정 임무와 관련된 제2 작업이 수행되는 단계 및 상기 제2 작업이 완료되는 것에 근거하여, 상기 제2 로봇에서 상기 특정 임무와 관련된 제3 작업이 수행될 수 있다. A collaboration method using a plurality of robots according to the present invention comprises the steps of: assigning a specific task to a first robot performing a first function, and performing a first task related to the specific task in the first robot; sensing, in the first robot, a second robot located around the first robot and performing a second function different from the first function; specifying, based on the sensing of the second robot by the first robot, the second robot as a collaboration target robot that will collaborate with the first robot on the specific task; performing, based on data communication between the first robot and the second robot, a second task related to the specific task by the first robot and the second robot; and performing, based on the completion of the second task, a third task related to the specific task in the second robot.

나아가, 본 발명에 따른, 공간을 주행하는 서비스 로봇은, 디스플레이부, 주행부, 및 상기 서비스 로봇의 동작 상태에 근거하여, 상기 디스플레이부에 출력되는 정보를 제어하는 제어부를 포함하고, 상기 제어부는, 상기 서비스 로봇에서, 상기 공간에 배치된 특정 로봇과 특정 임무와 관련된 협업이 진행되는 것에 근거하여, 상기 디스플레이부에 출력되는 정보를 제어하고, 상기 디스플레이부에는, 상기 특정 로봇에서 상기 서비스 로봇을 식별 가능하도록 하는 제1 마커 및 상기 서비스 로봇의 현재 동작 상태를 식별 가능하도록 하는 제2 마커가 출력될 수 있다. Furthermore, a service robot according to the present invention that navigates a space includes a display unit, a navigation unit, and a control unit that controls information output to the display unit based on an operating state of the service robot, wherein the control unit controls information output to the display unit based on collaboration between a specific robot arranged in the space and a specific task-related task, and the display unit may output a first marker that enables identification of the service robot from the specific robot, and a second marker that enables identification of the current operating state of the service robot.

나아가, 본 발명에 따른 로봇은, 협업을 수행하는 특정 로봇에 출력되는 마커를 인식하는 카메라부, 상기 특정 로봇의 동작을 제어하기 위한 제어신호를 출력하는 출력부 및 상기 카메라부 및 상기 출력부를 제어하는 제어부를 포함하고, 상기 제어부는, 상기 협업에 대응되는 특정 임무의 진행 상태에 따라 상기 특정 로봇에서 특정 동작이 이루어지도록, 상기 출력부에 대한 제어를 통해, 상기 특정 동작에 대응되는 제어 신호를 출력할 수 있다. Furthermore, a robot according to the present invention includes a camera unit that recognizes a marker output to a specific robot performing collaboration, an output unit that outputs a control signal for controlling the operation of the specific robot, and a control unit that controls the camera unit and the output unit, wherein the control unit can output a control signal corresponding to the specific operation through control of the output unit so that a specific operation is performed in the specific robot according to the progress status of a specific task corresponding to the collaboration.

나아가, 본 발명에 따른 클라우드 서버와 통신하는 제1 로봇 및 제2 로봇이 위치하는 건물은, 상기 제1 로봇 및 상기 제2 로봇이 위치하는 공간을 포함하고, 상기 제1 로봇 및 상기 제2 로봇은, 상기 클라우드 서버로부터 수신되는 제어명령에 근거하여, 제1 기능을 수행하는 상기 제1 로봇에 대해 특정 임무가 할당되고, 상기 제1 로봇에서 상기 특정 임무와 연관된 제1 작업이 수행되는 단계, 상기 제1 로봇에서, 상기 제1 로봇 주변에 위치한, 상기 제1 기능과 다른 제2 기능을 수행하는 제2 로봇을 센싱하는 단계, 상기 제1 로봇에서 상기 제2 로봇이 센싱되는 것에 근거하여, 상기 제2 로봇이, 상기 제1 로봇과 상기 특정 임무에 대하여 협업을 수행할 협업 대상 로봇으로서 특정되는 단계, 상기 제1 로봇 및 상기 제2 로봇 간의 데이터 통신에 근거하여, 상기 제1 로봇 및 상기 제2 로봇들에 의해서, 상기 특정 임무와 관련된 제2 작업이 수행되는 단계 및 상기 제2 작업이 완료되는 것에 근거하여, 상기 제2 로봇에서 상기 특정 임무와 관련된 제3 작업이 수행되는 단계를 통해, 상기 건물에서 상기 특정 임무를 수행하고, 상기 클라우드 서버에는, 상기 제1 로봇 및 상기 제2 로봇 중 적어도 하나로부터 수신되는 작업 이력 정보에 근거하여, 상기 특정 임무에 대한 작업 입력이 업데이트될 수 있다. Furthermore, a building in which a first robot and a second robot communicating with a cloud server according to the present invention are located includes a space in which the first robot and the second robot are located, and the first robot and the second robot are configured to perform a first task associated with the specific task by assigning a specific task to the first robot performing a first function based on a control command received from the cloud server, a step of sensing, in the first robot, a second robot located around the first robot and performing a second function different from the first function, a step of specifying, based on the first robot sensing the second robot, the second robot as a collaboration target robot to collaborate with the first robot on the specific task, a step of performing a second task associated with the specific task by the first robot and the second robot based on data communication between the first robot and the second robot, and a step of performing a third task associated with the specific task by the second robot based on the completion of the second task, thereby performing the specific task in the building. In the cloud server, the task input for the specific task can be updated based on the task history information received from at least one of the first robot and the second robot.

나아가, 본 발명에 따른 제1 로봇 및 제2 로봇 간에 협업이 이루어지는 로봇 협업 시스템은, 제1 기능을 수행하는 제1 로봇에 대해 특정 임무가 할당되고, 상기 제1 로봇에서 상기 특정 임무와 연관된 제1 작업을 수행하고, 상기 제1 로봇에서, 상기 제1 로봇 주변에 위치한, 상기 제1 기능과 다른 제2 기능을 수행하는 제2 로봇을 센싱하며, 상기 제1 로봇에서 상기 제2 로봇이 센싱되는 것에 근거하여, 상기 제2 로봇을, 상기 제1 로봇과 상기 특정 임무에 대하여 협업을 수행할 협업 대상 로봇으로서 특정하고, 상기 제1 로봇 및 상기 제2 로봇 간의 데이터 통신에 근거하여, 상기 제1 로봇 및 상기 제2 로봇들에 의해서, 상기 특정 임무와 관련된 제2 작업이 수행되고, 상기 제2 작업이 완료되는 것에 근거하여, 상기 제2 로봇에서 상기 특정 임무와 관련된 제3 작업을 수행하는 것을 통해, 상기 특정 임무에 대한 협업이 이루어질 수 있다. Furthermore, a robot collaboration system in which collaboration is achieved between a first robot and a second robot according to the present invention includes: a specific task is assigned to a first robot performing a first function; the first robot performs a first task associated with the specific task; the first robot senses a second robot located around the first robot and performing a second function different from the first function; and, based on the sensing of the second robot by the first robot, the second robot is specified as a collaboration target robot that collaborates with the first robot for the specific task; and, based on data communication between the first robot and the second robot, a second task associated with the specific task is performed by the first robot and the second robot; and, based on the completion of the second task, the second robot performs a third task associated with the specific task, thereby enabling collaboration for the specific task.

본 발명에 따른 복수의 로봇들을 이용한 협업 방법 및 시스템은, 제1 로봇 및 제2 로봇 각각에 구비된 출력부 및 센싱부 간의 데이터 통신에 근거하여, 제1 로봇 및 제2 로봇들에 의해서, 특정 임무와 관련된 협업을 수행함으로써 네트워크가 부재하거나 네트워크 장애가 발생되는 상황에서도, 협업 업무를 수행할 수 있다. 따라서, 본 발명에 따른 로봇들이 포함된 건물에서는 네트워크가 존재하지 않는 환경에서도 로봇을 복수의 로봇 간 협업 업무를 통해 다양한 서비스를 제공할 수 있어, 사용자 편의성을 더욱 향상시킬 수 있다.The collaborative method and system using a plurality of robots according to the present invention can perform collaborative work even in a situation where a network is absent or a network failure occurs by performing collaboration related to a specific task by the first robot and the second robots based on data communication between the output units and sensing units provided in each of the first robot and the second robot. Therefore, in a building including robots according to the present invention, even in an environment where a network does not exist, the robots can provide various services through collaborative work among a plurality of robots, thereby further improving user convenience.

나아가, 본 발명에 따른 로봇 친화형 건물은 로봇, 자율주행, AI, 클라우드 기술이 융합되고, 연결되는 테크 컨버전스(Technological Convergence)를 이용하며, 이러한 기술과, 로봇 그리고 건물내 구비되는 설비 인프라가 유기적으로 결합되는 새로운 공간을 제공할 수 있다.Furthermore, the robot-friendly building according to the present invention utilizes technological convergence in which robots, autonomous driving, AI, and cloud technologies are integrated and connected, and can provide a new space in which these technologies, robots, and facility infrastructure provided within the building are organically combined.

나아가, 본 발명에 따른 로봇 친화형 건물은 다수의 로봇과 연동하는 클라우드 서버를 이용하여, 다수의 로봇 및 설비 인프라를 유기적으로 제어함으로써, 보다 체계적으로 서비스를 제공하는 로봇의 주행을 체계적으로 관리할 수 있다. 이를 통해, 본 발명에 따른 로봇 친화형 건물은, 보다 안전하고, 신속하게, 그리고 정확하게 사람들에게 다양한 서비스를 제공할 수 있다.Furthermore, the robot-friendly building according to the present invention can systematically manage the operation of robots that provide services more systematically by organically controlling a plurality of robots and facility infrastructure using a cloud server that is linked to a plurality of robots. Through this, the robot-friendly building according to the present invention can provide various services to people more safely, quickly, and accurately.

나아가, 본 발명에 따른 건물에 적용된 로봇은 클라우드 서버에 의해 제어되는 브레인리스(brainless) 형식으로 구현될 수 있으며, 이에 의하면, 건물에 배치되는 다수의 로봇을 값비싼 센서 없이 저렴하게 제조할 수 있을 뿐만 아니라, 고성능/고정밀로 제어할 수 있다.Furthermore, the robot applied to the building according to the present invention can be implemented in a brainless format controlled by a cloud server, and according to this, not only can a large number of robots placed in the building be manufactured inexpensively without expensive sensors, but they can also be controlled with high performance/high precision.

나아가, 본 발명에 따른 건물에서는 건물에 배치된 다수의 로봇에 할당된 임무와 이동 상황을 고려함은 물론, 사람을 배려하도록 주행이 제어됨으로써, 같은 공간 속에서 자연스럽게 로봇과 사람이 공존할 수 있다.Furthermore, in a building according to the present invention, the driving is controlled to take into consideration the tasks and movement situations assigned to a number of robots placed in the building, as well as to take people into consideration, so that robots and people can coexist naturally in the same space.

나아가, 본 발명에 따른 건물에서는 로봇에 의한 사고 방지 및 예기치 못한 상황에 대응할 수 있도록 다양한 제어를 수행함으로써, 사람들에게 로봇이 위험한 것이 아닌, 친근하고 안전하다는 인식을 심어줄 수 있다.Furthermore, in a building according to the present invention, by performing various controls to prevent accidents caused by robots and to respond to unexpected situations, it is possible to instill in people the perception that robots are friendly and safe, rather than dangerous.

도 1, 도 2 및 도 3은 본 발명에 따른 로봇 친화형 건물을 설명하기 위한 개념도들이다.

도 4, 도 5 및 도 6은 본 발명에 따른 로봇 친화형 건물을 주행하는 로봇 및 로봇 친화형 건물에 구비된 다양한 설비를 제어하는 시스템을 설명하기 위한 개념도들이다.

도 7 및 도 8은 본 발명에 따른 로봇 친화형 건물에 구비된 설비 인프라를 설명하기 위한 개념도들이다.

도 9 내지 도 11은 본 발명에 따른 로봇 친화형 건물을 주행하는 로봇의 위치를 추정하는 방법을 설명하기 위한 개념도들이다.

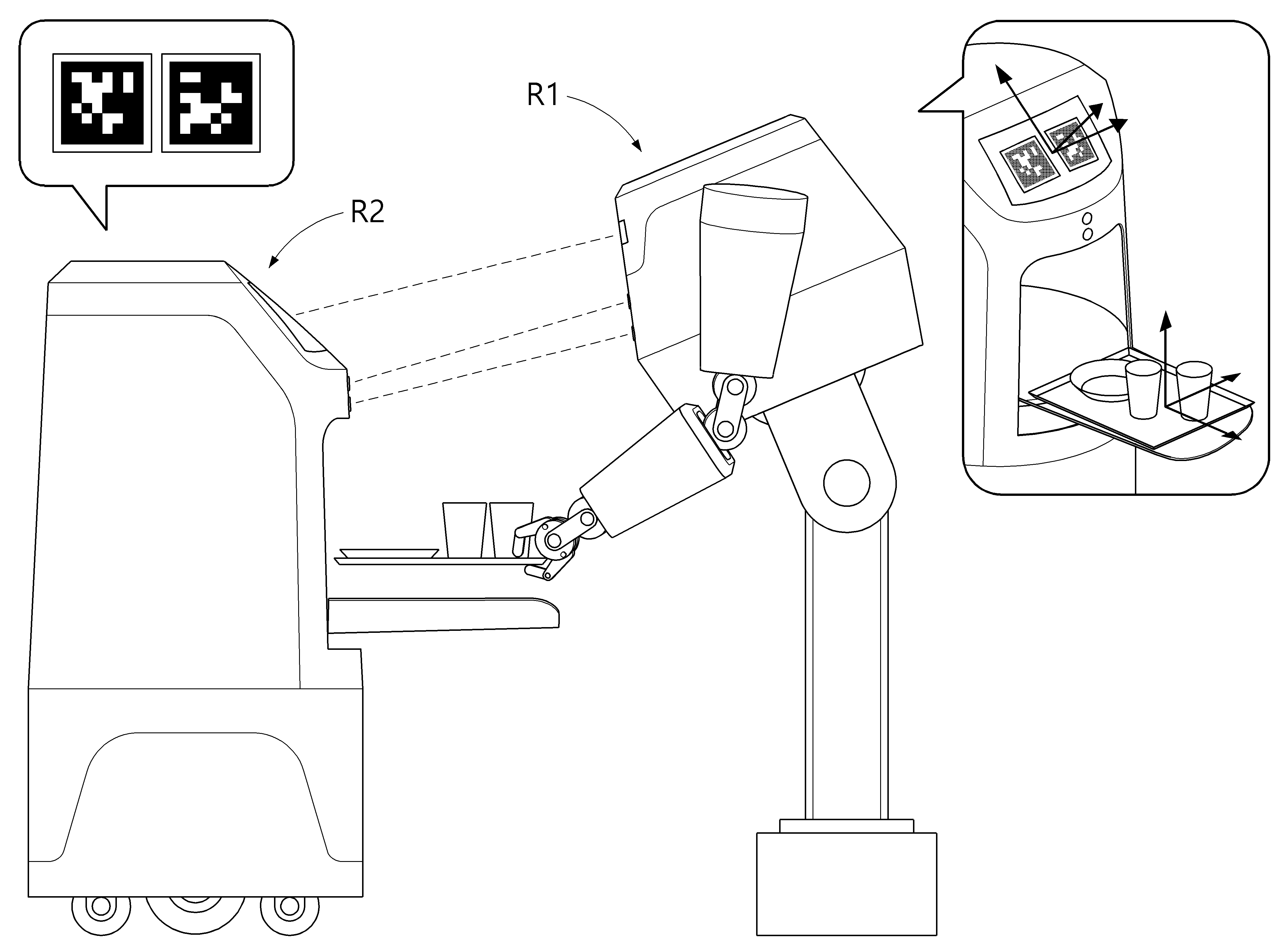

도 12는 본 발명에 따른 복수의 로봇들을 이용한 협업 방법을 설명하기 위한 개념도이다.

도 13 및 도 14는 협업을 수행하는 로봇을 설명하기 위한 블록도들이다.

도 15는 본 발명에 따른 복수의 로봇들을 이용한 협업 방법 을 설명하기 위한 흐름도이다.

도 16, 도 17, 도 18 및 도 19는 본 발명에 따른 로봇에서 출력되는 정보를 설명하기 위한 개념도들이다.

도 20a 및 도 20b는 본 발명에 따른 복수의 로봇들을 이용한 협업을 위해 데이터 통신을 수행하는 방법을 설명하기 위한 개념도들이다.

도 21은 본 발명에서 로봇 간의 협업을 위한 연동을 설명하기 위한 개념도들이다.

도 22는 본 발명에 따른 로봇이 작업 이력을 업데이트 하는 것을 설명하기 위한 개념도이다.

도 23 및 도 24는 본 발명에 따른 로봇 협업에 관리자가 개입하는 방법을 설명하기 위한 개념도이다. Figures 1, 2, and 3 are conceptual diagrams illustrating a robot-friendly building according to the present invention.

FIGS. 4, 5, and 6 are conceptual diagrams for explaining a system for controlling a robot that drives a robot-friendly building and various facilities provided in the robot-friendly building according to the present invention.

Figures 7 and 8 are conceptual diagrams for explaining the facility infrastructure provided in a robot-friendly building according to the present invention.

FIGS. 9 to 11 are conceptual diagrams for explaining a method for estimating the position of a robot moving through a robot-friendly building according to the present invention.

Figure 12 is a conceptual diagram for explaining a collaboration method using multiple robots according to the present invention.

Figures 13 and 14 are block diagrams illustrating robots performing collaboration.

Figure 15 is a flow chart for explaining a collaboration method using multiple robots according to the present invention.

Figures 16, 17, 18, and 19 are conceptual diagrams for explaining information output from a robot according to the present invention.

FIGS. 20A and 20B are conceptual diagrams for explaining a method of performing data communication for collaboration using a plurality of robots according to the present invention.

Figure 21 is a conceptual diagram explaining the linkage for collaboration between robots in the present invention.

Figure 22 is a conceptual diagram explaining how a robot according to the present invention updates its work history.

FIGS. 23 and 24 are conceptual diagrams illustrating a method for a manager to intervene in robot collaboration according to the present invention.

이하, 첨부된 도면을 참조하여 본 명세서에 개시된 실시 예를 상세히 설명하되, 도면 부호에 관계없이 동일하거나 유사한 구성요소에는 동일한 참조 번호를 부여하고 이에 대한 중복되는 설명은 생략하기로 한다. 이하의 설명에서 사용되는 구성요소에 대한 접미사 "모듈" 및 "부"는 명세서 작성의 용이함만이 고려되어 부여되거나 혼용되는 것으로서, 그 자체로 서로 구별되는 의미 또는 역할을 갖는 것은 아니다. 또한, 본 명세서에 개시된 실시 예를 설명함에 있어서 관련된 공지 기술에 대한 구체적인 설명이 본 명세서에 개시된 실시 예의 요지를 흐릴 수 있다고 판단되는 경우 그 상세한 설명을 생략한다. 또한, 첨부된 도면은 본 명세서에 개시된 실시 예를 쉽게 이해할 수 있도록 하기 위한 것일 뿐, 첨부된 도면에 의해 본 명세서에 개시된 기술적 사상이 제한되지 않으며, 본 발명의 사상 및 기술 범위에 포함되는 모든 변경, 균등물 내지 대체물을 포함하는 것으로 이해되어야 한다. Hereinafter, embodiments disclosed in this specification will be described in detail with reference to the attached drawings. Regardless of the drawing symbols, identical or similar components will be given the same reference numerals and redundant descriptions thereof will be omitted. The suffixes "module" and "part" used for components in the following description are assigned or used interchangeably only for the convenience of writing the specification, and do not have distinct meanings or roles in themselves. In addition, when describing embodiments disclosed in this specification, if it is determined that a specific description of a related known technology may obscure the gist of the embodiments disclosed in this specification, the detailed description thereof will be omitted. In addition, the attached drawings are only intended to facilitate easy understanding of the embodiments disclosed in this specification, and the technical ideas disclosed in this specification are not limited by the attached drawings, and should be understood to include all modifications, equivalents, and substitutes included in the spirit and technical scope of the present invention.

제1, 제2 등과 같이 서수를 포함하는 용어는 다양한 구성요소들을 설명하는데 사용될 수 있지만, 상기 구성요소들은 상기 용어들에 의해 한정되지는 않는다. 상기 용어들은 하나의 구성요소를 다른 구성요소로부터 구별하는 목적으로만 사용된다.Terms including ordinal numbers, such as first, second, etc., may be used to describe various components, but the components are not limited by the terms. The terms are used only to distinguish one component from another.

어떤 구성요소가 다른 구성요소에 "연결되어" 있다거나 "접속되어" 있다고 언급된 때에는, 그 다른 구성요소에 직접적으로 연결되어 있거나 또는 접속되어 있을 수도 있지만, 중간에 다른 구성요소가 존재할 수도 있다고 이해되어야 할 것이다. 반면에, 어떤 구성요소가 다른 구성요소에 "직접 연결되어" 있다거나 "직접 접속되어" 있다고 언급된 때에는, 중간에 다른 구성요소가 존재하지 않는 것으로 이해되어야 할 것이다.When it is said that a component is "connected" or "connected" to another component, it should be understood that it may be directly connected or connected to that other component, but that there may be other components in between. On the other hand, when it is said that a component is "directly connected" or "directly connected" to another component, it should be understood that there are no other components in between.

단수의 표현은 문맥상 명백하게 다르게 뜻하지 않는 한, 복수의 표현을 포함한다. Singular expressions include plural expressions unless the context clearly indicates otherwise.

본 출원에서, "포함한다" 또는 "가지다" 등의 용어는 명세서상에 기재된 특징, 숫자, 단계, 동작, 구성요소, 부품 또는 이들을 조합한 것이 존재함을 지정하려는 것이지, 하나 또는 그 이상의 다른 특징들이나 숫자, 단계, 동작, 구성요소, 부품 또는 이들을 조합한 것들의 존재 또는 부가 가능성을 미리 배제하지 않는 것으로 이해되어야 한다.In this application, it should be understood that terms such as “comprises” or “have” are intended to specify the presence of a feature, number, step, operation, component, part or combination thereof described in the specification, but do not exclude in advance the possibility of the presence or addition of one or more other features, numbers, steps, operations, components, parts or combinations thereof.

본 발명은 로봇 친화형 건물에 관한 것으로서, 사람과 로봇이 안전하게 공존하고, 나아가 건물 내에서 로봇이 유익한 서비스를 제공할 수 있는 로봇 친화형 건물을 제안한다. The present invention relates to a robot-friendly building, and proposes a robot-friendly building in which people and robots can safely coexist and, further, in which robots can provide useful services within the building.

보다 구체적으로, 본 발명은 로봇, 로봇 친화 인프라 및 이를 제어하는 다양한 시스템을 이용하여, 사람에게 유용한 서비스를 제공하는 방법을 제공한다. 본 발명에 따른 건물에서는 사람과 다수의 로봇이 공존할 수 있으며, 다수의 로봇이 건물 내에서 자유롭게 이동할 수 있는 다양한 인프라(또는 설비 인프라)가 제공될 수 있다. More specifically, the present invention provides a method for providing useful services to people by using robots, robot-friendly infrastructure, and various systems for controlling the same. In a building according to the present invention, people and a plurality of robots can coexist, and various infrastructures (or facility infrastructures) can be provided that allow a plurality of robots to move freely within the building.

본 발명에서, 건물은 지속적인 거주, 생활, 업무 등을 위하여 만들어진 구조물로서, 상업용 건물, 산업용 건물, 기관용 건물, 거주용 건물 등과 같이 다양한 형태를 가질 수 있다. 또한, 상기 건물은 복수의 층을 가진 다층 건물과 이에 반대되는 단층 건물이 될 수 있다. 다만, 본 발명에서는 설명의 편의상 다층 건물에 적용되는 인프라 또는 설비 인프라를 예시로서 설명한다.In the present invention, a building is a structure built for continuous residence, living, work, etc., and may have various forms such as a commercial building, an industrial building, an institutional building, a residential building, etc. In addition, the building may be a multi-story building with multiple floors, or a single-story building as opposed to a multi-story building. However, in the present invention, for the convenience of explanation, the infrastructure or facility infrastructure applied to a multi-story building is described as an example.

본 발명에서, 인프라 또는 설비 인프라는, 서비스 제공, 로봇의 이동, 기능 유지, 청결 유지 등을 위하여 건물에 구비되는 시설로서, 그 종류 및 형태는 매우 다양할 수 있다. 예를 들어, 건물에 구비되는 인프라는 이동 설비(예를 들어, 로봇 이동 통로, 엘리베이터, 에스컬레이터 등), 충전 설비, 통신 설비, 세척 설비, 구조물(예를 들어, 계단 등) 등과 같이 다양할 수 있다. 본 명세서에서는 이러한 설비들은 시설, 인프라, 시설 인프라 또는 설비 인프라로 명명하도록 하며, 경우에 따라 용어를 혼용하여 사용하도록 한다.In the present invention, the infrastructure or facility infrastructure refers to facilities installed in a building for providing services, moving robots, maintaining functions, maintaining cleanliness, etc., and their types and forms may vary greatly. For example, the infrastructure installed in a building may include various types of moving facilities (e.g., robot moving passageways, elevators, escalators, etc.), charging facilities, communication facilities, cleaning facilities, structures (e.g., stairs, etc.), etc. In this specification, these facilities are referred to as facilities, infrastructure, facility infrastructure, or facility infrastructure, and the terms may be used interchangeably in some cases.

나아가, 본 발명에 따른 건물에서는 건물, 건물에 구비된 다양한 설비 인프라 및 로봇 중 적어도 하나가 서로 연동하여 제어됨으로써, 로봇이 안전하고, 정확하게 건물 내에서 다양한 서비스를 제공하도록 이루어질 수 있다. Furthermore, in a building according to the present invention, at least one of the building, various facility infrastructures provided in the building, and a robot are controlled in conjunction with each other, so that the robot can safely and accurately provide various services within the building.

본 발명은 다수의 로봇이 건물 내에서 주행하고, 임무(또는 업무)에 따른 서비스를 제공하며, 필요에 따라 대기 또는 충전 기능, 나아가 로봇에 대한 수리 및 세척 기능을 지원할 수 있는 다양한 설비 인프라가 구비된 건물을 제안한다. 이러한 건물은 로봇에 대한 통합 솔루션(또는 시스템)을 제공하며, 본 발명에 따른 건물은 다양한 수식어로서 명명될 수 있다. 예를 들어, 본 발명에 따른 건물은, i)로봇이 이용하는 인프라를 구비하는 건물, ii)로봇 친화 인프라를 구비하는 건물, iii)로봇 친화형 건물, iv) 로봇과 사람이 함께 생활하는 건물, v)로봇을 이용한 다양한 서비스를 제공하는 건물과 등과 같이, 다양하게 표현될 수 있다.The present invention proposes a building equipped with various facility infrastructures that enable a plurality of robots to run within the building, provide services according to their tasks (or work), and support standby or charging functions, and further repair and cleaning functions for the robots as needed. Such a building provides an integrated solution (or system) for the robots, and the building according to the present invention can be named with various modifiers. For example, the building according to the present invention can be expressed in various ways, such as i) a building equipped with infrastructure used by robots, ii) a building equipped with robot-friendly infrastructure, iii) a robot-friendly building, iv) a building where robots and people live together, and v) a building that provides various services using robots.

한편, 본 발명에서 “로봇 친화”의 의미는, 로봇이 공존하는 건물에 대한 것으로서, 보다 구체적으로, 로봇의 주행을 허용하거나, 로봇이 서비스를 제공하거나, 로봇이 이용 가능한 설비 인프라가 구축되어 있거나, 로봇에게 필요한 기능(ex: 충전, 수리, 세척 등)을 제공하는 설비 인프라가 구축되어 있음을 의미할 수 있다. 이 경우에, 본 발명에서 “로봇 친화”는 로봇과 사람의 공존을 위한 통합 솔루션을 가지고 있다는 의미로 사용될 수 있다.Meanwhile, the meaning of “robot friendly” in the present invention refers to a building where robots coexist, and more specifically, it can mean that there is a facility infrastructure built that allows robots to run, that allows robots to provide services, that is usable by robots, or that is built to provide functions necessary for robots (ex: charging, repair, cleaning, etc.). In this case, “robot friendly” in the present invention can be used to mean that there is an integrated solution for coexistence of robots and humans.

이하에서는 첨부된 도면과 함께, 본 발명에 대해 보다 구체적으로 살펴본다.Below, the present invention will be described in more detail with reference to the attached drawings.

도 1, 도 2 및 도 3은 본 발명에 따른 로봇 친화형 건물을 설명하기 위한 개념도들이고, 도 4, 도 5 및 도 6은 본 발명에 따른 로봇 친화형 건물을 주행하는 로봇 및 로봇 친화형 건물에 구비된 다양한 설비를 제어하는 시스템을 설명하기 위한 개념도들이다. 나아가, 도 7 및 도 8은 본 발명에 따른 로봇 친화형 건물에 구비된 설비 인프라를 설명하기 위한 개념도들이다.FIGS. 1, 2 and 3 are conceptual diagrams for explaining a robot-friendly building according to the present invention, and FIGS. 4, 5 and 6 are conceptual diagrams for explaining a system for controlling a robot that drives a robot-friendly building according to the present invention and various facilities equipped in the robot-friendly building. Furthermore, FIGS. 7 and 8 are conceptual diagrams for explaining facility infrastructure equipped in a robot-friendly building according to the present invention.

먼저, 설명의 편의를 위하여, 대표적인 도면 부호를 정의하기로 한다.First, for convenience of explanation, we will define representative drawing symbols.

본 발명에서, 건물은 도면 부호 “1000”을 부여하며, 건물(1000)의 공간(실내 공간 또는 실내 영역)은 도면 부호 “10”을 부여한다(도 8 참조). 나아가, 건물(1000)의 실내 공간을 구성하는 복수의 층들(floors)에 각각 해당하는 실내 공간은 도면 부호 10a, 10b, 10c등을 부여한다(도 8 참조). 본 발명에서 실내 공간 또는 실내 영역은 건물의 외부와 반대되는 개념으로 외벽에 의하여 보호되는 건물의 내부를 의미하는 것으로서, 공간을 의미하는 것으로 한정되지 않는다.In the present invention, a building is given the drawing symbol “1000”, and a space (indoor space or indoor area) of the building (1000) is given the drawing symbol “10” (see FIG. 8). Furthermore, indoor spaces corresponding to a plurality of floors constituting the indoor space of the building (1000) are given drawing

나아가, 본 발명에서 로봇은 도면 부호 “R”을 부여하며, 도면 또는 명세서에서는 로봇에 대하여 도면 부호를 기입하지 않더라도, 모두 로봇(R)으로 이해되어질 수 있다.Furthermore, in the present invention, the robot is given a drawing symbol “R”, and even if a drawing symbol is not indicated for the robot in the drawing or specification, it can all be understood as a robot (R).

나아가, 본 발명에서 사람 또는 인간은 도면 부호 “U”를 부여하며, 사람 또는 인간은 동적인 객체로서 명명이 가능하다. 이때 동적인 객체는 반드시 사람만을 의미하는 것이 아니라, 강아지, 고양이와 같은 동물 또는 다른 적어도 하나의 로봇(예를 들어, 사용자의 개인 로봇, 다른 서비스를 제공하는 로봇 등), 드론, 청소기(예를 들어, 로봇 청소기)와 같이 움직임이 가능한 사물을 포함하는 의미로 받아들여질 수 있다.Furthermore, in the present invention, a person or a human is given the drawing symbol “U”, and a person or a human can be named as a dynamic object. At this time, the dynamic object does not necessarily mean only a person, but can be understood to include an animal such as a dog or a cat, or at least one other robot (e.g., a user’s personal robot, a robot providing other services, etc.), a drone, a vacuum cleaner (e.g., a robot vacuum cleaner), and other objects capable of movement.

한편, 본 발명에서 설명되는 건물(建物, building, structure, edifice, 1000)은 특별한 종류에 제한을 두지 않으며, 사람이 들어 살거나, 일을 하거나, 동물을 사육하거나, 또는 물건을 넣어 두기 위하여 지은 구조물을 의미할 수 있다.Meanwhile, the building (building, structure, edifice, 1000) described in the present invention is not limited to a specific type, and may mean a structure built for people to live in, work in, raise animals, or store objects.

예를 들어, 건물(1000)은 사무실, 오피스, 오피스텔, 아파트, 주상복합 아파트, 주택, 학교, 병원, 음식점, 관공서 등이 될 수 있으며, 본 발명은 이러한 다양한 종류의 건물들에 적용될 수 있다.For example, the building (1000) may be an office, an officetel, an apartment, a multi-use apartment, a house, a school, a hospital, a restaurant, a government office, etc., and the present invention may be applied to these various types of buildings.

도 1에 도시된 것과 같이, 본 발명에 따른 건물(1000)에서는 로봇이 주행하며 다양한 서비스를 제공할 수 있다.As illustrated in Fig. 1, in a building (1000) according to the present invention, a robot can move and provide various services.

건물(1000)내에는 하나 또는 그 이상의 서로 다른 종류의 복수의 로봇들이 위치할 수 있으며, 이러한 로봇들은 서버(20)의 제어 하에, 건물(1000) 내를 주행하고, 서비스를 제공하며, 건물(1000)에 구비된 다양한 설비 인프라를 이용할 수 있다.One or more different types of multiple robots may be positioned within the building (1000), and these robots may run within the building (1000), provide services, and utilize various facility infrastructures provided within the building (1000) under the control of the server (20).

본 발명에서 서버(20)의 위치는 다양하게 존재할 수 있다. 예를 들어, 서버(20)는 건물(1000)의 내부 및 건물(1000)의 외부 중 적어도 하나에 위치할 수 있다. 즉, 서버(20)의 적어도 일부는 건물(1000)의 내부에 위치하고, 나머지 일부는 건물(1000)의 외부에 위치할 수 있다. 또는, 서버(20)는 건물(1000) 내부에 모두 위치하거나, 건물(1000) 외부에만 위치할 수 있다. 이에, 본 발명에서는, 서버(20)의 구체적인 위치에 대해서는 특별한 한정을 두지 않기로 한다.In the present invention, the location of the server (20) may exist in various ways. For example, the server (20) may be located at least one of the inside of the building (1000) and the outside of the building (1000). That is, at least some of the servers (20) may be located inside the building (1000), and the remaining some may be located outside the building (1000). Alternatively, the servers (20) may be located entirely inside the building (1000), or only outside the building (1000). Accordingly, in the present invention, no particular limitation is placed on the specific location of the server (20).

나아가, 본 발명에서 서버(20)는 클라우드 컴퓨팅(Cloud Computing) 방식의 서버(클라우드 서버, 21) 및 엣지 컴퓨팅(Edge computing) 방식의 서버(엣지 서버, 22) 중 적어도 하나의 방식을 이용하도록 이루어질 수 있다. 나아가, 서버(20)는 클라우드 컴퓨팅 또는 엣지 컴퓨팅 방식 외에도, 로봇을 제어 가능한 방식이기만 하면 본 발명에 적용될 수 있다.Furthermore, in the present invention, the server (20) may be configured to use at least one of a cloud computing-type server (cloud server, 21) and an edge computing-type server (edge server, 22). Furthermore, in addition to the cloud computing or edge computing methods, the server (20) may be applied to the present invention as long as it is capable of controlling a robot.

한편, 본 발명에 따른 서버(20)는 경우에 따라, 클라우드 컴퓨팅(Cloud Computing) 방식의 서버(21) 및 엣지 컴퓨팅(Edge computing) 방식을 혼합하여 로봇 및 건물(1000)내 구비된 설비 인프라 중 적어도 하나에 대한 제어를 수행할 수 있다.Meanwhile, the server (20) according to the present invention may, in some cases, perform control of at least one of the robot and the facility infrastructure provided in the building (1000) by combining the server (21) of the cloud computing method and the edge computing method.

한편, 클라우드 서버(21)와 엣지 서버(22)에 대해서 보다 구체적으로 살펴보면, 엣지 서버(22)는 전자 장치로서, 로봇(R)의 브레인(brain)으로 동작할 수 있다. 즉 각각의 엣지 서버(22)는 적어도 하나의 로봇(R)을 무선으로 제어할 수 있다. 이 때 엣지 서버(22)는 정해지는 제어 주기에 기반하여, 로봇(R)을 제어할 수 있다. 제어 주기는 로봇(R)과 관련된 데이터를 처리(processing)하도록 주어지는 시간과 로봇(R)에 제어 명령을 제공하도록 주어지는 시간의 합으로 결정될 수 있다. 클라우드 서버(21)는 로봇(R) 또는 엣지 서버(22) 중 적어도 어느 하나를 관리할 수 있다. 이 때 엣지 서버(22)는 로봇(R)에 대응하여 서버로서 동작하고, 클라우드 서버(21)에 대응하여 클라이언트로 동작할 수 있다. Meanwhile, looking more specifically at the cloud server (21) and the edge server (22), the edge server (22) is an electronic device that can operate as the brain of the robot (R). That is, each edge server (22) can wirelessly control at least one robot (R). At this time, the edge server (22) can control the robot (R) based on a set control cycle. The control cycle can be determined as the sum of the time given to process data related to the robot (R) and the time given to provide a control command to the robot (R). The cloud server (21) can manage at least one of the robot (R) or the edge server (22). At this time, the edge server (22) can operate as a server corresponding to the robot (R) and as a client corresponding to the cloud server (21).

로봇(R)과 엣지 서버(22)는 무선으로 통신할 수 있으며, 엣지 서버(22)와 클라우드 서버(21)는 유선 또는 무선으로 통신할 수 있다. 이 때 로봇(R)과 엣지 서버(22)는, 초고신뢰 저지연 통신(ultra-reliable and low latency communications; URLLC)이 가능한 무선 네트워크를 통하여, 통신할 수 있다. 예를 들면, 무선 네트워크는 5G 네트워크 또는 WiFi-6(WiFi ad/ay) 중 적어도 어느 하나를 포함할 수 있다. 여기서, 5G 네트워크는, 초고신뢰 저지연 통신이 가능할 뿐 아니라, 초광대역 이동 통신(enhanced mobile broadband; eMBB) 및 대규모 사물 통신(massive machine type communications; mMTC)이 가능한 특징들을 가질 수 있다. 일 예로, 엣지 서버(22)는 MEC(mobile edge computing, multi-access edge computing) 서버를 포함하며, 기지국에 배치될 수 있다. 이를 통해, 로봇(R)과 엣지 서버(22) 간 통신에 따른 지연(latency) 시간이 단축될 수 있다. 이 때 엣지 서버(22)의 제어 주기에서, 로봇(R)으로 제어 명령을 제공하도록 주어지는 시간이 단축됨에 따라, 데이터를 처리하도록 주어지는 시간이 확대될 수 있다. 한편, 엣지 서버(22)와 클라우드 서버(21)는, 예컨대 인터넷(internet)과 같은 무선 네트워크를 통하여, 통신할 수 있다. The robot (R) and the edge server (22) can communicate wirelessly, and the edge server (22) and the cloud server (21) can communicate wiredly or wirelessly. At this time, the robot (R) and the edge server (22) can communicate via a wireless network capable of ultra-reliable and low latency communications (URLLC). For example, the wireless network may include at least one of a 5G network or WiFi-6 (WiFi ad/ay). Here, the 5G network may have features that not only enable ultra-reliable and low latency communications, but also enable enhanced mobile broadband (eMBB) and massive machine type communications (mMTC). For example, the edge server (22) may include an MEC (mobile edge computing, multi-access edge computing) server and may be deployed at a base station. Through this, the latency time due to communication between the robot (R) and the edge server (22) can be shortened. At this time, as the time given to provide a control command to the robot (R) in the control cycle of the edge server (22) is shortened, the time given to process data can be extended. Meanwhile, the edge server (22) and the cloud server (21) can communicate via a wireless network, such as the Internet, for example.

한편, 경우에 따라, 복수 개의 엣지 서버들은 무선 메시 네트워크(mesh network)를 통하여 연결될 수 있으며, 클라우드 서버(21)의 기능은 복수 개의 엣지 서버들에 분산될 수 있다. 이러한 경우, 어떤 로봇(R)에 대하여, 엣지 서버들 중 어느 하나가 로봇(R)을 위한 엣지 서버(22)로서 동작하고, 엣지 서버들 중 적어도 다른 하나가 엣지 서버들 중 어느 하나와 협력 하에, 로봇(R)을 위한 클라우드 서버(21)로서 동작할 수 있다. Meanwhile, in some cases, a plurality of edge servers may be connected via a wireless mesh network, and the function of the cloud server (21) may be distributed to a plurality of edge servers. In this case, for a certain robot (R), one of the edge servers may operate as an edge server (22) for the robot (R), and at least one other of the edge servers may operate as a cloud server (21) for the robot (R) in cooperation with one of the edge servers.

본 발명에 따른 건물(1000)에 형성되는 네트워크 또는 통신망은 데이터를 수집하도록 구성되는 적어도 하나의 로봇(R), 로봇(R)을 무선으로 제어하도록 구성되는 적어도 하나의 엣지 서버(22), 및 엣지 서버(22)와 연결되고, 로봇(R)과 엣지 서버(22)를 관리하도록 구성되는 클라우드 서버(21) 간의 통신을 포함할 수 있다. A network or communication network formed in a building (1000) according to the present invention may include communication between at least one robot (R) configured to collect data, at least one edge server (22) configured to wirelessly control the robot (R), and a cloud server (21) connected to the edge server (22) and configured to manage the robot (R) and the edge server (22).

엣지 서버(22)는, 로봇(R)으로부터 상기 데이터를 무선으로 수신하고, 상기 데이터를 기반으로 제어 명령을 결정하고, 로봇(R)에 상기 제어 명령을 무선으로 전송하도록 구성될 수 있다. The edge server (22) can be configured to wirelessly receive the data from the robot (R), determine a control command based on the data, and wirelessly transmit the control command to the robot (R).

다양한 실시예들에 따르면, 엣지 서버(22)는, 상기 데이터에 기반하여, 클라우드 서버(21)와 협력할 지의 여부를 판단하고, 클라우드 서버(21)와 협력하지 않아도 되는 것으로 판단되면, 정해진 제어 주기 내에서, 상기 제어 명령을 결정하고 상기 제어 명령을 전송하도록 구성될 수 있다. According to various embodiments, the edge server (22) may be configured to determine whether to cooperate with the cloud server (21) based on the data, and if it is determined that there is no need to cooperate with the cloud server (21), determine the control command and transmit the control command within a set control period.

다양한 실시예들에 따르면, 엣지 서버(22)는, 클라우드 서버(21)와 협력해야 하는 것으로 판단되면, 상기 데이터를 기반으로 클라우드 서버(21)와 통신하여, 상기 제어 명령을 결정하도록 구성될 수 있다. According to various embodiments, the edge server (22) may be configured to communicate with the cloud server (21) based on the data to determine the control command when it is determined that cooperation with the cloud server (21) is required.

한편, 로봇(R)은 제어 명령에 따라 구동될 수 있다. 예를 들면, 로봇(R)은 움직임을 변경함으로써 위치를 이동하거나 자세를 변경할 수 있으며, 소프트웨어 업데이트를 수행할 수 있다.Meanwhile, the robot (R) can be driven according to control commands. For example, the robot (R) can move its position or change its posture by changing its movement, and can perform software updates.

본 발명에서는, 설명의 편의를 위하여, 서버(20)를 “클라우드 서버”로 통일하여 명명하도록 하며, 도면 부호 “20”을 부여하도록 한다. 한편, 이러한 클라우드 서버(20)는 엣지 컴퓨팅의 엣지 서버(22)의 용어로도 대체될 수 있음은 물론이다.In the present invention, for the convenience of explanation, the server (20) is uniformly named as a “cloud server” and is given the drawing symbol “20”. Meanwhile, it goes without saying that the cloud server (20) can also be replaced with the term edge server (22) of edge computing.

나아가, “클라우드 서버”의 용어는 클라우드 로봇 시스템, 클라우드 시스템, 클라우드 로봇 제어 시스템, 클라우드 제어 시스템 등의 용어로 다양하게 변경될 수 있다.Furthermore, the term “cloud server” can be variously changed to terms such as cloud robot system, cloud system, cloud robot control system, and cloud control system.

한편, 본 발명에 따른 클라우드 서버(20)는 건물(1000)을 주행하는 복수의 로봇에 대한 통합 제어를 수행하는 것이 가능하다. 즉, 클라우드 서버(20)는 건물(1000)내 위치한 i)복수의 로봇(R)에 대한 모니터링을 수행하고, ii)복수의 로봇에 대해 임무(또는 업무)를 할당하며, iii)복수의 로봇(R)이 임무를 성공적으로 수행하도록 건물(1000)내 구비된 설비 인프라를 직접적으로 제어하거나, iv)설비 인프라를 제어하는 제어 시스템과 통신을 통하여 설비 인프라가 제어되도록 할 수 있다.Meanwhile, the cloud server (20) according to the present invention can perform integrated control for a plurality of robots running in a building (1000). That is, the cloud server (20) can i) monitor a plurality of robots (R) located in the building (1000), ii) assign tasks (or work) to the plurality of robots, iii) directly control the facility infrastructure provided in the building (1000) so that the plurality of robots (R) successfully perform the tasks, or iv) control the facility infrastructure through communication with a control system that controls the facility infrastructure.

나아가, 클라우드 서버(20)는 건물에 위치한 로봇들의 상태 정보를 확인하고, 로봇들에 필요한 다양한 기능을 제공(또는 지원)할 수 있다. 여기에서, 다양한 기능은, 로봇들에 대한 충전 기능, 오염된 로봇에 대한 세척 기능, 임무가 완료된 로봇들에 대한 대기 기능 등이 존재할 수 있다.In addition, the cloud server (20) can check the status information of robots located in the building and provide (or support) various functions required for the robots. Here, various functions may exist, such as a charging function for robots, a cleaning function for contaminated robots, and a standby function for robots whose tasks have been completed.

클라우드 서버(20)는 로봇들에 대해 다양한 기능을 제공하기 위하여, 로봇들이 건물(1000)에 구비된 다양한 설비 인프라를 이용하도록, 로봇들을 제어할 수 있다. 나아가, 클라우드 서버는, 로봇들에 대해 다양한 기능을 제공하기 위하여, 건물(1000)내 구비된 설비 인프라를 직접적으로 제어하거나, 설비 인프라를 제어하는 제어 시스템과 통신을 통하여 설비 인프라가 제어되도록 할 수 있다.The cloud server (20) can control the robots so that the robots can use various facility infrastructures equipped in the building (1000) to provide various functions to the robots. Furthermore, the cloud server can directly control the facility infrastructure equipped in the building (1000) or control the facility infrastructure through communication with a control system that controls the facility infrastructure to provide various functions to the robots.

이와 같이, 클라우드 서버(20)에 의해 제어되는 로봇들은 건물(1000)을 주행하며, 다양한 서비스를 제공할 수 있다.In this way, robots controlled by the cloud server (20) can move around the building (1000) and provide various services.

한편, 클라우드 서버(20)는 데이터베이스에 저장된 정보를 근거로, 다양한 제어를 수행할 수 있으며, 본 발명에서 데이터베이스의 종류 및 위치에는 특별한 한정을 두지 않는다. 이러한 데이터베이스의 용어는 메모리, 저장부, 저장소, 클라우드 저장소, 외부 저장소, 외부 서버 등, 정보가 저장되는 수단을 의미하는 용어이면 자유롭게 변형되어 사용되어질 수 있다. 이하에서는 “데이터베이스”의 용어로 통일하여 설명하도록 한다.Meanwhile, the cloud server (20) can perform various controls based on the information stored in the database, and there is no particular limitation on the type and location of the database in the present invention. The term of the database can be freely modified and used as long as it means a means for storing information, such as memory, storage, storage, cloud storage, external storage, external server, etc. In the following, the term “database” will be used for explanation.

한편, 본 발명에 따른 클라우드 서버(20)는 로봇들이 제공하는 서비스의 종류, 로봇에 대한 제어의 종류 등 다양한 기준에 근거하여 로봇에 대한 분산 제어를 수행할 수 있으며, 이 경우, 클라우드 서버(20)에는 하위 개념의 종속적인 서브 서버들이 존재할 수 있다.Meanwhile, the cloud server (20) according to the present invention can perform distributed control of robots based on various criteria such as the type of service provided by the robots, the type of control for the robots, etc., and in this case, the cloud server (20) can have sub-servers of lower concept.

나아가, 본 발명에 따른 클라우드 서버(20)는 다양한 인공지능 알고리즘에 근거하여, 건물(1000)을 주행하는 로봇을 제어할 수 있다.Furthermore, the cloud server (20) according to the present invention can control a robot moving through a building (1000) based on various artificial intelligence algorithms.

나아가, 클라우드 서버(20)는 로봇을 제어하는 과정에서 수집되는 데이터들을 학습 데이터로서 활용하는 인공지능 기반의 학습을 수행하고, 이를 로봇의 제어에 활용함으로써, 로봇에 대한 제어가 이루어질수록 로봇을 보다 정확하고, 효율적으로 운용할 수 있다. 즉, 클라우드 서버(20)는 딥러닝 또는 머신 러닝을 수행하도록 이루어질 수 있다. 또한, 클라우드 서버(20)는 시뮬레이션 등을 통하여 딥러닝 또는 머신 러닝을 수행하고, 그 결과로서 구축된 인공지능 모델을 이용하여 로봇에 대한 제어를 수행할 수 있다.Furthermore, the cloud server (20) performs artificial intelligence-based learning that utilizes data collected in the process of controlling the robot as learning data, and utilizes this to control the robot, so that the more control is performed on the robot, the more accurately and efficiently the robot can be operated. That is, the cloud server (20) can be configured to perform deep learning or machine learning. In addition, the cloud server (20) can perform deep learning or machine learning through simulation, etc., and perform control on the robot using the artificial intelligence model constructed as a result.

한편, 건물(1000)에는 로봇의 주행, 로봇의 기능 제공, 로봇의 기능 유지, 로봇의 임무 수행 또는 로봇과 사람의 공존을 위하여 다양한 설비 인프라가 구비될 수 있다. Meanwhile, the building (1000) may be equipped with various facility infrastructures for robot driving, robot function provision, robot function maintenance, robot mission performance, or coexistence of robots and humans.

예를 들어, 도 1의 (a)에 도시된 것과 같이, 건물(1000) 내에는 로봇(R)의 주행(또는 이동)을 지원할 수 있는 다양한 설비 인프라(1, 2)가 구비될 수 있다. 이러한 설비 인프라(1, 2)는 건물(1000)의 층 내에서 로봇(R)의 수평 방향으로의 이동을 지원하거나, 건물(1000)의 서로 다른 층 사이를 로봇(R)이 이동하도록 수직 방향으로의 이동을 지원할 수 있다. 이와 같이, 상기 설비 인프라(1, 2)는 로봇의 이동을 지원하는 운송체계를 구비할 수 있다. 클라우드 서버(20)는 이러한 다양한 설비 인프라(1, 2)를 이용하도록 로봇(R)을 제어하여, 도 1의 (b)에 도시된 것과 같이, 로봇(R)이 서비스를 제공하기 위하여 건물(1000) 내를 이동하도록 할 수 있다.For example, as illustrated in (a) of FIG. 1, various facility infrastructures (1, 2) capable of supporting the driving (or movement) of the robot (R) may be provided within the building (1000). These facility infrastructures (1, 2) may support horizontal movement of the robot (R) within a floor of the building (1000) or vertical movement of the robot (R) between different floors of the building (1000). In this way, the facility infrastructures (1, 2) may be provided with a transportation system that supports the movement of the robot. The cloud server (20) may control the robot (R) to utilize these various facility infrastructures (1, 2) so that the robot (R) may move within the building (1000) to provide a service, as illustrated in (b) of FIG. 1.

한편, 본 발명에 따른 로봇들은 클라우드 서버(20) 및 로봇 자체에 구비된 제어부 중 적어도 하나에 근거하여 제어되어, 건물(1000) 내를 주행하거나, 부여된 임무에 해당하는 서비스를 제공하도록 이루어질 수 있다.Meanwhile, robots according to the present invention can be controlled based on at least one of a cloud server (20) and a control unit provided in the robot itself to drive within a building (1000) or provide a service corresponding to an assigned task.

나아가, 도 1의 (c)에 도시된 것과 같이, 본 발명에 따른 건물은 로봇과 사람들이 공존하는 건물로서, 로봇들은 사람(U), 사람이 사용하는 물건(예를 들어 유모차, 카트 등), 동물과 같은 장애물을 피하여 주행하도록 이루어지며, 경우에 따라 로봇의 주행과 관련된 알림 정보(3)를 출력하도록 이루어질 수 있다. 이러한 로봇의 주행은 클라우드 서버(20) 및 로봇에 구비된 제어부 중 적어도 하나의 근거 하에 장애물을 피하도록 이루어질 수 있다. 클라우드 서버(20)는 로봇에 구비된 다양한 센서(예를 들어, 카메라(이미지 센서), 근접 센서, 적외선 센서 등)를 통해 수신되는 정보에 근거하여, 로봇이 장애물을 피하여 건물(1000) 내를 이동하도록 로봇에 대한 제어를 수행할 수 있다.Furthermore, as illustrated in (c) of FIG. 1, a building according to the present invention is a building where robots and people coexist, and the robots are configured to avoid obstacles such as people (U), objects used by people (e.g., baby strollers, carts, etc.), and animals while driving, and in some cases, may be configured to output notification information (3) related to the driving of the robot. Such driving of the robot may be configured to avoid obstacles based on at least one of a cloud server (20) and a control unit equipped in the robot. The cloud server (20) may control the robot so that the robot moves within the building (1000) while avoiding obstacles based on information received through various sensors equipped in the robot (e.g., a camera (image sensor), a proximity sensor, an infrared sensor, etc.).

또한, 도 1의 (a) 내지 (c)의 과정을 거쳐 건물 내를 주행하는 로봇은, 도 1의 (d)에 도시된 것과 같이, 건물 내에 존재하는 사람 또는 타겟 객체에게 서비스를 제공하도록 이루어질 수 있다. In addition, a robot that moves inside a building through the processes of (a) to (c) of FIG. 1 can be configured to provide a service to a person or target object existing inside the building, as shown in (d) of FIG. 1.

로봇이 제공하는 서비스의 종류는, 로봇 마다 상이할 수 있다. 즉, 로봇은 용도에 따라 다양한 종류가 존재할 수 있으며, 로봇은 용도 마다 상이한 구조를 가지고, 로봇에는 용도에 적합한 프로그램이 탑재될 수 있다.The types of services provided by robots may vary from robot to robot. In other words, robots may exist in various types depending on their purpose, robots may have different structures depending on their purpose, and robots may be equipped with programs appropriate for their purpose.

예를 들어, 건물(1000)에는 배송, 물류 작업, 안내, 통역, 주차지원, 보안, 방범, 경비, 치안, 청소, 방역, 소독, 세탁, 푸드(food) 제조, 음식 제조, 서빙, 화재 진압, 의료 지원 및 엔터테인먼트 서비스 중 적어도 하나의 서비스를 제공하는 로봇들이 배치될 수 있다. 로봇들이 제공하는 서비스는 위에서 열거된 예들 외에도 다양할 수 있다.For example, a building (1000) may be equipped with robots that provide at least one of the following services: delivery, logistics, guidance, interpretation, parking assistance, security, crime prevention, guarding, public safety, cleaning, quarantine, disinfection, laundry, food preparation, food preparation, serving, fire suppression, medical assistance, and entertainment. The services provided by the robots may vary in addition to the examples listed above.

한편, 클라우드 서버(20)는 로봇들 각각의 용도를 고려하여, 로봇들에게 적절한 임무를 할당하고, 할당된 임무가 수행되도록 로봇들에 대한 제어를 수행할 수 있다.Meanwhile, the cloud server (20) can assign appropriate tasks to the robots by considering the purpose of each robot and control the robots so that the assigned tasks are performed.

본 발명에서 설명되는 로봇들 중 적어도 일부는 클라우드 서버(20)의 제어 하에 주행하거나, 임무를 수행할 수 있으며, 이 경우, 로봇 자체에서 주행 또는 임무를 수행하기 위하여 처리되는 데이터의 양은 최소화될 수 있다. 본 발명에서는 이러한 로봇을 브레인리스(brainless) 로봇이라고 명명할 수 있다. 이러한 브레인리스 로봇은, 건물(1000) 내에서 주행, 임무 수행, 충전 수행, 대기, 세척 등의 행위를 하는데 있어서, 적어도 일부의 제어를 클라우드 서버(20)의 제어에 의존할 수 있다.At least some of the robots described in the present invention can drive or perform tasks under the control of a cloud server (20), and in this case, the amount of data processed by the robot itself for driving or performing tasks can be minimized. In the present invention, such a robot can be called a brainless robot. Such a brainless robot can depend on the control of the cloud server (20) for at least part of the control when performing actions such as driving, performing tasks, charging, waiting, and cleaning within a building (1000).

다만, 본 명세서에서는 브레인리스 로봇을 구분하여 명명하지 않고, 모두 “로봇”으로 통일하여 명명하도록 한다.However, in this specification, brainless robots are not named separately, but are all referred to as “robots.”

앞서 설명한 것과 같이, 본 발명에 따른 건물(1000)은 로봇이 이용 가능한 다양한 설비 인프라가 구비될 수 있으며, 도 2, 도 3 및 도 4에 도시된 것과 같이, 설비 인프라는 건물(1000)내에 배치되어, 건물(1000) 및 클라우드 서버(20)와의 연동을 통해, 로봇의 이동(또는 주행)을 지원하거나, 로봇에게 다양한 기능을 제공할 수 있다.As described above, the building (1000) according to the present invention can be equipped with various facility infrastructures that can be used by the robot, and as illustrated in FIGS. 2, 3, and 4, the facility infrastructures are placed within the building (1000) and, through linkage with the building (1000) and a cloud server (20), can support movement (or driving) of the robot or provide various functions to the robot.

보다 구체적으로, 설비 인프라는 건물 내에서 로봇의 이동을 지원하기 위한 설비들을 포함할 수 있다.More specifically, the facility infrastructure may include facilities to support the movement of the robot within the building.

로봇의 이동을 지원하는 설비들은, 로봇이 전용으로 사용하는 로봇 전용 설비 및 사람과 공동으로 사용하는 공용 설비 중 어느 하나의 타입을 가질 수 있다.The facilities that support the movement of the robot can have either a robot-only facility for exclusive use by the robot or a shared facility for joint use with people.

나아가, 로봇의 이동을 지원하는 설비들은 로봇의 수평 방향으로의 이동을 지원하거나, 로봇의 수직 방향으로의 이동을 지원할 수 있다. 로봇들은 건물(1000)내에서 설비들을 이용하여, 수평 또는 수직 방향으로 이동할 수 있다. 수평 방향으로의 이동은, 동일 층 내에서의 이동을 의미하며, 수직 방향으로의 이동은 서로 다른 층간 사이를 이동하는 것을 의미할 수 있다. 따라서 본 발명에서는 동일 층 내에서 상하로 이동하는 것은 수평 방향의 이동으로 지칭할 수 있다.Furthermore, the facilities supporting the movement of the robot can support the horizontal movement of the robot or the vertical movement of the robot. The robots can move horizontally or vertically using the facilities within the building (1000). Movement in the horizontal direction means movement within the same floor, and movement in the vertical direction can mean movement between different floors. Therefore, in the present invention, moving up and down within the same floor can be referred to as movement in the horizontal direction.

로봇의 이동을 지원하는 설비들은 다양할 수 있으며, 예를 들어, 도 2 및 도 3에 도시된 것과 같이, 건물(1000)에는 로봇의 수평 방향으로의 이동을 지원하는 로봇 통로(로봇 도로, 201, 202, 203)가 구비될 수 있다. 이러한 로봇 통로는, 로봇이 전용으로 이용하는 로봇 전용 통로를 포함할 수 있다. 한편, 로봇 전용 통로는 사람의 접근이 원천적으로 차단되도록 이루어지는 것이 가능하나, 반드시 이에 한정되지 않을 수 있다. 즉, 로봇 전용 통로는 사람이 통행하거나, 접근할 수 있는 구조로 이루어질 수 있다.The facilities supporting the movement of the robot may be diverse, and for example, as shown in FIGS. 2 and 3, a building (1000) may be provided with a robot passage (robot road, 201, 202, 203) supporting the horizontal movement of the robot. This robot passage may include a robot-only passage exclusively used by the robot. Meanwhile, the robot-only passage may be formed so that access by humans is fundamentally blocked, but may not necessarily be limited thereto. That is, the robot-only passage may be formed in a structure that allows humans to pass through or access it.

한편, 도 3에 도시된 것과 같이, 로봇 전용 통로는 제1 전용 통로(또는 제1 타입 통로, 201) 및 제2 전용 통로(또는 제2 타입 통로, 202) 중 적어도 하나로 이루어질 수 있다. 제1 전용 통로 및 제2 전용 통로(201, 202)는 동일 층에 함께 구비되거나, 서로 다른 층에 구비될 수 있다.Meanwhile, as illustrated in FIG. 3, the robot-only passage may be formed of at least one of a first-only passage (or a first-type passage, 201) and a second-only passage (or a second-type passage, 202). The first-only passage and the second-only passage (201, 202) may be provided together on the same floor or on different floors.

또 다른 예로서, 도 2 및 도 3에 도시된 것과 같이, 건물(1000)에는 로봇의 수직 방향으로의 이동을 지원하는 이동 수단(204, 205)이 구비될 수 있다. 이러한 이동 수단(204, 205)은 엘리베이터(elevator) 또는 에스컬레이터(escalator) 중 적어도 하나를 포함할 수 있다. 로봇은 건물(1000)에 구비된 엘리베이터(204) 또는 에스컬레이터(205)를 이용하여, 서로 다른 층 사이를 이동할 수 있다.As another example, as illustrated in FIGS. 2 and 3, the building (1000) may be equipped with a moving means (204, 205) that supports vertical movement of the robot. The moving means (204, 205) may include at least one of an elevator or an escalator. The robot may move between different floors using the elevator (204) or the escalator (205) equipped in the building (1000).

한편, 이러한 엘리베이터(204) 또는 에스컬레이터(205)는 로봇 전용으로 이루어지거나, 사람과 함께 이용하는 공용으로 이루어질 수 있다.Meanwhile, these elevators (204) or escalators (205) may be for robot use only or may be for shared use with people.

예를 들어, 건물(1000)에는 로봇 전용 엘리베이터 또는 공용 엘리베이터 중 적어도 하나가 포함될 수 있다. 마찬가지로, 나아가, 건물(1000)에는 로봇 전용 에스컬레이터 또는 공용 에스컬레이터 중 적어도 하나가 포함될 수 있다. For example, the building (1000) may include at least one of a robot-only elevator or a public elevator. Likewise, further, the building (1000) may include at least one of a robot-only escalator or a public escalator.

한편, 건물(1000)은 수직 방향 이동과 수평 방향 이동에 모두 활용될 수 있는 형태의 이동 수단이 구비될 수 있다. 예를 들어, 무빙워크(moving walkway) 형태의 이동 수단이 로봇에게 층 내에서 수평 방향 이동을 지원하거나, 층 간에서 수직 방향 이동을 지원할 수 있다.Meanwhile, the building (1000) may be equipped with a means of movement that can be utilized for both vertical and horizontal movement. For example, a means of movement in the form of a moving walkway may support horizontal movement of the robot within a floor or vertical movement between floors.

로봇은 자체적인 제어 또는 클라우드 서버(20)에 의한 제어 하에, 수평 방향 또는 수직 방향으로 건물(1000) 내를 이동할 수 있으며, 이때, 로봇의 이동을 지원하는 다양한 설비를 이용하여, 건물(1000) 내를 이동할 수 있다.The robot can move within the building (1000) in a horizontal or vertical direction under its own control or under the control of a cloud server (20), and at this time, the robot can move within the building (1000) using various facilities that support the movement of the robot.

나아가, 건물(1000)에는 건물(1000) 또는 건물(1000)내 특정 영역으로의 출입을 제어하는 출입문(206, 또는 자동문) 및 출입 통제 게이트(gate, 207) 중 적어도 하나를 포함할 수 있다. 출입문(206) 및 출입 통제 게이트(207) 중 적어도 하나는 로봇이 이용 가능하도록 이루어질 수 있다. 로봇은 클라우드 서버(20)의 제어 하에 출입문(또는 자동문, 206) 또는 출입 통제 게이트(207)를 통과하도록 이루어질 수 있다.Furthermore, the building (1000) may include at least one of an entrance door (206, or automatic door) and an access control gate (gate, 207) that control access to the building (1000) or a specific area within the building (1000). At least one of the entrance door (206) and the access control gate (207) may be configured to be accessible to a robot. The robot may be configured to pass through the entrance door (or automatic door, 206) or the access control gate (207) under the control of the cloud server (20).

한편, 출입 통제 게이트(207)는 다양하게 명명될 수 있으며, 스피드 게이트(speed gate)등으로 명명될 수 있다.Meanwhile, the access control gate (207) may be named in various ways, such as a speed gate.

나아가, 건물(1000)에는, 로봇이 대기하는 대기 공간에 해당하는 대기 공간 설비(208), 로봇의 충전을 위한 충전 설비(209), 로봇의 세척을 위한 세척 설비(210)가 더 포함될 수 있다.In addition, the building (1000) may further include a waiting space facility (208) corresponding to a waiting space where the robot waits, a charging facility (209) for charging the robot, and a cleaning facility (210) for cleaning the robot.

나아가, 건물(1000)에는 로봇이 제공하는 특정 서비스에 특화된 설비(211)가 포함될 수 있으며, 예를 들어 배송 서비스를 위한 설비가 포함될 수 있다.Furthermore, the building (1000) may include facilities (211) specialized for specific services provided by the robot, for example facilities for delivery services.

또한, 건물(1000)에는 로봇을 모니터링하기 위한 설비가 포함될 수 있으며(도면부호 212 참조), 이러한 설비의 예로는 다양한 센서들(예를 들어, 카메라(또는 이미지 센서, 121)가 존재할 수 있다.Additionally, the building (1000) may include equipment for monitoring the robot (see drawing symbol 212), examples of which may include various sensors (e.g., cameras (or image sensors, 121).

도 2 및 도 3과 함께 살펴본 것과 같이, 본 발명에 따른 건물(1000)에는 서비스 제공, 로봇의 이동, 주행, 기능 유지, 청결 유지 등을 위한 다양한 설비들이 구비될 수 있다.As seen with reference to FIGS. 2 and 3, the building (1000) according to the present invention may be equipped with various facilities for providing services, moving the robot, driving, maintaining functions, maintaining cleanliness, etc.

한편, 도 4에 도시된 것과 같이, 본 발명에 따른 건물(1000)은 클라우드 서버(20), 로봇(R), 설비 인프라(200)와 상호 연결되어, 건물(1000) 내에서 로봇들이 다양한 서비스를 제공함은 물론, 이를 위하여 설비들을 적절하게 이용하도록 할 수 있다.Meanwhile, as illustrated in FIG. 4, a building (1000) according to the present invention is interconnected with a cloud server (20), a robot (R), and equipment infrastructure (200), so that the robots can provide various services within the building (1000) and use the equipment appropriately for this purpose.

여기에서, “상호 연결”된다고 함은, 건물 내에서 제공되는 서비스, 로봇의 이동, 주행, 기능 유지, 청결 유지 등과 관련된 다양한 데이터, 제어명령이 네트워크(또는 통신망)을 통하여 적어도 하나의 주체에서 다른 적어도 하나의 주체로 단방향 또는 쌍방향으로 송수신되는 것을 의미할 수 있다.Here, “interconnected” may mean that various data and control commands related to services provided within a building, movement, driving, function maintenance, and cleaning of the robot, etc. are transmitted and received unidirectionally or bidirectionally from at least one entity to at least one other entity through a network (or communication network).

여기에서, 주체는, 건물(1000), 클라우드 서버(20), 로봇(R), 설비 인프라(200) 등이 될 수 있다.Here, the subject can be a building (1000), a cloud server (20), a robot (R), facility infrastructure (200), etc.

나아가, 설비 인프라(200)는 도 2 및 도 3과 함께 살펴본 다양한 설비들(도면부호 201 내지 213 참조) 각각 및 이들을 제어하는 제어 시스템(201a, 202a, 203a, 204a, …) 중 적어도 하나를 포함할 수 있다.Furthermore, the facility infrastructure (200) may include at least one of the various facilities (see drawing

건물(1000)을 주행하는 로봇(R)은 네트워크(40)를 통하여, 클라우드 서버(20)와 통신하도록 이루어지며, 클라우드 서버(20)와의 제어 하에 건물(1000) 내에서 서비스를 제공할 수 있다.A robot (R) running in a building (1000) is configured to communicate with a cloud server (20) via a network (40) and can provide services within the building (1000) under the control of the cloud server (20).

보다 구체적으로, 건물(1000)은 건물(1000)에 구비된 다양한 설비들과 통신하거나, 설비들을 직접적으로 제어하기 위한 건물 시스템(1000a)을 포함할 수 있다. 도 4에 도시된 것과 같이, 건물 시스템(1000a)은 통신부(110), 센싱부(120), 출력부(130), 저장부(140) 및 제어부(150)를 포함할 수 있다.More specifically, the building (1000) may include a building system (1000a) for communicating with various facilities provided in the building (1000) or directly controlling the facilities. As illustrated in FIG. 4, the building system (1000a) may include a communication unit (110), a sensing unit (120), an output unit (130), a storage unit (140), and a control unit (150).

통신부(110)는 건물(1000) 내에서 유선 통신망 및 무선 통신망 중 적어도 하나를 형성함으로써, i)클라우드 서버(20)와 로봇(R) 사이, ii)클라우드 서버(20)와 건물(1000) 사이, iii)클라우드 서버(20)와 설비 인프라(200) 사이, iv)설비 인프라(200)와 로봇(R) 사이, v)설비 인프라(200)와 건물(1000) 사이를 연결할 수 있다. 즉, 통신부(110)는 서로 다른 주체 간에 통신의 매개체 역할을 수행할 수 있다. 이러한 통신부(110)는 기지국, 공유기 등으로도 명명될 수 있으며, 통신부(110)는 건물(1000) 내에서, 로봇(R), 클라우드 서버(20), 설비 인프라(200)가 상호 통신할 수 있도록 통신망 또는 네트워크를 형성할 수 있다.The communication unit (110) forms at least one of a wired communication network and a wireless communication network within the building (1000), thereby connecting i) between the cloud server (20) and the robot (R), ii) between the cloud server (20) and the building (1000), iii) between the cloud server (20) and the facility infrastructure (200), iv) between the facility infrastructure (200) and the robot (R), and v) between the facility infrastructure (200) and the building (1000). That is, the communication unit (110) can act as a medium for communication between different entities. This communication unit (110) can also be referred to as a base station, a router, etc., and the communication unit (110) can form a communication network or network so that the robot (R), the cloud server (20), and the facility infrastructure (200) can communicate with each other within the building (1000).

한편, 본 명세서에서, 건물(1000)과 통신망을 통해 연결된다고 함은, 건물 시스템(1000a)에 포함된 구성요소 중 적어도 하나와 연결됨을 의미할 수 있다.Meanwhile, in this specification, being connected to a building (1000) via a communication network may mean being connected to at least one of the components included in the building system (1000a).

도 5에 도시된 것과 같이, 건물(1000)에 배치되는 복수의 로봇들(R)은 통신부(110)를 통해 형성되는 유선 통신망 및 무선 통신망 중 적어도 하나를 통하여, 클라우드 서버(20)와 통신을 수행함으로써, 클라우드 서버(20)에 의해 원격 제어되도록 이루어질 수 있다. 이러한 유선 통신망 또는 무선 통신망과 같은 통신망은 네트워크(40)라고 이해되어질 수 있다.As illustrated in FIG. 5, a plurality of robots (R) placed in a building (1000) can be remotely controlled by a cloud server (20) by performing communication with the cloud server (20) through at least one of a wired communication network and a wireless communication network formed through a communication unit (110). Such a communication network, such as a wired communication network or a wireless communication network, can be understood as a network (40).

이와 같이, 건물(1000), 클라우드 서버(20), 로봇(R) 및 설비 인프라(200)는 건물(1000)내에 형성되는 통신망에 근거하여 네트워크(40)를 형성할 수 있다. 로봇(R)은 이러한 네트워크에 기반하여, 클라우드 서버(20)의 제어 하에 건물(1000)내에 구비된 다양한 설비를 이용하여, 할당된 임무에 해당하는 서비스를 제공할 수 있다.In this way, the building (1000), the cloud server (20), the robot (R), and the equipment infrastructure (200) can form a network (40) based on the communication network formed within the building (1000). Based on this network, the robot (R) can provide a service corresponding to an assigned task by utilizing various equipment provided within the building (1000) under the control of the cloud server (20).

한편, 설비 인프라(200)는 도 2 및 도 3과 함께 살펴본 다양한 설비들(도면부호 201 내지 213 참조) 각각 및 이들을 제어하는 제어 시스템(201a, 202a, 203a, 204a, …) 중 적어도 하나를 포함할 수 있다(이러한 제어 시스템은 “제어 서버”로도 명명될 수 있다).Meanwhile, the facility infrastructure (200) may include at least one of the various facilities (see drawing

도 4에 도시된 것과 같이, 서로 다른 종류의 설비들은 고유의 제어 시스템을 구비할 수 있다. 예를 들어, 로봇 통로(또는 로봇 전용 통로, 로봇 도로, 로봇 전용 도로, 201, 202, 203)의 경우, 로봇 통로(201, 202, 203)를 각각 독립적으로 제어하기 위한 제어 시스템(201a, 202a, 203a)이 존재하고, 엘리베이터(또는 로봇 전용 엘리베이터, 204)의 경우, 엘리베이터(204)를 제어하기 위한 제어 시스템(204)이 존재할 수 있다.As illustrated in FIG. 4, different types of equipment may have their own control systems. For example, in the case of a robot passageway (or a robot-only passageway, a robot road, a robot-only road, 201, 202, 203), there may be a control system (201a, 202a, 203a) for independently controlling each of the robot passageways (201, 202, 203), and in the case of an elevator (or a robot-only elevator, 204), there may be a control system (204) for controlling the elevator (204).

이러한, 설비들을 제어하기 위한 고유의 제어 시스템들은 클라우드 서버(20), 로봇(R), 건물(1000) 중 적어도 하나와 통신하여, 로봇(R)이 설비를 이용하도록 각각의 설비에 대한 적절한 제어를 수행할 수 있다.These unique control systems for controlling the facilities can communicate with at least one of the cloud server (20), the robot (R), and the building (1000) to perform appropriate control of each facility so that the robot (R) can use the facility.

한편, 각각의 설비 제어 시스템(201a, 202a, 203a, 204a, …)에 포함된 센싱부(201b, 202b, 203b, 204b, …)는, 설비 자체에 구비되어, 설비와 관련된 다양한 정보를 센싱하도록 이루어질 수 있다. Meanwhile, the sensing units (201b, 202b, 203b, 204b, ...) included in each facility control system (201a, 202a, 203a, 204a, ...) may be provided in the facility itself and configured to sense various information related to the facility.

나아가, 각각의 설비 제어 시스템(201a, 202a, 203a, 204a, …)에 포함된 제어부(201c, 202c, 203c, 204c, …)는 각각의 설비의 구동을 위한 제어를 수행하며, 클라우드 서버(20)와의 통신을 통하여, 로봇(R)이 설비를 이용하도록 적절한 제어를 수행할 수 있다. 예를 들어, 엘리베이터(204)의 제어 시스템(204b)은, 클라우드 서버(20)와의 통신을 통해, 로봇(R)이 엘리베이터(204)에 탑승하도록 로봇(R)이 위치한 층에, 엘리베이터(204)가 정차하도록 엘리베이터(204)를 제어할 수 있다.Furthermore, the control unit (201c, 202c, 203c, 204c, ...) included in each facility control system (201a, 202a, 203a, 204a, ...) performs control for driving each facility, and can perform appropriate control so that the robot (R) can use the facility through communication with the cloud server (20). For example, the control system (204b) of the elevator (204) can control the elevator (204) to stop at the floor where the robot (R) is located so that the robot (R) can board the elevator (204) through communication with the cloud server (20).

각각의 설비 제어 시스템(201a, 202a, 203a, 204a, …)에 포함된 제어부(201c, 202c, 203c, 204c, …) 중 적어도 일부는 각각의 설비(201, 202, 203, 204, …)와 함께 건물(1000)내에 위치하거나, 건물(1000)의 외부에 위치할 수 있다.At least some of the control units (201c, 202c, 203c, 204c, ...) included in each facility control system (201a, 202a, 203a, 204a, ...) may be located within the building (1000) together with each facility (201, 202, 203, 204, ...) or may be located outside the building (1000).

나아가, 본 발명에 따른 건물(1000)에 포함된 설비들 중 적어도 일부는, 클라우드 서버(20)에 의해 제어되거나, 건물(1000)의 제어부(150)에 의하여 제어되는 것 또한 가능하다. 이 경우, 설비는 별도의 설비 제어 시스템을 구비하지 않을 수 있다.Furthermore, at least some of the facilities included in the building (1000) according to the present invention may be controlled by a cloud server (20) or by a control unit (150) of the building (1000). In this case, the facilities may not be equipped with a separate facility control system.

이하의 설명에서는 각각의 설비가 고유의 제어 시스템을 구비하는 것을 예를 들어 설명하도록 하나, 위에서 언급한 것과 같이, 설비를 제어하기 위한 제어 시스템의 역할은 클라우드 서버(20) 또는 건물(1000)의 제어부(150)에 의해 대체될 수 있음은 물론이다. 이 경우, 본 명세서에서 설명되는 설비 제어 시스템의 제어부(201c, 202c, 203c, 204c, …)의 용어는, 클라우드 서버(20) 또는 제어부(150, 또는 건물의 제어부(150))의 용어로 대체되어 표현될 수 있음은 물론이다.In the following description, each facility is provided with an example of having its own control system. However, as mentioned above, it goes without saying that the role of the control system for controlling the facility can be replaced by the control unit (150) of the cloud server (20) or the building (1000). In this case, it goes without saying that the term of the control unit (201c, 202c, 203c, 204c, ...) of the facility control system described in this specification can be replaced with the term of the cloud server (20) or the control unit (150, or the control unit (150) of the building.

한편, 도 4에서 각각의 설비 제어 시스템(201a, 202a, 203a, 204a, …)의 구성요소들은 일 예에 대한 것으로서, 각각의 설비 특성에 따라 다양한 구성요소들이 추가되거나, 제외될 수 있다.Meanwhile, the components of each facility control system (201a, 202a, 203a, 204a, …) in FIG. 4 are for example only, and various components may be added or excluded depending on the characteristics of each facility.

이와 같이, 본 발명에서는 로봇(R), 클라우드 서버(20) 및 설비 제어 시스템(201a, 202a, 203a, 204a, …)이 설비 인프라를 이용하여 건물(1000) 내에서 다양한 서비스를 제공한다. In this way, in the present invention, a robot (R), a cloud server (20), and a facility control system (201a, 202a, 203a, 204a, …) provide various services within a building (1000) by utilizing the facility infrastructure.

이 경우에, 로봇(R)은 주로 건물 내를 주행하여 다양한 서비스를 제공하게 된다. 이를 위하여, 로봇(R)은 바디부, 구동부, 센싱부, 통신부, 인터페이스부 및 전원공급부 중 적어도 하나를 구비할 수 있다.In this case, the robot (R) mainly drives inside the building to provide various services. To this end, the robot (R) may be equipped with at least one of a body part, a driving part, a sensing part, a communication part, an interface part, and a power supply part.

바디부는 외관을 이루는 케이스(케이싱, 하우징, 커버 등)를 포함한다. 본 실시예에서, 케이스는 복수의 파트로 구분될 수 있으며, 케이스에 의하여 형성된 공간에는 각종 전자부품들이 내장된다. 이 경우에, 바디부는 본 발명에서 예시하는 다양한 서비스에 따라 서로 다른 형태로 이루어질 수 있다. 예를 들어, 배송 서비스를 제공하는 로봇의 경우에, 바디부의 상부에 물건을 보관하는 수용함이 구비될 수 있다. 다른 예로서, 청소 서비스를 제공하는 로봇의 경우에 바디부의 하부에 진공을 이용하여 먼지를 흡입하는 흡입구가 구비될 수 있다.The body part includes a case (casing, housing, cover, etc.) forming the exterior. In the present embodiment, the case can be divided into a plurality of parts, and various electronic components are built into the space formed by the case. In this case, the body part can be formed in different shapes according to various services exemplified in the present invention. For example, in the case of a robot providing a delivery service, a storage compartment for storing items can be provided on the upper part of the body part. As another example, in the case of a robot providing a cleaning service, a suction port for sucking dust using a vacuum can be provided on the lower part of the body part.

구동부는 클라우드 서버(20)에서 전송하는 제어 명령에 따른 특정 동작을 수행하도록 이루어진다. The driving unit is configured to perform specific operations according to control commands transmitted from the cloud server (20).

구동부는 주행과 관련하여 로봇의 바디부가 특정 공간 내를 이동할 수 있는 수단을 제공한다. 보다 구체적으로, 구동부는 모터 및 복수의 바퀴를 포함하며, 이들이 조합되어, 로봇(R)을 주행, 방향 전환, 회전시키는 기능을 수행한다. 다른 예로서, 구동부는 주행 외의 다른 동작, 예를 들어 픽업 등의 수행을 위하여 엔드 이펙터, 매니퓰레이터, 액추에이터 중 적어도 하나를 구비할 수 있다. The drive unit provides a means for the body of the robot to move within a specific space in relation to driving. More specifically, the drive unit includes a motor and a plurality of wheels, which are combined to perform the functions of driving, changing direction, and rotating the robot (R). As another example, the drive unit may include at least one of an end effector, a manipulator, and an actuator to perform other operations than driving, such as picking up.