KR101446143B1 - CCTV Environment based Security Management System for Face Recognition - Google Patents

CCTV Environment based Security Management System for Face Recognition Download PDFInfo

- Publication number

- KR101446143B1 KR101446143B1 KR1020130001692A KR20130001692A KR101446143B1 KR 101446143 B1 KR101446143 B1 KR 101446143B1 KR 1020130001692 A KR1020130001692 A KR 1020130001692A KR 20130001692 A KR20130001692 A KR 20130001692A KR 101446143 B1 KR101446143 B1 KR 101446143B1

- Authority

- KR

- South Korea

- Prior art keywords

- image

- face

- feature data

- recognition

- cctv

- Prior art date

- Legal status (The legal status is an assumption and is not a legal conclusion. Google has not performed a legal analysis and makes no representation as to the accuracy of the status listed.)

- Active

Links

Images

Classifications

-

- G—PHYSICS

- G06—COMPUTING OR CALCULATING; COUNTING

- G06T—IMAGE DATA PROCESSING OR GENERATION, IN GENERAL

- G06T7/00—Image analysis

- G06T7/10—Segmentation; Edge detection

- G06T7/168—Segmentation; Edge detection involving transform domain methods

Landscapes

- Engineering & Computer Science (AREA)

- Computer Vision & Pattern Recognition (AREA)

- Physics & Mathematics (AREA)

- General Physics & Mathematics (AREA)

- Theoretical Computer Science (AREA)

- Image Analysis (AREA)

- Collating Specific Patterns (AREA)

Abstract

카메라를 통해 입력되는 영상을 실시간으로 영상을 처리하여 얼굴인식을 수행하여 등록자/미등록자를 인식하는 감시 로봇과, 감시 로봇으로 전송되는 영상을 수신하여 유사도를 평가하는 관제 서버에 의하여 수행되는 CCTV 환경에서의 얼굴 인식 기반 보안 관리 방법에 관한 것으로서, (a) 카메라를 통해 입력되는 영상으로부터 인물 이미지를 추출하는 단계; (b) 상기 인물 이미지로부터 얼굴 영역을 검출하는 단계; (c) 상기 얼굴 영역의 특징 데이터를 추출하는 단계; (d) 상기 특징 데이터가 추출되면 그 추출된 특징 데이터를 관제 서버로 전송하는 단계; 및, (e) 상기 관제 서버로부터 상기 추출된 특징 데이터와 기등록된 특징 데이터 간의 유사도 평가에 따른 인식결과를 수신하는 단계를 포함하는 구성을 마련한다.

상기와 같은 얼굴 인식 기반 보안 관리 방법에 의하여, CCTV 환경에서 개인 프라이버시를 최대한 보호할 수 있으며 범용적으로 적용될 수 있는 얼굴 검출 및 인식시스템의 보안 프레임워크 기술을 제시할 수 있다.

A surveillance robot that recognizes the registrant / non-registrant by performing face recognition by processing an image input through a camera in real time, and a control server that receives the image transmitted by the surveillance robot and evaluates the similarity, (A) extracting a portrait image from an image input through a camera; (b) detecting a face region from the portrait image; (c) extracting feature data of the face region; (d) if the feature data is extracted, transmitting the extracted feature data to a control server; And (e) receiving a recognition result based on the similarity evaluation between the extracted feature data and pre-registered feature data from the control server.

According to the face recognition based security management method as described above, it is possible to protect personal privacy in a CCTV environment as much as possible, and present a security framework technique of a face detection and recognition system which can be applied universally.

Description

본 발명은 감시 로봇에서 카메라를 통해 입력된 영상을 실시간으로 처리하여 등록자/미등록자를 인식하고, 각 상황에 맞는 영상을 저장하여 관제 서버로 전송하며, 전송된 기록영상은 저장소에 보관하고, 관계자에게 검색 기능을 통해 저장된 영상을 검색 후 프리뷰(preview)를 제공하는 CCTV 환경에서의 얼굴 인식 기반 보안 관리 시스템 및 방법에 관한 것이다.The surveillance robot recognizes the registrant / non-registrant by processing the image input through the camera in real time, stores the image corresponding to each situation, transmits the image to the control server, stores the transmitted recorded image in a storage, The present invention relates to a face recognition based security management system and method in a CCTV environment that provides a preview after retrieving a stored image through a search function.

또한, 본 발명은 입력된 영상에서 얼굴을 검출하고, 검출된 얼굴에서 인식을 위한 특징 데이터를 추출하여 등록되어진 특징 데이터들과 유사도 평가 과정을 거처 누구인지를 인식하는 CCTV 환경에서의 얼굴 인식 기반 보안 관리 시스템 및 방법에 관한 것이다.

The present invention also relates to a method and apparatus for detecting a face in an input image, extracting feature data for recognition from the detected face, Management system and method.

바이오인식 융합기술 환경을 위해 국내에서는 외교부 전자여권 발급 등 바이오인식 기반 국가 인프라 구축사업이 본격적으로 착수됨에 따라, 구축사업의 신뢰성 및 안전성 제공이 절대적으로 우선시되어야 한다. 또한 바이오인식 정보와 개인 식별 정보가 결합되어 운영되는 상황에서 바이오인식 정보 제공자의 개인 프라이버시 정보를 보호할 수 있는 메커니즘에 대한 시급한 시장 수요예측에 따른 선도성 기술개발이 필요한 시점에 이르렀다.For the bio-aware fusion technology environment, the establishment of national infrastructure based on biometrics, such as the issuance of e-passports by Ministry of Foreign Affairs, is being launched in earnest. In addition, in a situation where biometric information and personal identification information are combined and operated, it is necessary to develop a leading technology according to an urgent market demand prediction for a mechanism for protecting personal privacy information of a biometric information provider.

특히 CCTV를 활용하여 실시간 객체들의 위협 탐지 및 추적, 사고나 범죄 증거 수집 등의 응용이 넓어짐에 따라 유무선 정보통신환경에서의 텔레바이오메트릭스(Telebiometrics) 응용기술 및 CCTV 등 물리적 보안기술과 결합한 융합기술을 개발하는 신규 기술 개발 시도가 절대적으로 필요한 시점에 이르렀다. 즉, 국내 바이오인식 기반 국가인프라 구축사업에 신뢰성 제공을 위한 시험기술 표준 개발 및 표준화가 필요한 현 시점에서 CCTV 기반의 얼굴 검출 및 인식시스템 보안 프레임워크 모델을 모델링하고, 이를 구현하는 것은 국가 정보보호 기반 및 바이오인식 표준개발을 통안 신뢰성 및 안전성 제공을 위해 시급한 필요한 과제이다.Especially, CCTV is used to detect and track threats of real-time objects and to collect accidents and criminal evidence. Therefore, convergence technology combined with telebiometrics application technology and physical security technologies such as CCTV in wired and wireless information communication environment It is absolutely necessary to attempt to develop new technologies to develop. In other words, the development and standardization of the test technology standard to provide reliability in the national infrastructure construction project based on domestic bio-recognition is required, and modeling and implementing the CCTV-based face detection and recognition system security framework model is required And development of biometrics standards are urgently needed to provide reliability and safety in the pipeline.

현재 ISO의 SC29/WG11(MPEG)과 SC37의 두 그룹이 얼굴 검출 및 인식과 관련된 표준화를 추진 중에 있다. 현재까지 얼굴 검출 및 인식 기술은 괄목할 성과를 거두었으나 CCTV와 융합된 환경에서 얼굴 검출 및 인식 기술에 관한 연구는 지금부터 시작되는 시점에 있다. 현재 국내에 설치된 CCTV로 촬영된 얼굴만으로는 직접적으로 범죄 성향을 보이는 범인의 인적 특성을 밝혀낼 수가 없을 뿐만 아니라, 검출 및 인식된 얼굴이라도 얼굴 인식 속도의 느림과 조명 등의 빛의 영향 문제로 인한 인식률 저하, 다양한 얼굴 포즈 및 표정 등으로 인해 인식률 저하 및 범인 검거 등에 취약하기에 극복되어야 하는 난제들이 상당히 많이 존재한다.Currently, two groups of ISO SC29 / WG11 (MPEG) and SC37 are pursuing standardization related to face detection and recognition. Face Detection and Recognition Technology has achieved remarkable results so far, but research on face detection and recognition technology in the environment that is fused with CCTV is starting from now on. In this paper, we propose a method of detecting the face of a criminal who has a criminal tendency. In this method, There are many problems that must be overcome because they are vulnerable to deterioration of recognition rate and arrest of the criminal because of various facial pose and facial expression.

이와 같은 CCTV 기반 얼굴 검출 및 인식 기술의 한계를 극복하기 위해 최근 조명에 강인한 IR 기반 얼굴 인식 기술 등 다양한 얼굴 검출 및 인식 기술들이 새롭게 연구되고 있다. 특히 고성능 얼굴 인식 시스템 개발을 위해서는 우수한 얼굴 검출 기술 개발이 우선적으로 개발되어져야 함을 최근 연구를 통해 발견되고 있다. 하지만 현재의 얼굴 검출 방법은 영상에서 얼굴이 있는 위치를 찾아내는 것으로 얼굴 인식에서의 문제점들과 더불어 얼굴 판단, 크기가 다른 얼굴 찾기, 정확한 얼굴 영역 찾기, 얼굴 검출 속도, 결과 조합 등 해결되어야 할 많은 문제들이 존재한다. CCTV(Closed Circuit Television)라 함은 일정한 공간에 설치된 촬영기기를 통해 수집한 화상정보를 폐쇄적인 유/무선 전송로를 통하여 전송 후 특정인만이 수신할 수 있는 통신장비 일체를 일컬어 말한다. 현재 CCTV에 의한 여러 보안 위협이 발생하고 있음에도 불구하고 CCTV 설치ㅇ운영에 대한 관계 법률이 제대로 정립되어 있지 않으며 체계적인 CCTV 설치ㅇ운영 및 관리가 이루어지지 않고 있다.In order to overcome the limitations of CCTV based face detection and recognition technology, various face detection and recognition technologies such as IR-based face recognition technology which is robust to illumination have been newly researched. Especially, it is found in recent researches that the development of excellent face detection technology should be developed first for developing a high-performance face recognition system. However, the current face detection method is to detect the position of the face in the image. In addition to the problems in face recognition, there are many problems to be solved such as face judgment, face detection of different sizes, accurate face region search, face detection speed, Lt; / RTI > CCTV (Closed Circuit Television) refers to a communication device that only a specific person can receive image information collected through a photographing device installed in a certain space through a closed wired / wireless transmission path and then receive it. Although there are various security threats caused by CCTV, the related law on the installation of CCTV is not properly established and the systematic CCTV installation is not operated and managed.

CCTV 시스템은 영상감시 서버에 연결된 여러 종류의 다양한 유무선 CCTV 카메라들로 구성한다. 또한 CCTV 시스템은 USB 또는 IP 카메라들도 지원한다. 특히 무선 Wi-Fi 카메라의 경우 아주 쉽고 저비용으로 원하는 임의의 위치에 설치가 가능하다. 오래전부터 사용되어 오고 있는 아날로그 카메라들 또한 사용 가능하며 전송된 아날로그 영상을 영상감시 서버는 코덱 알고리즘을 이용하여 디지털화하는 능력도 가진다. 일반적으로 영상은 서버에 의해 목적에 맞는 형태로 처리되며, 결과 영상들은 모바일 폰, 데스크톱 PC, 노트북/랩탑, PDA 등 다양한 클라이언트들에게 인터넷 망 등 유무선 통신망을 통해 전송되며, 해당 클라이언트들은 수신한 영상을 인증, ID 관리, 범죄 예방, 증거 수집, 테러 예방, 접근 관리 등 그들의 목적에 맞게 활용하게 된다.The CCTV system consists of various kinds of wired and wireless CCTV cameras connected to the video surveillance server. The CCTV system also supports USB or IP cameras. Especially for wireless Wi-Fi cameras, it is very easy and low cost to install in any location you want. Analog cameras that have been in use for a long time are also available, and the video surveillance server has the ability to digitize transmitted analog images using codec algorithms. In general, images are processed by the server in a form suitable for the purpose, and the resulting images are transmitted to various clients such as a mobile phone, a desktop PC, a laptop / laptop, and a PDA through a wired / wireless communication network such as the Internet, To use them for their purposes, such as authentication, identity management, crime prevention, evidence collection, terror prevention, and access control.

위와 같은 기본적인 보호 기법들 외에 최근에 연구 된 CCTV 환경에 응용 가능한 7가지의 바이오 인식 정보 보호 기법들이 있다.In addition to the basic protection schemes described above, there are seven types of biometrics information protection schemes that can be applied to the recently studied CCTV environment.

예를 들어, 연구자 Newton 등은 마스킹 기법은 다양한 멀티미디어 응용에 적용하기에는 한계를 가짐을 지적하였다. 이에 대한 해결책으로 미식별 얼굴 특징(de-identify facial features) 기법을 제안하였다. 이 방법은 알려진 얼굴 인식 소프트웨어로 분해된 얼굴(degraded faces)을 올바르게 식별할 수 없게 하는 기법으로 강한 프라이버시 제공이 가능하다. 하지만 이 방법의 문제점은 추가적인 저장 공간 요구와 전체 시스템 무결성 및 보안 관리 문제가 발생한다. For example, researcher Newton et al. Pointed out that masking techniques have limitations in applying them to various multimedia applications. As a solution to this problem, we proposed a de-identifying facial features technique. This method is able to provide strong privacy because it can not correctly identify degraded faces with known face recognition software. The problem with this method, however, is that additional storage space requirements and overall system integrity and security management issues arise.

일본 Sony사에서는 피부(skin) 영역 감지 알고리즘을 이용한 감지 영역에 대한 임의의 색상으로 변경하여 특정 중요 부위를 통해 인종, 민족 식별 등을 방지하는 보호 기법을 개발하였다. 하지만 이 방법의 문제점은 여전히 얼굴 영역 식별은 가능할 뿐만 아니라 인종, 민족 고유의 정보를 눈의 구조, 두개골 모양, 입술 등의 부분 특성 정보로 쉽게 인식이 가능하다는 것이다. Sony Sony developed a protection technique to prevent race and ethnicity discrimination through certain critical areas by changing the color of the detection area using the skin area detection algorithm. However, the problem of this method is that face region identification is not only possible but also it can easily recognize the ethnic and ethnic information by partial characteristic information such as eye structure, skull shape, and lip.

연구자 Senior 등은 프라이버시 보장 영상 콘솔(privacy preserving video console)을 제안하였다. Senior 등은 컴퓨터 비전(computer vision) 기술과 암호학(cryptography) 기술을 적용하여 CCTV 감시 영상 내용을 안전하게 관리할 수 있는 프레임워크를 제안하였다. 즉, 먼저 영상 정보를 암호화하여 저장한 후, 요청한 영상 영역만 다시 복원하거나 사용자의 권한에 따라 특정 개인 정보를 제공하는 기법을 제안하였다. Researchers Senior and others have proposed a privacy preserving video console. Senior and others proposed a framework that can safely manage CCTV surveillance video contents by applying computer vision and cryptography techniques. In other words, after encrypting and storing the image information, the user can restore only the requested image area or provide specific personal information according to the user's authority.

연구자 Boult는 인버터블 암호학적 변형(invertible cryptographic transform) 기법을 사용한 안전한 영상 정보 저장 기법 제안하였다. 이 방법은 먼저 개인정보를 포함하고 있는 프라이버시 영역은 DCT, DWT 등의 손실(lossy) 엔코딩 처리 후 영상 프레임으로부터 잘려(cropped)져, 이후 해당 영역은 DES, AES 등의 임의의 암호 기법으로 암호화되어 저장된 후 최종 엔코딩을 위해 이미지에 다시 맵핑(mapped)되게 된다. 이때 사용된 암호 기법은 주어진 데이터를 완전한 랜덤 스트림으로 변환되기 때문에 잘려진(cropped) 영역은 프라이버시를 강화시켜 완벽한 모호성을 가질 수 있게 된다. 결론적으로 오직 합법적인 비밀키를 가진(법적 권한을 가진) 관리자만이 모호한 영역을 복호화하여 올바른 개인 정보를 제공할 수 있어 강한 보안성을 제공할 수 있다. Researcher Boult proposed a secure image information storage technique using an invertible cryptographic transform technique. In this method, a privacy area containing personal information is first cropped from a video frame after lossy encoding processing such as DCT and DWT, and then the corresponding area is encrypted with an arbitrary encryption technique such as DES or AES And then mapped back to the image for final encoding. In this case, since the cipher technique used is to convert the given data into a complete random stream, the cropped area can be completely ambiguous by enhancing privacy. In conclusion, only administrators with legitimate secret keys (with legal authority) can decrypt the ambiguous domain and provide correct personal information, thus providing strong security.

연구자 Dufaux와 Ebrahimi는 영역 기반 변환 도메인 스크램블링(region -based transform-domain scrambling) 기법을 제안하였다. 이 방법은 먼저 개인 정보 영역들(얼굴 또는 신체)은 컴퓨터 비전 기법으로 영상 프레임상에서 감지되게 된다. 이후 선택 영역은 엔코딩 단계에서 스크램블링 되는데, 이때 DCT나 DWT의 계수(coefficients)를 활용한 플립핑 신호(flipping signs)에 의해 프라이버시 영역은 스크램블링된다. 해당 플립핑(Flipping)은 비밀키에 의해 제어되며 원 영상으로 역변환 된다. 추가적으로 특정 모양의 영역들은 스크램블링 되어 질 때 스크램블링 강도는 플립된 계수(flipped coefficients)의 수를 통해 조절 가능하다. Researchers Dufaux and Ebrahimi proposed a region-based transform-domain scrambling technique. In this method, the personal information areas (face or body) are detected on the image frame by the computer vision technique. The selection area is then scrambled in the encoding step, where the privacy area is scrambled by flipping signs using DCT or DWT coefficients. The corresponding flipping is controlled by the secret key and is inversely transformed into the original image. In addition, the scrambling strength is adjustable through the number of flipped coefficients as regions of a particular shape are scrambled.

연구자 Zhang 등은 민감한 영역에 대응되는 준비된 배경(backgrounds)으로 대체하며 해당 영상 내의 워터마크로서 제거된 영역을 저장하는 기법을 소개하였다. 이 방법에서 해당 영역에 대한 요청이 있을 때 관리자는 소유하고 있는 비밀키로 워터마크를 추출한 후 원 영상 정보로 복원할 수 있게 된다. 추가적으로 영상정보 조작 방지를 위한 영상 헤더 부분에 전자서명을 저장하게 된다. 하지만 이 방법의 문제점은 프레임 비율(rate)이 아주 높아지는 문제점을 가진다. Researcher Zhang et al. Introduced a technique of replacing the prepared backgrounds corresponding to the sensitive region and storing the removed region as a watermark in the corresponding image. In this method, when there is a request for the corresponding area, the administrator can extract the watermark with the secret key that he possesses and restore the original image information. In addition, an electronic signature is stored in the image header portion for preventing manipulation of image information. However, the problem with this method is that the frame rate becomes very high.

연구자 Jonathon Phillips는 프라이버시와 영상 감시 성능과의 역(inverse) 관계에 대해 연구하여 프라이버시 운용 특징 커브(POC: privacy operating characteristic curve)를 제안하였다. 이 방법은 생체 검증 시스템에서 오수락율(FAR: false accept rate) 대 오거부율(FRR: false reject rate)을 측정할 때 사용되는 수신자 운용 커브(ROC: receiver operating curve)를 유추하는 POC 기법을 제안하였다. POC를 사용하여 시스템 관리자는 프라이버시 강도 레벨을 조절 가능한 영상 감시 시스템을 위한 적합한 운용 포인트(operating point)를 선택할 수 있도록 하였다. 이때 POC 커브(curve)는 영상 정보 내에서 프라이버시 강도 조절을 위해 민감한 개인 정보를 숨겨주는 기능을 하게 된다.

Researcher Jonathon Phillips has proposed a privacy operating characteristic curve (POC) by studying the inverse relationship between privacy and video surveillance performance. This method proposes a POC technique to infer the receiver operating curve (ROC) used to measure the false accept rate (FAR) versus the false reject rate (FRR) Respectively. Using the POC, the system administrator can select an appropriate operating point for a video surveillance system that can adjust the privacy strength level. At this time, the POC curve functions to hide sensitive personal information for adjusting the privacy strength in the image information.

한편, 범용으로 사용할 수 있는 안전한 CCTV 기반 얼굴 검출 및 인식시스템 보안 프레임워크 구축을 위하여 반드시 고려 및 해결되어야 할 과제들은 3가지 정도로 요약할 수 있다. 첫째, CCTV를 이용한 영상감시 시스템에서의 개인정보보호를 위한 프레임워크를 개발을 통하여 개인 프라이버시보호를 위한 시스템 운영 및 기술적 방안을 정립할 필요가 있다. 둘째, CCTV를 이용한 고성능 얼굴인식 기술 내 프라이버시 보호 S/W 개발, 그리고 프레임워크의 유효성 확보를 위한 CCTV 용 상황인지 및 프라이버시 보호 방안 제시를 통한, CCTV 용 상황인지 및 프라이버시 보호 S/W 개발이 필요하다. 셋째, CCTV를 이용한 영상감시 시스템에서의 개인정보보호를 위한 표준화 개발을 통하여 ISO/IEC SC27 WG5에서의 CCTV에서의 개인정보보호에 관한 표준안 마련 및 ISO/IEC JTC1 SC27 표준안 도출을 통하여 범용적인 CCTV 기반 얼굴 검출 및 인식시스템 보안 프레임워크 표준화가 필요하다.On the other hand, there are three issues that need to be considered and solved in order to construct security CCTV-based face detection and recognition system security framework that can be used for general purpose. First, it is necessary to establish system operation and technical measures to protect personal privacy through developing a framework for protecting personal information in video surveillance system using CCTV. Second, it is necessary to develop situation awareness and privacy protection S / W for CCTV through development of privacy protection software in high performance face recognition technology using CCTV and presenting situation awareness and privacy protection method for CCTV to secure the effectiveness of framework Do. Third, through the development of standardization for protecting personal information in CCTV video surveillance system, ISO / IEC SC27 WG5 establishes standards for protection of personal information in CCTV and derives ISO / IEC JTC1 SC27 standard, Face detection and recognition System security framework standardization is needed.

요약하면, 범용으로 사용할 수 있는 안전한 CCTV 기반 얼굴 검출 및 인식시스템 보안 프레임워크 구축을 위하여 반드시 해결되어야 할 문제들이 있다. 먼저 CCTV를 이용한 영상감시 시스템에서의 개인정보보호를 위한 프레임워크를 개발을 통하여 개인 프라이버시보호를 위한 시스템 운영 및 기술적 방안을 정립할 필요가 있다. 그리고 CCTV를 이용한 고성능 얼굴인식 기술 내 프라이버시 보호 S/W 개발, 그리고 프레임워크의 유효성 확보를 위한 CCTV 상황인지 및 프라이버시 보호 방안 제시를 통한 CCTV 상황인지 및 프라이버시 보호 S/W 개발이 필요하다. 또한 CCTV를 이용한 영상감시 시스템에서의 개인정보보호를 위한 표준화 개발을 통하여 범용적인 CCTV 기반 얼굴 검출 및 인식시스템 보안 프레임워크 표준화가 필요하다.

In summary, there are some issues that must be solved in order to build a secure CCTV-based face detection and recognition system security framework that can be used universally. First of all, it is necessary to establish system operation and technical measures to protect personal privacy through development of a framework for protecting personal information in video surveillance system using CCTV. Also, it is necessary to develop CCTV situation recognition and privacy protection S / W through the development of privacy protection software in high - performance face recognition technology using CCTV, and CCTV situation recognition and privacy protection scheme to secure the effectiveness of the framework. Also, it is necessary to standardize CCTV - based face detection and recognition system security framework by developing standardization for protection of personal information in CCTV video surveillance system.

본 발명의 목적은 상술한 바와 같은 문제점을 해결하기 위한 것으로, 감시 로봇에서 카메라를 통해 입력된 영상을 실시간으로 처리하여 등록자/미등록자를 인식하고, 각 상황에 맞는 영상을 저장하여 관제 서버로 전송하며, 전송된 기록영상은 저장소에 보관하고, 관계자에게 검색 기능을 통해 저장된 영상을 검색 후 프리뷰(preview)를 제공하는 CCTV 환경에서의 얼굴 인식 기반 보안 관리 시스템 및 방법을 제공하는 것이다.An object of the present invention is to solve the above-mentioned problems, and an object of the present invention is to provide a surveillance robot that realizes a video input through a camera in a surveillance robot to recognize a registrant / And a system and method for security management based on face recognition in a CCTV environment in which a recorded video image is stored in a storage and a preview is searched after retrieving a stored image through a search function to an interested person.

또한, 본 발명의 목적은 입력된 영상에서 얼굴을 검출하고, 검출된 얼굴에서 인식을 위한 특징 데이터를 추출하여 등록되어진 특징 데이터들과 유사도 평가 과정을 거처 누구인지를 인식하는 CCTV 환경에서의 얼굴 인식 기반 보안 관리 시스템 및 방법을 제공하는 것이다.It is another object of the present invention to provide a method and apparatus for detecting a face in an input image, extracting feature data for recognition from the detected face, Based security management system and method.

상기 목적을 달성하기 위해 본 발명은 카메라를 통해 입력되는 영상을 실시간으로 영상을 처리하여 얼굴인식을 수행하여 등록자/미등록자를 인식하는 감시 로봇과, 상기 감시 로봇으로 전송되는 영상을 수신하여 데이터베이스로 보관하는 관제 서버에 의하여 수행되는 CCTV 환경에서의 얼굴 인식 기반 보안 관리 방법에 관한 것으로서, (a) 카메라를 통해 입력되는 영상으로부터 인물 이미지를 추출하는 단계; (b) 상기 인물 이미지로부터 얼굴 영역을 검출하는 단계; (c) 상기 얼굴 영역의 특징 데이터를 추출하는 단계; (d) 상기 특징 데이터가 추출되면 그 추출된 특징 데이터를 관제 서버로 전송하는 단계; 및, (e) 상기 관제 서버로부터 상기 추출된 특징 데이터와 기등록된 특징 데이터 간의 유사도 평가에 따른 인식결과를 수신하는 단계를 포함하는 것을 특징으로 한다.According to an aspect of the present invention, there is provided a surveillance robot including a surveillance robot for recognizing a registrant / a non-registrant by processing images input through a camera in real time to perform face recognition, The present invention relates to a security management method based on face recognition in a CCTV environment performed by a control server, which comprises: (a) extracting a person image from an image input through a camera; (b) detecting a face region from the portrait image; (c) extracting feature data of the face region; (d) if the feature data is extracted, transmitting the extracted feature data to a control server; And (e) receiving recognition result based on the similarity evaluation between the extracted feature data and pre-registered feature data from the control server.

또, 본 발명은 CCTV 환경에서의 얼굴 인식 기반 보안 관리 방법에 있어서, 상기 (b)단계에서, 아다부스트(Adaboost) 검출 기법을 이용하여 분류기를 구하고, 상기 분류기에 의하여 상기 인물 이미지로부터 얼굴 영역을 검출하는 것을 특징으로 한다.According to another aspect of the present invention, there is provided a method for security management based on face recognition in a CCTV environment, the method comprising: obtaining a classifier using an adaboost detection technique in the step (b) Is detected.

또, 본 발명은 CCTV 환경에서의 얼굴 인식 기반 보안 관리 방법에 있어서, 상기 (c)단계는, (c1) 가볼 웨이블릿 변환을 이용하여 상기 얼굴 영역의 이미지로부터 경계선 영상을 구하는 단계; 및, (c2) 상기 경계선 영역을 대상으로 주성분 분석을 적용하여 고유벡터의 영상을 구하고, 상기 고유벡터의 영상으로부터 특징 데이터를 구하는 단계를 포함하는 것을 특징으로 한다.According to another aspect of the present invention, there is provided a method for managing security based on face recognition in a CCTV environment, the method comprising: (c1) obtaining a boundary line image from an image of the face region using wavelet transform; And (c2) obtaining an image of the eigenvector by applying principal component analysis to the boundary region, and obtaining feature data from the image of the eigenvector.

또, 본 발명은 CCTV 환경에서의 얼굴 인식 기반 보안 관리 방법에 있어서, 상기 (c1)단계에서, 상기 얼굴 영역의 이미지에 90도 위상관계가 있는 한 쌍의 가볼(Gabor) 필터를 적용하여 2개의 컨벌루션된 영상을 구하고, 상기 컨벌류션된 영상들을 합하고, 합한 영상에 대하여 가볼 웨이블릿 계수 히스토그램의 평균값을 적용하여 경계선 영상을 구하는 것을 특징으로 한다.According to another aspect of the present invention, there is provided a method for security management based on face recognition in a CCTV environment, wherein a pair of Gabor filters having a phase relationship of 90 degrees with respect to an image of the face region is applied at step (c1) The convolutional image is obtained, the convolutional images are summed, and a boundary line image is obtained by applying an average value of a wavelet coefficient histogram to the summed image.

또, 본 발명은 CCTV 환경에서의 얼굴 인식 기반 보안 관리 방법에 있어서, 상기 컨벌류션된 영상 v1, v2 를 다음 수학식에 의하여 합하는 것을 특징으로 한다.Also, the present invention is a method for security management based on face recognition in a CCTV environment, wherein the convolved images v 1 and v 2 are summed by the following equation.

또, 본 발명은 CCTV 환경에서의 얼굴 인식 기반 보안 관리 방법에 있어서, 상기 유사도 평가는, 상기 추출된 특징 데이터와 상기 기등록된 특징 데이터 간에 유클리디언(Eudlidean) 거리를 계산하고, 그 계산된 거리가 가장 가까운 얼굴 이미지를 맵핑하는 것을 특징으로 한다.

According to another aspect of the present invention, there is provided a security management method based on face recognition in a CCTV environment, wherein the similarity evaluation is performed by calculating an Eudlidean distance between the extracted feature data and the previously registered feature data, And maps an image of the face closest to the distance.

상술한 바와 같이, 본 발명에 따른 CCTV 환경에서의 얼굴 인식 기반 보안 관리 시스템 및 방법에 의하면, CCTV 환경에서 개인 프라이버시를 최대한 보호할 수 있으며 범용적으로 적용될 수 있는 얼굴 검출 및 인식시스템의 보안 프레임워크 기술을 제시하는 효과가 얻어진다.

As described above, according to the face recognition-based security management system and method in the CCTV environment according to the present invention, the security framework of the face detection and recognition system that can protect the privacy of the individual in the CCTV environment and can be applied universally The effect of presenting the technique can be obtained.

도 1은 본 발명의 일실시예에 따른 CCTV 환경에서의 얼굴 인식 기반 보안 관리 시스템을 도시한 블록구성도.

도 2는 도 1에 도시된 감시 로봇의 블록구성도.

도 3은 도 1에 도시된 감시 로봇에 의한 영상 저장 과정을 도시한 흐름도.

도 4는 도 1에 도시된 감시 로봇에 의한 영상 전송 과정을 도시한 흐름도.

도 5는 본 발명에 따른 CCTV 환경에서의 얼굴 인식 기반 보안 방법을 설명하는 흐름도.

도 6은 얼굴 인식 시스템에서 취급되는 한계 요소의 일례를 도시한 것.

도 7은 본 발명에 따른 얼굴 검출 결과의 예들을 도시한 것.

도 8은 본 발명에 따라 얼굴 영상에서 특징을 추출하는 과정을 예시한 것.

도 9는 본 발명에 따라 적용된 Gabor 필터의 예.

도 10은 본 발명에 따라 얼굴의 주요요소 성분들의 경계선을 검출한 결과의 예.

도 11은 본 발명에 따라 특징을 추출한 특징 추출 맵 결과의 예.

도 12는 본 발명에 따라 AT&T Face DB를 이용한 주성분 분석에 의한 고유벡터(Eigen face)의 예.

도 13은 본 발명에 따라 특징점(Landmarks) 추출 결과물의 예.

도 14는 본 발명의 시뮬레이션에 따른 얼굴 검출의 결과 예시.1 is a block diagram illustrating a face recognition-based security management system in a CCTV environment according to an embodiment of the present invention;

Fig. 2 is a block diagram of the monitoring robot shown in Fig. 1. Fig.

FIG. 3 is a flowchart illustrating an image storing process by the monitoring robot shown in FIG. 1;

FIG. 4 is a flowchart illustrating a video transmission process by the surveillance robot shown in FIG. 1;

5 is a flowchart illustrating a security method based on face recognition in a CCTV environment according to the present invention.

Fig. 6 shows an example of a limitation element handled in the face recognition system. Fig.

7 shows examples of face detection results according to the present invention.

FIG. 8 illustrates a process of extracting features from a facial image according to the present invention.

Figure 9 is an example of a Gabor filter applied in accordance with the present invention.

10 is an example of a result of detecting a boundary line of major component elements of a face according to the present invention.

11 is an example of a feature extraction map result in which features are extracted according to the present invention.

12 is an example of an eigenface by principal component analysis using AT & T Face DB according to the present invention.

FIG. 13 is an example of a Landmarks extraction result according to the present invention. FIG.

14 illustrates an example of the result of face detection according to the simulation of the present invention.

이하, 본 발명의 실시를 위한 구체적인 내용을 도면에 따라서 설명한다.DETAILED DESCRIPTION OF THE PREFERRED EMBODIMENTS Hereinafter, the present invention will be described in detail with reference to the drawings.

또한, 본 발명을 설명하는데 있어서 동일 부분은 동일 부호를 붙이고, 그 반복 설명은 생략한다.

In the description of the present invention, the same parts are denoted by the same reference numerals, and repetitive description thereof will be omitted.

먼저, 본 발명의 일실시예에 따른 CCTV 환경에서의 얼굴 인식 기반 보안 관리 시스템의 구성을 도 1 내지 도 4를 참조하여 설명한다. 도 1은 본 발명에 따른 영상인식 시스템을 도시한 블록구성도이고, 도 2는 도 1에 도시된 감시 로봇의 블록구성도이며, 도 3은 도 1에 도시된 감시 로봇에 의한 영상 저장 과정을 도시한 흐름도이고, 도 4는 도 1에 도시된 감시 로봇에 의한 영상 전송 과정을 도시한 흐름도이다.First, the configuration of a face recognition-based security management system in a CCTV environment according to an embodiment of the present invention will be described with reference to FIG. 1 to FIG. FIG. 1 is a block diagram illustrating a video recognition system according to the present invention. FIG. 2 is a block diagram of the surveillance robot shown in FIG. 1. FIG. 3 is a flowchart illustrating an image storage process by the surveillance robot shown in FIG. 4 is a flowchart illustrating a video transmission process by the surveillance robot shown in FIG.

도 1에서 보는 바와 같이, 본 발명에 따른 얼굴 인식 기반 보안 관리 시스템은 감시 로봇(100), 관제 서버(200), 어플리케이션 서버(300)로 구성된다.As shown in FIG. 1, the face recognition-based security management system according to the present invention includes a

감시 로봇(100)은 카메라(110)를 통해 입력되는 영상을 실시간으로 처리하여 등록자/미등록자를 인식하고, 각 상황에 맞는 영상을 저장한다. 여기서, 감시 로봇(100)은 하나 이상의 카메라(110)를 구비할 수 있다.The

감시 로봇(100)은 카메라(110)를 통해 획득한 영상 내에서 얼굴 영역을 검출하고, 그 검출된 얼굴 영역으로부터 특징 데이터를 추출하여 기록한다. 그리고, 감시 로봇(100)은 추출된 특징 데이터를 등록자의 특징 데이터와 비교하여 촬영된 영상의 얼굴이 등록자인지 미등록자인지를 인식한다.The

감시 로봇(100)은 설정정보에 따라 고정 모드 또는 이동 모드로 동작한다. 예를 들어, 감시 로봇(100)은 주간에 고정 모드로 동작하고, 야간에 이동 모드로 동작한다. 감시 로봇(100)이 이동 모드로 동작하는 경우 감시 로봇(100)은 정해진 구역 및 취약 감시 구역을 이동하며 경계 감시를 수행한다. 한편, 감시 로봇(100)이 고정 모드로 동작하는 경우, 감시 로봇(100)은 충전과 동시에 이동 모드로 동작 시 저장한 영상을 관제 센터(20)로 전달한다. 또한 이동 모드 시 감시 로봇(100)은 미등록자를 발견하는 경우 스피커 및 램프(미도시)를 통해 미등록자에게 경고 신호를 출력한다.The

또한, 감시 로봇(100)은 촬영된 영상으로부터 인물 이미지만 추출하여 관제 서버(200)로 전송한다.The

감시 로봇(100)은 동체 내에 움직임 감지 센서(미도시)를 탑재하여 이동물체가 감지되면 그 순간 이동물체가 감지된 방향으로 램프를 점등하여 이동물체를 촬영하여 영상으로 저장한다.When a moving object is sensed, the

관제 서버(200)는 감시 로봇(100)으로부터 전송되는 영상을 수신하여 데이터베이스(DB)에 보관한다.The

관제 서버(200)는 통합관리 DB 및 영상인식 DB를 포함한다. 통합관리 DB에는 감시 로봇(100)의 운영과 관련된 정보 및 감시 로봇(100)으로부터 전송되는 영상들이 저장된다. 영상인식 DB는 얼굴인식 시 사용되는 형판(템플릿)영상이 저장된다.The

어플리케이션 서버(300)는 검색 기능을 통해 저장된 영상을 검색하여 미리보기(preview)를 할 수 있도록 미리보기 기능을 사용자의 단말기(미도시)에 제공한다. 사용자의 단말기의 종류(예를 들어, PC, 태블릿PC, 휴대폰, 스마트폰, 이동단말 등)에 따라 그에 맞는 영상을 제공한다.The

또한, 어플리케이션 서버(300)는 관제 서버(200)에 접속하여 감시 로봇(100)의 카메라(110)를 통해 실시간으로 제공되는 영상 및 카메라 운영 현황, DB 및 데이터저장장치 운영 현황을 확인하여 사용자의 단말기에 제공한다. 어플리케이션 서버(300)에는 관제 서버(200)에 접속하여 관제 서버(200)에서 제공하는 각종 데이터를 확인할 수 있게 하는 어플리케이션이 설치된다.The

도 2를 참조하면, 감시 로봇(100)은 카메라(110), 영상인식모듈(120), 영상저장 전송모듈(130), 제어부(140)를 포함한다.2, the

제어부(140)는 관제 서버(200)로부터 설정정보를 수신하여 감시 로봇(100)의 동작 및 카메라를 제어하는 로봇 에이전트(robot agent)이다. 제어부(140)는 로봇의 동작을 실시간으로 체크하며 관리한다. 제어부(140)는 관제 서버(200)에서 전송되는 설정 파라미터 값을 수신하여 그 설정 파라미터 값에 따라 실행하는데 감시 로봇(100)이 동작하는 중에는 계속 실행되어 관제 서버(200)와 통신하고, 관제 서버(200)의 제어에 따라 업로더(uploader)(132)를 실행하고, 기록부(recorder)(131)가 실행중인지를 체크하여 감시 로봇(100)의 상태를 체크한다. 제어부(140)는 기록부의 실행이 종료되면 이를 다시 실행한다. 제어부(140)는 관제 서버(200)와 연동하여 감시 로봇(100) 운영에 필요한 데이터를 전송받도록 한다.The

영상인식모듈(120)은 기록부(131)에서 캡쳐한 정지영상을 분석하여 얼굴인식을 수행한다. 영상인식모듈(120)는 얼굴 검출 모듈과 특징 추출 모듈로 구성된다. 얼굴인식은 얼굴의 각도, 밝기, 표정 등의 사소한 변화나 영상의 복잡한 배경 등 다양한 환경적 요소로 인해 많은 영향을 받는다. 따라서, 얼굴 인식에 있어서, 얼굴을 어떻게 표현할 것인지와 표현된 얼굴을 어떻게 구분할 것인가 하는 것은 핵심적인 부분이다. 특히, 얼굴인식에 있어서 얼굴표현은 가장 핵심적인 부분이다. 이러한 얼굴인식 방법에는 얼굴의 기하학적인 특징인 눈, 코 입 등의 위치나 크기 또는 이들 간의 거리를 이용하여 얼굴을 인식하는 기하학적 정합방법, 얼굴자료를 자료기지에 저장한 형판(템플릿) 영상과 비교하여 서로간의 상관성을 분석하여 얼굴을 인식하는 형판패턴정합방법, 신경망을 이용한 방법, SVM(Support Vector Machine) 방법, HMM(Hidden Markov Model) 방법 등이 있다.The

영상 저장 및 전송 모듈(130)은 감시 로봇(100)의 카메라(110)로부터 입력된 영상을 실시간으로 전송하여 통합관제 어플리케이션이 설치된 단말기(300)에서 모니터링이 가능하게 해주는 전송 모듈과 영상을 실시간으로 저장하며 관제 서버(200)로 업로드해주는 모듈이다.The video storage and

기록부(131)는 RTSP(Real Time Streaming Protocol)를 통해 카메라(110)로부터 실시간 입력받은 영상을 저장하고 정지영상을 캡쳐한다. 기록부(131)는 감시 로봇(100)에서 영상을 확인할 수 있도록 데이터 포맷(예: H.264)을 변환하여 저장하고 정지영상을 추출한다.The

또한, 기록부(131)는 영상 서버 상태 옵션에 따라 영상 크기, 저장위치 등을 설정하여 영상을 저장할 수 있다. 기록부(131)는 감시 로봇(100)에서 지원하는 H.264/MP4 파일과 HD(1280/720)급 정지영상을 저장한다. 기록부(131)는 MP4 파일로 변환 저장 시 로봇코드번호와 경로 규칙을 적용하며, 정지영상 저장 시 최대 초당 10개의 이미지를 저장한다. 기록부(131)는 서버 상태 정보에 따라 영상 저장 사이즈 변경이 가능하며, 관제 프로그램과의 연동 재생을 지원한다.Also, the

업로더(FTP_Uploader)(132)는 기록부(131)에서 저장한 영상을 순서에 따라 관제 서버(200)로 업로드한다. 다시 말해서, 업로더(132)는 감시 로봇(100)에 저장되는 영상을 FTP를 이용하여 관제 서버(200)의 NAS 스토리지로 업로드한다.The uploader (FTP_Uploader) 132 uploads the images stored in the

업로더(132)는 제어부(140)에서 NAS 스토리지의 IP, ID, 비밀번호를 파라미터로 받고, 저장된 파일 이름의 규칙을 통해서 NAS 서버에 저장할 디렉토리를 생성하고 파일을 업로드한다.

The

다음으로, 영상인식모듈(120)에 대하여 보다 구체적으로 설명한다.Next, the

앞서 설명한 바와 같이, 영상에서 얼굴 인식과정은 얼굴 검출 모듈과 특징 추출 모듈로 구성된다. 얼굴인식은 얼굴의 각도, 밝기, 표정 등의 사소한 변화나 영상의 복잡한 배경 등 다양한 환경적 요소로 인해 많은 영향을 받으며 얼굴이 검출된 조건에서 그의 얼굴이 누구의 얼굴이며 어떤 표정을 하고 있는가 등의 한계 요소들을 극복하여야 한다. 최근, 얼굴인식 기술은 2차원 얼굴인식으로부터 3차원 얼굴인식 기술로, 정면 얼굴인식에서 비정면 얼굴(기울어진 얼굴이나 측면 얼굴)에 대한 인식기술로 발전하고 있으며 여러 가지 얼굴 인식기법들과 체계적인 평가방법이 제시되고 있다.As described above, the face recognition process in the image consists of the face detection module and the feature extraction module. Face recognition is influenced by various environmental factors such as minor changes such as face angle, brightness, facial expression, and complex background of image. In the condition where face is detected, the face of the person whose face and what kind of face Limitations must be overcome. In recent years, face recognition technology has evolved from two-dimensional face recognition to three-dimensional face recognition technology, front face face recognition (non-frontal face (inclined face or lateral face) recognition technology, and various face recognition techniques and systematic evaluation Methods have been proposed.

얼굴인식 문제는 크게 두 가지로 구분할 수 있는데 첫 번째 문제는 얼굴을 어떻게 표현할 것인가 하는 문제이고 두 번째 문제는 표현된 얼굴을 어떻게 구분해낼 것인가 하는 문제이다. 이 중에서도 얼굴표현이 얼굴인식에서 핵심적인 부분으로 된다. 얼굴인식에 대한 연구는 크게 얼굴의 기하학적인 특징인 눈, 코, 입 등의 위치나 크기 또는 이들 간의 거리를 이용하여 얼굴을 인식하는 기하학적 정합방법, 얼굴자료를 자료기지에 저장한 형판(템플릿)영상과 비교하여 서로간의 상관성을 분석하여 얼굴을 인식하는 형판패턴정합방법, 신경망(ANN: Arfiti-cial Neural Network)을 이용한 방법, SVM(Support Vector Machine)방법, HMM (Hidden Markov Model)방법 등이 있다.The problem of face recognition can be classified into two kinds. The first problem is how to express the face, and the second problem is how to distinguish the expressed face. Among these, facial expressions become a key part of face recognition. The research on face recognition is largely based on the geometric matching method that recognizes the face using the position, size, or distance between the geometric features of the face such as eyes, nose, and mouth, the template (template) (Supported Vector Machine) method, HMM (Hidden Markov Model) method, and the like, by analyzing the correlation between the image and the image in comparison with the image, by using a pattern matching method for recognizing a face, a method using an arnithine cial neural network have.

기하학적 특징정합방법은 눈, 코, 입과 같은 얼굴 특징점들 사이의 위치, 모양 등의 기하학적인 거리와 각도 등을 구하고 두 얼굴을 비교하여 얼굴을 인식하는 방법이다. 여기서는 얼굴에 대한 정규화과정인 전처리수법을 잘 이용하여 얼굴의 특징점들을 잘 추출하는 것이다. 이 방법에서는 검출된 얼굴에서 얼굴의 빛(light)과 형태(shape)에 대한 특징 데이터에 의하여서도 얼굴을 인식하는데 매 얼굴에 대한 정규화과정이 선행되야 한다. 기하학적 특징정합방법은 인식연산에 많은 시간이 소모되며 매 얼굴에서 특징 데이터를 추출하는데 어려움이 있다.The geometric feature matching method is a method of recognizing a face by comparing the geometric distance and angle of the position, the shape, etc. between the facial feature points such as eyes, nose, and mouth. Here, the feature points of the face are extracted well by using the preprocessing technique which is the normalization process of the face. In this method, faces are recognized by the feature data of light and shape of the detected face, and normalization process of each face should be preceded. The geometric feature matching method consumes a lot of time for recognition operations and it is difficult to extract feature data from each face.

형판 패턴정합의 대표적인 얼굴인식방법들로는 주성분 분석 (PCA:Principal Component Analysis)방법, 독립성분 분석(ICA: Independent Component Anal-ysis)방법, 선형판별 분석(LDA: linear dis-criminant Analysis)방법, 2DPCA(2-Dimensional PCA)방법, PCA/LDA 방법, 구성요소기반(DCT/ LDA)방법, 극부적 특징 분석(LFA: Local Feature Analysis)방법들이 있다.Representative facial recognition methods for template matching include PCA (Principal Component Analysis), ICA (Independent Component Anal- ysis), linear dis-cidanalysis (LDA), 2DPCA 2-Dimensional PCA (PCA) method, PCA / LDA method, Component Based (DCT / LDA) method and Local Feature Analysis (LFA) method.

PCA방법은 전체 영상공간에서 얼굴을 가장 잘 표현할 수 있는 벡터, 즉 얼굴영상과 일치하는 공분산행렬의 고유벡터와 고유값을 구하고 고유벡터를 2차원 영상으로 변환한 고유얼굴(eigenface)들과 주어진 영상을 비교하여 얼굴을 인식하는 방법이다. 이 방법은 학습 데이터(DB)에서 최대분산방향을 나타내는 새로운 직교 기저 벡터들의 모임을 생성함으로서 영상공간의 전체적인 구조를 보존하면서도 새롭게 추출되는 특징 데이터의 표현과 그 특징 데이터로부터 본래의 영상을 재현하는 능력에 있어서 탁월하지만 조명이나 환경변화에 민감하고 학습영상의 수가 증가함에 따라 계산양이 많아지며 눈, 코, 입과 같은 세부적인 특징들을 추출하지 못한다는 단점이 있다. 또한 이 방법에 의하여 얻어지는 특징 데이터(기저 벡터들의 선형결합을 만드는 계수)들이 2차 통계량에 기초한 것으로 하여 2차 종속성만이 제거되기 때문에 이러한 정보가 학습 DB에 명백히 제공되지 않는다면 기저 벡터를 정확히 생성할 수 없다는 단점이 있다.The PCA method calculates the eigenvectors and eigenvalues of the covariance matrices that best represent the face in the entire image space, that is, the covariance matrices that coincide with the facial images, the eigenfaces that convert the eigenvectors into 2D images, To recognize the face. This method generates a new group of orthogonal basis vectors representing the direction of maximum dispersion in the training data (DB), thereby preserving the overall structure of the image space, and expressing newly extracted characteristic data and reproducing the original image from the characteristic data , But it is sensitive to illumination and environmental changes. As the number of learning images increases, the amount of computation increases, and it is disadvantageous in that it can not extract detailed features such as eyes, nose, and mouth. Also, since the feature data (coefficients that make linear combinations of basis vectors) obtained by this method are based on the quadratic statistic and only the secondary dependency is removed, if the information is not explicitly provided in the learning DB, There is a disadvantage that it can not.

ICA방법은 PCA방법의 이러한 결함을 극복하기 위해 제안된 방법으로서 고차원적인 통계적 정보를 이용하여 얼굴영상을 독립적인 성분들로 분리하여 얼굴을 인식하는 방법이다. 그러나 실험적 결과들은 ICA방법이 PCA방법에 비해 성능이 좋지 못하며 오히려 어떤 경우에는 인식률에 있어서 더 떨어진다는 것을 보여주었다. 또한 ICA방법은 자료의 통계적 독립성을 판정하기 위하여 확률밀도함수나 역행렬을 계산하는 등 고차원적인 처리를 진행해야 하므로 계산시간이 오래 걸리는 단점이 있다.The ICA method is a method to overcome these deficiencies of the PCA method, and is a method of recognizing faces by separating facial images into independent components using high dimensional statistical information. Experimental results, however, have shown that the ICA method is not as good as the PCA method, and in some cases, it has a lower recognition rate. In addition, the ICA method has a disadvantage in that it takes a long time to calculate the statistical independence of the data because it requires high-order processing such as calculating a probability density function or an inverse matrix.

LDA 방법은 PCA 방법의 제한성을 극복하기 위한 방법으로서 공분산행렬이 아닌 개별행렬 상에서 고유값 분석을 통하여 얼굴을 인식하는 방법이다. 이 방법에서는 클래스간(between-scatter:BS) 분산을 최대화하고 클래스 내(within-scatter: WS) 분산을 최소화하는 선형변환을 찾아내는 것으로서 판별정보를 보존하면서도 인식에 아주 적합하다고 볼 수 있다. 그것은 PCA방법은 얼굴영역들에 대한 차원수를 줄여 표현하여 얼굴을 인식하지만 LDA방법은 클래스 정보를 사용하여 동일한 클래스들의 자료는 서로 모으고 다른 클래스 간의 자료는 서로 분리하기 때문에 입력 데이터를 비교적 정확히 분류한다. The LDA method is a method to overcome limitations of the PCA method by recognizing faces through eigenvalue analysis on an individual matrix rather than a covariance matrix. This method maximizes between-scatter (BS) variance and finds a linear transform that minimizes within-scatter (WS) variance. It preserves discrimination information and is well suited for recognition. It recognizes faces by reducing the number of dimensions for facial regions, but LDA method classifies input data relatively accurately because it uses class information to collect data of the same classes and to separate data from other classes .

따라서 LDA 방법으로는 서로 다른 개개인의 얼굴을 잘 분리해 표현하므로 인식률을 높이고 있다. 그러나 이 방법은 학습 DB의 구성으로 매 사람당 조명, 표정 등의 서로 다른 다양한 표본얼굴화상을 요구한다. 따라서 학습모임이 작은 경우에 이 방법이 PCA 방법보다 성능이 떨어지며 서로 다른 학습모임들에 대해서는 PCA 방법보다 더 강인하다는 것이 이미 알려진 사실이다.Therefore, the LDA method improves the recognition rate by separating different faces of different individuals. However, this method requires a variety of different sample face images such as lighting, facial expression, etc. per person with the configuration of the learning DB. Thus, it is already known that this method is less robust than the PCA method for smaller learning groups and is more robust than the PCA method for different learning groups.

2DPCA방법은 2차원 영상과 평균영상을 이용하여 공분산행렬을 구하고 공분산행렬의 고유값과 고유벡터를 구하여 얼굴을 인식하는 방법으로서 입력영상을 1차원벡터로 변형하여 공분산행렬을 구하는 PCA방법의 확장이라고 볼 수 있다.The 2DPCA method is an extension of the PCA method of finding a covariance matrix by transforming an input image into a one-dimensional vector by finding a covariance matrix using two-dimensional images and an average image, and obtaining eigenvalues and eigenvectors of the covariance matrix. can see.

DCT/LDA방법은 영상 데이터가 저주파성분과 고주파성분으로 분리되는 DCT의 특징(DCT로 변환된 영상은 푸리에 변환처럼 영상의 에너지가 낮은 공간주파수 쪽에 집중되며 여기서 저주파성분은 부호화되고 고주파성분은 제거되어 저주파성분으로 영상을 표현할 수 있다)을 이용하여 전체 얼굴영상에 대한 특징값과 눈, 코 등의 얼굴요소들의 특징값을 함께 이용하여 얼굴을 인식하는 방법이다. 즉 이 방법은 입력영상에 대하여 밝기성분을 정규화하는 전처리를 수행한 후 전체 얼굴영상과 눈 및 좌측 눈, 우측 눈, 코에 대하여 DCT/LDA 특징값을 추출하여 얼굴을 인식하는 방법이다. 이 방법은 학습과정이 없이 자료의 차원수를 줄일 수 있으나 전체얼굴의 특징값을 이용하기 때문에 조명과 같은 외부요인의 영향을 많이 받게 된다.In the DCT / LDA method, the feature of the DCT in which the image data is separated into the low frequency component and the high frequency component (the DCT transformed image is focused on the spatial frequency side where the energy of the image is low, such as Fourier transform, where the low frequency component is encoded, And the feature values of the facial elements such as the eyes and nose are used together with the feature values of the whole facial image using the facial features of the facial features. In other words, this method is a method of recognizing faces by extracting DCT / LDA feature values for the whole face image, eye, left eye, right eye, and nose after performing pre-processing to normalize the brightness component of the input image. This method can reduce the number of dimensions of the data without learning process, but because it uses the feature value of the whole face, it is affected by external factors such as illumination.

LFA방법은 얼굴영상에 임의의 선을 긋고 선을 일정한 차원을 가진 격자(lattice line)로 표현하고 매 격자내부픽셀들의 명암도를 벡터로 표현한 특징 데이터와 DB에 기억된 특징 데이터들을 비교하여 가장 신뢰도가 높은 그룹을 선택하는 방법이다. 이 방법은 하나의 영상이 아니라 여러 개의 영상에 대한 그룹을 구할 때 성공률이 높다.The LFA method compares the feature data that expresses the intensities of the pixels inside each lattice with the feature data stored in the DB and draws an arbitrary line on the facial image, expresses the line as a lattice line with a certain dimension, It is a method of selecting a high group. This method has a high success rate when a group of several images is obtained instead of one image.

SVM방법은 선형 분리 가능한 학습영상표본들에 대하여 클래스 간의 거리가 최대로 되도록 학습함으로써 비교적 우수한 성능을 나타낸다. 또한 HMM방법은 조명이나 환경변화와 같은 조건에 덜 민감하게 제안된 얼굴인식기법이다.

The SVM method shows relatively good performance by learning the distance between classes for the linearly separable learning image samples to be maximized. In addition, the HMM method is a face recognition technique that is less sensitive to conditions such as illumination or environmental changes.

한편, 여러 가지 얼굴인식 방법들을 고찰하고 그에 대한 성능평가를 진행하는 과정에 조명이나 얼굴표정, 원근투영과 같은 변화들에 강인한 가볼 커널 웨이블릿(Gabor-kernel wavelet) 변환기를 얼굴 특징데이터 추출에 이용하고, 인식을 위한 특징 데이터의 효과적 변환을 실현하는 2중 비선형 매핑(non-linear mapping) 기반의 주성분분석법을 적용한다. 이 방법에서는 Gabor 특징 데이터의 통계적 분산성만이 아니라 사람얼굴에서의 공간적인 정보까지도 고려한다. 따라서 이러한 비선형 매핑(non-linear mapping) 후 변환된 특징 데이터들은 보다 높은 판별능력을 가지게 되며 그 결과 조명, 얼굴표정, 원근투영과 같은 여러 가지 조건으로 인한 특징 데이터 변화의 영향에 대해 강인한 특성을 가질 수 있게 된다.

In the process of evaluating various facial recognition methods, a Gabor-kernel wavelet transformer robust to changes such as illumination, facial expression, and perspective projection is used for facial feature data extraction , We apply principal component analysis based on non-linear mapping to realize effective transformation of feature data for recognition. In this method, not only statistical variance of Gabor feature data but also spatial information in human face are considered. Therefore, after the non-linear mapping, the transformed feature data have a higher discrimination ability, and as a result, they have robust characteristics about the influence of feature data change due to various conditions such as illumination, facial expression, and perspective projection .

다음으로, 본 발명의 일실시예에 따른 CCTV 환경에서의 얼굴 인식 기반 보안 방법을 도 5를 참조하여 보다 구체적으로 설명한다.Next, a face recognition based security method in a CCTV environment according to an embodiment of the present invention will be described in more detail with reference to FIG.

도 5를 참조하면, 감시 로봇(100)은 카메라(110)를 통해 입력되는 입력된 영상에서 인물 이미지를 추출하여 로드한다(S11). 감시 로봇(100)은 멀티 카메라를 통해 입력되는 3차원(3D) 영상 데이터를 재구성하여 자세 보정한 후 2차원(2D) 영상 데이터로 변환하여 인물 이미지를 추출한다.Referring to FIG. 5, the

감시 로봇(100)은 로드된 인물 이미지로부터 얼굴 영역을 검출한다(S12).The

로드된 인물 이미지의 프레임 정보에서 얼굴을 검출하는 모듈이다. 얼굴 인식 관련 시스템에서 중요한 첫 번째 단계는 영상에서 얼굴이 있는 위치를 알아내는 것이다. 이러한 과정을 통틀어 얼굴 검출이라고 아는데 최근 실시간 얼굴 인식을 목적으로 하는 다양한 시스템이 선을 보이고 있고, 이에 따라 실시간 응용에서의 인식을 위한 얼굴 영역을 검출하는 과정이 더욱 중요하게 된다.And detects the face from the frame information of the loaded portrait image. The first important step in the face recognition system is to locate the face in the image. Recently, various systems aiming at real-time face recognition are known, and the process of detecting the face region for recognition in real-time application becomes more important.

사람의 얼굴은 응시하는 방향에 따른 정면 혹은 측면의 각도, 고개를 좌우로 기울이는 정도, 다양한 표정, 카메라와의 거리에 따른 얼굴 영상의 크기 등과 같은 형태적 변화와 조명에 따른 얼굴 내에서의 발기 정도의 차이, 복잡한 배경 혹은 얼굴과 구분이 어려운 색상의 다른 객체 등과 같은 외부적 변화에 따라 매우 다양하게 나타날 수 있기 때문에 영상으로부터의 얼굴 검출 연구는 많은 어려움과 한계성을 포함하고 있다. 이러한 한계 요소로 인해 얼굴 인식 분야에서 얼굴 영역 및 성분 검출이 상당히 중요한 요소이다. 도 6은 얼굴 인식 시스템에서 취급되는 한계 요소를 나타내고 있다.The face of a person is affected by the morphological changes such as the angle of the front or side according to the gazing direction, the degree of tilting the head to the left and right, the various facial expressions, the distance to the camera and the size of the facial image, The face detection study from the image contains many difficulties and limitations because it can be very various depending on the external changes such as the difference of the face, the difference of the complex background, or other objects of the color difficult to distinguish from the face. Due to these limitations, facial region and component detection is a very important factor in face recognition. Fig. 6 shows the limiting factors handled in the face recognition system.

다음으로, 아다부스트(Adaboost) 얼굴 검출 기법을 이용하여 얼굴 검출을 수행하는 방법을 설명한다.Next, a method of performing face detection using the Adaboost face detection technique will be described.

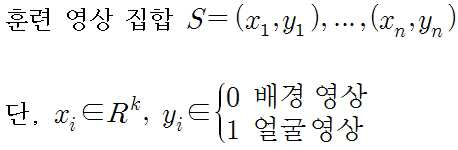

먼저, 다음과 같이 훈련 영상을 입력받는다.First, the training image is input as follows.

[수학식 1][Equation 1]

그리고 다음 수식과 같이 비중을 초기화한다.Then initialize the specific weight as shown in the following formula.

[수학식 2]&Quot; (2) "

여기서, m은 훈련영상 집합 S내의 배경영상의 개수이며, l은 얼굴영상 개수이다.Here, m is the number of background images in the training image set S, and l is the number of face images.

다음으로, t=1, ..., T에 대하여 다음 (a)단계 내지 (d)단계를 반복한다.Next, the following steps (a) to (d) are repeated for t = 1, ..., T.

(a) 비중의 표준화(a) Standardization of specific gravity

[수학식 3]&Quot; (3) "

여기서, w(t,i)는 t번째 약한 분류기에 입력되는 i번째 훈련영상의 비중을 의미한다.Here, w (t, i) denotes the weight of the i-th training image input to the t-th weak classifier.

(b) 약한 분류기 (hj)의 에러 εj (b) the error ε j of the weak classifier (h j )

[수학식 4]&Quot; (4) "

(c) 분류기의 선택(c) Selection of classifier

가장 낮은 에러율을 εt라 하고, εt를 가지는 약한 분류기 hj를 선택한다.Let ε t be the lowest error rate, and select a weak classifier h j with ε t .

(d) 비중 업데이트(d) Update the specific gravity

[수학식 5]&Quot; (5) "

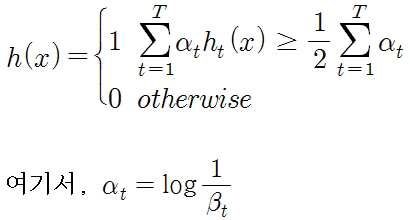

마지막으로, 최종적인 강한 분류기를 다음 수식과 같이 구한다.Finally, the final strong classifier is obtained as

[수학식 6]&Quot; (6) "

분류기를 구한 후, 분류기에 의하여 얼굴 영역을 검출한다. 도 8은 얼굴 검출 결과의 예들을 도시한 것이다.

After the classifier is obtained, the face region is detected by the classifier. Fig. 8 shows examples of face detection results.

다음으로, 상기 인물 이미지로부터 얼굴 영역이 검출되면 감시 로봇(100)은 검출된 얼굴 영역에서 특징 데이터를 추출한다(S13). 이때, 감시 로봇(100)은 추출된 특징 데이터 파일과 얼굴 썸네일을 저장한다.Next, when a face region is detected from the portrait image, the

얼굴 인식 시스템은 크게 특징 기반 방법과 외형 기반 방법으로 나눌 수 있다. 특징 기반 방법이란 얼굴의 기하학적인 정보를 이용하거나 얼굴 특징 성분들 눈, 코, 입, 턱 등을 이용하여 그 크기와 모양, 상호 연관성 혹은 이러한 요소들의 혼합된 형태의 정보를 이용해서 얼굴을 인식하는 방법이다. 마찬가지로 이 방법은 처리 시간이 빠르고 그 구조가 간단하며 쉽게 얼굴을 인식할 수 있다는 장점을 가지고 있다. 하지만, 얼굴의 기울어진 정도에 따라 얼굴의 특징 성분드을 검출하지 못할 수 있기 때문에 조명과 포즈 등의 한계 요소들에 상당히 민감한 단점이 있다. 이 방법 또한 이러한 단점을 극복하기 위해서 여러 제한조건을 제시하고 있다. Face recognition system can be divided into feature based method and external form based method. The feature-based method is a method of recognizing a face by using geometric information of the face or by using the facial feature components of the eye, nose, mouth, jaw, etc., and using the information of the size, shape, Method. Likewise, this method has the advantage that the processing time is fast, its structure is simple, and face recognition is easy. However, since the feature component of the face may not be detected depending on the degree of inclination of the face, there is a disadvantage that it is extremely sensitive to limit factors such as illumination and pose. This method also presents several limitations in order to overcome these drawbacks.

외형 기반 방법은 학습 영상 집합에 의해 학습된 모델을 이용해 얼굴을 인식하는 방법으로 얼굴 인식 분야에서 가장 널리 사용되고 있다. 이러한 외형 기반 방법으로는 주성분 분석(Pricipal component analysis:PCA)에 의해 생성되는 고유 얼굴(Eigenface), 선형 판별 분석(Linear discriminant analysis:LDA)에 의해 생성되는 Fisherface, 신경망(Neural network:NN), Support Vector Machine(SVM)을 이용하는 방법 등이 있다.The face - based method is the face recognition method using the model learned by the learning image set, and is widely used in the face recognition field. These outline-based methods include eigenface generated by pricipal component analysis (PCA), Fisherface generated by linear discriminant analysis (LDA), neural network (NN), Support And a method using a Vector Machine (SVM).

도 8에서 보는 바와 같이, 본 발명에서는 가볼 커널 기반의 주성분 분석(Principal component analysis method based Gabor-kernel)과 가볼 웨이블릿 변환(Gabor Wavelet Transformation) 방법을 활용한다.As shown in FIG. 8, the present invention utilizes a principal component analysis method based Gabor-kernel and Gabor Wavelet Transformation method.

얼굴의 특징점을 추출하기 위하여 얼굴의 텍스쳐 정보를 이용하며, 가볼(Gabor) 웨이블릿 변환을 사용하여 얼굴 영상들을 처리한다. 각각의 영상은 한 쌍의 Gabor 커널(kernel)과 컨벌루션(convolution)된다. Gabor 웨이블릿은 다중해상도와 다중방향으로 이루어진 필터들로 하나의 영상에 대해 여러 개의 표상을 생성한다. We use facial texture information to extract facial feature points and process facial images using Gabor wavelet transform. Each image is convolved with a pair of Gabor kernels. Gabor wavelets generate multiple representations for a single image with multi-resolution and multi-directional filters.

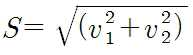

즉, 얼굴영역의 영상을 2개의 가볼(Gabor) 커널(필터)를 적용시켜서 2개의 컨벌루션된 영상(v1, v2)을 만든다. 2개의 컨벌루션된 영상을 합하여 웨이블릿 계수 히스토그램의 평균값을 적용하여 얼굴의 주요요소의 경계선을 추출한다.That is, the image of the face region is applied to two Gabor kernels (filters) to produce two convoluted images v1 and v2. The two convoluted images are summed and the average value of the wavelet coefficient histogram is applied to extract the boundary line of the main element of the face.

2차원 Gabor 웨이블릿 함수는 다음의 형식을 갖는다.The two-dimensional Gabor wavelet function has the following form.

[수학식 7]&Quot; (7) "

2차원 웨이브벡터 는 필터의 공간 주파수 k와 방향 θ을 통제하며, 벡터 는 영상을 이루는 각각의 화소를 나타낸다. σ는 k에 관련하여 가우시안(Gaussian) 윈도우의 폭을 조절한다.2D wave vector Controls the spatial frequency k and direction θ of the filter, and the vector Represents each pixel constituting an image. ? adjusts the width of the Gaussian window in relation to k.

도 9는 영상에 적용된 Gabor필터 쌍이다. 이 필터들은 90도 위상관계를 이루고 있다. 필터쌍들이 위상 차이에 의하여 영상에 미치는 영향을 적게 하기 위하여 각각의 필터를 영상에 적용한 후, 생성된 2개의 컨벌루션 된 영상 v1, v2는 다음과 같이 합하여 처리된다.Figure 9 is a Gabor filter pair applied to an image. These filters have a 90 degree phase relationship. In order to reduce the influence of the filter pairs on the image due to the phase difference, each of the filters is applied to the image, and the two convoluted images v 1 and v 2 generated are summed as follows.

[수학식 8]&Quot; (8) "

도 10의 결과와 같이, Gabor 웨이블릿 계수 히스토그램의 평균값을 적용하여 얼굴의 주요 요소들의 경계선 영상을 추출한다. 도 11은 도 10의 주요 요소들의 경계선으로부터 특징 추출 맵을 생성한 예이다.

As shown in FIG. 10, the average value of the Gabor wavelet coefficient histogram is applied to extract the boundary line image of the main elements of the face. FIG. 11 is an example of generating a feature extraction map from the boundary line of the main elements in FIG.

다음으로, 경계선 영상에 대하여 주성분 분석을 적용하여, 특징 데이터를 구한다.Next, principal component analysis is applied to the boundary image to obtain characteristic data.

PCA를 이용한 얼굴 인식에서는 얼굴을 가장 잘 표현할 수 있는 얼굴 공간(Face space)을 만드는 것으로 가능해 진다. 이러한 얼굴 공간들의 벡터가 주성분(principal component)이 되고, 전체 영상공간에서 얼굴을 가장 잘 표현할 수 있는 벡터를 찾는 것이 목적이다.In face recognition using PCA, it is possible to make face space that can best express face. The purpose of this paper is to find a vector that can be used as the principal component of a face space and represent the best face in the entire image space.

얼굴영상에 일치하는 공분산 행렬의 고유벡터를 구하고, 새로운 영상을 구해진 고유벡터를 이용해 부수공간으로 투영시켜 학습 집합과 비교함으로써 인식을 수행한다. 각 개인의 얼굴은 고유벡터들의 선형 결합에 의해 표현되며, 고유벡터의 계산량을 고려하여 가장 큰 고유값과 대응하는 것으로부터 M개의 고유벡터만을 사용함으로써 고차원의 영상 데이터를 저차원으로 차원 감소시킨다.The eigenvector of the covariance matrix that matches the facial image is obtained, and the new image is projected onto the side space using the obtained eigenvector and compared with the learning set to perform recognition. Each face of the individual is represented by a linear combination of eigenvectors, and by using only the M eigenvectors corresponding to the largest eigenvalue in consideration of the amount of calculation of the eigenvectors, the image data of the higher dimension is reduced to a low dimension.

구체적으로, 주성분 분석을 이용하여 특징 데이터를 추출하는 과정을 설명한다.Specifically, a process of extracting feature data using principal component analysis will be described.

먼저, 학습 얼굴 영상을 1차원 벡터로 변환한다.First, the learning face image is converted into a one-dimensional vector.

[수학식 9]&Quot; (9) "

여기서, i는 학습 집합의 얼굴 영상의 전체 픽셀 수이고, ak는 학습 집합의 k번째 얼굴이다.Where i is the total number of pixels of the facial image of the training set and a k is the kth face of the training set.

그리고 학습 얼굴 영상들의 얼굴 평균 Ψ을 구한다.Then, the face averages Ψ of the learning face images are obtained.

[수학식 10]&Quot; (10) "

그리고 각 얼굴 영상의 차영상 xik을 평균 영상으로부터 구한다.Then, the difference image x ik of each face image is obtained from the average image.

[수학식 11]&Quot; (11) "

여기서, X는 학습 집합을 정의하는 I*k차원의 행렬이다Where X is a matrix of I * k dimensions that define a training set

다음으로, 행렬의 분산을 최대화하기 위한 공분산 행렬(covariance matrix)을 구한다.Next, a covariance matrix for maximizing the variance of the matrix is obtained.

[수학식 12]&Quot; (12) "

이 행렬은 차원이 크므로(영상의 픽셀 수와 동일) 계산하기가 어렵다. 따라서 XXT와 XTX의 고유치는 같고, 고유 벡터는 X를 곱하고 정규화 한 것과 동일하다는 사실을 이용해 계산을 쉽게 하고자 한다. 위 식의 고유값들을 λk 라 하고, 고유벡터들을 Ek 라 가정한다.Since this matrix is large in dimension (equal to the number of pixels in the image), it is difficult to calculate. Therefore, we want to make the calculation easier by using the fact that the eigenvalues of XX T and X T X are the same, and the eigenvectors are multiplied by X and are the same as normalized. The eigenvalues of the above equation are denoted by λ k , and the eigenvectors are denoted by E k .

그리고 변환된 방법으로 공분산 행렬을 구한다.Then, the covariance matrix is obtained by the transformed method.

[수학식 13]&Quot; (13) "

다음으로, Q의 고유벡터를 Vk 와 고유값 λk 을 구한다.Next, the eigenvector of Q is Vk and the eigenvalue? K is obtained.

[수학식 14]&Quot; (14) "

양변에 X를 곱해 원래 데이터 집합의 고유벡터를 구한다.Multiply both sides by X to get the eigenvectors of the original data set.

[수학식 15]&Quot; (15) "

여기서, XVk 는 C의 고유벡터이므로, Ek = XVk 가 된다.Here, since XV k is the eigenvector of C, E k = XV k .

또한 Vk 는 k*k 행렬인데 m개의 중요한 고유벡터를 선정하면 Vkm 으로 표현할 수 있다. 따라서 Vkm 에 해당되는 고유벡터를 구하기 위한 식은 다음과 같다Also, V k is a k * k matrix, which can be expressed as V km by selecting m important eigenvectors. Therefore, the equation for obtaining the eigenvector corresponding to V km is as follows

[수학식 16]&Quot; (16) "

다음으로, 각 학습 얼굴 영상은 고유벡터 공간의 선형결합으로 표시한다.Next, each learning face image is represented by a linear combination of eigenvector spaces.

[수학식 17]&Quot; (17) "

주성분 분석에 의해 구해진 가장 큰 고유치들과 상응하는 고유벡터들을 영상의 크기와 같은 형태로 변환한 것을 보여주고, 이러한 고유 벡터의 영상 형태를 고유 얼굴(Eigen face)라 부른다.We show that the eigenvectors corresponding to the largest eigenvalues obtained by principal component analysis are transformed into the same size as the image size, and the image form of this eigenvector is called the eigenface.

고유벡터를 사용하여 영상의 변화 정도에 의해 특징점을 추출한다.Feature points are extracted by the degree of change of the image using eigenvectors.

도 12는 AT&T Face DB를 이용하여 주성분 분석에 의한 고유벡터(Eigen face)의 일례를 보여주고 있다. 또한, 도 13은 특징점들을 추출한 결과물을 예시하고 있다.

12 shows an example of an eigenface by principal component analysis using the AT & T Face DB. FIG. 13 illustrates the result of extracting the minutiae.

다음으로, 감시 로봇(100)은 특징 데이터 파일 및 얼굴 썸네일을 관제 서버(200)로 전송한다(S14).Next, the

관제 서버(200)는 감시 로봇(100)으로부터 전송되는 특징 데이터 파일 및 얼굴 썸네일을 수신하여 로드한다(S15, S16).The

또한, 관제 서버(200)는 영상인식 DB로부터 등록자의 특징 데이터 파일을 로딩한다(S17). 이어서, 관제 서버(200)는 감시 로봇(100)로부터 전송받은 특징 데이터와 영상인식 DB로부터 로딩한 등록자의 특징 데이터 간의 유사도 평가를 수행한다.In addition, the

감시 로봇(100)의 영상인식 모듈(120)은 아다부스트(Adaboost) 학습 알고리즘을 통해 검출된 얼굴 영역의 이미지는 가볼-커널(Gabor-Kernel) 기반의 PCA 특징 추출기 입력으로 사용된다. 영상인식 모듈(120)는 [수학식 1]과 같이 추출된 특징 데이터의 계수들과 등록되어 있는 등록자 및 미등록자 간에 유클리디언(Eudlidean) 거리를 계산하고 그 계산된 거리가 가장 가까운 얼굴 이미지로 맵핑된다. 영상인식 모듈(120)은 등록된 얼굴들과의 유사도를 계산하는 모듈로 얼굴 인식을 통해 등록자 중 누구인지를 인식하고, 그렇지 않으면 미등록자로 그룹핑한다.The

[수학식 18]&Quot; (18) "

유사도 평가가 완료되면 관제 서버 (200)는 그 유사도 평가에 따른 인식 결과를 감시 로봇(100)에 전송한다(S18).Upon completion of the similarity evaluation, the

감시 로봇(100)은 관제 서버(200)로부터 전송된 인식결과를 디스플레이 화면에 표시한다(S19).

The

다음으로, 시뮬레이션을 통한 본 발명의 효과를 도 14를 참조하여 설명하고자 한다.Next, the effect of the present invention through simulation will be described with reference to FIG.

본 발명에 따라 개발한 얼굴인식 시스템을 다양한 방식으로 시뮬레이션 하였다. 먼저 도 14의 (a)는 등록자가 앞모습으로 있을 때 인식이 가능하였으며, 옆모습으로 돌아서면 미등록으로 인식한다. 또한 미등록자 역시 미등록으로 인식하고 있다. (b)는 2명이 지나가다가 얼굴을 카메라를 향하여 돌리는 모습이다. 이 경우 인식 시스템은 2명 모두 인식할 수 있었다. (c)는 3명의 등록자와 1명의 미등록자가 동시에 나타나는 경우인데 등록자와 미등록자 4명 모두 인식하였다. 그러나 등록자 한명이 다른 사람 뒤에 가는 경우는 인식이 되지 못한다. 즉 얼굴의 눈을 중심으로 인식하기 때문에 눈이 보이지 않을 경우 인식이 어렵다.The face recognition system developed in accordance with the present invention is simulated in various ways. First, FIG. 14 (a) recognizes the registrant when it is in the front view, and recognizes it as unregistered when it turns to the side view. Non-registrants are also recognized as unregistered. (b) shows two people passing by and turning their faces toward the camera. In this case, the recognition system could recognize both of them. (c) is a case where three registrants and one unregistered person appear at the same time, and both registrants and non-registrants have recognized it. However, if a registrant goes after another, it is not recognized. That is to say, it is hard to recognize when the eyes are not seen because it recognizes the eyes of the face.

(d), (e), (f)는 등록자와 미등록자 2명이 동시에 카메라 앞에 서서 다양한 방식으로 수행해 보았다. 두 명 모두 얼굴이 돌아가는 경우 인식이 불가능하였고, 얼굴이 위와 아래를 향할 때도 두 눈이 보이지 않으면 인식이 안 됨을 알 수 있다. (d), (e), and (f), two registrants and two non-registrants stood in front of the camera at the same time and tried various methods. Both of them could not recognize if their faces were turning, and they could not recognize if their eyes were not seen even when faces were facing up and down.

또한 손으로 눈을 가리는 경우도 인식이 안 된다. 이처럼 본 시스템은 정확히 특징 추출을 한 경우에 그 추출 정보가 유사하게 일치해야 인식이 가능하며 유사한 정보가 차이가 많이 나거나 정보가 없는 경우는 인식이 어렵다. 끝으로 (g)는 사람이 먼 거리에서 다가올 때 인식하는 경우이다. 이는 카메라 성능으로 그 효율성을 높일 수 있다.

Also, it is not recognized even if you cover your eyes with your hands. In this way, when the feature extraction is performed correctly, the extracted information can be recognized by similar similarity, and it is difficult to recognize the similar information if there is a large difference or no information. Finally (g) is when people recognize when coming from a long distance. This can increase the efficiency with camera performance.

이상, 본 발명자에 의해서 이루어진 발명을 실시 예에 따라 구체적으로 설명하였지만, 본 발명은 실시 예에 한정되는 것은 아니고, 그 요지를 이탈하지 않는 범위에서 여러 가지로 변경 가능한 것은 물론이다.

The invention made by the present inventors has been described concretely with reference to the embodiments. However, it is needless to say that the present invention is not limited to the embodiments, and that various changes can be made without departing from the gist of the present invention.

100 : 감시로봇 110 : 카메라

120 : 영상인식모듈 130 : 영상저장전송 모듈

131 : 기록부 132 : 업로더

140 : 제어부 200 : 관제서버

300 : 어플리케이션 서버 100: surveillance robot 110: camera

120: image recognition module 130: image storage transmission module

131: recording section 132: uploader

140: control unit 200: control server

300: Application server

Claims (6)

(a) 카메라를 통해 입력되는 영상으로부터 인물 이미지를 추출하는 단계;

(b) 상기 인물 이미지로부터 얼굴 영역을 검출하는 단계;

(c) 상기 얼굴 영역의 특징 데이터를 추출하는 단계;

(d) 상기 특징 데이터가 추출되면 그 추출된 특징 데이터를 관제 서버로 전송하는 단계; 및,

(e) 상기 관제 서버로부터 상기 추출된 특징 데이터와 기등록된 특징 데이터 간의 유사도 평가에 따른 인식결과를 수신하는 단계를 포함하고,

상기 (b)단계에서, 아다부스트(Adaboost) 검출 기법을 이용하여 분류기를 구하고, 상기 분류기에 의하여 상기 인물 이미지로부터 얼굴 영역을 검출하는 것을 특징으로 하는 CCTV 환경에서의 얼굴 인식 기반 보안 관리 방법.

A surveillance robot for recognizing a registrant / a non-registrant by performing image recognition in real time on an image input through a camera to recognize the registrant / non-registrants; a CCTV environment The method comprising:

(a) extracting a portrait image from an image input through a camera;

(b) detecting a face region from the portrait image;

(c) extracting feature data of the face region;

(d) if the feature data is extracted, transmitting the extracted feature data to a control server; And

(e) receiving a recognition result based on the similarity evaluation between the extracted feature data and pre-registered feature data from the control server,

Wherein the classifier is obtained by using an Adaboost detection technique and the face region is detected from the portrait image by the classifier in the step (b).

(c1) 가볼 웨이블릿 변환을 이용하여 상기 얼굴 영역의 이미지로부터 경계선 영상을 구하는 단계; 및,

(c2) 상기 경계선 영역을 대상으로 주성분 분석을 적용하여 고유벡터의 영상을 구하고, 상기 고유벡터의 영상으로부터 특징 데이터를 구하는 단계를 포함하는 것을 특징으로 하는 CCTV 환경에서의 얼굴 인식 기반 보안 관리 방법.

The method of claim 1, wherein the step (c)

(c1) obtaining a boundary line image from the image of the face region using wavelet transform; And

(c2) applying a principal component analysis to the borderline region to obtain an image of the eigenvector, and obtaining feature data from the image of the eigenvector.

상기 (c1)단계에서, 상기 얼굴 영역의 이미지에 90도 위상관계가 있는 한 쌍의 가볼(Gabor) 필터를 적용하여 2개의 컨벌루션된 영상을 구하고, 상기 컨벌류션된 영상들을 합하고, 합한 영상에 대하여 가볼 웨이블릿 계수 히스토그램의 평균값을 적용하여 경계선 영상을 구하는 것을 특징으로 하는 CCTV 환경에서의 얼굴 인식 기반 보안 관리 방법.

The method of claim 3,

In the step (c1), a pair of Gabor filters having a phase relationship of 90 degrees to the image of the face region is applied to obtain two convoluted images, the convolved images are summed, And a boundary line image is obtained by applying an average value of a wavelet coefficient histogram to be watched.

상기 컨벌류션된 영상 v1, v2 를 다음 수학식에 의하여 합하는 것을 특징으로 하는 CCTV 환경에서의 얼굴 인식 기반 보안 관리 방법.

5. The method of claim 4,

Wherein the convolved images v 1 and v 2 are summed according to the following equation.

상기 유사도 평가는,

상기 추출된 특징 데이터와 상기 기등록된 특징 데이터 간에 유클리디언(Eudlidean) 거리를 계산하고, 그 계산된 거리가 가장 가까운 얼굴 이미지를 맵핑하는 것을 특징으로 하는 CCTV 환경에서의 얼굴 인식 기반 보안 관리 방법.

The method according to claim 1,

The similarity-

The Eudlidean distance is calculated between the extracted feature data and the pre-registered feature data, and the face image having the calculated distance is mapped to the face image, and the face recognition based security management method in the CCTV environment .

Priority Applications (1)

| Application Number | Priority Date | Filing Date | Title |

|---|---|---|---|

| KR1020130001692A KR101446143B1 (en) | 2013-01-07 | 2013-01-07 | CCTV Environment based Security Management System for Face Recognition |

Applications Claiming Priority (1)

| Application Number | Priority Date | Filing Date | Title |

|---|---|---|---|

| KR1020130001692A KR101446143B1 (en) | 2013-01-07 | 2013-01-07 | CCTV Environment based Security Management System for Face Recognition |

Publications (2)

| Publication Number | Publication Date |

|---|---|

| KR20140089810A KR20140089810A (en) | 2014-07-16 |

| KR101446143B1 true KR101446143B1 (en) | 2014-10-06 |

Family

ID=51737737

Family Applications (1)

| Application Number | Title | Priority Date | Filing Date |

|---|---|---|---|

| KR1020130001692A Active KR101446143B1 (en) | 2013-01-07 | 2013-01-07 | CCTV Environment based Security Management System for Face Recognition |

Country Status (1)

| Country | Link |

|---|---|

| KR (1) | KR101446143B1 (en) |

Cited By (2)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| KR20160078154A (en) | 2014-12-24 | 2016-07-04 | 주식회사 케이티 | Customer information provision method, device and computer program |

| WO2018174311A1 (en) * | 2017-03-22 | 2018-09-27 | 스노우 주식회사 | Dynamic content providing method and system for facial recognition camera |

Families Citing this family (10)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| GB2528330B (en) * | 2014-07-18 | 2021-08-04 | Unifai Holdings Ltd | A method of video analysis |

| KR102002528B1 (en) * | 2017-07-05 | 2019-07-22 | 주식회사 케이티 | Apparatus for detecting object and method thereof |

| KR102028930B1 (en) * | 2017-12-26 | 2019-10-07 | 이노뎁 주식회사 | method of providing categorized video processing for moving objects based on AI learning using moving information of objects |

| JP7269711B2 (en) * | 2018-10-03 | 2023-05-09 | 株式会社日立製作所 | Biometric authentication system, biometric authentication method and program |

| KR20200089972A (en) * | 2019-01-18 | 2020-07-28 | 삼성전자주식회사 | Method for securing image and electronic device implementing the same |

| KR102199178B1 (en) * | 2019-06-03 | 2021-01-06 | 계명대학교 산학협력단 | Identification system for face recognition using tprl algorithm and its way to working |

| KR20230106977A (en) * | 2022-01-07 | 2023-07-14 | 한화비전 주식회사 | Object Search based on Re-ranking |

| CN116704660B (en) * | 2023-06-29 | 2026-02-03 | 深圳市巨龙创视科技有限公司 | Gate inhibition picture issuing method, gate inhibition picture issuing system, intermediate server and storage medium |

| KR102830177B1 (en) * | 2024-03-29 | 2025-07-07 | (주) 제브라 앤 시퀀스 | Smart senior center management system with disappearance prevention function |

| CN119697405B (en) * | 2025-02-26 | 2025-05-16 | 天翼视联科技有限公司 | Video reduction method, system and storage medium |

Citations (4)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| KR20020079083A (en) * | 2001-04-13 | 2002-10-19 | 주식회사 아이티에스월드 | security system using data of face photographing and method of security thereof |

| KR20070023880A (en) * | 2005-08-25 | 2007-03-02 | 엘지전자 주식회사 | User registration system and method using mobile terminal |

| KR20110107521A (en) * | 2010-03-25 | 2011-10-04 | 박창연 | Ubiquitous Surveillance System Using Face Recognition DVR |

| KR101103923B1 (en) * | 2010-10-20 | 2012-01-12 | 성균관대학교산학협력단 | Camera robot for shooting video and video recording method using camera robot |

-

2013

- 2013-01-07 KR KR1020130001692A patent/KR101446143B1/en active Active

Patent Citations (4)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| KR20020079083A (en) * | 2001-04-13 | 2002-10-19 | 주식회사 아이티에스월드 | security system using data of face photographing and method of security thereof |

| KR20070023880A (en) * | 2005-08-25 | 2007-03-02 | 엘지전자 주식회사 | User registration system and method using mobile terminal |

| KR20110107521A (en) * | 2010-03-25 | 2011-10-04 | 박창연 | Ubiquitous Surveillance System Using Face Recognition DVR |

| KR101103923B1 (en) * | 2010-10-20 | 2012-01-12 | 성균관대학교산학협력단 | Camera robot for shooting video and video recording method using camera robot |

Cited By (5)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| KR20160078154A (en) | 2014-12-24 | 2016-07-04 | 주식회사 케이티 | Customer information provision method, device and computer program |

| WO2018174311A1 (en) * | 2017-03-22 | 2018-09-27 | 스노우 주식회사 | Dynamic content providing method and system for facial recognition camera |

| KR20190125478A (en) * | 2017-03-22 | 2019-11-06 | 스노우 주식회사 | Method and system for providing dynamic content of face recognition camera |

| US11017567B2 (en) | 2017-03-22 | 2021-05-25 | Snow Corporation | Dynamic content providing method and system for face recognition camera |

| KR102256314B1 (en) * | 2017-03-22 | 2021-05-26 | 스노우 주식회사 | Method and system for providing dynamic content of face recognition camera |

Also Published As

| Publication number | Publication date |

|---|---|

| KR20140089810A (en) | 2014-07-16 |

Similar Documents

| Publication | Publication Date | Title |

|---|---|---|

| KR101446143B1 (en) | CCTV Environment based Security Management System for Face Recognition | |

| Rusia et al. | A comprehensive survey on techniques to handle face identity threats: challenges and opportunities | |

| US11288504B2 (en) | Iris liveness detection for mobile devices | |

| US10943095B2 (en) | Methods and systems for matching extracted feature descriptors for enhanced face recognition | |

| Chan et al. | Face liveness detection using a flash against 2D spoofing attack | |

| Sharma et al. | A survey on face presentation attack detection mechanisms: hitherto and future perspectives | |

| Ayyappan et al. | Criminals and missing children identification using face recognition and web scrapping | |

| US10839204B2 (en) | Sharing identification data with audio/video recording and communication devices and local processing of the shared data | |

| US10939120B1 (en) | Video upload in limited bandwidth | |

| US20070286497A1 (en) | System and Method for Comparing Images using an Edit Distance | |

| Senior et al. | Face recognition and its application | |

| Fondje et al. | Cross-domain identification for thermal-to-visible face recognition | |

| KR20190093799A (en) | Real-time missing person recognition system using cctv and method thereof | |

| Erdélyi et al. | Privacy protection vs. utility in visual data: An objective evaluation framework | |

| Pilania et al. | Exploring face detection and recognition in steganography | |

| US10733857B1 (en) | Automatic alteration of the storage duration of a video | |

| Al-Kawaz et al. | Advanced facial recognition for digital forensics | |

| KR102329466B1 (en) | Apparatus and method for real time face recognition | |

| Edmunds | Protection of 2D face identification systems against spoofing attacks | |

| Wei | Unconstrained face recognition with occlusions | |

| Hamdan et al. | A self-immune to 3D masks attacks face recognition system | |

| Sun et al. | Dual camera based feature for face spoofing detection | |

| Rani et al. | Face Recognition System for Criminal Identification in CCTV Footage Using Keras and OpenCV. | |

| Singh et al. | A New Approach for Suspect Detection in Video Surveillance | |

| RAO | Experimental investigations to face recognition using openCV for monitoring turnout time |

Legal Events

| Date | Code | Title | Description |

|---|---|---|---|

| A201 | Request for examination | ||

| PA0109 | Patent application |

St.27 status event code: A-0-1-A10-A12-nap-PA0109 |

|

| PA0201 | Request for examination |

St.27 status event code: A-1-2-D10-D11-exm-PA0201 |

|

| PN2301 | Change of applicant |

St.27 status event code: A-3-3-R10-R13-asn-PN2301 St.27 status event code: A-3-3-R10-R11-asn-PN2301 |

|

| D13-X000 | Search requested |

St.27 status event code: A-1-2-D10-D13-srh-X000 |

|

| D14-X000 | Search report completed |

St.27 status event code: A-1-2-D10-D14-srh-X000 |

|

| E902 | Notification of reason for refusal | ||

| PE0902 | Notice of grounds for rejection |

St.27 status event code: A-1-2-D10-D21-exm-PE0902 |

|

| E13-X000 | Pre-grant limitation requested |

St.27 status event code: A-2-3-E10-E13-lim-X000 |

|

| P11-X000 | Amendment of application requested |

St.27 status event code: A-2-2-P10-P11-nap-X000 |

|

| P13-X000 | Application amended |

St.27 status event code: A-2-2-P10-P13-nap-X000 |

|

| PG1501 | Laying open of application |

St.27 status event code: A-1-1-Q10-Q12-nap-PG1501 |

|

| E701 | Decision to grant or registration of patent right | ||

| PE0701 | Decision of registration |

St.27 status event code: A-1-2-D10-D22-exm-PE0701 |

|

| GRNT | Written decision to grant | ||

| PR0701 | Registration of establishment |

St.27 status event code: A-2-4-F10-F11-exm-PR0701 |

|

| PR1002 | Payment of registration fee |

St.27 status event code: A-2-2-U10-U11-oth-PR1002 Fee payment year number: 1 |

|

| PG1601 | Publication of registration |

St.27 status event code: A-4-4-Q10-Q13-nap-PG1601 |

|

| P22-X000 | Classification modified |

St.27 status event code: A-4-4-P10-P22-nap-X000 |

|

| P22-X000 | Classification modified |

St.27 status event code: A-4-4-P10-P22-nap-X000 |

|

| R18-X000 | Changes to party contact information recorded |

St.27 status event code: A-5-5-R10-R18-oth-X000 |

|

| PR1001 | Payment of annual fee |

St.27 status event code: A-4-4-U10-U11-oth-PR1001 Fee payment year number: 4 |

|

| FPAY | Annual fee payment |

Payment date: 20180814 Year of fee payment: 5 |

|

| PR1001 | Payment of annual fee |

St.27 status event code: A-4-4-U10-U11-oth-PR1001 Fee payment year number: 5 |

|

| PR1001 | Payment of annual fee |

St.27 status event code: A-4-4-U10-U11-oth-PR1001 Fee payment year number: 6 |

|

| PR1001 | Payment of annual fee |

St.27 status event code: A-4-4-U10-U11-oth-PR1001 Fee payment year number: 7 |

|

| PN2301 | Change of applicant |

St.27 status event code: A-5-5-R10-R11-asn-PN2301 |

|

| PN2301 | Change of applicant |

St.27 status event code: A-5-5-R10-R14-asn-PN2301 |

|

| P14-X000 | Amendment of ip right document requested |

St.27 status event code: A-5-5-P10-P14-nap-X000 |

|

| P16-X000 | Ip right document amended |

St.27 status event code: A-5-5-P10-P16-nap-X000 |

|

| Q16-X000 | A copy of ip right certificate issued |

St.27 status event code: A-4-4-Q10-Q16-nap-X000 |

|

| PR1001 | Payment of annual fee |

St.27 status event code: A-4-4-U10-U11-oth-PR1001 Fee payment year number: 8 |

|

| S20-X000 | Security interest recorded |

St.27 status event code: A-4-4-S10-S20-lic-X000 |

|

| PN2301 | Change of applicant |

St.27 status event code: A-5-5-R10-R13-asn-PN2301 St.27 status event code: A-5-5-R10-R11-asn-PN2301 |

|

| P22-X000 | Classification modified |

St.27 status event code: A-4-4-P10-P22-nap-X000 |

|

| P14-X000 | Amendment of ip right document requested |

St.27 status event code: A-5-5-P10-P14-nap-X000 |

|

| P16-X000 | Ip right document amended |

St.27 status event code: A-5-5-P10-P16-nap-X000 |

|

| Q16-X000 | A copy of ip right certificate issued |

St.27 status event code: A-4-4-Q10-Q16-nap-X000 |

|

| PR1001 | Payment of annual fee |

St.27 status event code: A-4-4-U10-U11-oth-PR1001 Fee payment year number: 9 |

|

| PR1001 | Payment of annual fee |

St.27 status event code: A-4-4-U10-U11-oth-PR1001 Fee payment year number: 10 |

|

| R18-X000 | Changes to party contact information recorded |

St.27 status event code: A-5-5-R10-R18-oth-X000 |

|

| PR1001 | Payment of annual fee |

St.27 status event code: A-4-4-U10-U11-oth-PR1001 Fee payment year number: 11 |

|

| PR1001 | Payment of annual fee |

St.27 status event code: A-4-4-U10-U11-oth-PR1001 Fee payment year number: 12 |

|

| U11 | Full renewal or maintenance fee paid |

Free format text: ST27 STATUS EVENT CODE: A-4-4-U10-U11-OTH-PR1001 (AS PROVIDED BY THE NATIONAL OFFICE) Year of fee payment: 12 |