JP7578209B1 - Image generation system, image generation method, and image generation program - Google Patents

Image generation system, image generation method, and image generation program Download PDFInfo

- Publication number

- JP7578209B1 JP7578209B1 JP2024065475A JP2024065475A JP7578209B1 JP 7578209 B1 JP7578209 B1 JP 7578209B1 JP 2024065475 A JP2024065475 A JP 2024065475A JP 2024065475 A JP2024065475 A JP 2024065475A JP 7578209 B1 JP7578209 B1 JP 7578209B1

- Authority

- JP

- Japan

- Prior art keywords

- video

- data

- generation

- scenario

- information

- Prior art date

- Legal status (The legal status is an assumption and is not a legal conclusion. Google has not performed a legal analysis and makes no representation as to the accuracy of the status listed.)

- Active

Links

Images

Classifications

-

- G—PHYSICS

- G06—COMPUTING OR CALCULATING; COUNTING

- G06T—IMAGE DATA PROCESSING OR GENERATION, IN GENERAL

- G06T13/00—Animation

- G06T13/20—3D [Three Dimensional] animation

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N5/00—Details of television systems

- H04N5/222—Studio circuitry; Studio devices; Studio equipment

- H04N5/262—Studio circuits, e.g. for mixing, switching-over, change of character of image, other special effects ; Cameras specially adapted for the electronic generation of special effects

- H04N5/272—Means for inserting a foreground image in a background image, i.e. inlay, outlay

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N5/00—Details of television systems

- H04N5/222—Studio circuitry; Studio devices; Studio equipment

- H04N5/262—Studio circuits, e.g. for mixing, switching-over, change of character of image, other special effects ; Cameras specially adapted for the electronic generation of special effects

- H04N5/278—Subtitling

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N5/00—Details of television systems

- H04N5/76—Television signal recording

- H04N5/91—Television signal processing therefor

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N5/00—Details of television systems

- H04N5/76—Television signal recording

- H04N5/91—Television signal processing therefor

- H04N5/92—Transformation of the television signal for recording, e.g. modulation, frequency changing; Inverse transformation for playback

Landscapes

- Engineering & Computer Science (AREA)

- Multimedia (AREA)

- Signal Processing (AREA)

- Physics & Mathematics (AREA)

- General Physics & Mathematics (AREA)

- Theoretical Computer Science (AREA)

- Processing Or Creating Images (AREA)

- Studio Circuits (AREA)

Abstract

【課題】ユーザからの入力クエリに応じて動画データを取得する。

【解決手段】本開示に係る映像生成システムは、動画生成に関する入力クエリをユーザから取得する取得部と、前記入力クエリに基づいて、動画生成に関するシナリオデータを生成するシナリオ生成部と、前記シナリオデータに基づいて、3Dデータを構成するためのコードを生成するコード生成部と、前記コードに基づいて、動画データを取得する動画データ取得部と、を備える。

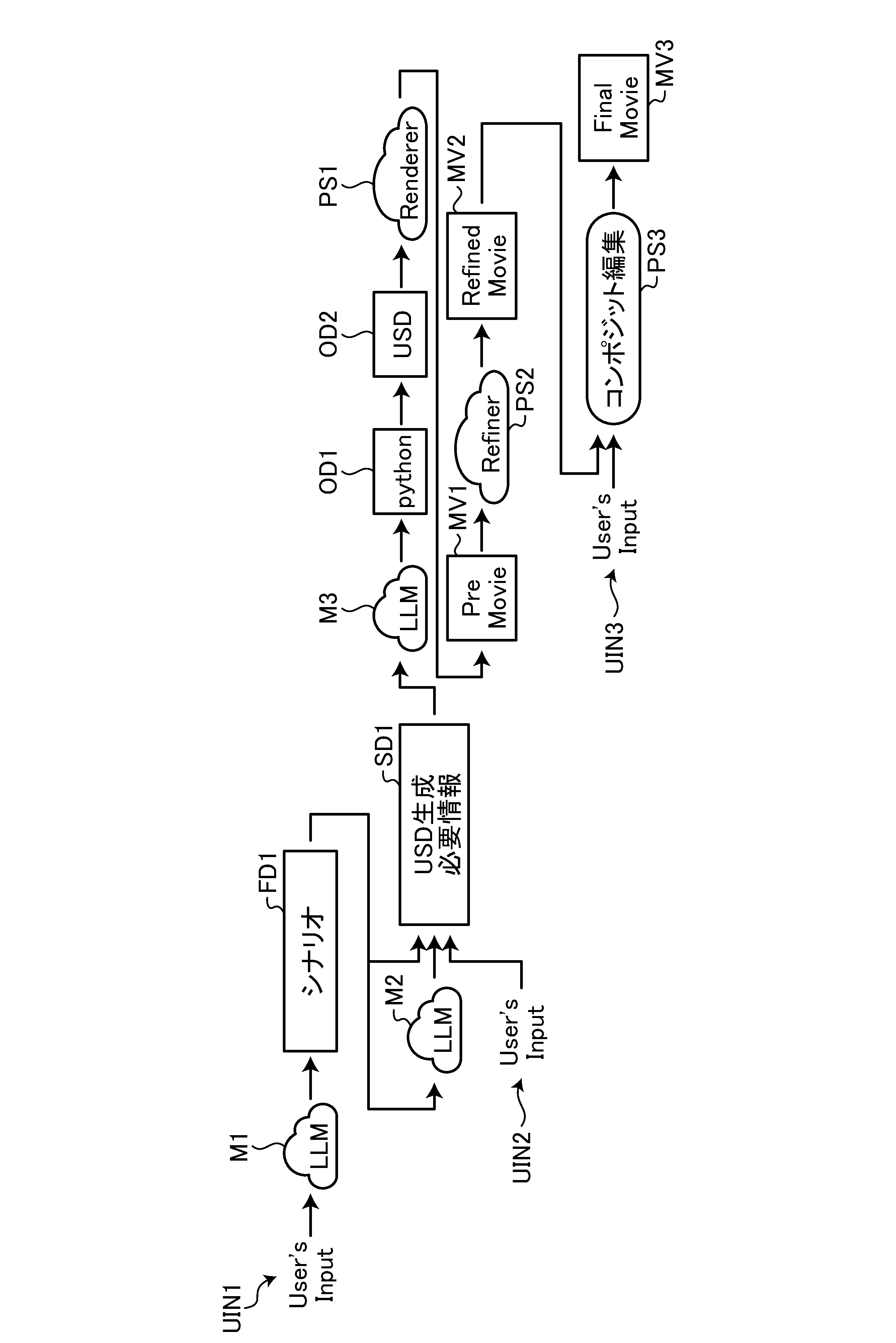

【選択図】図3

The present invention obtains video data in response to a query input by a user.

[Solution] The video generation system disclosed herein comprises an acquisition unit that acquires an input query related to video generation from a user, a scenario generation unit that generates scenario data related to video generation based on the input query, a code generation unit that generates code for constructing 3D data based on the scenario data, and a video data acquisition unit that acquires video data based on the code.

[Selected figure] Figure 3

Description

本開示は、映像生成システム、映像生成方法及び映像生成プログラムに関する。 This disclosure relates to an image generation system, an image generation method, and an image generation program.

映像(「動画」ともいう)を自動で生成する技術が提供されている。例えば、2次元的な線画から仮想人物の3次元姿勢を推定し、動画を生成する技術が提供されている(例えば特許文献1)。 Technology has been provided for automatically generating images (also called "videos"). For example, technology has been provided for estimating the three-dimensional posture of a virtual person from a two-dimensional line drawing and generating a video (for example, Patent Document 1).

しかしながら、従来技術には、改善の余地がある。例えば、従来技術では、動画を生成するために2次元的な線画、すなわち画像が必要となり、2次元的な線画といった画像を用意することはユーザの負担が大きく、ユーザが画像を用意できない場合等、動画を生成することが難しい。そのため、ユーザの負担が少なく、ユーザビリティが高い動画生成サービスを提供することが望まれており、例えばユーザからの入力クエリに応じて動画データを取得することが望まれている。 However, there is room for improvement in the conventional technology. For example, in the conventional technology, two-dimensional line drawings, i.e., images, are required to generate videos, and preparing images such as two-dimensional line drawings places a large burden on the user, making it difficult to generate videos when the user is unable to prepare images. For this reason, it is desirable to provide a video generation service that places less burden on the user and has high usability, and it is desirable, for example, to obtain video data in response to a query input by the user.

そこで、本開示では、ユーザからの入力クエリに応じて動画データを取得することができる映像生成システム、映像生成方法及び映像生成プログラムを提案する。 Therefore, this disclosure proposes a video generation system, a video generation method, and a video generation program that can acquire video data in response to a query input by a user.

上記の課題を解決するために、本開示に係る一形態の映像生成システムは、動画生成に関する入力クエリをユーザから取得する取得部と、前記入力クエリに基づいて、動画生成に関するシナリオデータを生成するシナリオ生成部と、前記シナリオデータに基づいて、3Dデータを構成するためのコードを生成するコード生成部と、前記コードに基づいて、動画データを取得する動画データ取得部と、を備える。 In order to solve the above problems, a video generation system according to one embodiment of the present disclosure includes an acquisition unit that acquires an input query related to video generation from a user, a scenario generation unit that generates scenario data related to video generation based on the input query, a code generation unit that generates code for constructing 3D data based on the scenario data, and a video data acquisition unit that acquires video data based on the code.

以下に、本開示の実施形態について図面に基づいて詳細に説明する。なお、この実施形態により本願にかかる映像生成システム、映像生成方法及び映像生成プログラムが限定されるものではない。また、以下の各実施形態において、同一の部位には同一の符号を付することにより重複する説明を省略する。 Embodiments of the present disclosure will be described in detail below with reference to the drawings. Note that the image generation system, image generation method, and image generation program according to the present application are not limited to these embodiments. In addition, in the following embodiments, the same components are designated by the same reference numerals, and duplicated descriptions will be omitted.

以下に示す項目順序に従って本開示を説明する。

1.実施形態

1-1.本開示の映像生成システムの構成概要

1-2.本開示の映像生成システムによる処理

1-3.ユーザインタフェース

1-4.処理例

1-4-1.音生成例

1-4-2.テキストロゴ生成例

1-4-3.再学習例

1-4-4.USD更新例

1-4-5.評価例

1-4-6.複数カットの選択例

1-4-7.時間情報の利用例

1-4-8.言語化の度合いに応じた応答例

1-4-9.定性的な値の利用例

1-4-10.入力途中でのレンダリング処理例

1-4-11.編集時の確認作業例

1-4-12.範囲選択に応じた処理例

1-4-13.被写界深度に応じた処理例

1-4-14.確認作業時の再生処理例

1-4-15.強調表示例

1-4-16.カット間の関係提示例

1-4-17.オブジェクトの選択例

1-4-18.3Dモデル利用例

1-4-19.参考データの利用例

1-4-20.3Dデータを有する利点例

1-5.ユーザから見た処理フロー例

1-6.AIモデルについて

2.その他の実施形態

2-1.その他の構成例

2-2.その他

3.本開示に係る効果

4.ハードウェア構成

The present disclosure will be described in the following order.

1. Embodiment 1-1. Overview of the configuration of the video generation system of the present disclosure 1-2. Processing by the video generation system of the present disclosure 1-3. User interface 1-4. Processing examples 1-4-1. Sound generation example 1-4-2. Text logo generation example 1-4-3. Re-learning example 1-4-4. USD update example 1-4-5. Evaluation example 1-4-6. Selection example of multiple cuts 1-4-7. Use example of time information 1-4-8. Response example according to degree of verbalization 1-4-9. Use example of qualitative values 1-4-10. Rendering processing example during input 1-4-11. Confirmation work example during editing 1-4-12. Processing example according to range selection 1-4-13. Processing example according to depth of field 1-4-14. Playback processing example during confirmation work 1-4-15. Highlighting example 1-4-16. Example of presenting relationships between cuts 1-4-17. Example of selecting objects 1-4-18. Example of using 3D models 1-4-19. Example of using reference data 1-4-20. Example of advantages of having 3D data 1-5. Example of processing flow from the user's perspective 1-6. About AI models 2. Other embodiments 2-1. Other configuration examples 2-2. Others 3. Effects of the

<1.実施形態>

<1-1.本開示の映像生成システムの構成概要>

図1は、本開示の映像生成システムの一例を示す図である。映像生成システム1は、映像生成モジュール100、情報取得モジュール200、センサ部300、及びクライアントUI表示部400を有する。なお、図1では各々の構成を1つだけ図示するが、映像生成システム1には、複数の映像生成モジュール100、複数の情報取得モジュール200、複数のセンサ部300、及び複数のクライアントUI表示部400が含まれてもよい。

1. Embodiment

1-1. Overview of the configuration of the image generation system of the present disclosure

Fig. 1 is a diagram showing an example of an image generation system according to the present disclosure. The

まず、映像生成処理を行う映像生成モジュール100の構成について説明する。映像生成モジュール100は、入力テキスト解析部110、センサ解析部120、プロンプト等生成部130、映像生成部140、サウンド生成部150、テキスト/ロゴ生成部160、コンポジット編集部170、評価部180、クライアントUIモジュール190等を有する。

First, the configuration of the

入力テキスト解析部110は、入力されたテキストを解析する。例えば、入力テキスト解析部110は、情報取得モジュール200から入力されたテキストを解析する。センサ解析部120は、入力されたセンサ情報を解析する。例えば、センサ解析部120は、情報取得モジュール200から取得したセンサ情報を解析する。

The input text analysis unit 110 analyzes the input text. For example, the input text analysis unit 110 analyzes the text input from the

プロンプト等生成部130は、後述する機械学習モデルであるAI(Artificial Intelligence)モデル(単に「モデル」ともいう)に入力するプロンプト等を含む映像(動画)の生成のために必要となる各種情報を生成する。例えば、プロンプト等生成部130は、ユーザの入力と予め保存されたプロンプト(のテンプレート等)とを用いてプロンプトを生成する。なお、プロンプトは、AIモデルへ入力する情報(モデル入力情報)の一例に過ぎず、AIモデルへ入力するモデル入力情報はプロンプトに限らず、任意の形式のモデル入力情報が採用可能であり、「プロンプト等生成部」は「モデル入力情報等生成部」と読み替えてもよい。図1では、プロンプト等生成部130は、シナリオ向け生成部131、映像向け生成部132、サウンド向け生成部133、テキスト/ロゴ向け生成部134を有する。

The prompt etc. generation unit 130 generates various information required for generating a video (video) including a prompt etc. to be input to an AI (Artificial Intelligence) model (also simply referred to as a "model"), which is a machine learning model described later. For example, the prompt etc. generation unit 130 generates a prompt using a user's input and a pre-stored prompt (template, etc.). Note that a prompt is merely one example of information to be input to an AI model (model input information), and the model input information to be input to an AI model is not limited to a prompt, and any form of model input information can be adopted, and the "prompt etc. generation unit" may be read as a "model input information etc. generation unit." In FIG. 1, the prompt etc. generation unit 130 has a scenario-oriented

シナリオ向け生成部131は、シナリオの生成に関連する各種情報を生成する。シナリオ向け生成部131は、シナリオを出力するモデルに入力する入力情報を生成する。例えば、シナリオ向け生成部131は、入力クエリに基づいて、動画生成に関するシナリオデータを生成するシナリオ生成部である。例えば、シナリオ向け生成部131は、入力クエリに基づいて、シナリオデータを生成するためにシナリオ生成部が用いるシナリオ生成用情報を出力する第1の出力部である。

The scenario-oriented

映像向け生成部132は、映像の生成に関連する各種情報を生成する。映像向け生成部132は、3D(三次元)データを構成するためのコードを出力するモデルに入力する入力情報を生成する。例えば、映像向け生成部132は、シナリオデータに基づいて、3Dデータを構成するためのコードを生成するコード生成部である。例えば、映像向け生成部132は、シナリオデータに基づいて、3Dデータを構成するためのコードを生成するためにコード生成部が用いるコード生成用情報を出力する第2の出力部である。

The

サウンド向け生成部133は、サウンド情報(音情報)の生成に関連する各種情報を生成する。サウンド向け生成部133は、サウンドを出力するモデルに入力する入力情報を生成する。テキスト/ロゴ向け生成部134は、テキスト及びロゴの生成に関連する各種情報を生成する。テキスト/ロゴ向け生成部134は、テキスト及びロゴのうち少なくとも1つを出力するモデルに入力する入力情報を生成する。

The sound-oriented

映像生成部140は、映像の生成に関する処理を実行する。映像生成部140は、コードに基づいて、動画データを取得する動画取得部である。映像生成部140は、プロンプト等生成部130で生成された各種情報を用いて映像を生成する。例えば、映像生成部140は、コードに基づいて、動画データを生成する動画生成部である。なお、映像生成部140は、任意の態様により動画データを取得してもよい。例えば、映像生成部140は、動画データの生成に用いられるデータを、動画データ生成のサービスを提供する外部のサービス提供装置(ベンダー等)に送信し、そのサービス提供装置が生成した動画データを、そのサービス提供装置から受信することにより、動画データを取得してもよい。図1では、映像生成部140は、USD生成部141、レンダリング部142、映像リファイン部143を有する。

The

USD生成部141は、USD(Universal Scene Description)に関連する各種情報を生成する。例えば、USD生成部141は、映像向け生成部132での映像向けプロンプト生成で得られたプロンプトを用いて、Large Language Model(以下「LLM」ともいう)などのAIモデルにより、USD-Pythonなどを生成する。

The USD generation unit 141 generates various information related to the USD (Universal Scene Description). For example, the USD generation unit 141 uses a prompt obtained by the video prompt generation in the

レンダリング部142は、レンダリングに関連する各種処理を実行する。レンダリング部142は、USD生成部141により生成されたUSDをレンダリングする処理を実行する。

The

映像リファイン部143は、映像をリファインするための各種処理を実行する。レンダリング部142は、生成された映像を、映像リファインの処理によりクオリティを高くする。例えば、映像リファイン部143は、動画データの画質を改善する画質改善処理を実行する画質改善部である。

The

サウンド生成部150は、サウンド(音)を生成する処理を実行する。サウンド生成部150は、サウンド向け生成部133でのサウンド向けのプロンプト生成で得られたプロンプトを用いて、Contrastive Learning ModelなどのAIモデルにより、BGM(background music)、SE(Sound Effect)、ナレーション、セリフなどのサウンド情報を生成する。

The

テキスト/ロゴ生成部160は、テキスト及びロゴのうち少なくとも1つを生成する処理を実行する。テキスト/ロゴ生成部160は、テキスト/ロゴ向け生成部134により生成された情報を用いてテキスト及びロゴのうち少なくとも1つを生成する。

The text/

映像生成モジュール100は、上述した構成により、あらかじめ保存されたプロンプトとユーザの入力を合わせてシナリオ生成のためのプロンプトを生成する。映像生成モジュール100は、生成されたプロンプトをLLMなどのAIモデルに入力することで、シナリオを生成する。また、映像生成モジュール100は、生成されたシナリオより、映像、サウンド、テキスト/ロゴを生成するためのプロンプトを生成する。映像生成モジュール100は、映像、サウンド、テキスト/ロゴを生成するためのプロンプト、シナリオ等を用いて、映像生成、サウンド生成、テキスト/ロゴ生成を実施する。

With the above-described configuration, the

コンポジット編集部170は、編集に関連する処理を実行する。例えば、コンポジット編集部170は、生成された映像、サウンド、テキスト/ロゴを一つにまとめ(合成し)、一つの映像とする処理を実行する。

The

評価部180は、各種の対象を評価する評価処理を実行する。評価部180は、上述した構成により生成された情報の評価を行う。例えば、評価部180は、シナリオデータと動画データのうち少なくとも1つの評価を示す情報を生成する。

The

クライアントUIモジュール190は、クライアント側のUI(User Interface)での出力に関連する処理を実行する。例えば、クライアントUIモジュール190は、クライアント側のUIでの出力に関連する各種情報を生成する。この場合、クライアントUIモジュール190は、ユーザ側で表示されるUIを生成する処理を実行する。クライアントUIモジュール190は、クライアントUI表示部400に表示させる各種情報を生成する。

The

また、情報取得モジュール200は、各種情報を取得する。情報取得モジュール200は、入力テキスト取得部210、センサ取得部220等を有する。入力テキスト取得部210は、キーボード320やマイク330により入力されたテキスト情報を取得する。例えば、入力テキスト取得部210は、ユーザがキーボード320やマイク330により入力したテキスト情報を取得する。例えば、入力テキスト取得部210は、動画生成に関する入力クエリをユーザから取得する取得部である。

In addition, the

センサ取得部220は、カメラ340やモーションキャプチャなどのセンサにより検知された情報(「センサ情報」ともいう)を取得する。情報取得モジュール200は、取得した各種情報を、映像生成モジュール100へ提供(送信)する。なお、情報取得モジュール200は、映像生成モジュール100と一体であってもよい。

The

センサ部300は、各種のセンサを有する。センサ部300は、ユーザの入力をセンシングする。センサ部300は、ユーザによる操作を受け付ける。例えば、センサ部300は、ユーザから動画編集に関する操作を受け付ける受付部である。例えば、センサ部300は、マウス310、キーボード320、マイク330、カメラ340、慣性計測装置であるIMU350等を有する。このように、センサ部300は、マウス310、キーボード320の他に、マイク330、カメラ340、IMU350を備えるユーザ端末(スマートフォン等)やモーションキャプチャなどのセンサなどを含み、ユーザの入力をセンシングする。

The

クライアントUI表示部400は、クライアント(ユーザ)に提示するための各種情報を表示する。クライアントUI表示部400は、クライアントUIモジュール190により生成されたUIをクライアントのディスプレイ(表示装置)に表示する。例えば、クライアントUI表示部400は、シナリオデータに基づいたストーリーボードを表示させる表示制御部である。ストーリーボードは、動画のカット毎に動画データを表示するように構成される。

The client

映像生成システム1は、図2に示すようなハードウェア構成であってもよい。図2は、本開示の映像生成システムに係るハードウェア構成の一例を示す図である。図2では、映像生成システム1は、クラウド側のコンピュータ10、クライアント側のコンピュータ20、カメラ等の各種のセンサを含むカメラ/センサ30等をハードウェア構成として有する。また、映像生成システム1には、学習データ等の情報リソース40、AIモデル50をコンピュータ10に提供する情報提供装置(コンピュータ)が含まれてもよい。

The

なお、図2に示すハードウェア構成は、一例に過ぎず、映像生成システム1は、所望の処理が実行可能であれば、任意のハードウェア構成が採用可能である。例えば、コンピュータ10とコンピュータ20とは一体であってもよい。また、情報リソース40やAIモデル50はコンピュータ10内部に保存されてもよい。

The hardware configuration shown in FIG. 2 is merely an example, and the

コンピュータ10は、CPU(Central Processing Unit)11、GPU(Graphics Processing Unit)12、通信装置13、メモリ/ストレージ14を備える。例えば、コンピュータ10は、図1中の映像生成モジュール100及び情報取得モジュール200に対応する。コンピュータ10は、映像生成サービスを提供するサービス提供装置(サーバ装置)であってもよい。CPU11及びGPU12は、いわゆるプロセッサであり、例えば映像生成等の各種の処理に関連する計算処理(演算処理)を実行する。

The

通信装置13は、コンピュータ20、情報提供装置等との間で情報を送受信するための通信機能を有する通信装置であり、例えば、通信回路、NIC(Network Interface Card)等であってもよい。通信装置13は、所定のネットワーク(インターネット等)を介してコンピュータ20、情報提供装置等の他の装置と通信を行う。例えば、通信装置13は、所定のネットワークと有線または無線で接続され、コンピュータ20、情報提供装置等の他の装置との間で情報の送受信を行う。

The communication device 13 is a communication device having a communication function for transmitting and receiving information between the

メモリ/ストレージ14は、各種の情報を記憶する記憶装置である。メモリ/ストレージ14は、例えば、RAM(Random Access Memory)、フラッシュメモリ(Flash Memory)等の半導体メモリ素子、または、ハードディスク、光ディスク等の記憶装置である。メモリ/ストレージ14は、CPU11及びGPU12等のプロセッサが処理に用いる各種情報を記憶する。メモリ/ストレージ14は、情報リソース40、AIモデル50等を記憶してもよい。

The memory/storage 14 is a storage device that stores various types of information. For example, the memory/storage 14 is a semiconductor memory element such as a random access memory (RAM) or a flash memory, or a storage device such as a hard disk or an optical disk. The memory/storage 14 stores various types of information used for processing by processors such as the CPU 11 and the GPU 12. The memory/storage 14 may also store

コンピュータ20は、CPU21、GPU22、通信装置23、メモリ/ストレージ24、IOインタフェース25を備える。例えば、コンピュータ20は、図1中のクライアントUI表示部400に対応する。コンピュータ20は、映像生成サービスを利用するユーザが利用する端末装置(PC(Personal Computer)、スマートフォン等の携帯デバイス等)であってもよい。CPU21及びGPU22は、いわゆるプロセッサであり、例えば映像表示等の各種の処理に関連する計算処理(演算処理)を実行する。なお、上記は一例に過ぎず、コンピュータ20は、所望の処理が可能であれば任意の構成が採用可能である。例えば、コンピュータ20は、ASIC(Application Specific Integrated Circuit)やFPGA(Field Programmable Gate Array)等の回路により映像表示等の各種の処理に関連する計算処理(演算処理)を実行してもよい。また、コンピュータ20は、メモリ(メモリ/ストレージ24等)にプログラムを保存する代わりに、プロセッサの回路内にプログラムを直接組み込むよう構成されても構わない。この場合、プロセッサは回路内に組み込まれたプログラムを読み出し実行することで機能を実現する。なお、本実施形態の各プロセッサは、プロセッサごとに単一の回路として構成される場合に限らず、複数の独立した回路を組み合わせて1つのプロセッサとして構成し、その機能を実現するようにしてもよい。また、コンピュータ10もコンピュータ20と同様に、所望の処理が可能であれば任意の構成が採用可能である。

The

通信装置23は、コンピュータ10、センサ30等との間で情報を送受信するための通信機能を有する通信装置であり、例えば、通信回路、NIC等であってもよい。通信装置23は、所定のネットワーク(インターネット等)を介してコンピュータ10、センサ30等の他の装置と通信を行う。例えば、通信装置23は、所定のネットワークと有線または無線で接続され、コンピュータ10、センサ30等の他の装置との間で情報の送受信を行う。

The

メモリ/ストレージ24は、各種の情報を記憶する記憶装置である。メモリ/ストレージ24は、例えば、RAM、フラッシュメモリ等の半導体メモリ素子、または、ハードディスク、光ディスク等の記憶装置である。メモリ/ストレージ24は、CPU21及びGPU22等のプロセッサが処理に用いる各種情報を記憶する。

The memory/storage 24 is a storage device that stores various types of information. For example, the memory/storage 24 is a semiconductor memory element such as a RAM or a flash memory, or a storage device such as a hard disk or an optical disk. The memory/storage 24 stores various types of information used for processing by processors such as the

IOインタフェース25は、入出力のインタフェース装置である。コンピュータ20は、IOインタフェース25を介して、センサ30からの入力を受信する。例えば、コンピュータ20は、IOインタフェース25を介して、キーボードやマウス等の入力デバイスからの入力を受信する。また、コンピュータ20は、IOインタフェース25を介して、ディスプレイ(表示装置)、スピーカー(音声出力装置)から情報を出力させる。例えば、コンピュータ20は、IOインタフェース25を介して、ディスプレイ及びスピーカーにより映像を再生する。

The IO interface 25 is an input/output interface device. The

カメラ等の各種のセンサ30は、ユーザの入力をセンシングする。カメラ等の各種のセンサ30は、ユーザによる操作を受け付ける。例えば、センサ30は、図1中のセンサ部300に対応する。また、情報リソース40は、学習データ等の様々な情報を含む。例えば、情報リソース40は、LLM等の各種のAIモデルの学習に用いられる学習データを含む。AIモデル50は、LLM等の映像生成に関連する処理に用いられるAIモデルの情報を含む。例えば、AIモデル50は、後述するモデルM1~M3等の各種のAIモデルの情報を含む。なお、上述したように、映像生成システム1は、図2に示す構成以外の構成をとってもよい。

The

<1-2.本開示の映像生成システムによる処理>

ここから、映像生成システムによる処理について説明する。まず、図3に示す映像生成処理の流れの一例について説明する。図3は、本開示の映像生成処理の流れの一例を示す図である。なお、以下で映像生成システム1を処理主体として説明する処理は、映像生成システム1に含まれる装置構成に応じて、その処理を実行可能ないずれの装置が行ってもよい。

1-2. Processing by the image generation system of the present disclosure

From here, the processing by the video generation system will be described. First, an example of the flow of the video generation processing shown in Fig. 3 will be described. Fig. 3 is a diagram showing an example of the flow of the video generation processing of the present disclosure. Note that the processing described below with the

図3では「User's Input」と表記するユーザ入力情報UIN1は、ユーザが映像生成のために入力した情報(「入力クエリ」ともいう)に対応する。なお、入力クエリは、テキスト(文字情報)に限らず、任意の情報が採用可能である。入力クエリは、テキスト、画像、音声、3Dデータのうち少なくとも1つを含む任意の情報であってもよい。 User input information UIN1, denoted as "User's Input" in FIG. 3, corresponds to information input by the user for image generation (also referred to as "input query"). Note that the input query is not limited to text (character information) and any information can be used. The input query may be any information including at least one of text, image, audio, and 3D data.

映像生成システム1は、ユーザ入力情報UIN1を用いて、図3では「LLM」と表記するモデルM1の入力として用いられるシナリオ生成用情報(「第1の入力情報」ともいう)を生成するが、この点については後述する。例えば、モデルM1は、第1の入力情報の入力に応じてシナリオデータを出力する第1のモデルである。モデルM1は、入力に応じて所望の出力が可能であれば、LLM(大規模言語モデル)等の任意のAIモデルが採用可能である。なお、モデルM1等のAIモデルに関しては後述する。

The

映像生成システム1は、モデルM1に第1の入力情報を入力し、モデルM1にシナリオデータであるシナリオFD1を出力させることにより、シナリオFD1を生成する。そして、映像生成システム1は、シナリオFD1、シナリオFD1を入力とするモデルM2の出力、及びユーザ入力情報UIN2等を用いて、モデルM3の入力として用いられるコード生成用情報(「第2の入力情報」ともいう)であるUSD生成必要情報SD1を生成する。例えば、モデルM3は、第2の入力情報の入力に応じてコードを出力する第2のモデルである。モデルM3は、入力に応じて所望の出力が可能であれば、LLM(大規模言語モデル)等の任意のAIモデルが採用可能である。

The

なお、図3では、USD生成必要情報SD1を1つのみ図示するが、例えば生成するUSDファイルの数に応じてUSD生成必要情報SD1は複数あってもよい。例えば、USD生成必要情報SD1は、図18に示すようなデータ構造に対応して生成するUSDファイルの数に応じてUSD生成必要情報SD1は複数あってもよい。 Note that, although only one piece of information SD1 required for generating USD is illustrated in FIG. 3, there may be multiple pieces of information SD1 required for generating USD, for example, depending on the number of USD files to be generated. For example, there may be multiple pieces of information SD1 required for generating USD, depending on the number of USD files to be generated corresponding to the data structure shown in FIG. 18.

例えば、モデルM2は、シナリオデータの入力に応じて、そのシナリオデータに対応するテンプレート等を出力するモデルであってもよい。モデルM2は、入力に応じて所望の出力が可能であれば、任意のAIモデルが採用可能である。例えば、ユーザ入力情報UIN2は、映像生成での制約条件の指定等を行うための情報であってもよい。なお、映像生成システム1は、シナリオFD1とテンプレート入力情報とを用いて第2の入力情報を生成してもよいがこの点については後述する。

For example, model M2 may be a model that outputs a template or the like corresponding to scenario data in response to the input of that scenario data. Any AI model can be adopted for model M2 as long as it is capable of providing the desired output in response to the input. For example, user input information UIN2 may be information for specifying constraint conditions for image generation. Note that

映像生成システム1は、モデルM3にUSD生成必要情報SD1を入力し、モデルM3に図3では「python」と表記するパイソンコードOD1を出力させることにより、パイソンコードOD1を生成する。例えば、パイソンコードOD1は実行によりUSD形式のデータ(「USDファイル」ともいう)を生成する(プログラム)コードである。なお、パイソンは一例に過ぎず、コードは所望の3DCG用のデータを生成可能であれば、パイソンに限らず任意の形式のコードが採用可能である。また、USDは一例に過ぎず、3DCG用のデータであれば、FBX(Film Box)等任意の形式が採用可能である。映像生成システム1は、パイソンコードOD1を実行し、図3では「USD」と表記するUSDファイルOD2を生成する。

The

映像生成システム1は、図3では「Renderer」と表記するレンダリング処理PS1を実行することにより、図3では「PreMovie」と表記する動画データMV1を生成する。例えば、動画データMV1は、後述するリファイン処理PS2を実行する前のデータ(「第1の動画データ」ともいう)である。

The

映像生成システム1は、図3では「Refiner」と表記するリファイン処理PS2を実行することにより、図3では「RefinedMovie」と表記する動画データMV2を生成する。例えば、リファイン処理PS2は、動画データの画質を改善する画質改善処理である。動画データMV2は、リファイン処理PS2により第1の動画データである動画データMV1が更新された後のデータ(「第2の動画データ」ともいう)である。

The

映像生成システム1は、動画データMV2、ユーザ入力情報UIN3等を用いてコンポジット編集PS3を実行することにより、図3では「FinalMovie」と表記する動画データMV3を生成する。例えば、コンポジット編集PS3は、ユーザ入力情報UIN3が示すユーザの編集指示に応じて、動画データMV2を更新(編集)する処理を実行することにより、動画データMV2が更新された動画データMV3を生成する。

The

なお、図3に示す映像生成処理の流れは一例に過ぎず、映像生成システム1は、ユーザの入力クエリから動画データを生成可能であれば、任意の処理態様が採用可能である。例えば、図3では、モデルM1がコード(パイソンコード)を出力する場合を一例として説明したが、モデルM1は、USDファイル等の3DCG用のデータを出力するモデルであってもよい。また、映像生成システム1は、図3に示す処理に限らず、様々な態様の映像生成処理を行ってもよい。この点の一例について図4を用いて説明する。図4は、本開示の映像生成処理の流れの他の一例を示す図である。図4は、音生成必要情報SD2及びテキストロゴ必要情報SD3を生成し、それらを用いて映像生成処理を行う点等で図3と相違する。なお、図3で説明した内容と同様の点については適宜説明を省略する。

Note that the flow of the image generation process shown in FIG. 3 is merely an example, and the

図4では、映像生成システム1は、シナリオFD1、シナリオFD1を入力とするモデルM2の出力、及びユーザ入力情報UIN2等を用いて、図3では「AI」と表記するモデルM4の入力として用いられる音生成用情報である音生成必要情報SD2を生成する。例えば、モデルM4は、音生成必要情報SD2及び動画データMV2の入力に応じて各種の音データを出力するモデルである。モデルM4は、入力に応じて所望の出力が可能であれば、任意のAIモデルが採用可能である。なお、モデルM4は、音生成必要情報SD2のみを入力とするモデルであってもよい。

In FIG. 4, the

映像生成システム1は、モデルM4に音生成必要情報SD2を入力し、モデルM4にBGM(BackGround Music)用の音データAD1、SE用の音データAD2、Narration用の音データAD3等を出力させることにより、映像に対応する音データを生成する。また、映像生成システム1は、ユーザ入力情報UIN4を用いて、音データAD1、AD2、AD3を生成してもよい。例えば、モデルM4が音データAD1、AD2、AD3を1つの音データとして出力する場合、映像生成システム1は、ユーザ入力情報UIN4での指定に基づいて、モデルM4が出力した1つの音データから、音データAD1、AD2、AD3を抽出して、音データAD1、AD2、AD3を生成してもよい。

The

図4では、映像生成システム1は、シナリオFD1、シナリオFD1を入力とするモデルM2の出力、及びユーザ入力情報UIN2等を用いて、モデルM5の入力として用いられるテキストロゴ生成用情報であるテキストロゴ生成必要情報SD3を生成する。例えば、モデルM5は、テキストロゴ生成必要情報SD3の入力に応じてテキスト及びロゴのうち少なくとも1つを出力するモデルである。モデルM5は、入力に応じて所望の出力が可能であれば、任意のAIモデルが採用可能である。

In FIG. 4, the

映像生成システム1は、モデルM5にテキストロゴ生成必要情報SD3を入力し、モデルM5にText用のテキストロゴデータDI1、Logo用のテキストロゴデータDI2等を出力させることにより、映像に対応するテキストロゴデータを生成する。

映像生成システム1は、動画データMV2、音データAD1、AD2、AD3、テキストロゴデータDI1、DI2、ユーザ入力情報UIN3等を用いてコンポジット編集PS3を実行することにより、動画データMV3を生成する。例えば、コンポジット編集PS3は、動画データMV2、音データAD1、AD2、AD3、テキストロゴデータDI1、DI2等を一つにまとめ(合成し)、一つの映像とした動画データMV3を生成する処理を実行する。

The

上述した図3及び図4は、初期状態としてシナリオやUSD生成必要情報、USD、PreMovie、RefinedMovie等がない状態での処理の一例を示す。上述したように、映像生成システム1は、ユーザの入力クエリに基づき、シナリオを生成するためのプロンプトを生成し、自然言語モデルへプロンプトを提供してシナリオを生成し、シナリオに記載のテキスト情報より、動画を構成するコード出力のためのプロンプトを生成し、自然言語モデルへプロンプトを提供して、動画を構成するコードを生成し、動画を生成する。このように、映像生成システム1では、動画を作る際、ユーザの作りたいものや目的を入力すると、3DCGの知識や映像制作の知識がなくても効果的な映像のストーリーボードと動画が生成される。また、映像生成システム1では、ストーリーボードにすることで、その後に編集しやすくなる。なおこれらの点についての詳細は後述する。

The above-mentioned Figures 3 and 4 show an example of processing in an initial state where there is no scenario, information required for generating USD, USD, PreMovie, RefinedMovie, etc. As described above, the

また、映像生成システム1は、映像生成に関連する各種の処理を行ってもよい。例えば、映像生成システム1は、生成した情報を対象として評価処理を行ってもよい。この点について、図5を用いて、評価処理の流れの一例について説明する。図5は、本開示の評価処理の流れの一例を示す図である。

The

図5では、映像生成システム1は、シナリオFD1、USD生成必要情報SD1、音生成必要情報SD2、テキストロゴ生成必要情報SD3のうち少なくとも1つを入力し、モデルM10に、入力された情報についての評価を示す評価テキスト情報EV1を出力させることにより、生成した情報に対する評価を行う。例えば、モデルM10は、情報の入力に応じて、その入力された情報の評価を出力するモデルである。例えば、モデルM10は、シナリオFD1の入力に応じて、その入力されたシナリオFD1の評価を示す評価テキストを出力する。なお、モデルM10は、シナリオFD1、USD生成必要情報SD1、音生成必要情報SD2、テキストロゴ生成必要情報SD3ごとに入力を受け付けるモデルであってもよいし、これらの情報を組み合わせた入力を受け付けるモデルであってもよい。また、モデルM10は、映像を示す情報(キャプション等)の入力に応じて、その入力された情報に対応する映像の評価を出力するモデルであってもよい。

In FIG. 5, the

ここから、上述した処理の流れについて、映像生成システム1が実行する各処理の具体例について記載する。なお、上述した内容と同様の点について適宜説明を省略する。

From here, specific examples of each process executed by the

例えば、映像生成システム1は、図6に示すように、シナリオ生成用情報(第1の入力情報)を生成する。図6は、シナリオ生成用情報の生成処理の一例を示す図である。図6では、映像生成システム1は、コンテンツCT1にユーザが入力したユーザ入力情報IDT1、IDT2をユーザの入力情報として取得する。コンテンツCT1は、「どういう動画を作りたいですか?」という質問事項、及び「スタイル」という質問事項の各々に対するユーザの入力情報を受け付けるためのコンテンツである。

For example, the

例えば、クライアントUI表示部400は、コンテンツCT1を表示し、センサ部300は、ユーザ入力情報IDT1、IDT2をユーザ入力情報として受け付ける。例えば、ユーザ入力情報IDT1、IDT2は、図3及び図4中のユーザ入力情報UIN1に対応する。

For example, the client

図6では、クライアントUI表示部400は、「どういう動画を作りたいですか?」という質問事項を表示する。センサ部300は、「どういう動画を作りたいですか?」という質問事項に対しては、「15秒のスニーカーのCM動画」というユーザ入力情報IDT1を受け付ける。また、クライアントUI表示部400は、「スタイル」という質問事項を表示する。センサ部300は、「スタイル」という質問事項に対しては「映画風」というユーザ入力情報IDT2を受け付ける。

In FIG. 6, the client

なお、映像生成システム1は、ユーザの入力情報を任意の態様により受け付けてもよく、複数の候補からユーザの選択を受け付けてもよい。例えば、映像生成システム1は、ユーザがキーボードやマイクから入力した情報をテキスト情報にして、ユーザの入力情報として受け付けてもよい。また、映像生成システム1は、自由文だけでなく、動画全体の秒数、スタイル、カメラワークなどの設定値、画像、動画などの他ファイルをユーザの入力情報として受け付けてもよい。

The

映像生成システム1は、ユーザ入力情報IDT1、IDT2、及びテンプレート入力情報であるテンプレートTP1を用いて、シナリオ生成用情報(第1の入力情報)であるプロンプトPT1を生成する。例えば、テンプレートTP1は、予め設定されたものであってもよいし、複数のテンプレート候補から選択されてもよい。例えば、映像生成システム1は、複数のテンプレート候補のうち、ユーザの入力情報に対応するテンプレートを選択してもよい。例えば、映像生成システム1は、ユーザ入力情報IDT1、IDT2が示す内容に基づいて、複数のテンプレート候補のうち、映画風の広告に関連するテンプレートTP1を選択してもよい。

The

例えば、映像生成システム1は、テンプレートTP1にユーザ入力情報IDT1、IDT2を反映することにより、プロンプトPT1を生成する。図6では、映像生成システム1は、制約条件のスタイルの項目に入力情報IDT2が示す「映画風」を追加し、入力文に入力情報IDT1が示す「15秒のスニーカーのCM動画」を追加することにより、プロンプトPT1を生成する。このように、映像生成システム1は、ユーザの入力情報により、シナリオを生成するためのプロンプトを生成する。なお、ユーザの入力情報は、一画面で入力されてもよいし、いくつかの質問に答えることにより入力されてもよいが、これらの点の例について後述する。

For example, the

また、映像生成システム1は、図7に示すように、シナリオデータを生成する。図7は、シナリオデータの生成処理の一例を示す図である。図7では、映像生成システム1は、プロンプトPT1を用いて、シナリオデータSN1を生成する。例えば、シナリオデータSN1は、図3及び図4中のシナリオFD1に対応する。シナリオデータSN1には、オープニングシーン、スニーカーを履くシーン等のシーンごとにその秒数、カットの説明などの情報が含まれる。

The

例えば、映像生成システム1は、LLM等であるモデルM1にプロンプトPT1を入力し、モデルM1にシナリオデータSN1を出力させることにより、シナリオデータSN1を生成する。このように、映像生成システム1は、生成したプロンプトをAI(LLMなど)に入力することにより、シナリオを生成する。なお、図7に示す情報(「シナリオ情報」ともいう)以外にも、シナリオデータSN1には、環境、登場人物、モーション、カメラワーク、ライティング、カラーなどの情報も含まれる。例えば、シナリオ生成には特徴が出るように、ユーザのこれまでの経験学習データや特定の監督や人の学習データを、モデルM1等にRAG(Retrieval-Augmented Generation)やファインチューンングで入れることで、映像生成システム1は、様々なシナリオバリエーションを生成することが可能となる。

For example, the

また、映像生成システム1は、図8に示すように、コード生成用情報(第2の入力情報)を生成する。図8は、コード生成用情報の生成処理の一例を示す図である。映像生成システム1は、シナリオデータSN1、及びテンプレート入力情報であるテンプレートTP2を用いて、コード生成用情報(第2の入力情報)であるプロンプトPT2を生成する。例えば、テンプレートTP2は、予め設定されたものであってもよいし、複数のテンプレート候補から選択されてもよい。例えば、映像生成システム1は、複数のテンプレート候補のうち、シナリオに対応するテンプレートを選択してもよい。例えば、映像生成システム1は、シナリオデータSN1が示す内容に基づいて、複数のテンプレート候補のうち、CMに関連するテンプレートTP2を選択してもよい。

The

例えば、映像生成システム1は、テンプレートTP2にシナリオデータSN1を反映することにより、プロンプトPT2を生成する。図8では、映像生成システム1は、入力文にシナリオデータSN1が示す情報を追加することにより、プロンプトPT2を生成する。このように、映像生成システム1は、AIにより生成されたシナリオにより、映像向けのプロンプトを生成する。

For example, the

例えば、図8は、人に関するシナリオからUSD-Pythonに変換するためのプロンプト生成の一例を示す。USD-Pythonへの変換は変換の形式の一例に過ぎず、変換はUSD-Pythonに限らずに、任意の変換の形式であってもよい。例えば、変換の形式は、Blender向けPython、またUSDなどの形式であってもよい。また、映像生成システム1は、人、環境、カメラワークなどの対象ごとに個別にプロンプトを生成してもよいし、まとめてプロンプトを生成してもよい。また、生成するプロンプトには、使用するアセットのパスやモーションのパスがされてもよいし、アセット/モーションのAI生成アルゴリズムに投げる(入力する)ためのソースコードやAPI(Application Programming Interface)が記載されてもよい。

For example, FIG. 8 shows an example of prompt generation for converting a scenario related to a person into USD-Python. Conversion into USD-Python is merely one example of a conversion format, and the conversion is not limited to USD-Python and may be any conversion format. For example, the conversion format may be Python for Blender, USD, or other formats. Furthermore, the

そして、映像生成システム1は、生成したプロンプトをAI(LLMなど)に入力することでUSD-Pythonファイルを生成する。なお、ファイルの形式はpython形式に限らず、USDなど他の形式でファイルが生成されてもよい。そして、映像生成システム1は、USDファイル等、レンダリングできる形式に変換し、レンダリングを実行することにより、PreMovie(mp4等の映像ファイル)を生成する。

Then, the

なお、映像生成システム1は、PreMovieを用いてコンポジット編集を行ってもよいが、図9に示すように、PreMovieに画質改善処理の一例であるリファイナ処理を行ってもよい。図9は、画質改善処理の一例を示す図である。図9では、映像生成システム1は、PreMovieである第1の動画IN1を入力として、RefinedMovieである第2の動画OT1を出力するDiffusionモデルであるモデルM11を用いたリファイナ処理により、第1の動画IN1から第2の動画OT1を生成する。

The

なお、リファイナ処理に用いられるAIモデル(モデルM11等)は、Diffusionモデルに限らず、LDM(Latent Diffusion Model)、LCM(Latent Consistency Model)などの任意のAIモデルが採用可能である。また、リファイナ処理には、AnimateDiff(時間方向安定化)、ControlNet(ラインアート制御)等の技術が用いられてもよい。このようなリファイナ処理により、映像生成システム1は、登場人物、背景、プロップ(小道具)などの一貫性を保ったまま、映像のクオリティを向上させることができる。

The AI model (such as model M11) used in the refiner process is not limited to the diffusion model, and any AI model such as the latent diffusion model (LDM) or latent consistency model (LCM) can be used. In addition, techniques such as AnimateDiff (time directional stabilization) and ControlNet (line art control) may be used in the refiner process. Through this refiner process, the

また、リファイナ処理には、動画だけでなくプロンプトを用いてもよい。例えば、モデルM11は、第1の動画IN1に加えて、プロンプトIN2を入力としてもよい。例えば、モデルM11は、プロンプトIN2により30代女性等の対象が指定された場合、第1の動画IN1中の30代女性の箇所を改善した第2の動画OT1を出力する。これにより、映像生成システム1は、第1の動画IN1のうちプロンプトIN2により指定された対象について画質等が改善された第2の動画OT1を生成する。

In addition, the refiner process may use prompts in addition to videos. For example, the model M11 may input prompt IN2 in addition to the first video IN1. For example, when a target such as a woman in her 30s is specified by prompt IN2, the model M11 outputs a second video OT1 in which the parts of the first video IN1 that represent the woman in her 30s have been improved. This allows the

上述した映像生成システム1の処理により、ユーザからは入力後にシナリオ(ストリーボード)と各カットの動画が生成されているように見え、その間の処理はシステム内に閉じている。これらの処理は、ユーザの入力テキストから一気にシナリオから全てのカット、リファイナ処理まで生成されることもありうるし、処理の途中で好みの選択などユーザの入力が行われてもよい。例えば、映像生成システム1においては、大筋のみを書いたシナリオを何パターンか生成後、ユーザが選択し、選択された大筋のシナリオを基に詳細シナリオと動画生成処理が実行されてもよい。また、映像生成システム1においては、シナリオ生成後、映像生成の前で生成される映像の登場人物を何パターンか生成し、ユーザが1つを選択後、動画をレンダリング処理やリファイナ処理を実行してもよい。

From the user's perspective, the above-mentioned processing of the

シナリオの構成要素として、カットの動画や代表とする画像(動画の1フレーム目など)、カットの説明、登場人物(ビジュアル、設定など)、各登場人物のモーション、ライティング、カメラワーク、背景の環境情報、カット間のトランジション、セリフ、ナレーションなどがありうる。これらはユーザに提示するものもあれば、ユーザに提示はせずに処理のために持つものもある。シナリオはカットごとに時系列に並んでいる。 The components of a scenario may include videos of cuts, a representative image (such as the first frame of a video), a description of the cut, characters (visuals, setting, etc.), the motions of each character, lighting, camera work, background environmental information, transitions between cuts, dialogue, narration, etc. Some of these are presented to the user, while others are not presented to the user and are kept for processing purposes. The scenario is arranged in chronological order by cut.

現在、Pika、Runway Gen-2、Lumiere、Stable Video Diffusionなどの様々な既存動画生成サービスが提供されている。これらは画像から空間方向や時間方向のベクトルを動かすDiffusionモデルを使い、動画を生成している。これらは、2Dの画像だけを使い映像を生成している。一方、映像生成システム1は、内部に3Dの情報を保持している。例えば、既存動画生成サービスでは動画内の指定した(X,Y)領域のみ修正することは可能であるが、服の色味だけ変化させたいのにモーションも変わってしまうという課題がある。一方で、映像生成システム1の場合、内部に3Dの情報を保持しているため、モーションのみ、ライティングのみ、人の服の色のみなどの狙った部分のみの修正が可能となる。

Currently, various existing video generation services are provided, such as Pika, Runway Gen-2, Lumiere, and Stable Video Diffusion. These generate videos using a diffusion model that moves vectors in the spatial and temporal directions from an image. These generate videos using only 2D images. On the other hand,

また、既存動画生成サービスはカットごとの動画を生成するのみであり、ユーザが各カットの一貫性を自ら担保する必要があるが、映像生成システム1はシナリオ(ストリーボード)から動画生成、修正まで一貫して実施することが可能であり、映像の出演者や背景、カラーグレーディングなど一貫性を持った動画生成をすることが可能である。

In addition, existing video generation services only generate videos for each cut, and users must ensure the consistency of each cut themselves. However,

<1-3.ユーザインタフェース>

ここから、映像生成システム1を利用するユーザに対するユーザインタフェース(UI)について記載する。なお、上述した内容と同様の点については適宜説明を省略する。

<1-3. User interface>

From here, we will describe the user interface (UI) for users who use the

映像生成システム1は、図10に示すように、コンテンツCT11をユーザに提供する。図10は、ユーザインタフェースの一例を示す図である。コンテンツCT11は、ユーザの入力情報を受け付けるための表示画面(コンテンツ)である。例えば、クライアントUI表示部400は、コンテンツCT11を表示する。ユーザは、コンテンツCT11を介して、どんな動画を作るかを指示するテキスト(図10では「Prompt」の欄)及びスタイルの選択(図10では「Style」の欄)をユーザの入力情報として入力する。このように、ユーザは、テキスト及びスタイルの選択をユーザの入力情報として入力する。例えば、ユーザは、コンテンツCT11に含まれる例文等を参考に「Prompt」の欄に文字情報を入力する。例えば、ユーザは、「Style」の欄の下向きの三角形を押す(クリック等)すること等により、表示される複数のスタイル候補から使用するスタイルを選択する。

As shown in FIG. 10, the

ユーザの入力情報の入力が完了したユーザは、図10中の「Ask AI Director」と表記されたボタンを選択することにより、映像生成システム1にユーザの入力情報に応じた動画生成を指示する。これにより、映像生成システム1は、ユーザの入力情報に応じた動画の生成処理を実行する。

When the user has completed inputting the user's input information, the user selects the button labeled "Ask AI Director" in FIG. 10 to instruct the

映像生成システム1は、図14に示すように、生成した動画に関するコンテンツCT15をユーザに提供する。図14は、ユーザインタフェースの一例を示す図である。コンテンツCT15は、生成した動画に対するユーザの操作(指示)を受け付けるためのストーリーボード画面(コンテンツ)である。図14に示すように、コンテンツCT15は、生成した動画のカット毎に動画データを表示するストーリーボード画面である。例えば、クライアントUI表示部400は、コンテンツCT15を表示する。このように、映像生成システム1は、ユーザの入力情報に応じて、ストーリーボードと映像が出力されるUIを提供する。ユーザは、ストーリーボード画面にて、各カットの動画、内容、ナレーション、セリフ、カメラワーク、BGM、ライティング、カラーなどの設定をする。

As shown in FIG. 14, the

なお、映像生成システム1は、ユーザに質問を行いながら、ユーザによるユーザの入力情報を受け付けてもよい。例えば、映像生成システム1は、図10中の「Ask AI Director」と表記されたボタンを選択した場合、図11~図13に示すように、ユーザとの会話(対話)によりユーザの入力情報を受け付ける。図11~図13は、ユーザインタフェースの一例を示す図である。図11中のコンテンツCT12は、図10で入力されたユーザの入力情報に対応して生成したサンプルを提示して、ユーザにイメージに近いものがあるかを質問する表示画面(コンテンツ)である。例えば、クライアントUI表示部400は、コンテンツCT12を表示する。

The

図12中のコンテンツCT13は、図11中のコンテンツCT12で提示したサンプルにイメージに合うものがないとのユーザの回答(入力情報)に応じて、詳細なターゲット等を要求(質問)する表示画面(コンテンツ)である。例えば、クライアントUI表示部400は、コンテンツCT13を表示する。

Content CT13 in FIG. 12 is a display screen (content) that requests (asks) detailed targets, etc. in response to the user's response (input information) that none of the samples presented in content CT12 in FIG. 11 match the image. For example, the client

図13中のコンテンツCT14は、ターゲット等を具体的に指定したユーザの回答(入力情報)に対応して再度生成したサンプルを提示して、ユーザにイメージに近いものがあるかを質問する表示画面(コンテンツ)である。例えば、クライアントUI表示部400は、コンテンツCT14を表示する。図13では、ユーザがマウスカーソルを4つのサンプルのうち左端のサンプル動画に合わせてクリック等の指定操作を行うことにより、4つのサンプルのうち左端のサンプル動画がイメージに近い動画であると、ユーザが指定した場合を示す。これにより、映像生成システム1は、4つのサンプルのうち左端のサンプル動画を指定するユーザの入力情報に応じた動画の生成処理を実行する。

Content CT14 in FIG. 13 is a display screen (content) that presents samples that have been regenerated in response to a user's answer (input information) that specifically specifies a target, etc., and asks the user whether there is one that is close to the image. For example, the client

この場合、映像生成システム1は、図14に示すように、生成した動画に関するコンテンツCT15をユーザに提供する。例えば、クライアントUI表示部400は、コンテンツCT15を表示する。このように、映像生成システム1は、初期入力内容で、ストーリーボードと動画を生成するにあたり、必要な情報が足りない場合はユーとの会話(対話)により必要な情報を収集しながら、詳細を詰めていってもよい。

In this case, the

また、映像生成システム1は、図15及び図16に示すように、ユーザに作りたい動画に関する短文を入力させ、その短文を基に動画のストーリーをいくつか生成し、気に入ったものをユーザに選択させてもよい。図15及び図16は、ユーザインタフェースの一例を示す図である。

As shown in Figs. 15 and 16, the

映像生成システム1は、図15に示すように、コンテンツCT21をユーザに提供する。コンテンツCT21は、ユーザの入力情報を受け付けるための表示画面(コンテンツ)である。例えば、クライアントUI表示部400は、コンテンツCT21を表示する。ユーザは、コンテンツCT21を介して、どんな動画を作りたいかを示す文章(短文)をユーザの入力情報として入力する。例えば、ユーザは、コンテンツCT21中の入力欄に文字情報を入力する。

As shown in FIG. 15, the

ユーザの入力情報の入力が完了したユーザは、コンテンツCT21中の入力欄の右端の「開始」と表記されたボタンを選択することにより、映像生成システム1にユーザの入力情報に応じた動画のストーリーの生成を指示する。これにより、映像生成システム1は、ユーザの入力情報に応じた動画のストーリーの生成処理を実行する。

When the user has finished inputting the user's input information, the user selects the button marked "Start" on the right side of the input field in content CT21 to instruct

映像生成システム1は、図16に示すように、生成した動画のストーリーに関するコンテンツCT22をユーザに提供する。図16中のコンテンツCT22は、図15で入力されたユーザの入力情報に対応して生成した動画のストーリーのサンプルを提示する表示画面(コンテンツ)である。例えば、クライアントUI表示部400は、コンテンツCT22を表示する。例えば、ユーザは、動画のストーリーのサンプルのうち、気に入ったものがあれば、そのサンプルの表示領域の右端の「続ける」と表記されたボタンを選択することにより、映像生成システム1に選択したサンプルに対応する動画生成を指示する。

As shown in FIG. 16, the

なお、映像生成システム1は、ユーザが気に入ったものがなければ別パターンを再度生成する。例えば、ユーザは、動画のストーリーのサンプルのうち、気に入ったものが無ければ、短文の表示領域の右端の「続ける」と表記されたボタンを選択することにより、映像生成システム1に別パターンの動画のストーリーのサンプルを再度生成することを指示する。これにより、映像生成システム1は、別パターンの動画のストーリーのサンプルを生成する。

If the user does not like any of the video story samples, the

<1-4.処理例>

ここから、上述した具体例以外に、映像生成システム1が実行する各処理の具体例について記載する。なお、上述した内容と同様の点について適宜説明を省略する。以下では、上述した映像生成システム1の処理における音等の生成処理、評価処理等についての具体例を説明する。なお、上述した内容と同様の点については適宜説明を省略する。

<1-4. Processing example>

From here, in addition to the specific examples described above, specific examples of each process executed by the

<1-4-1.音生成例>

例えば、映像生成システム1は、図17に示すように、音生成用情報(図3及び図4中の音生成必要情報SD2に対応)を生成する。図17は、音生成用情報の生成処理の一例を示す図である。映像生成システム1は、シナリオデータSN1、及びテンプレート入力情報であるテンプレートTP3を用いて、音生成用情報であるプロンプトPT3を生成する。例えば、テンプレートTP3は、予め設定されたものであってもよいし、複数のテンプレート候補から選択されてもよい。例えば、映像生成システム1は、複数のテンプレート候補のうち、シナリオに対応するテンプレートを選択してもよい。例えば、映像生成システム1は、シナリオデータSN1が示す内容に基づいて、複数のテンプレート候補のうち、CMに関連するテンプレートTP3を選択してもよい。

<1-4-1. Sound generation example>

For example, the

例えば、映像生成システム1は、テンプレートTP3にシナリオデータSN1を反映することにより、プロンプトPT3を生成する。図17では、映像生成システム1は、入力文にシナリオデータSN1が示す情報を追加することにより、プロンプトPT3を生成する。例えば、映像生成システム1は、シナリオにより合うサウンド(BGM等)を生成するために、シナリオの中からキーとなるフレーズをいくつか抽出するためのプロンプトを生成する。映像生成システム1は、生成したプロンプトをAI(LLM等)に入力することで、サウンド生成に必要なキーワードやテキスト情報を取得してもよい。

For example, the

映像生成システム1は、生成したプロンプトPT3を用いて、音データを生成する。例えば、映像生成システム1は、生成された動画とストーリーボード(シナリオデータSN1等)に記載のテキスト情報に基づき、BGMやSE、ナレーション、セリフなどのサウンド(音データ)を生成する。また、映像生成システム1は、セリフやナレーション等、既に必要な言葉(文字情報)がシナリオ内に抜き出されている場合は、プロンプトを生成せずに、その言葉(文字情報)をセリフやナレーション等の音データとして保存してもよい。

The

例えば、映像生成システム1は、得られたサウンド生成のための必要情報(音生成用情報)、動画、ユーザが入力した音声データ(音源、ユーザの声や鼻歌など)より音データを生成する。なお、映像生成システム1は、BGMやSEに関しては、text to music generationの様なTransformer(モデル)を利用し、テキストや動画からサウンドを生成してもよい。また、映像生成システム1は、text to music estimationの様なContrastive Learningされた音源を自然文から検索してもよい。

For example, the

また、映像生成システム1は、セリフやナレーションに関しては、その言葉自体と、シナリオから得られた人物像に関するテキスト情報を元に、text to speech(DiffusionモデルやFlow Matchingなど)で音声を生成してもよい。また、映像生成システム1は、生成された動画と音声をつなげる際、音声の開始終了時間、音量等を示すため、動画内もしくは音声ファイル内にメタ情報を組み込んでもよい。

In addition, for lines and narration, the

<1-4-2.テキストロゴ生成例>

例えば、映像生成システム1は、テキストロゴ生成用情報(図3及び図4中のテキストロゴ生成必要情報SD3に対応)を生成する。映像生成システム1は、生成したストーリーボード(シナリオデータSN1等)に基づき、映像上に表示されるテキストやロゴ情報(キャプション、タイトル、ロゴ、説明文等)を生成する。

<1-4-2. Example of text logo generation>

For example,

例えば、生成されたシナリオ内に、表示するテキスト文章が明確に記載されている場合もあるが、明確に記載されていない場合は、映像生成システム1は、テキスト情報(テキストロゴデータ等)を生成するためのプロンプトを生成し、AI(LLMなど)に投げてテキスト情報を生成する。また、映像生成システム1は、ユーザが表示するテキストを自ら入力した場合、ユーザが入力したその情報をテキスト情報(テキストロゴデータ等)として用いてもよい。

For example, the text sentence to be displayed may be clearly stated in the generated scenario, but if it is not clearly stated, the

また、テキスト表示のフォントやサイズ位置は、任意の方法により決定される。例えば、映像生成システム1は、Diffusionモデル、VAE(Variational Auto-Encoder)、GAN(Generative Adversarial Networks)、DALL E、StyleGAN、StyleGAN2、Pix2Pix、TransGAN、LLMなどの任意のAIを用いて、テキスト表示のフォントやサイズ位置を決定してもよい。また、テキスト表示のフォントやサイズ位置は、ユーザが自ら手動で設定してもよい。

The font, size, and position of the text display may be determined by any method. For example, the

ロゴやイメージに関しては、ユーザが画像や動画をjpeg形式やmp4形式等で入力してもよい。また、ロゴやイメージに関しては、映像生成システム1は、画像生成のためのプロンプトを生成し、Diffusionモデル、VAE、GAN、DALL E、StyleGAN、StyleGAN2、Pix2Pix、TransGAN、LLMなどの任意のAIに投げてロゴ情報を生成してもよい。

Regarding logos and images, the user may input images or videos in jpeg or mp4 format, etc. Also, regarding logos and images, the

また、映像生成システム1は、テキストやロゴ情報と動画をつなげる際、テキストやロゴの開始終了時間や位置、大きさを明確(メタ情報)に示すため、動画内もしくはテキストやロゴ自体にメタ情報を組み込んでもよい。

In addition, when linking text or logo information with a video, the

<1-4-3.再学習例>

また、映像生成システム1は、シナリオや映像を生成する際、取り替え可能な特定の学習データに基づき、その学習データにしか出せないシナリオや映像を生成してもよい。例えば、これまで制作した映像や画像を基に学習データとして再学習する事が可能である。RAGやファインチューンングで再学習することで、生成されるシナリオや映像を変化させることができる。すなわち、映像生成システム1は、過去に制作したユーザ個人のデータ(履歴)を再学習することも可能であるし、特定の映画監督の作品を学習データとして再学習したモデルで生成することも可能である。

<1-4-3. Re-learning example>

Furthermore, when generating a scenario or image, the

また、その学習データは、個人のPC上で再学習させることも可能であるし、サーバ上で再学習させることも可能である。学習データは、LLMやDiffusionモデルなど数多くのモデルを学習させるための学習データとなる。全体のシナリオはA監督を用いてシナリオ生成したいが、映像のカラーは別のB監督を用いてカラーグレーディングを生成したい場合等においては、映像生成システム1は、特定の部分に関して別の学習データで再学習してもよい。

The learning data can also be re-learned on an individual's PC or on a server. The learning data is used to train a number of models, such as the LLM and Diffusion model. In cases such as when it is desired to generate an overall scenario using director A, but to generate color grading for the video color using a different director B, the

<1-4-4.USD更新例>

上述したように、映像生成システム1は、ユーザの入力情報と生成されたストーリーボードのテキスト情報に基づき、既存動画の元となる3DCGアセットやレンダリング方法などを修正する。そして、映像生成システム1は、新しく動画を構成するコード出力のためのプロンプトを出力し、自然言語モデルへプロンプトを提供して、動画を構成するコードを出力し、動画を生成する。これにより、映像生成システム1は、ユーザが3DCGや映像制作の知識がなくても、ユーザの入力に合わせて映像を修正することができる。

<1-4-4. USD update example>

As described above, the

映像生成システム1では、映像(動画)を生成した後、シナリオ情報、映像の情報などはテキストや動画として保存されている。そのため、ユーザはこれらの情報を入力情報(テキストやセンサなど)で修正することが可能である。

After generating a video (video),

例えば、映像生成システム1では、USDファイルは図18に示すように、アセットやモーションごとにわかれて保存される。図18は、USDファイルの一例を示す図である。例えば、図18に示すデータ構造において、上位の階層のUSDには下位の階層のUSDへのパス(ファイルパス)が含まれてもよい。

For example, in the

例えば、全体USDには、環境アセットUSD、人アセットUDS、カメラUSD等へのパスが含まれる。また、環境アセットUSDには、建物アセットUSD、PropアセットUSDへのパスが含まれる。また、建物アセットUSDには、建物自体のメッシュ情報等が含まれる。また、人アセットUSDには、人のメッシュ情報、モーションUSDへのパスが含まれる。このように、USDファイル等の3DCG用のデータ(3Dデータ)は、複数のデータセットを含んでもよい。なお、図18に示すUSDファイルの構成(データ構造)は一例に過ぎず、任意の構成が採用可能であり、全体が一塊(1つのデータセット)のUSD(USDファイル)として構成されてもよい。 For example, the entire USD includes paths to the environment assets USD, human assets UDS, camera USD, etc. The environment assets USD also include paths to the building assets USD and prop assets USD. The building assets USD also include mesh information of the building itself, etc. The human assets USD also include paths to human mesh information and motion USD. In this way, data for 3DCG (3D data) such as a USD file may include multiple data sets. Note that the configuration (data structure) of the USD file shown in FIG. 18 is merely an example, and any configuration can be adopted, and the entire USD (USD file) may be configured as one block (one data set).

修正が行われる際は、図19に示すような処理フローにより、映像生成システム1がユーザの修正情報をAI(LLMなど)で解析し、USDを取り替えるかUSDの一部を修正するかにより、処理が変わる。また、修正後はレンダリング処理とリファイン処理が実行される。図19は、映像生成システムが実行する処理手順を示すフローチャートである。具体例には、図19は、USDファイルの書き換えに関する処理手順を示すフローチャートである。

When modifications are made, the

まず、映像生成システム1は、ユーザの修正情報入力を受け付ける(ステップS101)。例えば、センサ部300は、ユーザによる修正を指示する入力情報を受け付ける。映像生成システム1は、AIにて入力を解析する(ステップS102)。例えば、映像生成モジュール100は、各種モデル等を用いてユーザによる修正を指示する入力情報の内容を解析する。

First, the

映像生成システム1は、既存USDファイルの形式を認識する(ステップS103)。例えば、映像生成モジュール100は、修正前の状態におけるUSDファイルの形式を認識する。映像生成システム1は、USDの一部を修正するか否かを判定する(ステップS104)。例えば、映像生成モジュール100は、ユーザによる修正を指示する入力情報の内容及び既存USDファイルの形式に基づいて、USDの一部を修正するか否かを判定する。

The

映像生成システム1は、USDの一部を修正する場合(ステップS104:Yes)、修正用USD-Python生成のためのプロンプトを生成する(ステップS105)。例えば、映像生成モジュール100は、USDの一部を修正する場合、修正用USD-Python生成のためテンプレート等を用いて、修正用USD-Python生成のためのプロンプトを生成する。

When a portion of the USD is to be modified (step S104: Yes), the

映像生成システム1は、AI(LLM等)にてUSD-Pythonを生成する(ステップS106)。例えば、映像生成モジュール100は、USD-Pythonを生成するためのモデルに、プロンプトを入力することにより、USD-Pythonを生成する。

The

映像生成システム1は、修正対象USDファイルを置き換える(ステップS107)。例えば、映像生成モジュール100は、生成したUSD-Pythonを修正対象USDファイルに反映することにより、修正対象USDファイルを置き換える。このように、映像生成システム1は、USDファイルの複数のデータセットのうち少なくとも1つを更新する。例えば、映像生成システム1は、USDファイルの複数のデータセットのうち一部を更新する処理を実行する。

The

映像生成システム1は、更新後のUSDファイルを用いてレンダリング処理を実行する(ステップS108)。例えば、映像生成モジュール100は、書き換え後、すなわち修正後のUSDファイルを用いてレンダリング処理を実行する。

The

一方、映像生成システム1は、USDの一部を修正しない場合(ステップS104:No)、作成用USD-Python生成のためのプロンプトを生成する(ステップS109)。例えば、映像生成モジュール100は、USDの一部を修正しない、すなわちUSDを新たに作成(生成)する場合、作成用USD-Python生成のためテンプレート等を用いて、作成用USD-Python生成のためのプロンプトを生成する。

On the other hand, if the

映像生成システム1は、AI(LLM等)にてUSD-Python及びUSDを生成する(ステップS110)。例えば、映像生成モジュール100は、USD-Pythonを生成するためのモデルに、プロンプトを入力することにより、USD-Python及びUSDを生成する。

The

映像生成システム1は、修正対象USDファイルと置き換える(ステップS111)。例えば、映像生成モジュール100は、生成したUSDを、修正対象USDファイルと置き換える。このように、映像生成システム1は、USDファイルを更新する処理を実行する。例えば、映像生成システム1は、USDファイルの複数のデータセット全体を更新する処理を実行する。そして、映像生成システム1は、ステップS108の処理を実行する。例えば、映像生成モジュール100は、置き換え後、すなわち修正後のUSDファイルを用いてレンダリング処理を実行する。

The

ここで上述した修正に関するユーザインタフェース(UI)について記載する。映像生成システム1は、図20に示すように、コンテンツCT31をユーザに提供する。図20は、ユーザインタフェースの一例を示す図である。コンテンツCT31は、ストーリーボード等、生成した動画に関する情報を提示し、ユーザの修正指示を受け付けるための表示画面(コンテンツ)である。例えば、クライアントUI表示部400は、コンテンツCT31を表示する。

Now, the user interface (UI) related to the above-mentioned modifications will be described. As shown in FIG. 20, the

ユーザは、コンテンツCT31を介して、生成された動画に対しての修正を指示する情報を入力する。例えば、ユーザが動画の特定の部分をクリックし、テキストで修正内容を入力した場合、映像生成システム1は、USDを更新し、修正内容が反映された動画に更新(変更)する。

The user inputs information instructing corrections to be made to the generated video via content CT31. For example, when the user clicks on a specific part of the video and inputs corrections in text, the

図20では、ユーザが一番上のカット(サムネイル)画像を選択し、「子供がスキップしてお母さんによっていく」という修正を指示した場合を示す。この場合、映像生成システム1は、生成した動画のうち、一番上のカット(サムネイル)画像に対応する部分を、「子供がスキップしてお母さんによっていく」という修正指示を基にUSDを更新し、修正内容が反映された動画を生成する。

Figure 20 shows a case where the user selects the top cut (thumbnail) image and instructs a modification to "child skips and runs to mother." In this case, the

なお、上記のUIは一例に過ぎず、映像生成システム1は、様々な態様によりユーザの修正指示を受け付けてもよい。例えば、映像生成システム1は、図21に示すように、コンテンツCT32をユーザに提供し、ユーザの修正指示を受け付けてもよい。図21は、ユーザインタフェースの一例を示す図である。コンテンツCT32は、ユーザの修正指示を受け付けるための表示画面(コンテンツ)である。例えば、クライアントUI表示部400は、コンテンツCT32を表示する。

Note that the above UI is merely an example, and the

また、映像生成システム1は、図22に示すように、コンテンツCT33をユーザに提供し、ユーザの修正指示を受け付けてもよい。図22は、ユーザインタフェースの一例を示す図である。コンテンツCT33は、ユーザの修正指示を受け付けるための表示画面(コンテンツ)である。例えば、クライアントUI表示部400は、コンテンツCT33を表示する。

Also, as shown in FIG. 22, the

ユーザは、コンテンツCT32またはコンテンツCT33を介して、生成された動画に対しての修正を指示する情報を入力する。これにより、映像生成システム1は、ユーザからの修正指示を受け付けて、修正指示を基にUSDを更新し、修正内容が反映された動画を生成する。例えば、ユーザは動画中に出てくる人物や物を選択し、選択した対象に関するモーションの設定をテキストで編集することができる。また、ユーザは選択した対象のアセットを変更することができる。また、ユーザはカメラワークについてもテキストで編集することができる。また、ユーザは上記以外にも、動画の背景や照明の設定をテキストで編集することができる。

The user inputs information instructing corrections to the generated video via content CT32 or content CT33. As a result, the

なお、上記では動画の一例として説明したが、映像生成システム1は、ユーザの修正指示に基づいて、サウンド情報(BGM、SE、ナレーション、セリフなど)やテキストロゴ情報などに対しての修正処理を実行してもよい。

Although the above description is given as an example of a moving image, the

<1-4-5.評価例>

また、映像生成システム1は、評価処理を実行する。例えば、映像生成システム1は、モデルM10等のAIモデルを用いてシナリオデータについての評価テキストを生成する。例えば、映像生成システム1は、シナリオデータについて生成した評価テキストを基に、ユーザが行う編集(修正等)の指示を基に、シナリオデータを再度生成してもよい。映像生成システム1は、生成した評価テキストを提示する。これにより、ユーザは評価を見ながら映像制作を行うことができる。

<1-4-5. Evaluation example>

Furthermore, the

例えば、映像生成システム1は、シナリオデータについての評価テキストをユーザに提示し、提示した評価テキストを確認したユーザからシナリオデータに対する編集の指示を受け付ける。映像生成システム1は、ユーザから受け付けた編集の指示を基に、シナリオデータを生成する。例えば、映像生成システム1は、ユーザから受け付けた編集の指示を基に、シナリオデータの内容を変更(更新)する。映像生成システム1は、評価テキストを基に生成されたシナリオデータを基に、コードを生成する。映像生成システム1は、評価テキストを基に生成されたコードを用いて動画データを生成する。

For example, the

なお、映像生成システム1は、評価テキストを基にシナリオデータまたはコードのうち少なくとも1つを自動で生成(更新)してもよい。例えば、映像生成システム1は、シナリオデータについての評価テキストが示す内容に対応するようにシナリオデータの内容を変更してもよい。例えば、映像生成システム1は、シナリオデータについての評価テキストがある登場人物の向きが良くないことを示す場合、その登場人物の向きを変更したシナリオデータを生成する。なお、上記は一例に過ぎず、映像生成システム1は、評価テキストを適宜用いて、シナリオデータまたはコードのうち少なくとも1つを生成してもよい。

The

映像生成システム1では、映像(動画)を生成した後、シナリオ情報、映像の情報、音情報、テキスト/ロゴ情報などはテキストや動画ファイル、サウンドファイル、画像ファイルなどで保存されている。そのため、映像生成システム1は、これらの情報を用いた評価処理を行うことが可能である。映像生成システム1は、ユーザの入力情報と生成されたストーリーボードのテキスト情報、評価テキストに基づき、既存動画の元となる3DCGアセットやレンダリング方法などを修正し、新しく動画を構成するコード出力のためのプロンプトを出力し、自然言語モデルへプロンプトを提供して、動画を構成するコードを出力し、動画を生成する。例えば、映像生成システム1は、ユーザの入力情報と生成されたストーリーボードのテキスト情報に基づき、評価テキスト(図5中の評価テキスト情報EV1に対応)を生成するためのプロンプトを出力し、自然言語モデルへプロンプトを提供して評価テキストを生成してもよい。例えば、映像生成システム1は、シナリオの評価については、シナリオ情報を基に評価のためのプロンプトを生成しAI(LLM等)に入力することで、シナリオの評価を示す評価テキストを生成してもよい。

In the

また、映像生成システム1は、映像の構成の評価については、動画の1フレームをAI(Contrastive Captioner Model、Image Captioning Modelなど)に入力することで動画のキャプションを取得する。そして、映像生成システム1は、取得したキャプションとシナリオ文をAI(LLM等)に入力することで、映像の構成の評価を示す評価テキストを生成する。例えば、映像生成システム1は、取得したキャプションとシナリオ文をAI(LLM等)で比較することでキャプション通りの画になっているかを評価してもよい。また、映像生成システム1は、ユーザが評価をして欲しいと希望する評価者像の指定を受け付けてもよい。例えば、映像生成システム1は、マーケット戦略、コピーライター、映像監督、特定の人などの視点で評価を行ってもよい。

In addition, when evaluating the composition of a video, the

<1-4-6.複数カットの選択例>

ここから、編集処理についていくつか例示を記載する。従来技術では、ストーリーボード上では複数カットを同時に修正できないという課題がある。このように、従来技術には、ユーザビリティに関する課題があり、ユーザビリティの改善の余地がある。そこで、映像生成システム1は、図23に示すように、複数のカットを選択して編集処理(修正処理)を行ってもよい。図23は、編集処理の一例を示す図である。具体例には、図23は、複数カットの選択に基づく編集処理の一例を示す図である。

<1-4-6. Example of multiple cut selection>

From here, some examples of the editing process will be described. In the conventional technology, there is a problem that multiple cuts cannot be simultaneously corrected on a storyboard. In this way, the conventional technology has a problem regarding usability, and there is room for improvement in usability. Therefore, the

映像生成システム1は、図23に示すように、コンテンツCT41をユーザに提供し、ユーザの複数カットの選択に応じた修正指示を受け付けてもよい。コンテンツCT41は、カットCU1~CU4等の複数のカット(シーン)を含む動画に対するユーザの修正指示を受け付けるための表示画面(コンテンツ)である。例えば、クライアントUI表示部400は、コンテンツCT41を表示する。

As shown in FIG. 23, the

ユーザは、コンテンツCT41を介して、カットCU1~CU4のうち、複数のカットを選択し、選択した複数のカットに対しての修正を指示する情報を入力する。例えば、ユーザは、コンテンツCT41中のカットCU1~CU4のうち、カットCU1~CU3が表示された範囲を選択する操作(線で囲む操作等)を行うことやカットCU1~CU3の各々をクリックすること等により、カットCU1~CU3を選択する。 The user selects multiple cuts from among cuts CU1 to CU4 via content CT41, and inputs information instructing corrections to the selected multiple cuts. For example, the user selects cuts CU1 to CU3 by performing an operation to select the range in which cuts CU1 to CU3 are displayed (such as by surrounding it with a line) among cuts CU1 to CU4 in content CT41, or by clicking on each of cuts CU1 to CU3.

そして、ユーザは、カットCU1~CU3を選択した後に、修正指示を示すプロンプト(文字情報等)を、ユーザの入力情報として入力することにより、映像生成システム1にカットCU1~CU3を対象とした修正を指示する。映像生成システム1は、ユーザからの修正指示に応じて、カットCU1~CU3を対象とした修正を実行する。これにより、ユーザは、複数のカットを選択し、プロンプトを入力することで選択されたカットの構成やカット内容を修正することができる。例えば、各カットのシナリオ情報には、カットの内容、登場人物、カット撮影時間帯などが含まれており、映像生成システム1は、ユーザの入力情報とシナリオ情報をAI(LLMなど)に与えることで、シナリオを再生成する。なお、映像生成システム1は、ユーザの修正指示の内容に基づいて、任意の修正処理を実行する。例えば、映像生成システム1は、必要に応じて映像のUSDファイルを更新してもよいし、USDファイルはそのままでカットの順番のみを変更してもよい。上述した処理により、映像生成システム1は、ユーザビリティを向上させることができる。

After selecting cuts CU1 to CU3, the user inputs a prompt (text information, etc.) indicating a correction instruction as user input information, thereby instructing the

<1-4-7.時間情報の利用例>

従来技術では、特定のカットの修正後、その修正の影響を受ける他のシーンが修正(変更)されないという課題がある。このように、従来技術には、ユーザビリティに関する課題があり、ユーザビリティの改善の余地がある。そこで、映像生成システム1は、図24に示すように、時間情報を用いて編集処理を行ってもよい。図24は、編集処理の一例を示す図である。具体例には、図24は、時間情報に応じて決定した修正内容に基づく編集処理の一例を示す図である。例えば、映像生成システム1は、各カットにAIが生成した日付時間情報(「時間情報」または「日付情報」ともいう)を入れておき、その情報を基に映像のカット割りや修正内容を決定する。

<1-4-7. Examples of using time information>

In the conventional technology, there is a problem that after a specific cut is corrected, other scenes affected by the correction are not corrected (changed). Thus, the conventional technology has a problem with usability, and there is room for improvement in usability. Therefore, the

図24では、映像生成システム1は、各カットにそのカットに対応する日付時間情報(時間情報)を対応付けて管理する。例えば、カットCU11には2023年12月21日10時31分を示す時間情報TI11が対応付けられる。また、カットCU12には2023年12月21日10時41分を示す時間情報TI12が対応付けられる。このように、カットCU11及びカットCU12は、時間的に近い(近接した)カットである。この場合、映像生成システム1は、カットCU11が修正された場合、その修正をカットCU12にも反映する。動画データの各カットには時間情報(日付情報)が対応付けられている。

In FIG. 24, the

例えば、映像生成システム1は、カットCU11での人物Xの服装が修正された場合、カットCU11での人物Xの服装と同じようにカットCU12での人物Xの服装も修正する。例えば、映像生成システム1は、各カット間の時間情報を比較し、修正されたカット(「修正対象カット」ともいう)との時間差が所定の範囲内であるカット(「影響カット」ともいう)がある場合、修正対象カットでの修正内容に基づく修正を、その影響カットにも反映すると決定する。

For example, when the clothing of person X in cut CU11 is modified, the

そして、映像生成システム1は、修正対象カットでの修正内容に基づく修正を影響カットに対して実行する。なお、このカット間の影響に基づく影響カットの修正(変更)については、映像生成システム1は、人アセットのみに限らず、環境アセット(天候、ライティング、時間経過で変化するろうそく等のプロップ等)にも行ってもよい。

Then, the

例えば、カットCU21には2023年12月21日10時31分を示す時間情報TI21が対応付けられる。また、カットCU22には2023年12月21日18時41分を示す時間情報TI22が対応付けられる。このように、カットCU21及びカットCU22は、時間的に遠い(離間した)カットである。この場合、映像生成システム1は、カットCU21が修正された場合、その修正をカットCU22には反映しない。

For example, cut CU21 is associated with time information TI21 indicating 10:31 on December 21, 2023. Also, cut CU22 is associated with time information TI22 indicating 18:41 on December 21, 2023. In this way, cut CU21 and cut CU22 are cuts that are distant in time (separate). In this case, when cut CU21 is modified, the

例えば、映像生成システム1は、カットCU21での人物Xの服装が修正された場合、カットCU21での人物Xの服装の修正に応じて、カットCU22での人物Xの服装は修正しない。例えば、映像生成システム1は、各カット間の時間情報を比較し、修正されたカット(修正対象カット)との時間差が所定の範囲内であるカット(影響カット)がない場合、修正対象カットでの修正内容に基づく修正を他のカットには反映しないと決定する。

For example, when the clothing of person X in cut CU21 is modified, the

例えば、映像生成システム1は、シナリオ生成時に、各カットに日付時間情報もAI(LLMなど)で生成しておき、各カットのメタ情報として保存しておく。この日付時間情報は前後のカットとの関係性を考えるためや、季節などを把握するために利用される。生成された架空の日付時間情報は、各カットの内容や各カット間の関係性を保つために入れておく。例えば、映像生成システム1は、雪が降っている朝のショットだとすると、1月24日午前6時30分などとする。また、例えば、映像生成システム1は、前後のカットの関係性が強いショットだとすると、1月24日午前6時30分と1月24日午前7時など同日の近い時間帯とする。

For example, when generating a scenario, the

例えば、映像生成システム1は、季節や時間に応じてユーザの着ている服、太陽のライティング設定、空気のモヤなどを変化させる。また、対象カットと前のカットの日付時間情報が近い場合、対象カットを変更すると前後のカットも影響を受ける。例えば、同じ人物が別カットに出演し、対象カットと時間が近い場合、対象カットの服を変更すると別カットの服も変更される。上述した処理により、映像生成システム1は、ユーザビリティを向上させることができる。

For example, the

<1-4-8.言語化の度合いに応じた応答例>

従来技術では、修正内容をユーザが具体的に言語化できない場合、ユーザの意図に沿った修正が難しいという課題がある。このように、従来技術には、ユーザビリティに関する課題があり、ユーザビリティの改善の余地がある。そこで、映像生成システム1は、以下に示すような処理により、修正内容をユーザが具体的に言語化できない場合であっても、ユーザの意図に沿った修正を可能にしてもよい。

<1-4-8. Response examples according to the degree of verbalization>

In the conventional technology, when the user cannot specifically verbalize the content of the correction, it is difficult to make corrections according to the user's intention. Thus, the conventional technology has problems with usability, and there is room for improvement in usability. Therefore, the

例えば、映像生成システム1は、入力された文章に応じて、返答方式を変化させてもよい。映像生成システム1は、図25に示すように、ユーザの指示の抽象度、言語化の度合いに応じて応答を異ならせてもよい。図25は、編集処理の一例を示す図である。具体例には、図25は、言語化の度合いに応じた編集処理の一例を示す図である。

For example, the

図25中の応答例AP1は、「見るユーザが日常を感じる映像にしてください」といった目的ベースの修正指示をユーザが行った場合を示す。この場合、映像生成システム1は、具体的な指示の文章を添えて映像を生成する。例えば、映像生成システム1は、「見るユーザが日常を感じる映像にしてください」といった目的ベースの修正指示に対して、「手を自然な角度で下に下げ、体の向きに合わせて動かします。」という文章を添えて、その文章を基に修正した映像をディスプレイ等に表示することにより、ユーザに対して提示する。

Response example AP1 in FIG. 25 shows a case where a user issues a purpose-based correction instruction such as "Please make the video so that the viewer feels like they are in an everyday situation." In this case,

また、図25中の応答例AP2は、「両腕を自然な状態にして下さい」といった抽象的な文章の修正指示をユーザが行った場合を示す。この場合、映像生成システム1は、具体的な文章を複数提示し、ユーザに選択させる。例えば、映像生成システム1は、「手を下に下ろして、空上の向きに合わせて動かします」、「手で頭をかいて、その後手を下ろします」、「ポケットに手を入れます」等の複数の文章をディスプレイ等に表示することにより、ユーザに対して提示する。そして、映像生成システム1は、複数の文章のうちユーザが選択した文章を基に修正した映像をディスプレイ等に表示することにより、ユーザに対して提示する。

Response example AP2 in FIG. 25 shows a case where the user instructs to correct an abstract sentence such as "Keep both arms in a natural position." In this case, the

図25中の応答例AP3は、「2秒で右前の車の方を見るようにして下さい」といった具体的な文書の修正指示をユーザが行った場合を示す。この場合、映像生成システム1は、ユーザが入力した文章通りに変更(修正)した映像をディスプレイ等に表示することにより、ユーザに対して提示する。例えば、目的ベースの文章、抽象的な文章、具体的な文章の違いは、AI(LLMなど)により判断され、映像生成システム1は、それに応じて生成するプロンプトを変えてAI(LLMなど)に処理を投げてもよい。

Response example AP3 in FIG. 25 shows a case where the user gives a specific instruction to correct a sentence, such as "Please look at the car in front of you on the right in 2 seconds." In this case, the

例えば、映像生成システム1は、センサ用いてモーションやカメラの動きをユーザに指定させてもよい。映像生成システム1は、図26に示すように、Webカメラ等の任意のセンサから得たモーション情報を映像に重畳表示(重ねて表示)し、ユーザの修正を受け付けてもよい。図26は、編集処理の一例を示す図である。具体例には、図26は、映像への重畳表示による編集処理の一例を示す図である。

For example, the

例えば、映像生成システム1は、モバイルモーションキャプチャ、Webカメラ等の任意のセンサから得たモーション情報MTを映像MV11に重畳させて表示し、ユーザの修正指示を受け付ける。このように、映像生成システム1は、顔表情等を含むモーション情報を現在の映像の上に重ねて表示することにより、現在の映像とモーション情報との差異を可視化した状態を基に、ユーザの修正指示を受け付ける。例えば、4秒のカットであれば、常に4秒のカットが再生され続け、ユーザは気に入るまで何度も自分でモーション情報を変更することができる。例えば、ユーザが気に入ったモーション情報がある場合、映像生成システム1は、自然なモーション情報を最終生成して映像のモーションを変更してもよい。

For example, the

ユーザのモーションはモバイルモーションキャプチャ、Webカメラなどでトラッキングされる。また、ユーザはどの人物のモーションを修正するかは、事前にUIからマウスで選択してもよい。映像中の頭と体の大きさや向きより、重ねる自分のモーション表示部分の大きさと位置向きを決定する。細かい大きさと位置向きの調整は、ユーザがマウスとキーボードで入力して調整してもよい。モーションの録画は、上記画像に記載したカットが繰り返し際される方法もありうるし、スタートボタンを押してから体勢を整えるまでの数秒後に録画が開始する方法もありうる。また、撮影後、ユーザがモーション生成ボタンを押すことで、入力したモーションが指定した登場人物に適応されてもよい。 The user's motion is tracked using a mobile motion capture device, a web camera, etc. The user may also select in advance from the UI with the mouse which character's motion they wish to modify. The size and position of the portion of the user's motion to be superimposed is determined based on the size and orientation of the head and body in the video. The user may adjust the size, position, and orientation in detail using the mouse and keyboard. Motion may be recorded by repeating the cuts shown in the image above, or by starting recording several seconds after the start button is pressed and the user adjusts their position. After filming, the user may press the motion generation button, and the input motion may be applied to the specified character.

また、撮影したモーション自体は不自然であることもありうるので、映像生成システム1は、撮影したモーションをmotion to motionのAIを用い、モーション推定や生成などを行い、より自然なモーションに変換してから登場人物のモーションに適応してもよい。また、映像生成システム1は、入力したモーションと自然文を用い、モーションを推定したり生成したりしてもよい。例えば、映像生成システム1は、モーションを入力後、ユーザが入力した「こんな感じで活き活きとした動きにする」などの自然文と共にAI(LLM、text&motion to motion生成のモデルなど)に処理を投げてもよい。

In addition, since the captured motion itself may be unnatural, the

また、ユーザは、自身の手をカメラと見立てて動かして、カメラワークを変更してもよい。例えば、映像生成システム1は、ユーザの手の動きをWebカメラ等のセンサで取得する。映像生成システム1は、図27に示すように、変更したカメラワークを枠として映像に重ねて提示(重畳表示)する。図27は、編集処理の一例を示す図である。具体例には、図27は、映像へのカメラワークの重畳表示の一例を示す図である。

The user may also change the camerawork by moving their hand as if it were a camera. For example, the

例えば、映像生成システム1は、変更前のカメラワークを示す枠CW1と変更後のカメラワークを示す枠CW2とを映像MV12に重畳させて表示する。そして、映像生成システム1は、ユーザが変更後のカメラワークを用いることを指示した場合、その変更後のカメラワークを基にレンダリング処理を実行する。このように、ユーザが変更後のカメラワークをOKとして、その変更後のカメラワークに映像がレンダリングされる。

For example, the

また、ユーザは、自身の携帯端末(スマートフォン等)のIMUやImageSLAM等を用いてカメラワークを指定してもよい。例えば、映像生成システム1は、AR(Augmented Reality)でメインキャラクターを実空間(現実の机の上等)に配置して提示してもよい。映像生成システム1は、変更したカメラワークを図27に示す場合と同様に映像に枠を重ねて表示する。

The user may also specify the camerawork using an IMU or ImageSLAM of the user's mobile device (such as a smartphone). For example, the

上記のように、映像生成システム1では、ユーザが手やスマホの動きを使い、モーションやカメラの動きを決めてもよい。例えば、ユーザが手の動きでカメラワークを決める際、もう一方の手で指定した人物を想定し、左手(カメラ)と右手(人物)の距離から、カメラの相対的な位置を決めてもよい。また、映像生成システム1は、ユーザが手やカメラの入力で変更したカメラワークを枠として映像に重ねて表示するが、その後、ユーザがマウス操作で枠やその動きを微調整してもよい。また、入力したカメラワークは手で入れているため不自然な動きである可能性もあるため、映像生成システム1は、motion to motion生成モデル、text&motion to motion生成モデル等を用いて、自然なカメラワークに修正してもよい。上述した処理により、映像生成システム1は、ユーザビリティを向上させることができる。

As described above, in the

<1-4-9.定性的な値の利用例>

従来技術では、現状や変更履歴をシステムとしてどのように判断するのかという点については考慮されていない場合があった。例えば、「もう少し後ろに立って」や「もう少し明るくして」など、現状と比較して調整したいという場合等があり、システム的にどのように現状を理解(把握)するかについては課題がある。このように、従来技術には、ユーザビリティに関する課題があり、ユーザビリティの改善の余地がある。そこで、映像生成システム1は、以下に示すような処理により、現状や変更履歴を適切に判断可能にしてもよい。

<1-4-9. Examples of using qualitative values>

In the conventional technology, there are cases where consideration is not given to how the system determines the current state and the change history. For example, there are cases where a user wants to make adjustments by comparing with the current state, such as "stand a little further back" or "make it a little brighter," and there is a problem with how the system understands (grasps) the current state. Thus, the conventional technology has a problem with usability, and there is room for improvement in usability. Therefore, the

例えば、映像生成システム1は、動き速度、明るさなど各ポイントを、定量的な数値として保持しておき、その値を比較して映像を修正してもよい。映像生成システム1は、図28に示すように、定性的な値を用いて編集処理を行ってもよい。図28は、編集処理の一例を示す図である。具体例には、図28は、定性的な値に応じて決定した修正内容に基づく編集処理の一例を示す図である。

For example, the

図28では、値情報VL21は映像MV21に対応づけられた定量的な値を示す。例えば、値情報VL21は、町全体の明るさ、人の歩行スピード、人の顔を動かすスピード、人の位置、車のスピード、車の位置等の定性的な値を含み、映像MV21のカット等に対応づけられる値を示す。このように、映像生成システム1は、変更されうる値は全て定量的な値として保持しておき、その値と比較して映像を変更する。

In FIG. 28, value information VL21 indicates a quantitative value associated with video MV21. For example, value information VL21 includes qualitative values such as the brightness of the entire town, people's walking speed, the speed at which people's faces move, people's positions, car speeds, and car positions, and indicates values associated with cuts in video MV21. In this way,

図28では、映像MV21について、ユーザが「顔をもう少しゆっくり動かして」という修正指示を行い、映像生成システム1は、映像MV21の顔を動かすスピードを遅くした映像MV22を生成する。映像生成システム1は、「顔をもう少しゆっくり動かして」という修正指示を基に、映像MV21の値情報VL21のうち人の顔を動かすスピードの値を「21」から「10」に減少させた値情報VL22の映像MV22を生成する。

In FIG. 28, the user gives a modification instruction for video MV21, "move your face a little slower," and

図28では、値情報VL22は修正後の映像MV22に対応づけられた定量的な値を示す。例えば、値情報VL22は、町全体の明るさ、人の歩行スピード、人の顔を動かすスピード、人の位置、車のスピード、車の位置等の定性的な値を含み、映像MV22のカット等に対応づけられる値を示す。 In FIG. 28, value information VL22 indicates quantitative values associated with the corrected video MV22. For example, value information VL22 indicates values associated with cuts in video MV22, including qualitative values such as the brightness of the entire town, people's walking speed, the speed at which people's faces move, people's positions, car speeds, and car positions, etc.

このように、映像生成システム1は、定性的な値を用いて映像の編集処理を行ってもよい。例えば、映像生成システム1は、動き速度、明るさなど各ポイント(項目)について、定量的な数値として保持しておき、その値を比較して映像を修正する。上述したように、定性的な値を保持しておく街全体の明るさ、人の歩行スピードなどの分類は、事前に設定された項目である。例えば、映像生成システム1は、各々を自然言語からAI(LLMなど)を使って設定修正してもよいし、設定値を直接修正してもよい。上述した処理により、映像生成システム1は、ユーザビリティを向上させることができる。

In this way, the

また、それぞれの値の取得方法の一例を以下に示すが、取得方法は以下に限らず他の取得方法であってもよい。例えば、映像生成システム1は、ライティングについては、3DCG内のライトの設定値(位置、回転、強さ、色など)を取得する。また、映像生成システム1は、カラーグレーディングについては、コンポジット編集で設定された、ホワイトバランス、色温度、色かぶり補正、彩度、露光量、コントラスト、ハイライト、シャドウ、白レベル、黒レベル、カラー、LUT設定などを取得する。また、映像生成システム1は、歩行スピードについては、対象の3Dモデルの腰のボーンの位置移動速度を取得する。また、映像生成システム1は、顔を動かすスピードについては、頭のボーンの回転速度を取得する。また、映像生成システム1は、位置については、3Dモデルの位置を取得する。

An example of a method for acquiring each value is shown below, but the acquisition method is not limited to the following and may be another method. For example, for lighting, the

<1-4-10.入力途中でのレンダリング処理例>

従来技術では、レンダリング時間を待つのがユーザにとって大変(ユーザビリティが低い)という課題がある。このように、従来技術には、ユーザビリティに関する課題があり、ユーザビリティの改善の余地がある。そこで、映像生成システム1は、以下に示すような処理により、レンダリングに関するユーザビリティを向上させてもよい。

<1-4-10. Example of rendering process during input>

The conventional technology has an issue in that it is difficult for the user to wait for the rendering time (low usability). Thus, the conventional technology has an issue with usability, and there is room for improvement in usability. Therefore, the

例えば、映像生成システム1は、テキスト入力途中からレンダリング処理を開始してもよい。映像生成システム1は、図29に示すように、ユーザの入力途中でレンダリング処理を行ってもよい。図29は、編集処理の一例を示す図である。具体例には、図29は、入力途中でのレンダリング処理に基づく編集処理の一例を示す図である。

For example, the

図29では、映像生成システム1は、ユーザが「手で頭を掻いて」というテキストTX31の入力に応じて、レンダリング処理等を実行し映像MV31を表示する。例えば、テキストTX31中の末尾の「|」はユーザが修正指示を入力途中であることを示す。映像生成システム1は、文章として理解できるようになったら一旦バックグラウンドで処理を開始する。例えば、映像生成システム1は、「手で頭を掻いて」までを入力した時点で、バックグラウンドでレンダリング処理等を開始する。このように、映像生成システム1は、ユーザがテキストを入力している途中でレンダリング処理を開始してもよい。

In FIG. 29, the

図29では、ユーザは、テキストTX31から「手をおろして」というテキストTX32に文章を変更する。例えば、テキストTX32中の末尾の「|」はユーザが修正指示を入力途中であることを示す。映像生成システム1は、テキストTX31からテキストTX32の変更に応じて、処理を実行する。例えば、映像生成システム1は、文章が変更されたら、その時点で行っている処理を止めて再度処理をやり直す。例えば、映像生成システム1は、テキストTX31を基に行っていた処理を終了し、テキストTX32を基に、レンダリング処理等を実行し映像MV32を表示する。

In FIG. 29, the user changes the sentence from text TX31 to text TX32, which reads "Put your hands down." For example, the "|" at the end of text TX32 indicates that the user is in the middle of inputting a correction instruction. The

図29では、ユーザは、テキストTX32から「手をおろして、自然な感じで」というテキストTX33に変更して、文章として完成させ、開始ボタン等を押すこと等により処理の実行を指示する。映像生成システム1は、始まっているバックグラウンド処理を終わらせて、テキストTX33を基にレンダリング処理等が実行された映像MV33を表示する。上述した処理により、映像生成システム1は、ユーザビリティを向上させることができる。

In FIG. 29, the user changes text TX32 to text TX33, "Keep your hands down, in a natural way," completes the sentence, and instructs execution of processing by pressing a start button or the like. The

<1-4-11.編集時の確認作業例>

従来技術では、編集時の確認作業についてはユーザビリティが低いなどの課題があり改善の余地があった。そこで、映像生成システム1は、図30に示すように、編集時の確認作業を行ってもよい。図30は、編集処理の一例を示す図である。具体例には、図30は、編集時の確認作業の一例を示す図である。

<1-4-11. Example of confirmation work when editing>

In the conventional technology, there is a problem that the usability is low in the confirmation work at the time of editing, and there is a room for improvement. Therefore, the

図30中の確認作業CP1は、モーションやカメラワークなどの時間軸方向の変化を見る必要がある場合の確認作業の一例を示す。例えば、確認作業CP1では、ユーザは理想に近い動画を選ぶことを繰り返す。また、図30中の確認作業CP2は、時間軸方向の変化を見る必要がある場合以外の確認作業の一例を示す。例えば、確認作業CP2では、ユーザは理想に近い画像を選ぶことを繰り返す。 Checking task CP1 in FIG. 30 shows an example of a checking task when it is necessary to check changes in the time axis direction, such as motion or camera work. For example, in checking task CP1, the user repeatedly selects a video that is close to ideal. Checking task CP2 in FIG. 30 shows an example of a checking task other than when it is necessary to check changes in the time axis direction. For example, in checking task CP2, the user repeatedly selects an image that is close to ideal.

例えば、映像生成システム1は、全てのカットの画像をレンダリングした後、編集したいものから動画のレンダリングを実施してもよい。例えば、映像生成システム1は、生成した動画をユーザに提示し、入力情報の編集を行うかどうかをユーザに判断させてもよい。例えば、確認作業CP1、CP2等に示すように、ユーザの入力情報に対してバリエーションをもたせた数パターンの動画の生成結果をユーザに提示する場合、複数の動画をレンダリングするための待ち時間が生じるという課題がある。このように、従来技術には、ユーザビリティに関する課題があり、ユーザビリティの改善の余地がある。

For example, the

そこで、映像生成システム1は、その待ち時間を低減するために、時間軸方向の変化を見る必要がある確認作業以外の作業(確認作業CP2に対応)については、動画中の1フレームないしは数フレームのみをレンダリングし、画像としてユーザに候補を提示する。これにより、映像生成システム1は、レンダリング待ち時間を低減することができる。

Therefore, in order to reduce this waiting time, for tasks other than the confirmation task that requires viewing changes along the time axis (corresponding to confirmation task CP2), the

また、映像生成システム1は、ユーザがモーションやカメラワークの編集作業を行う場合は動画による候補提示を行う。例えば、レンダリングに用いる動画中の数フレームを選択する方法として、単純に動画の先頭と最後の2フレームのみをレンダリングする方法、USDファイル内のアニメーションの変化量が大きいフレームを数フレームレンダリングする方法、AIに全てのフレームの中でハイライトとして表示すべきフレームを選択させる方法などが挙げられる。例えば、映像生成システム1では、複数枚画像をレンダリングした場合はユーザがマウスカーソルをホバーすることでパラパラ漫画のような形で生成結果を確認することができる。

Furthermore, when the user edits the motion or camerawork, the

また、映像生成システム1は、動画生成については、候補選択用の画像生成を終えた段階で、順次、各パターンの動画生成を開始することで動画プレビュー時の待ち時間を軽減することができる。パターンごとの動画生成の順番については、ランダムな順番で生成する方法の他に、ユーザがUI上のボタンを押すことでレンダリング順番を選ぶ方法、マウスカーソルが画像上にホバーされた時間が長い順番にレンダリングする方法などが挙げられる。上述した処理により、映像生成システム1は、ユーザビリティを向上させることができる。

In addition, when generating videos, the

ここで、上述した確認作業に関する処理フローの一例について図31を用いて説明する。図31は、映像生成システムが実行する処理手順を示すフローチャートである。具体例には、図31は、編集処理に関する処理手順を示すフローチャートである。 Here, an example of a processing flow related to the above-mentioned confirmation work will be described with reference to FIG. 31. FIG. 31 is a flowchart showing the processing procedure executed by the video production system. As a specific example, FIG. 31 is a flowchart showing the processing procedure related to editing processing.

図31では、映像生成システム1は、ユーザの設定からUSDファイルを数パターン生成する(ステップS201)。映像生成システム1は、すべてのパターンのUSDファイルの画像書き出しが終了している場合(ステップS202:Yes)、ファイルの画像書き出しについての処理(例えばステップS202~S204)を終了する。

In FIG. 31, the

映像生成システム1は、すべてのパターンのUSDファイルの画像書き出しが終了していない場合(ステップS202:No)、書き出しが完了していないUSDファイルの画像を書き出す(ステップS203)。映像生成システム1は、書き出した画像をUI上に表示する(ステップS204)。その後、映像生成システム1は、ステップS205以降の処理を開始するとともに、ファイルの画像書き出しが終了するまでステップS202~S204の処理を繰り返す。

If image writing of all patterns of USD files has not been completed (step S202: No), the

映像生成システム1は、すべてのパターンのUSDファイルの動画書き出しが終了している場合(ステップS205:Yes)、ファイルの動画書き出しについての処理(例えばステップS205~S207)を終了する。

When video export of all patterns of USD files has been completed (step S205: Yes), the

映像生成システム1は、すべてのパターンのUSDファイルの動画書き出しが終了していない場合(ステップS205:No)、書き出しが完了していないUSDファイルの動画を書き出す(ステップS206)。映像生成システム1は、書き出した動画をUI上に表示する(ステップS207)。その後、映像生成システム1は、ファイルの動画書き出しが終了するまでステップS205~S207の処理を繰り返す。

If video export of all patterns of USD files has not been completed (step S205: No), the

<1-4-12.範囲選択に応じた処理例>

従来技術では、映像(動画)生成について経験(知見)が無い人(「素人」ともいう)が動画を作ろうとした場合、何が良くて何が悪いのかを判断することが難しく、判断を誤る場合も多いという課題がある。このように、従来技術には、ユーザビリティに関する課題があり、ユーザビリティの改善の余地がある。そこで、映像生成システム1は、図32に示すように、生成された動画について評価を行ってもよい。図32は、範囲選択に応じた評価処理の一例を示す図である。

<1-4-12. Examples of processing according to range selection>

In the conventional technology, when a person (also called an "amateur") who has no experience (knowledge) in video (moving image) generation tries to create a video, it is difficult for the person to judge what is good and what is bad, and the person often makes an erroneous judgment. Thus, the conventional technology has a problem regarding usability, and there is room for improvement in usability. Therefore, the

図32では、映像生成システム1は、範囲選択に応じた評価処理を行う。図32中の映像MV40は、ユーザ入力に応じて生成された動画を示す。図32中の映像MV41は、ユーザが評価してほしい範囲として人の部分を指定し、その範囲に対する映像生成システム1による評価を示すテキストTX41が重畳表示された状態を示す。図32では、映像生成システム1は、ユーザが指定した人の部分に対して、「この人の顔の表情を見せたほうがユーザーに感情が伝わりやすい」というテキストTX41が示す評価(修正案の提示)を行う。

In FIG. 32, the

図32中の映像MV42は、映像生成システム1による評価を示すテキストTX42がさらに重畳表示された状態を示す。図32では、映像生成システム1は、ユーザが指定した人の部分に対して、「演出の観点だと顔を真正面から捉えた方が良い」というテキストTX42が示す評価を行う。

Video MV42 in FIG. 32 shows a state in which text TX42 indicating an evaluation by

例えば、テキストTX42が示す評価をユーザが良いと思い、映像生成システム1は、その評価に基づく修正指示のユーザから受け付ける。そして、映像生成システム1は、テキストTX42が示す評価に対応する複数の候補動画MV43、MV44、MV45を生成し、表示する。これにより、映像生成システム1は、テキストTX42が示す評価に対応する複数の候補動画MV43、MV44、MV45をユーザに提示する。

For example, if the user thinks that the evaluation indicated by text TX42 is good,

例えば、ユーザはマウスで範囲を指定し、映像生成システム1は、指定された範囲に対する評価を行いユーザとの対話(議論)を開始する。映像生成システム1は、マウスでの範囲選択に応じて、その範囲を対象としてAIによる評価を開始する。例えば、映像生成システム1は、ユーザが修正を指示するまでの間、N秒に1回の評価(修正案の提示)を行う。ユーザが良いと思ったところで、マウスでクリックすることにより、映像生成システム1は、それまでの対話(議論)を踏まえた修正候補を複数提示する。上述した処理により、映像生成システム1は、ユーザビリティを向上させることができる。

For example, a user specifies a range with a mouse, and

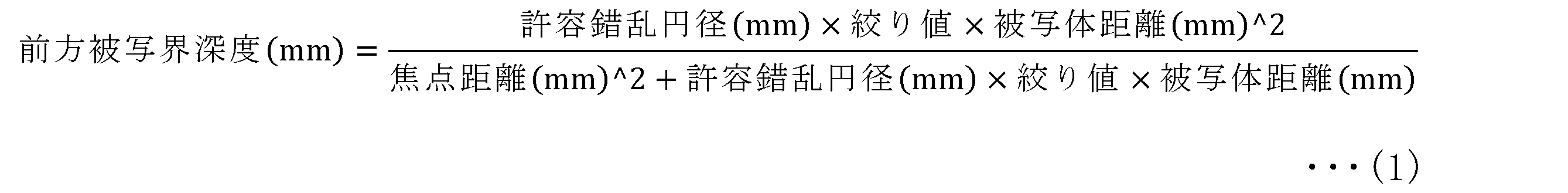

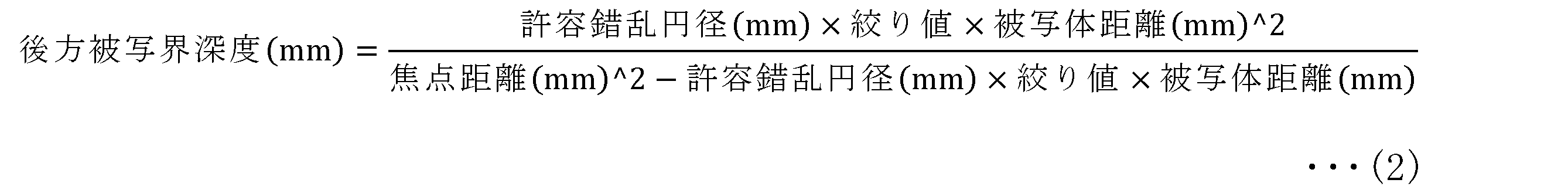

<1-4-13.被写界深度に応じた処理例>

従来技術では、環境アセットのポリゴン数が高かったり、テクスチャの解像度が高かったりしてアセットが重い場合、レンダリングに要する時間の増大を抑制することが難しいという課題がある。このように、従来技術には、ユーザビリティに関する課題があり、ユーザビリティの改善の余地がある。そこで、映像生成システム1は、図33に示すように、被写界深度に応じた処理を行ってもよい。図33は、被写界深度に応じた処理の一例を示す概念図である。

<1-4-13. Example of processing according to depth of field>

In the conventional technology, when the number of polygons in the environmental asset is high or the texture resolution is high, and the asset is heavy, it is difficult to suppress the increase in the time required for rendering. Thus, the conventional technology has a problem regarding usability, and there is room for improvement in usability. Therefore, the

図33では、映像生成システム1は、被写界深度に応じて、被写体の前後所定の範囲内については高ポリゴン数、高解像度テクスチャにし、被写体の前後所定の範囲内については低ポリゴン数、低解像度テクスチャにする。図33では、高ポリゴン数、高解像度テクスチャの対象物(被写体に近い丸)を濃いハッチングで示し、低ポリゴン数、低解像度テクスチャの対象物(被写体から遠い丸)を薄いハッチングで示す。このように、映像生成システム1は、被写界深度に応じて、ポリゴン数やテクスチャ解像度を変更する。映像生成システム1は、以下のような式(1)~(3)により、被写界深度を算出する。

In FIG. 33, the

式(1)は、前方被写界深度(mm)を算出する関数である。映像生成システム1は、式(1)を用いて、前方被写界深度を算出する。例えば、図33では、が前方被写界深度は、被写体の前方側(カメラに近づく側)に対応する。また、式(2)は、後方被写界深度(mm)を算出する関数である。映像生成システム1は、式(2)を用いて、後方被写界深度を算出する。例えば、図33では、が後方被写界深度は、被写体の後方側(カメラから離れる側)に対応する。式(3)は、被写界深度を算出する関数である。像生成システム1は、式(3)を用いて、前方被写界深度と後方被写界深度とを足し合わせることにより、被写界深度を算出する。

Equation (1) is a function for calculating the front depth of field (mm). The

例えば、映像生成システム1は、前方被写界深度よりカメラに近い部分、後方被写界深度よりカメラから遠い部分に関して、レンダリング前にポリゴン数やテクスチャ解像度を落としたものに差し替えておく。例えば、映像生成システム1は、被写界深度的にボケを作る場合、ポリゴン数やテクスチャ解像度を小さく(低く)する。このように、映像生成システム1は、焦点距離、F値、被写体距離等の基準に、ポリゴン数やテクスチャ解像度を決定する。例えば、映像生成システム1は、上記の決定をUSDファイル生成時に行ってもよい。上述した処理により、映像生成システム1は、ユーザビリティを向上させることができる。

For example, the

<1-4-14.確認作業時の再生処理例>

従来技術では、生成された動画を全て再生して確認する場合、確認作業に要する時間の増大を抑制することが難しいという課題がある。このように、従来技術には、ユーザビリティに関する課題があり、ユーザビリティの改善の余地がある。そこで、映像生成システム1は、確認作業時に適した再生を行ってもよい。映像生成システム1は、ユーザの操作に応じて再生の態様を変更してもよい。例えば、映像生成システム1は、ユーザの操作に応じて、パラパラ漫画のような態様で動画を再生してもよい。

<1-4-14. Example of playback process during confirmation work>

In the conventional technology, when all the generated videos are played back for review, it is difficult to suppress an increase in the time required for the reviewing work. Thus, the conventional technology has a problem regarding usability, and there is room for improvement in usability. Therefore, the

映像生成システム1は、ユーザによるクリックやマウスホイール回転ごとに所定の秒数(例えば0.5秒)だけ動画の再生を進めてもよい。例えば、映像生成システム1は、マウスやマウスホイールの動きや位置に応じて、カット内のコマ送りをする。映像生成システム1は、図34に示すように、マウスの位置に対応する秒数だけ動画の再生を進めてもよい。

The

図34では、映像生成システム1は、コンテンツCT41をユーザに提供し、ユーザによる動画を進める度合い(秒数、フレーム数等)の指示を受け付けてもよい。コンテンツCT41は、ユーザによるユーザの動画を進める度合いを受け付けるための表示画面(コンテンツ)である。コンテンツCT41は、動画に重畳させて、動画を進める秒数を指定するための情報を配置する。図34では、0~3.5秒の間で指定可能であり、左から右に行くほど動画を進める秒数が大きくなる場合を示す。例えば、クライアントUI表示部400は、コンテンツCT41を表示する。

In FIG. 34, the

ユーザは、コンテンツCT41を介して、動画を再生する際に動画を進める秒数を指定する情報を入力する。図34では、ユーザはマウスを操作して、マウスカーソルMSを1.0と表示された領域に位置させることに動画を進める秒数を1.0秒に指定する。この場合、映像生成システム1は、ユーザからの動画を進める秒数の指定に応じて、動画を1.0秒の間隔で再生を進める。なお、ユーザはマウスを操作して、マウスカーソルMSを1.0と表示された領域に位置させ、クリックすること等により、動画を進める秒数を1.0秒に指定してもよい。上述した処理により、映像生成システム1は、ユーザビリティを向上させることができる。

Through content CT41, the user inputs information specifying the number of seconds to advance the video when playing the video. In FIG. 34, the user operates the mouse to position the mouse cursor MS in the area marked 1.0 to specify 1.0 seconds as the number of seconds to advance the video. In this case, the

<1-4-15.強調表示例>

従来技術では、動画のうち編集等により変更された生成された部分が分かりづらい場合があり、確認作業に要する時間の増大を抑制することが難しいという課題がある。このように、従来技術には、ユーザビリティに関する課題があり、ユーザビリティの改善の余地がある。そこで、映像生成システム1は、図35に示すように、強調表示を行ってもよい。図35は、変更部分の強調表示の一例を示す図である。例えば、映像生成システム1は、前回の生成結果と変化された部分を強調表示する。図35では映像中の女性が変更された場合を一例として説明する。

<1-4-15. Highlighting example>

In the conventional technology, it may be difficult to understand the parts of the video that have been changed by editing or the like, and it is difficult to prevent the increase in time required for the confirmation work. However, there are problems with usability and there is room for improvement in usability. Therefore, the

図35中の映像MV51は、第1の強調表示態様を示す。映像MV51は、変更された箇所以外を暗くする(明度を下げる等)ことにより、変更された箇所を強調表示する態様を示す。映像生成システム1は、映像MV51を生成し、映像MV51を表示することにより、編集等により変更された部分を強調表示する。

Video MV51 in FIG. 35 shows a first highlighting mode. Video MV51 shows a mode in which the changed parts are highlighted by darkening parts other than the changed parts (reducing brightness, etc.).

また、図35中の映像MV52は、第2の強調表示態様を示す。映像MV52は、変更された箇所をハイライトする(色を付ける等)ことにより、変更された箇所を強調表示する態様を示す。映像生成システム1は、映像MV52を生成し、映像MV52を表示することにより、編集等により変更された部分を強調表示する。このように、映像MV51、MV52は、人の部分が変更された場合にその部分を強調表示する場合を示す。

Video MV52 in FIG. 35 shows a second highlighting mode. Video MV52 shows a mode in which the changed parts are highlighted (by adding color, etc.).

図35中の映像MV53は、第3の強調表示態様を示す。映像MV53は、変更があった時間をシークバー上に示すことにより、変更された箇所を強調表示する態様を示す。映像生成システム1は、変更があった時間に対応する位置に色付けした点HL531及び点HL532が配置されたシークバーを含む映像MV53を生成し、映像MV53を表示することにより、編集等により変更された部分を強調表示する。

Video MV53 in FIG. 35 shows a third highlighting mode. Video MV53 shows a mode in which the changed portion is highlighted by indicating the time when the change occurred on the seek bar.

図35中の映像MV54は、第4の強調表示態様を示す。映像MV54は、変更があった時間をシークバー上に示すことにより、変更された箇所を強調表示する態様を示す。映像生成システム1は、変更があった時間帯に対応する範囲に位置に色付けしたバーHL54が配置されたシークバーを含む映像MV54を生成し、映像MV54を表示することにより、編集等により変更された部分を強調表示する。

Video MV54 in FIG. 35 shows a fourth highlighting mode. Video MV54 shows a mode in which the changed portion is highlighted by indicating the time when the change occurred on the seek bar.

上述したように、ユーザが動画生成に関わる設定を行い動画の再生成を行った際には、生成された動画の確認作業が必要になる。複数の生成結果を提示するようなUIでは、それぞれの動画をひとつずつ確認する動作のユーザ負担が大きい。そこで、動画の確認作業の負担を軽減するために、映像生成システム1は、前回の動画生成の結果との差分をユーザに提示する。例えば、映像生成システム1は、動画中で変更のあった箇所のみを強調表示したり、動画中で変更のあった時間をシークバー上に表示したりしてユーザに提示する。これにより、ユーザは変更があった箇所のみを確認できるようになり、映像生成システム1は、確認作業の負担を軽減させることができる。上述した処理により、映像生成システム1は、ユーザビリティを向上させることができる。

As described above, when a user configures settings related to video generation and regenerates a video, the generated video needs to be checked. In a UI that presents multiple generation results, the user has to check each video one by one, which places a heavy burden on the user. Therefore, in order to reduce the burden of checking the videos, the

例えば、動画中で変化した箇所を取り出す方法として、生成したUSDファイルから差分を検出する方法、レンダリング済みの動画と過去にレンダリングした動画を1フレームごとに比較して差分を検出する方法等が挙げられる。例えば、生成したUSDファイルから差分を検出する方法では、USDファイルを都度生成して動画レンダリングを行っている特性を活かし、映像生成システム1は、ユーザが動画生成に関する設定を更新する前後で生成されたUSDファイルの内容を比較し、変化があったオブジェクトや変化があった時間を検出する。また、例えば、レンダリング済みの動画と過去にレンダリングした動画を1フレームごとに比較して差分を検出する方法では、映像生成システム1は、ユーザが動画生成に関する設定を更新する前後で生成された動画を1フレームごとに比較して、変化があったピクセルおよび変化があった時間を検出する。

For example, methods for extracting changed parts of a video include detecting differences from a generated USD file, and detecting differences by comparing a rendered video with a previously rendered video frame by frame. For example, in a method for detecting differences from a generated USD file, taking advantage of the characteristic of generating USD files each time and performing video rendering, the

<1-4-16.カット間の関係提示例>

従来技術では、カットごとに修正した場合、前後カットとの関係が分からなくなる場合があるという課題がある。このように、従来技術には、ユーザビリティに関する課題があり、ユーザビリティの改善の余地がある。そこで、映像生成システム1は、図36に示すように、カット間の関係の提示を行ってもよい。図36は、カット間の関係の提示の一例を示す図である。

<1-4-16. Example of showing the relationship between cuts>

In the conventional technology, there is a problem that when each cut is corrected, the relationship between the previous and next cuts may become unclear. Thus, the conventional technology has a problem with usability, and there is room for improvement in usability. Therefore, the

図36では、カットCU61が修正されたカット(「対象カット」ともいう)である場合を示す。対象カットであるカットCU61よりも前のカットCU60には、そのカットが対象カットよりも前のカットであることを示す前関係バーTR60が重畳表示される。例えば、前関係バーTR60は、右側を底辺として左側に延びる三角形である。前関係バーTR60は、対象カットとの時間が離れているほど左側に長く伸びる態様で表示される。 Figure 36 shows a case where cut CU61 is a modified cut (also called the "target cut"). A previous relationship bar TR60 is superimposed on cut CU60 that precedes cut CU61, the target cut, to indicate that the cut precedes the target cut. For example, the previous relationship bar TR60 is a triangle with its base on the right and extending to the left. The previous relationship bar TR60 is displayed in such a way that it extends further to the left the further away it is from the target cut.