JP7464512B2 - 3D human posture estimation device, method and program - Google Patents

3D human posture estimation device, method and program Download PDFInfo

- Publication number

- JP7464512B2 JP7464512B2 JP2020205383A JP2020205383A JP7464512B2 JP 7464512 B2 JP7464512 B2 JP 7464512B2 JP 2020205383 A JP2020205383 A JP 2020205383A JP 2020205383 A JP2020205383 A JP 2020205383A JP 7464512 B2 JP7464512 B2 JP 7464512B2

- Authority

- JP

- Japan

- Prior art keywords

- amount

- estimating

- image

- rotation

- dimensional

- Prior art date

- Legal status (The legal status is an assumption and is not a legal conclusion. Google has not performed a legal analysis and makes no representation as to the accuracy of the status listed.)

- Active

Links

Images

Landscapes

- Image Analysis (AREA)

Description

本発明は、三次元人物姿勢推定装置、方法およびプログラムに係り、特に、関節点同士を繋ぐ四肢のひねり回転量を考慮して三次元人物の姿勢を推定する三次元人物姿勢推定装置、方法およびプログラムに関する。 The present invention relates to a three-dimensional human posture estimation device, method, and program, and in particular to a three-dimensional human posture estimation device, method, and program that estimates the posture of a three-dimensional human by taking into account the amount of twisting rotation of the limbs connecting joint points.

三次元人物姿勢推定技術とは、人物の三次元空間における姿勢を推定する技術を言う。一般に、三次元空間における身体の姿勢は主要な関節それぞれについて、基準点に対する相対的な三次元座標、あるいは基準姿勢に対する相対的な三次元回転によって表現される。 3D human pose estimation technology is a technology that estimates a person's pose in three-dimensional space. In general, the body posture in three-dimensional space is expressed for each major joint by three-dimensional coordinates relative to a reference point, or three-dimensional rotation relative to a reference posture.

三次元座標ベースの姿勢表現では、例えば肘と手首の三次元座標だけでは腕のひねりが表現できないなど、詳細な姿勢を表現するには不向きな場合が多い。これに対して、三次元回転ベースの姿勢表現では、基準となる身体モデルが必要とはなるものの四肢のひねりを含めた詳細な姿勢の表現が可能になる。人物画像から姿勢パラメータを推定する先行技術は多数存在する。 3D coordinate-based posture representation is often not suitable for expressing detailed postures; for example, arm twists cannot be expressed using only the 3D coordinates of the elbow and wrist. In contrast, 3D rotation-based posture representation makes it possible to express detailed postures, including limb twists, although it requires a reference body model. There are many prior art technologies for estimating posture parameters from human images.

非特許文献1には、人物のRGB画像から各関節点の二次元座標を推定し、姿勢パラメータの初期値を適用した身体モデルの各関節点の三次元座標を画像上に投影することで各関節の初期の二次元座標を求め、各関節点についてこれら二つの二次元座標の差分が最小化されるようにカメラパラメータ及び姿勢パラメータの最適化を行うことで目的の姿勢パラメータを獲得する技術が開示されている。 Non-Patent Document 1 discloses a technology that estimates the two-dimensional coordinates of each joint point from an RGB image of a person, obtains the initial two-dimensional coordinates of each joint point of a body model by projecting the three-dimensional coordinates of each joint point with the initial values of the posture parameters applied onto the image, and obtains the desired posture parameters by optimizing the camera parameters and posture parameters so that the difference between these two two-dimensional coordinates for each joint point is minimized.

非特許文献2には、非特許文献1が考慮する関節点に加えて、目や鼻といった顔のキーポイントや手指の細かい関節点の二次元座標についても考慮することで全身の詳細な姿勢を推定する技術が開示されている。非特許文献2では更に、姿勢パラメータの最適化において不可能な姿勢や時間方向の急激な変化を避けるための制約を導入することで推定精度の向上を図っている。 Non-Patent Document 2 discloses a technology for estimating detailed posture of the entire body by considering not only the joint points considered in Non-Patent Document 1, but also two-dimensional coordinates of facial key points such as the eyes and nose, and fine joint points of the fingers. Non-Patent Document 2 further aims to improve estimation accuracy by introducing constraints to avoid impossible postures and sudden changes in the time direction when optimizing posture parameters.

非特許文献3は、RGB画像中の人物周辺の矩形領域から直接、姿勢パラメータを求める回帰モデルを提案する。非特許文献3では、大量の人物画像と姿勢パラメータとの対から回帰モデルを学習するだけでなく、モーションセンサーなどから得た実際の人物の動きを表す大量の姿勢パラメータデータから、その分布を事前知識として獲得することで学習に活用している。 Non-Patent Document 3 proposes a regression model that finds posture parameters directly from a rectangular region around a person in an RGB image. In Non-Patent Document 3, not only does the regression model learn from a large number of pairs of person images and posture parameters, but it also acquires the distribution of a large amount of posture parameter data representing actual human movements obtained from a motion sensor or the like as prior knowledge and uses this knowledge for learning.

非特許文献4には、RGB画像から人物の関節点の二次元座標を推定すると同時に、奥行などの三次元情報を効率よく抽出し、関節点の三次元座標を推定する技術が開示されている。非特許文献4では、関節点の三次元座標に対して身体モデルが合わさるように姿勢パラメータが最適化される。最適化には不可能な姿勢や時間方向の急激な変化を避ける制約が導入されている。 Non-Patent Document 4 discloses a technology that estimates the two-dimensional coordinates of a person's joint points from an RGB image while efficiently extracting three-dimensional information such as depth to estimate the three-dimensional coordinates of the joint points. In Non-Patent Document 4, posture parameters are optimized so that a body model matches the three-dimensional coordinates of the joint points. Constraints are introduced in the optimization to avoid impossible postures and sudden changes in the time direction.

特許文献1には、人物のRGBD画像と身体モデルから人物の姿勢パラメータを予測し、そのときの身体モデルの関節点の三次元座標を二次元画像上に投影した座標と時間方向の変化とについて整合性を評価し、評価値を反映して最終的な姿勢パラメータの推定結果を得る技術が開示されている。 Patent document 1 discloses a technology that predicts posture parameters of a person from an RGBD image and a body model of the person, evaluates the consistency between the 3D coordinates of the joint points of the body model at that time projected onto a 2D image and the change in the time direction, and obtains the final posture parameter estimation results that reflect the evaluation value.

非特許文献1では、RGB画像から関節点の二次元情報のみを抽出し、これと身体モデルが持つ人体形状に関する事前知識とを合わせることで奥行情報を補間して三次元姿勢を推定するため、奥行情報に曖昧さが残る上に四肢のひねりなどを含む詳細な姿勢を正しく推定することは難しい。 In Non-Patent Document 1, only two-dimensional information of joint points is extracted from RGB images, and this is combined with prior knowledge of the human body shape held by the body model to interpolate depth information and estimate three-dimensional posture, so the depth information remains ambiguous and it is difficult to correctly estimate detailed postures, including twisting of the limbs.

非特許文献2では、より多くの関節点及び身体上のキーポイントの二次元情報と人体のとりうる姿勢に関する事前知識を使うことで奥行情報の曖昧さを軽減し、さらに四肢のひねりなどを含む詳細な姿勢をより正しく推定できるようにしている。しかしながら、参照情報が増えることで最適化処理にかかる計算量が増大してしまう。 In Non-Patent Document 2, the ambiguity of depth information is reduced by using two-dimensional information of more joint points and key points on the body, as well as prior knowledge of possible postures of the human body, enabling more accurate estimation of detailed postures, including twisting of the limbs. However, the increase in reference information increases the amount of calculation required for optimization processing.

非特許文献3では、人物のRGB画像から姿勢パラメータを直接推定するが、姿勢パラメータは三次元回転によって構成されていることから非連続で複雑な値をとる。そのため、回帰の学習が難しく精度が比較的低くなる傾向がある。また、回帰の学習において主に関節点の三次元座標の誤差を最小化することを目的としていることから、四肢のひねりなどを含む詳細な姿勢を正しく推定することは難しい。 In Non-Patent Document 3, posture parameters are estimated directly from RGB images of a person, but because posture parameters are constructed by three-dimensional rotation, they take discontinuous and complex values. This makes regression learning difficult and accuracy tends to be relatively low. In addition, because the regression learning mainly aims to minimize errors in the three-dimensional coordinates of joint points, it is difficult to correctly estimate detailed postures, including limb twists.

非特許文献4では、RGB画像から推定した人物の関節点の三次元座標に対して身体モデルを適合させることで姿勢パラメータを求める際に、身体モデルが不可能な姿勢をとることのないよう関節の回転角について制約を設けているが、四肢のひねりを推定することは難しい。 In Non-Patent Document 4, when pose parameters are calculated by fitting a body model to the 3D coordinates of a person's joint points estimated from an RGB image, restrictions are placed on the rotation angles of the joints to prevent the body model from assuming an impossible pose, but it is difficult to estimate the twisting of the limbs.

特許文献1では、RGBD画像から関節点の二次元および三次元座標とその時間変化に着目するものの四肢のひねりなど含む詳細な姿勢については考慮していない。 Patent document 1 focuses on the two-dimensional and three-dimensional coordinates of joint points and their changes over time from RGBD images, but does not take into account detailed postures, including twisting of limbs.

このように、先行技術の多くは主要な関節点の位置を正しくかつ不可能な姿勢とならない制約下で推定するに留まっており、四肢のひねりも含めた姿勢を正しく推定することは難しい。そのため、ジェスチャーやスポーツフォームのように四肢のひねりも重要な意味を持つシーンでの姿勢推定では十分な精度を得られない。また、非特許文献2には計算量が大きいという問題もある。 As such, most of the prior art techniques are limited to estimating the positions of major joint points correctly and under the constraint of not resulting in impossible postures, and it is difficult to correctly estimate postures including limb twists. As a result, sufficient accuracy cannot be achieved in posture estimation in scenes where limb twists are important, such as gestures and sports forms. In addition, Non-Patent Document 2 also has the problem of a large amount of calculation.

本発明の目的は、上記の技術課題を解決し、人物の四肢のひねりも含めた姿勢を少ない計算量で正しく推定できる三次元人物姿勢推定装置、方法およびプログラムを提供することにある。 The object of the present invention is to provide a 3D human posture estimation device, method, and program that can solve the above technical problems and accurately estimate a person's posture, including the twisting of the limbs, with a small amount of calculations.

上記の目的を達成するために、本発明は、被写体人物の三次元姿勢を推定する三次元人物姿勢推定装置において、以下の構成を具備した点に特徴がある。 To achieve the above object, the present invention provides a 3D human pose estimation device that estimates the 3D pose of a subject human, and is characterized by having the following configuration.

(1) 被写体人物の画像に基づいて関節点ごとに三次元座標を推定する手段と、被写体人物の画像に基づいて関節点ごとに四肢のひねり回転量を推定する手段と、前記三次元座標およびひねり回転量の各推定結果に基づいて被写体人物の姿勢パラメータを推定する手段とを具備した。 (1) The device includes a means for estimating three-dimensional coordinates for each joint point based on an image of the subject person, a means for estimating the amount of twisting rotation of the limbs for each joint point based on the image of the subject person, and a means for estimating posture parameters of the subject person based on the estimated three-dimensional coordinates and amount of twisting rotation.

(2) ひねり回転量を推定する手段は、任意の人物画像とその四肢のひねり回転量との関係を学習した回帰モデルに被写体人物の画像を適用して各四肢のひねり回転量を推定するようにした。 (2) The method for estimating the amount of twisting rotation is to apply the image of the subject person to a regression model that has learned the relationship between an arbitrary person image and the amount of twisting rotation of its limbs, and estimate the amount of twisting rotation of each limb.

(3)ひねり回転量を推定する手段は、任意の人物画像とその関節点ごとの四肢のひねり回転量との関係を学習した回帰モデルに、被写体人物の画像および各関節点の三次元座標の推定結果または当該推定結果に基づいて生成した各関節点のヒートマップを適用して各四肢のひねり回転量を推定するようにした。 (3) The means for estimating the amount of twist rotation is to estimate the amount of twist rotation of each limb by applying the estimated results of the image of the subject person and the three-dimensional coordinates of each joint point, or a heat map of each joint point generated based on the estimated results, to a regression model that has learned the relationship between an arbitrary human image and the amount of twist rotation of the limbs at each joint point.

(1) 姿勢推定の対象となる実際の人物の四肢にはひねりが生じ得るところ、本発明では四肢のひねり回転量を考慮して被写体人物の三次元姿勢を推定するので、特に四肢にひねりが生じている人物の姿勢を正確に推定できるようになる。 (1) The limbs of an actual person whose posture is to be estimated may be twisted. In this invention, the three-dimensional posture of the subject person is estimated by taking into account the amount of twisting rotation of the limbs, which makes it possible to accurately estimate the posture of a person whose limbs are twisted.

(2) 任意の人物画像とその四肢のひねり回転量との関係を学習して構築した回帰モデルを予め用意し、当該回帰モデルに被写体画像を適用することで四肢のひねり回転量を推定するので、少ない計算量で四肢のひねり回転量を考慮した姿勢推定が可能になる。 (2) A regression model is prepared in advance by learning the relationship between any human image and the amount of twisting rotation of the limbs. The amount of twisting rotation of the limbs is estimated by applying the subject image to the regression model, making it possible to estimate posture taking into account the amount of twisting rotation of the limbs with a small amount of calculation.

(3) 被写体画像に基づいて推定した各関節点の三次元座標または当該推定結果に基づいて生成した関節点のヒートマップを用いて各関節点のひねり回転量を推定するので、各関節点の探索範囲を制限できる。したがって、より少ない計算量でより精度の高い姿勢推定が可能になる。 (3) The amount of twist rotation for each joint point is estimated using the 3D coordinates of each joint point estimated based on the subject image or a heat map of the joint points generated based on the estimation results, so the search range for each joint point can be limited. This enables more accurate pose estimation with less computational effort.

以下、図面を参照して本発明の実施の形態について詳細に説明する。図1は、本発明の第1実施形態に係る三次元人物姿勢推定装置1の主要部の構成を示した機能ブロック図であり、ここでは本発明の説明に不要な構成は図示を省略している。本発明は三次元回転ベースでの姿勢推定を対象とする。 Embodiments of the present invention will now be described in detail with reference to the drawings. FIG. 1 is a functional block diagram showing the configuration of the main parts of a 3D human pose estimation device 1 according to a first embodiment of the present invention, and configuration that is not necessary for explaining the present invention is omitted from the illustration. The present invention is directed to pose estimation based on 3D rotation.

このような三次元人物姿勢推定装置1は、CPU,ROM,RAM,バス,インタフェース等を備えた少なくとも一台の汎用のコンピュータやサーバに各機能を実現するアプリケーション(プログラム)を実装することで構成できる。あるいはアプリケーションの一部をハードウェア化またはソフトウェア化した専用機や単能機としても構成できる。 Such a 3D human pose estimation device 1 can be configured by implementing applications (programs) that realize each function on at least one general-purpose computer or server equipped with a CPU, ROM, RAM, bus, interface, etc. Alternatively, it can be configured as a dedicated machine or a single-function machine in which part of the application is implemented as hardware or software.

画像入力部10は、被写体として姿勢推定対象の人物が映ったカメラ画像を取得する。カメラ画像はカメラから直接取得しても良いし、あるいは事前に撮影してHDDなどに保蔵されているカメラ画像ファイルを読み出すことで取得しても良い。本実施形態ではカメラ画像がRGB形式で取得される。

The

身体モデル記憶部40には、図2に一例を示したように人物の代表的な関節点が、図3に一例を示したように各関節点を連結する四肢(リブ)の定義や拘束条件と共に身体モデルとして記憶されている。

In the body

関節点三次元座標推定部20は、被写体のカメラ画像から被写体人物の各関節点の三次元座標を推定する。本実施形態では、各関節点の定義や拘束条件に従い、右手首や右肘などの区別をもって各関節点を検出し、更にその三次元座標を推定する。このような関節点の検出および座標推定には任意の手法を採用することが可能であり、例えば非特許文献4と同様の手法を採用できる。

The joint point three-dimensional coordinate

あるいは、CNNベースの学習済モデルによって画像上で特定の関節点が存在している可能性の高い箇所を検出し、更にその奥行に関する情報を抽出することで三次元座標を推定する手法を採用しても良い。推定した三次元座標の原点は、例えば腰の中心点とすることができる。三次元座標のスケールは、各関節点を連結する全てのリブの合計が一定の値となるように設定することができる。 Alternatively, a method may be used in which a CNN-based trained model is used to detect locations on an image where a specific joint point is likely to be present, and then information regarding the depth of the location may be extracted to estimate the 3D coordinates. The origin of the estimated 3D coordinates may be the center point of the waist, for example. The scale of the 3D coordinates may be set so that the sum of all the ribs connecting each joint point is a constant value.

ひねり回転量推定部30は、前記三次元座標の推定と前後または並行して、被写体人物の画像領域から各リブのひねり回転量を推定する。ひねり回転量は、前記身体モデル上で定義される値であり、同じく身体モデル上で定義される姿勢パラメータ(各関節点の三次元回転Rj:jは関節点識別子)から算出できる。

The twist rotation

本実施形態では、多数の人物画像とその四肢のひねり回転量との関係を学習して構築した回帰モデルを用意し、当該回帰モデルに取得した被写体人物の画像を適用することで関節点ごとに各四肢のひねり回転量を推定する。 In this embodiment, a regression model is prepared that is constructed by learning the relationship between a large number of person images and the amount of twisting rotation of the limbs, and the acquired image of the subject person is applied to the regression model to estimate the amount of twisting rotation of each limb for each joint point.

各関節点の三次元回転Rjは、図4に示すように、前記身体モデルの各関節点のツリー構造に従い、対象の関節点を中心にその子関節点と間にあるリブを回転させる値である。ひねり回転Tjは、関節点の三次元回転のうちリブを回転軸とする要素であり、それ以外の回転要素は振り回転Sjと呼ばれる。ひねり回転Tj、振り回転Sjおよびひねり回転角は以下のように導出される。 The three-dimensional rotation Rj of each joint point is a value for rotating the child joint point and the rib between the joint point and the target joint point as the center according to the tree structure of each joint point of the body model, as shown in Figure 4. The twist rotation Tj is an element of the three-dimensional rotation of the joint point that has the rib as the rotation axis, and the other rotation elements are called swing rotation Sj . The twist rotation Tj , swing rotation Sj , and twist rotation angle are derived as follows.

すなわち、各関節点Jjの三次元回転Rjは、これを分解して得られる振り回転Sjおよびひねり回転Tjに回転表現としてクオータニオン表現を用いれば次式(1)で表現できる。 That is, the three-dimensional rotation Rj of each joint point Jj can be expressed by the following equation (1) by using quaternion representation as a rotation representation for the swing rotation Sj and twist rotation Tj obtained by decomposing it.

ある姿勢(通常は姿勢パラメータが全て0)をとる身体モデルの各関節点Jjからその子関節点への方向ベクトルをvjとすると、これを三次元回転Rjで回転させた結果wjは、次式(2)のように振り回転Sjで回転させた結果と等しい。 If the direction vector from each joint point Jj of a body model taking a certain posture (usually all posture parameters are 0) to its child joint point is vj , the result wj of rotating this by a three-dimensional rotation Rj is equal to the result of rotating it by a swing rotation Sj as shown in the following equation (2).

このことから、次式(3)に示すように、方向ベクトルvjとwjとが成す平面の垂直方向ベクトルを軸とし、方向ベクトルvjとwjとが成す角を回転角とする回転を振り回転Sjとできる。ただし、Φは回転ベクトル表現からクオータニオン表現への変換式を表す。ひねり回転Tjは次式(4)から求まる。 From this, as shown in the following formula (3), the twist rotation Sj can be defined as a rotation with the axis being the perpendicular vector of the plane formed by the direction vectors vj and wj , and the angle formed by the direction vectors vj and wj being the rotation angle. Here, Φ represents the conversion formula from the rotation vector representation to the quaternion representation. The twist rotation Tj can be calculated from the following formula (4).

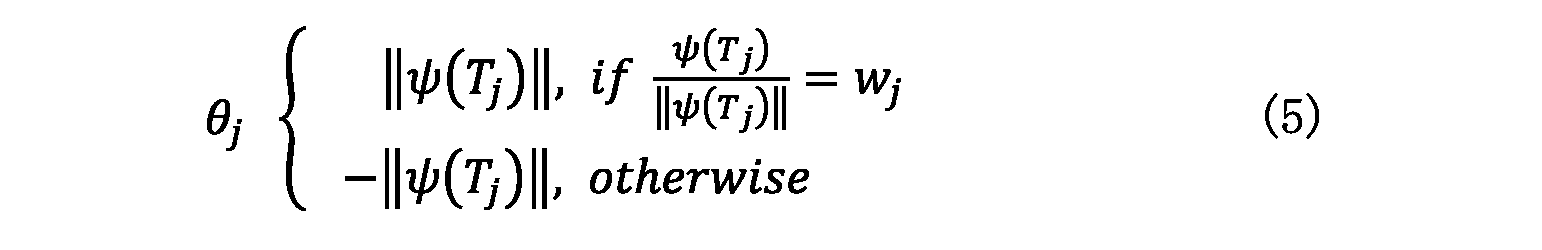

ここで、ひねり回転Tjを次式(5)でクオータニオン表現から回転ベクトル表現に変換(ψ)することでひねり回転角θjが求まる。 Here, the twist rotation angle θ j is obtained by converting the twist rotation T j from a quaternion representation to a rotation vector representation (ψ) using the following equation (5).

また、ひねり回転角θjは人体の構造上ある一定の範囲内しかとり得ないことが期待されることから、例えばその範囲で正規化することで0から1の値域の連続する値として定義できる。これを本実施形態ではひねり回転量と呼ぶ。 In addition, since the twist rotation angle θj is expected to be limited to a certain range due to the structure of the human body, it can be defined as a continuous value in the range from 0 to 1 by normalizing it within that range. In this embodiment, this is called the twist rotation amount.

ひねり回転量は、そのリブや関節点の見えから推定できると期待でき、例えば人物の画像領域から直接、全てのリブのひねり回転量をCNNベースの学習済回帰モデルを用いて推定すれば良い。 The amount of twist rotation can be expected to be estimated from the appearance of the ribs and joint points. For example, the amount of twist rotation of all ribs can be estimated directly from the image region of a person using a CNN-based trained regression model.

姿勢パラメータ推定部50は、関節点三次元座標推定部20が出力する各関節点の三次元座標の推定結果、ひねり回転量推定部30が出力する各リブのひねり回転量の推定結果および身体モデル記憶部40に記憶されている身体モデルを用いて、モデルフィッティングベースの最適化手法により、身体モデルと被写体人物との類似度が最大化するように身体モデルを変形させることで被写体人物の姿勢パラメータを推定する。

The posture

本実施形態では、身体モデルの各関節点の三次元座標および四肢のひねり回転量と、前記関節点三次元座標推定部20が推定した三次元座標、およびひねり回転量推定部30が推定したひねり回転量との差分からなる損失関数が最小化するように身体モデルの姿勢パラメータを繰り返し更新することで被写体人物の姿勢パラメータを推定する。前記最適化には任意の非線形最適化手法を用いることができ、例えば勾配降下法やレーベンバーグ・マーカート法などを採用できる。

In this embodiment, the posture parameters of the subject person are estimated by repeatedly updating the posture parameters of the body model so as to minimize a loss function consisting of the difference between the three-dimensional coordinates of each joint point of the body model and the amount of twist rotation of the limbs, and the three-dimensional coordinates estimated by the joint point three-dimensional coordinate

前記画像入力から姿勢パラメータ推定までの各処理は画像の入力が止まるまで繰り返し行う。なお、画像中から複数の人物が抽出された場合、関節点三次元座標推定から姿勢パラメータ推定までの各処理は並行して行われる。得られた姿勢パラメータはファイル出力や身体モデルへ適用した姿を描画するなど任意の形式で出力する。 The processes from image input to posture parameter estimation are repeated until image input stops. If multiple people are extracted from an image, the processes from joint point 3D coordinate estimation to posture parameter estimation are performed in parallel. The posture parameters obtained can be output in any format, such as a file or by drawing the figure applied to a body model.

図5は、本実施形態による三次元人物姿勢推定の手順を示したフローチャートである。ステップS1では、画像入力部10によりカメラ画像が所定の周期、例えばフレーム単位で取得される。ステップS2では、取得したカメラ画像から人物領域が抽出される。ステップS3では、前記関節点三次元座標推定部20において、人物領域ごとに各関節点が検出され、更に関節点ごとに三次元座標が推定される。

Figure 5 is a flowchart showing the procedure for estimating three-dimensional human pose according to this embodiment. In step S1, the

これと前後または並行して、ステップS4では前記ひねり回転量推定部30において、予め構築されている回帰モデルに各人物領域の画像を適用することで被写体人物の各四肢のひねり回転量が推定される。本実施形態では、任意の人物画像とその四肢のひねり回転量との関係を大量に学習することで回帰モデルが予め構築される。

Before, after, or in parallel with this, in step S4, the twist rotation

ステップS5では、前記姿勢パラメータ推定部50において、身体モデルの現在の姿勢を反映した姿勢パラメータに基づいて当該身体モデルを構成する各関節点の三次元座標および各四肢のひねり回転量が計算される。

In step S5, the posture

ステップS6では、前記身体モデルの各関節点の三次元座標および各四肢のひねり回転量と、前記関節点三次元座標推定部20およびひねり回転量推定部30がそれぞれ推定した各関節点の三次元座標および各四肢のひねり回転量との差分Δdからなる損失関数f(Δd)が計算される。

In step S6, a loss function f(Δd) is calculated, which is the difference Δd between the three-dimensional coordinates of each joint point and the amount of twisting rotation of each limb of the body model and the three-dimensional coordinates of each joint point and the amount of twisting rotation of each limb estimated by the joint point three-dimensional coordinate

ステップS7では、損失関数f(Δd)が所定の収束条件を充足する十分に小さな値であるか否かが判断される。収束条件を充足する値でなければステップS8へ進み、身体モデルの姿勢パラメータを更新(姿勢変形)してステップS5へ戻る。その後、ステップS7で損失関数f(Δd)が所定の収束条件を充足すると判断されるまで上記の各処理が繰り返される。 In step S7, it is determined whether the loss function f(Δd) is a sufficiently small value that satisfies a specified convergence condition. If the value does not satisfy the convergence condition, the process proceeds to step S8, where the posture parameters of the body model are updated (posture deformation) and the process returns to step S5. After that, each of the above processes is repeated until it is determined in step S7 that the loss function f(Δd) satisfies the specified convergence condition.

損失関数f(Δd)が所定の収束条件を充足するとステップS9へ進み、現時点での身体モデルの姿勢パラメータが被写体人物の姿勢パラメータと推定される。ステップS10では次画像の有無が判断され、全ての画像について姿勢推定が終了するまでは、ステップS1へ戻って上記の各処理が繰り返される。 When the loss function f(Δd) satisfies a predetermined convergence condition, the process proceeds to step S9, where the current posture parameters of the body model are estimated to be the posture parameters of the subject person. In step S10, it is determined whether there is a next image, and the process returns to step S1 and the above processes are repeated until posture estimation is completed for all images.

このように、姿勢推定の対象となる実際の人物の四肢にはひねりが生じ得るところ、本実施形態によれば四肢のひねり回転量を考慮して被写体人物の三次元姿勢を推定するので、特に四肢にひねりが生じている人物の姿勢を正確に推定できるようになる。 Thus, the limbs of an actual person who is the subject of posture estimation may be twisted, and according to this embodiment, the three-dimensional posture of the subject person is estimated taking into account the amount of twisting rotation of the limbs, making it possible to accurately estimate the posture of a person whose limbs are particularly twisted.

また、本実施形態によれば、任意の人物画像とその四肢のひねり回転量との関係を学習して構築した回帰モデルを予め用意し、当該回帰モデルに被写体画像を適用することで四肢のひねり回転量を推定するので、少ない計算量で四肢のひねり回転量を考慮した姿勢推定が可能になる。 In addition, according to this embodiment, a regression model is prepared in advance that is constructed by learning the relationship between an arbitrary person image and the amount of twisting rotation of the limbs, and the amount of twisting rotation of the limbs is estimated by applying the subject image to the regression model, making it possible to estimate posture taking into account the amount of twisting rotation of the limbs with a small amount of calculation.

図6は、本発明の第2実施形態に係る三次元人物姿勢推定装置1の主要部の構成を示した機能ブロック図であり、第1実施形態と同一の符号は同一または同等部分を表しているので、その説明は省略する。 Figure 6 is a functional block diagram showing the configuration of the main parts of a 3D human pose estimation device 1 according to a second embodiment of the present invention. The same reference symbols as those in the first embodiment represent the same or equivalent parts, and therefore their explanation will be omitted.

第1実施形態では、ひねり回転量推定部30がカメラ画像のみから被写体人物の各四肢のひねり回転量を直接推定するものとして説明した。しかしながら、人物の各関節点は相対的あるいは絶対的に所定の位置関係を有することから、カメラ画像上で各関節点の位置を予め限定できれば各四肢のひねり回転量の推定精度の向上が期待できる。

In the first embodiment, the twist rotation

そこで、本実施形態では関節点三次元座標推定部20に、各関節点の三次元座標の推定結果に基づいて関節点座標のヒートマップを生成するヒートマップ生成部21を設け、ひねり回転量推定部30へヒートマップを出力するようにした。ヒートマップでは各関節点の位置をその推定位置を中心とする二次元の正規分布で表現することができる。なお、ヒートマップは前記三次元座標の推定過程で得られる二次元情報に基づいて生成しても良い。

In this embodiment, therefore, the joint point three-dimensional coordinate

また、本実施形態では回帰モデルを予め構築する際に、人物画像と関節ごとの四肢のひねり回転量との関係に各関節点の座標位置を追加して回帰モデルを構築する。そして、推定時には被写体画像およびヒートマップに基づく各関節点の推定位置を前記回帰モデルに適用することで関節点ごとに各四肢のひねり回転量を推定する。 In addition, in this embodiment, when constructing a regression model in advance, the regression model is constructed by adding the coordinate position of each joint point to the relationship between the person image and the amount of twist rotation of the limbs for each joint. Then, during estimation, the estimated position of each joint point based on the subject image and the heat map is applied to the regression model to estimate the amount of twist rotation of each limb for each joint point.

本実施形態によれば、被写体画像に基づいて生成した関節点のヒートマップを用いて各関節点のひねり回転量を推定するので、各関節点の探索範囲を制限できる。したがって、より少ない計算量でより精度の高い姿勢推定が可能になる。 According to this embodiment, the amount of twist rotation for each joint point is estimated using a heat map of the joint points generated based on the subject image, so the search range for each joint point can be limited. This enables more accurate pose estimation with less computational effort.

なお、上記の第2実施形態では各関節点の推定位置をヒートマップ形式でひねり回転量推定部30へ提供するものとして説明したが、本発明はこれのみに限定されるものではなく、図7に示したように、関節点三次元座標推定部20が出力する各関節点の三次元座標の推定結果を前記ヒートマップに代えて回転量推定部30へ提供するようにしても良い。

In the second embodiment, the estimated position of each joint point is provided to the twist rotation

さらに、上記の各実施形態では姿勢パラメータ推定部50がフィッティングベースの最適化手法により被写体人物の姿勢パラメータを推定するものとして説明した。しかしながら、本発明はこれのみに限定されるものではなく、予め各関節点の三次元座標およびひねり回転量と各姿勢パラメータとの関係を、例えばニューラルネットワークベースで学習させた任意の回帰モデルを使って、三次元座標およびひねり回転量の各推定結果から姿勢パラメータを推定するようにしても良い。

Furthermore, in each of the above embodiments, the posture

10…画像入力部,20…関節点三次元座標推定部,30…ひねり回転量推定部,31…ヒートマップ生成部,40…身体モデル記憶部,50…姿勢パラメータ推定部 10...Image input unit, 20...Joint point 3D coordinate estimation unit, 30...Twist rotation amount estimation unit, 31...Heat map generation unit, 40...Body model storage unit, 50...Posture parameter estimation unit

Claims (12)

被写体人物の画像に基づいて関節点ごとに三次元座標を推定する手段と、

被写体人物の画像に基づいて関節点ごとに四肢のひねり回転量を推定する手段と、

前記三次元座標およびひねり回転量の各推定結果に基づいて被写体人物の姿勢パラメータを推定する手段とを具備し、

前記姿勢パラメータを推定する手段は、任意の人物画像の各関節点の三次元座標および四肢のひねり回転量と姿勢パラメータとの関係を学習した回帰モデルに前記三次元座標およびひねり回転量の各推定結果を適用することで被写体人物の姿勢パラメータを推定することを特徴とする三次元人物姿勢推定装置。 A three-dimensional human posture estimation device for estimating a three-dimensional posture of a subject person, comprising:

A means for estimating three-dimensional coordinates for each joint point based on an image of a subject person;

A means for estimating a twist rotation amount of a limb for each joint point based on an image of a subject person;

and estimating a posture parameter of the photographed person based on the estimated three-dimensional coordinates and the estimated amount of twist and rotation.

The pose parameter estimation means estimates the pose parameters of the subject person by applying the estimated results of the three-dimensional coordinates and the amount of twist rotation to a regression model that has learned the relationship between the three-dimensional coordinates of each joint point of an arbitrary human image and the amount of twist rotation of the limbs and the pose parameters .

被写体人物の画像に基づいて関節点ごとに三次元座標を推定する手段と、

被写体人物の画像に基づいて関節点ごとに四肢のひねり回転量を推定する手段と、

前記三次元座標およびひねり回転量の各推定結果に基づいて被写体人物の姿勢パラメータを推定する手段とを具備し、

前記ひねり回転量を推定する手段は、任意の人物画像とその四肢のひねり回転量との関係を学習した回帰モデルに被写体人物の画像を適用して各四肢のひねり回転量を推定することを特徴とする三次元人物姿勢推定装置。 A three-dimensional human posture estimation device for estimating a three-dimensional posture of a subject person, comprising:

A means for estimating three-dimensional coordinates for each joint point based on an image of a subject person;

A means for estimating a twist rotation amount of a limb for each joint point based on an image of a subject person;

and estimating a posture parameter of the photographed person based on the estimated three-dimensional coordinates and the estimated amount of twist and rotation.

The means for estimating the amount of twist rotation estimates the amount of twist rotation of each of the four limbs by applying the image of the subject person to a regression model that has learned the relationship between an arbitrary person image and the amount of twist rotation of the limbs.

被写体人物の画像に基づいて関節点ごとに三次元座標を推定する手段と、

被写体人物の画像に基づいて関節点ごとに四肢のひねり回転量を推定する手段と、

前記三次元座標およびひねり回転量の各推定結果に基づいて被写体人物の姿勢パラメータを推定する手段とを具備し、

前記三次元座標を推定する手段が推定した三次元座標または当該三次元座標の推定過程で得られる二次元情報に基づいて関節点のヒートマップを生成する手段を具備し、

前記ひねり回転量を推定する手段は、任意の人物画像とその関節点ごとの四肢のひねり回転量との関係を学習した回帰モデルに被写体人物の画像およびヒートマップを適用して各四肢のひねり回転量を推定することを特徴とする三次元人物姿勢推定装置。 A three-dimensional human posture estimation device for estimating a three-dimensional posture of a subject person, comprising:

A means for estimating three-dimensional coordinates for each joint point based on an image of a subject person;

A means for estimating a twist rotation amount of a limb for each joint point based on an image of a subject person;

and estimating a posture parameter of the photographed person based on the estimated three-dimensional coordinates and the estimated amount of twist and rotation.

a means for generating a heat map of joint points based on the three-dimensional coordinates estimated by the means for estimating the three-dimensional coordinates or two-dimensional information obtained in the process of estimating the three-dimensional coordinates;

The three-dimensional human pose estimation device is characterized in that the means for estimating the amount of twist rotation estimates the amount of twist rotation of each limb by applying the image of the subject person and a heat map to a regression model that has learned the relationship between an arbitrary human image and the amount of twist rotation of the limbs at each joint point of the human image.

被写体人物の画像に基づいて関節点ごとに三次元座標を推定する手段と、

被写体人物の画像に基づいて関節点ごとに四肢のひねり回転量を推定する手段と、

前記三次元座標およびひねり回転量の各推定結果に基づいて被写体人物の姿勢パラメータを推定する手段とを具備し、

前記ひねり回転量を推定する手段は、任意の人物画像とその関節点ごとの四肢のひねり回転量との関係を学習した回帰モデルに被写体人物の画像および前記三次元座標の推定結果を適用して各四肢のひねり回転量を推定することを特徴とする三次元人物姿勢推定装置。 A three-dimensional human posture estimation device for estimating a three-dimensional posture of a subject person, comprising:

A means for estimating three-dimensional coordinates for each joint point based on an image of a subject person;

A means for estimating a twist rotation amount of a limb for each joint point based on an image of a subject person;

and estimating a posture parameter of the photographed person based on the estimated three-dimensional coordinates and the estimated amount of twist and rotation.

The means for estimating the amount of twist rotation estimates the amount of twist rotation of each limb by applying the image of the subject person and the estimated results of the three-dimensional coordinates to a regression model that has learned the relationship between an arbitrary human image and the amount of twist rotation of the limbs for each joint point of the human image, thereby estimating the amount of twist rotation of each limb.

被写体人物の画像に基づいて関節点ごとに三次元座標を推定し、

被写体人物の画像に基づいて関節点ごとに四肢のひねり回転量を推定し、

前記三次元座標およびひねり回転量の各推定結果に基づいて被写体人物の姿勢パラメータを推定し、

任意の人物画像とその四肢のひねり回転量との関係を学習した回帰モデルに被写体人物の画像を適用して各四肢のひねり回転量を推定することを特徴とする三次元人物姿勢推定方法。 A three-dimensional human posture estimation method for estimating a three-dimensional posture of a subject person by a computer, comprising:

The three-dimensional coordinates of each joint point are estimated based on the image of the subject person;

The amount of twist and rotation of the limbs is estimated for each joint based on the image of the subject.

estimating posture parameters of the photographed person based on the estimated three-dimensional coordinates and the amount of twist and rotation;

A three-dimensional human posture estimation method comprising : applying an image of a subject person to a regression model that has learned the relationship between an arbitrary human image and the amount of twisting rotation of the limbs to estimate the amount of twisting rotation of each limb .

被写体人物の画像に基づいて関節点ごとに三次元座標を推定し、

被写体人物の画像に基づいて関節点ごとに四肢のひねり回転量を推定し、

前記三次元座標およびひねり回転量の各推定結果に基づいて被写体人物の姿勢パラメータを推定し、

前記関節点の三次元座標の推定結果に基づいて関節点のヒートマップを生成し、

任意の人物画像とその関節点ごとの四肢のひねり回転量との関係を学習した回帰モデルに被写体人物の画像およびヒートマップを適用して各四肢のひねり回転量を推定することを特徴とする三次元人物姿勢推定方法。 A three-dimensional human posture estimation method for estimating a three-dimensional posture of a subject person by a computer, comprising:

The three-dimensional coordinates of each joint point are estimated based on the image of the subject person;

The amount of twist and rotation of the limbs is estimated for each joint based on the image of the subject.

estimating posture parameters of the photographed person based on the estimated three-dimensional coordinates and the amount of twist and rotation;

generating a heat map of the joint points based on the estimation result of the three-dimensional coordinates of the joint points;

A three-dimensional human pose estimation method characterized by estimating the amount of twist rotation of each limb by applying an image and a heat map of the subject person to a regression model that has learned the relationship between an arbitrary human image and the amount of twist rotation of the limbs at each joint point.

被写体人物の画像に基づいて関節点ごとに三次元座標を推定し、

被写体人物の画像に基づいて関節点ごとに四肢のひねり回転量を推定し、

前記三次元座標およびひねり回転量の各推定結果に基づいて被写体人物の姿勢パラメータを推定し、

任意の人物画像とその関節点ごとの四肢のひねり回転量との関係を学習した回帰モデルに被写体人物の画像および前記三次元座標の推定結果を適用して各四肢のひねり回転量を推定することを特徴とする三次元人物姿勢推定方法。 A three-dimensional human posture estimation method for estimating a three-dimensional posture of a subject person by a computer, comprising:

The three-dimensional coordinates of each joint point are estimated based on the image of the subject person;

The amount of twist and rotation of the limbs is estimated for each joint based on the image of the subject.

estimating posture parameters of the photographed person based on the estimated three-dimensional coordinates and the amount of twist and rotation;

A three-dimensional human posture estimation method, comprising: applying an image of a subject person and the estimated results of the three-dimensional coordinates to a regression model that has learned the relationship between an arbitrary human image and the amount of twisting rotation of each limb at each joint point, thereby estimating the amount of twisting rotation of each limb.

被写体人物の画像に基づいて関節点ごとに三次元座標を推定する手順と、

被写体人物の画像に基づいて関節点ごとに四肢のひねり回転量を推定する手順と、

前記三次元座標およびひねり回転量の各推定結果に基づいて被写体人物の姿勢パラメータを推定する手順と、をコンピュータに実行させ、

前記ひねり回転量を推定する手順では、任意の人物画像とその四肢のひねり回転量との関係を学習した回帰モデルに被写体人物の画像を適用して各四肢のひねり回転量を推定することを特徴とする三次元人物姿勢推定プログラム。 In a three-dimensional human posture estimation program for estimating a three-dimensional posture of a subject person,

A step of estimating three-dimensional coordinates for each joint point based on an image of a subject person;

A step of estimating a twist rotation amount of a limb for each joint point based on an image of a subject person;

and estimating posture parameters of the photographed person based on the estimated three-dimensional coordinates and the estimated amount of twist rotation.

The three-dimensional human pose estimation program is characterized in that the step of estimating the amount of twist rotation includes applying an image of a subject person to a regression model that has learned the relationship between an arbitrary human image and the amount of twist rotation of its limbs to estimate the amount of twist rotation of each limb .

被写体人物の画像に基づいて関節点ごとに三次元座標を推定する手順と、

被写体人物の画像に基づいて関節点ごとに四肢のひねり回転量を推定する手順と、

前記三次元座標およびひねり回転量の各推定結果に基づいて被写体人物の姿勢パラメータを推定する手順と、をコンピュータに実行させ、

前記三次元座標を推定する手段が推定した三次元座標に基づいて関節点のヒートマップを生成する手順を含み、

前記ひねり回転量を推定する手順では、任意の人物画像とその関節点ごとの四肢のひねり回転量との関係を学習した回帰モデルに被写体人物の画像およびヒートマップを適用して各四肢のひねり回転量を推定することを特徴とする三次元人物姿勢推定プログラム。 In a three-dimensional human posture estimation program for estimating a three-dimensional posture of a subject person,

A step of estimating three-dimensional coordinates for each joint point based on an image of a subject person;

A step of estimating a twist rotation amount of a limb for each joint point based on an image of a subject person;

and estimating posture parameters of the photographed person based on the estimated three-dimensional coordinates and the amount of twist rotation.

generating a heat map of joint points based on the estimated three-dimensional coordinates by the means for estimating the three-dimensional coordinates;

The three-dimensional human pose estimation program is characterized in that the step of estimating the amount of twist rotation includes applying an image and a heat map of the subject person to a regression model that has learned the relationship between an arbitrary human image and the amount of twist rotation of each limb at each joint point to estimate the amount of twist rotation of each limb.

被写体人物の画像に基づいて関節点ごとに三次元座標を推定する手順と、

被写体人物の画像に基づいて関節点ごとに四肢のひねり回転量を推定する手順と、

前記三次元座標およびひねり回転量の各推定結果に基づいて被写体人物の姿勢パラメータを推定する手順と、をコンピュータに実行させ、

前記ひねり回転量を推定する手順では、任意の人物画像とその関節点ごとの四肢のひねり回転量との関係を学習した回帰モデルに被写体人物の画像および前記三次元座標の推定結果を適用して各四肢のひねり回転量を推定することを特徴とする三次元人物姿勢推定プログラム。 In a three-dimensional human posture estimation program for estimating a three-dimensional posture of a subject person,

A step of estimating three-dimensional coordinates for each joint point based on an image of a subject person;

A step of estimating a twist rotation amount of a limb for each joint point based on an image of a subject person;

and estimating posture parameters of the photographed person based on the estimated three-dimensional coordinates and the estimated amount of twist rotation.

The step of estimating the amount of twist rotation of each limb includes applying the image of the subject person and the estimated results of the three-dimensional coordinates to a regression model that has learned the relationship between an arbitrary human image and the amount of twist rotation of the limbs at each joint point of the human image, thereby estimating the amount of twist rotation of each limb.

Priority Applications (1)

| Application Number | Priority Date | Filing Date | Title |

|---|---|---|---|

| JP2020205383A JP7464512B2 (en) | 2020-12-10 | 2020-12-10 | 3D human posture estimation device, method and program |

Applications Claiming Priority (1)

| Application Number | Priority Date | Filing Date | Title |

|---|---|---|---|

| JP2020205383A JP7464512B2 (en) | 2020-12-10 | 2020-12-10 | 3D human posture estimation device, method and program |

Publications (2)

| Publication Number | Publication Date |

|---|---|

| JP2022092528A JP2022092528A (en) | 2022-06-22 |

| JP7464512B2 true JP7464512B2 (en) | 2024-04-09 |

Family

ID=82067939

Family Applications (1)

| Application Number | Title | Priority Date | Filing Date |

|---|---|---|---|

| JP2020205383A Active JP7464512B2 (en) | 2020-12-10 | 2020-12-10 | 3D human posture estimation device, method and program |

Country Status (1)

| Country | Link |

|---|---|

| JP (1) | JP7464512B2 (en) |

Families Citing this family (5)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| JP7600762B2 (en) | 2021-02-26 | 2024-12-17 | 日本電気株式会社 | Posture estimation device, learning device, posture estimation method and program |

| CN115346277A (en) * | 2022-08-29 | 2022-11-15 | 联想(北京)有限公司 | Data generation method and device |

| JP7768414B2 (en) | 2022-09-13 | 2025-11-12 | 富士通株式会社 | Conversion method, conversion program, and conversion device |

| CN117726907B (en) * | 2024-02-06 | 2024-04-30 | 之江实验室 | A training method for modeling model, a method for three-dimensional human body modeling and a device |

| CN119559697B (en) * | 2024-11-18 | 2025-11-04 | 重庆邮电大学 | A method and system for estimating pose in 3D multi-person scenarios based on explicit limb representation |

Citations (5)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| WO2013011644A1 (en) | 2011-07-15 | 2013-01-24 | パナソニック株式会社 | Posture estimation device, posture estimation method, and posture estimation program |

| JP2015167008A (en) | 2013-07-30 | 2015-09-24 | キヤノン株式会社 | Pose estimation device, pose estimation method and program |

| WO2019069358A1 (en) | 2017-10-03 | 2019-04-11 | 富士通株式会社 | Recognition program, recognition method, and recognition device |

| WO2020049847A1 (en) | 2018-09-06 | 2020-03-12 | 株式会社ソニー・インタラクティブエンタテインメント | Estimation device, learning device, estimation method, learning method, and program |

| JP2023057498A (en) | 2021-10-11 | 2023-04-21 | リアルビジョンスポーツ株式会社 | Motion attitude evaluating system by overlapping comparison of images |

Family Cites Families (2)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| JP2627483B2 (en) * | 1994-05-09 | 1997-07-09 | 株式会社エイ・ティ・アール通信システム研究所 | Attitude detection apparatus and method |

| JP2892610B2 (en) * | 1996-01-16 | 1999-05-17 | 株式会社エイ・ティ・アール通信システム研究所 | Attitude detection device |

-

2020

- 2020-12-10 JP JP2020205383A patent/JP7464512B2/en active Active

Patent Citations (5)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| WO2013011644A1 (en) | 2011-07-15 | 2013-01-24 | パナソニック株式会社 | Posture estimation device, posture estimation method, and posture estimation program |

| JP2015167008A (en) | 2013-07-30 | 2015-09-24 | キヤノン株式会社 | Pose estimation device, pose estimation method and program |

| WO2019069358A1 (en) | 2017-10-03 | 2019-04-11 | 富士通株式会社 | Recognition program, recognition method, and recognition device |

| WO2020049847A1 (en) | 2018-09-06 | 2020-03-12 | 株式会社ソニー・インタラクティブエンタテインメント | Estimation device, learning device, estimation method, learning method, and program |

| JP2023057498A (en) | 2021-10-11 | 2023-04-21 | リアルビジョンスポーツ株式会社 | Motion attitude evaluating system by overlapping comparison of images |

Also Published As

| Publication number | Publication date |

|---|---|

| JP2022092528A (en) | 2022-06-22 |

Similar Documents

| Publication | Publication Date | Title |

|---|---|---|

| JP7464512B2 (en) | 3D human posture estimation device, method and program | |

| US12469239B2 (en) | Data processing method and apparatus, electronic device, and computer-readable storage medium | |

| Zhu et al. | Detailed human shape estimation from a single image by hierarchical mesh deformation | |

| US10949649B2 (en) | Real-time tracking of facial features in unconstrained video | |

| Moreno-Noguer | 3d human pose estimation from a single image via distance matrix regression | |

| Ye et al. | Accurate 3d pose estimation from a single depth image | |

| CN111414797B (en) | Systems and methods for estimating pose and pose information of a subject | |

| JP4950787B2 (en) | Image processing apparatus and method | |

| CN101093582B (en) | Motion capture device and motion capture method | |

| WO2007010893A1 (en) | Joint object position and posture estimating device, its method, and program | |

| CN103310188A (en) | Method and apparatus for pose recognition | |

| CN111862299A (en) | Human body three-dimensional model construction method, device, robot and storage medium | |

| JP2005339288A (en) | Image processing apparatus and method | |

| CN112401369A (en) | Body parameter measuring method, system, equipment, chip and medium based on human body reconstruction | |

| Krishna | SignPose: Sign language animation through 3D pose lifting | |

| CN115049764A (en) | Training method, device, equipment and medium for SMPL parameter prediction model | |

| CN114663983A (en) | Mesh topology acquisition method, device, electronic device and storage medium | |

| CN116245940A (en) | Category-level six-degree-of-freedom object pose estimation method based on structure difference perception | |

| Henning et al. | BodySLAM++: Fast and tightly-coupled visual-inertial camera and human motion tracking | |

| Krzeszowski et al. | Gait recognition based on marker-less 3D motion capture | |

| Jatesiktat et al. | Personalized markerless upper-body tracking with a depth camera and wrist-worn inertial measurement units | |

| Cong et al. | Efficient human motion reconstruction from monocular videos with physical consistency loss | |

| Bian et al. | ShapeBoost: Boosting human shape estimation with part-based parameterization and clothing-preserving augmentation | |

| Bhuyan et al. | Hand gesture recognition and animation for local hand motions | |

| Asad et al. | Hand orientation regression using random forest for augmented reality |

Legal Events

| Date | Code | Title | Description |

|---|---|---|---|

| A621 | Written request for application examination |

Free format text: JAPANESE INTERMEDIATE CODE: A621 Effective date: 20230307 |

|

| A977 | Report on retrieval |

Free format text: JAPANESE INTERMEDIATE CODE: A971007 Effective date: 20240126 |

|

| A131 | Notification of reasons for refusal |

Free format text: JAPANESE INTERMEDIATE CODE: A131 Effective date: 20240131 |

|

| A521 | Request for written amendment filed |

Free format text: JAPANESE INTERMEDIATE CODE: A523 Effective date: 20240306 |

|

| TRDD | Decision of grant or rejection written | ||

| A01 | Written decision to grant a patent or to grant a registration (utility model) |

Free format text: JAPANESE INTERMEDIATE CODE: A01 Effective date: 20240327 |

|

| A61 | First payment of annual fees (during grant procedure) |

Free format text: JAPANESE INTERMEDIATE CODE: A61 Effective date: 20240328 |

|

| R150 | Certificate of patent or registration of utility model |

Ref document number: 7464512 Country of ref document: JP Free format text: JAPANESE INTERMEDIATE CODE: R150 |