JP2025069438A - Information processing system, information processing method, and information processing program - Google Patents

Information processing system, information processing method, and information processing program Download PDFInfo

- Publication number

- JP2025069438A JP2025069438A JP2025019594A JP2025019594A JP2025069438A JP 2025069438 A JP2025069438 A JP 2025069438A JP 2025019594 A JP2025019594 A JP 2025019594A JP 2025019594 A JP2025019594 A JP 2025019594A JP 2025069438 A JP2025069438 A JP 2025069438A

- Authority

- JP

- Japan

- Prior art keywords

- anchor

- information processing

- sound source

- space

- reverberation

- Prior art date

- Legal status (The legal status is an assumption and is not a legal conclusion. Google has not performed a legal analysis and makes no representation as to the accuracy of the status listed.)

- Pending

Links

Classifications

-

- G—PHYSICS

- G10—MUSICAL INSTRUMENTS; ACOUSTICS

- G10K—SOUND-PRODUCING DEVICES; METHODS OR DEVICES FOR PROTECTING AGAINST, OR FOR DAMPING, NOISE OR OTHER ACOUSTIC WAVES IN GENERAL; ACOUSTICS NOT OTHERWISE PROVIDED FOR

- G10K15/00—Acoustics not otherwise provided for

- G10K15/08—Arrangements for producing a reverberation or echo sound

- G10K15/10—Arrangements for producing a reverberation or echo sound using time-delay networks comprising electromechanical or electro-acoustic devices

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04R—LOUDSPEAKERS, MICROPHONES, GRAMOPHONE PICK-UPS OR LIKE ACOUSTIC ELECTROMECHANICAL TRANSDUCERS; DEAF-AID SETS; PUBLIC ADDRESS SYSTEMS

- H04R3/00—Circuits for transducers, loudspeakers or microphones

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04S—STEREOPHONIC SYSTEMS

- H04S7/00—Indicating arrangements; Control arrangements, e.g. balance control

Landscapes

- Physics & Mathematics (AREA)

- Engineering & Computer Science (AREA)

- Acoustics & Sound (AREA)

- Signal Processing (AREA)

- Multimedia (AREA)

- Circuit For Audible Band Transducer (AREA)

- Stereophonic System (AREA)

- Reverberation, Karaoke And Other Acoustics (AREA)

Abstract

Description

本発明は、情報処理システム、情報処理方法および情報処理プログラムに関する。 The present invention relates to an information processing system, an information processing method, and an information processing program.

従来、地理的な座標位置から所定の距離内にある範囲をジオフェンスとして設定し、GPS(Global Positioning System)等の測位衛星によって位置情報を取得できるモバイル端末が設定されたジオフェンス内に入った場合にモバイル端末にコンテンツの提供等のイベントを開始する技術がある。例えば、特許文献1には、モバイルクライアント装置がGPS受信機を有し、ジオフェンスにより定義される地理的ポジションの閾値距離内にモバイルクライアント装置が入った場合に広告等の印刷データを提供する技術が開示されている。 Conventionally, there is a technology that sets an area within a specified distance from a geographical coordinate position as a geofence, and starts an event such as providing content to a mobile terminal when a mobile terminal that can acquire position information from a positioning satellite such as a GPS (Global Positioning System) enters the set geofence. For example, Patent Document 1 discloses a technology in which a mobile client device has a GPS receiver, and provides print data such as an advertisement when the mobile client device enters within a threshold distance of a geographical position defined by the geofence.

また、カメラ等により撮影された映像に画像を重畳させるVR(Virtual Reality)において空間に配置されたイベントを実行する技術があった。例えば、特許文献2には、カメラで撮影された撮影画像に予め登録されたオブジェクトを配置して再生する装置に関する技術が開示されている。 There is also a technology for executing events arranged in a space in VR (Virtual Reality) by superimposing an image on a video captured by a camera or the like. For example, Patent Document 2 discloses a technology relating to a device that arranges a pre-registered object on an image captured by a camera and plays it back.

しかし、特許文献1の技術においては、測位衛星からの電波の受信状態によって測位の精度が変化して、例えば、上空の見晴らしの悪い場所や屋内においては測位衛星による測位精度が低下し、あるいは測位不能となる場合があった。このため、測位衛星による測位結果に応じてイベントが実行されるシステムにおいては、端末がジオフェンスに入ったか否かの検出精度が低下して、イベント開始のタイミングがずれる等、イベント開始の精度が低下する場合があった。 However, in the technology of Patent Document 1, the accuracy of positioning varies depending on the reception state of radio waves from the positioning satellite. For example, in places with poor visibility in the sky or indoors, the accuracy of positioning by the positioning satellite may decrease or positioning may be impossible. For this reason, in a system in which an event is executed according to the results of positioning by the positioning satellite, the accuracy of detection of whether or not the terminal has entered a geofence may decrease, causing the timing of the event start to be off, and other such accuracy in starting the event to decrease.

また、特許文献2においては、利用者の位置を精度良く検出するためには、複数のセンサを設置する必要があり、空間に仮想的に配置されたイベントが開始される開始条件の精度を向上させるためにはシステムを構築するコストが上昇してしまう場合があった。 In addition, in Patent Document 2, in order to accurately detect the user's position, it is necessary to install multiple sensors, and the cost of building the system may increase in order to improve the accuracy of the start conditions for starting an event virtually placed in space.

また、イベントとして実行される音源の再生においては、音源が再生される空間の形状等によって残響特性が異なるため、コンテンツを提供する提供者は、個別の空間の残響特性に応じてそれぞれの音源の調整をする必要があり、コンテンツを提供するためのコストが上昇してしまう場合があった。 In addition, when playing sound sources as part of an event, the reverberation characteristics differ depending on the shape of the space in which the sound source is played, so content providers need to adjust each sound source according to the reverberation characteristics of each individual space, which can increase the cost of providing content.

本発明は上記事情に鑑みてなされたものであり、測位衛星による測位が困難な状況においても空間に配置されたコンテンツを実行できるとともに、空間に応じた音源の提供コストの低減を図ることができる、情報処理システム、情報処理方法および情報処理プログラムを提供することを一つの目的とする。 The present invention has been made in consideration of the above circumstances, and has as its object to provide an information processing system, an information processing method, and an information processing program that can execute content arranged in a space even in situations where positioning by a positioning satellite is difficult, and can reduce the cost of providing a sound source according to the space.

上記の課題を解決するため、情報処理システムは、利用者に対してコンテンツを提供するための情報処理システムであって、利用者によって保持されて、空間をスキャンして空間に存在する対象物までの距離を取得する取得部と、取得部において取得された距離に基づき対象物の空間における座標情報を算出する座標情報算出部と、座標情報算出部において算出された座標情報と、予め空間に仮想的に配置されたアンカーの位置情報とに基づき、アンカーを検出するアンカー検出部と、空間における残響特性を算出する残響特性算出部と、残響特性算出部において算出部された残響特性に基づき、音源を調整する音源調整部と、アンカー検出部においてアンカーが検出されたときに、音源調整部において調整された音源に係るコンテンツの利用者に対する提供を制御するコンテンツ制御部とを備える。 To solve the above problems, the information processing system is an information processing system for providing content to a user, and includes an acquisition unit that is held by the user and scans a space to acquire a distance to an object present in the space, a coordinate information calculation unit that calculates coordinate information in the space of the object based on the distance acquired by the acquisition unit, an anchor detection unit that detects an anchor based on the coordinate information calculated by the coordinate information calculation unit and position information of an anchor virtually placed in advance in the space, a reverberation characteristic calculation unit that calculates reverberation characteristics in the space, a sound source adjustment unit that adjusts the sound source based on the reverberation characteristics calculated by the reverberation characteristic calculation unit, and a content control unit that controls the provision of content related to the sound source adjusted by the sound source adjustment unit to the user when an anchor is detected by the anchor detection unit.

本発明の一つの実施形態によれば、利用者によって保持されて、空間をスキャンして空間に存在する対象物までの距離を取得し、取得された距離に基づき対象物の空間における座標情報を算出し、算出された座標情報と、予め空間に仮想的に配置されたアンカーの位置情報とに基づき、アンカーを検出し、算出された座標情報に基づき、空間における残響特性を算出し、算出部された残響特性に基づき、音源を調整し、アンカーが検出されたときに、調整された音源に係るコンテンツの利用者に対する提供を制御することにより、測位衛星による測位が困難な状況においても空間に配置されたコンテンツを実行できるとともに、空間に応じた音源の提供コストの低減を図ることができる。 According to one embodiment of the present invention, the device is held by a user, scans a space to obtain the distance to an object present in the space, calculates coordinate information of the object in the space based on the obtained distance, detects an anchor based on the calculated coordinate information and position information of an anchor virtually placed in the space in advance, calculates reverberation characteristics in the space based on the calculated coordinate information, adjusts a sound source based on the calculated reverberation characteristics, and when an anchor is detected, controls the provision of content related to the adjusted sound source to the user, thereby making it possible to execute content placed in the space even in situations where positioning by a positioning satellite is difficult, and reducing the cost of providing a sound source according to the space.

以下、図面を参照して本発明の一実施形態における情報処理システム、情報処理方法および情報処理プログラムについて詳細に説明する。 Below, an information processing system, information processing method, and information processing program according to one embodiment of the present invention will be described in detail with reference to the drawings.

先ず、図1を用いて、情報処理システムの構成を説明する。図1は、実施形態における情報処理システムのシステム構成の一例を示すブロック図である。 First, the configuration of the information processing system will be described using FIG. 1. FIG. 1 is a block diagram showing an example of the system configuration of an information processing system in an embodiment.

図1において、情報処理システム1は、情報処理端末10、情報処理端末20、情報処理装置30およびコンテンツ実行装置40を有する。 In FIG. 1, the information processing system 1 has an information processing terminal 10, an information processing terminal 20, an information processing device 30, and a content execution device 40.

情報処理端末10は、空間に仮想的に配置されて実行されるコンテンツ(イベントという場合がある。)を設定するための端末である。情報処理端末20は、利用者に保持されて、空間に仮想的に配置されたコンテンツの提供を利用者が受けるための端末である。情報処理装置30は、情報処理端末10において配置されたコンテンツの設定を記憶し、記憶したコンテンツの設定に基づき、情報処理端末20を保持する利用者に対してコンテンツを提供させるための装置である。また、コンテンツ実行装置40は、利用者に対してコンテンツを提供する装置である。 The information processing terminal 10 is a terminal for setting content (sometimes called an event) that is virtually placed in a space and executed. The information processing terminal 20 is a terminal that is held by a user and that allows the user to receive the content that is virtually placed in a space. The information processing device 30 is a device that stores the settings of the content placed in the information processing terminal 10 and provides content to the user holding the information processing terminal 20 based on the stored content settings. The content execution device 40 is a device that provides content to the user.

本実勢形態におけるコンテンツとは、情報処理端末20の移動によって実行される、情報処理システム1において装置を動作させる情報である。情報処理システム1における装置とは、例えば、情報処理端末20(または情報処理端末10)、または、コンテンツ実行装置40等である。 In this embodiment, content is information that is executed by the movement of the information processing terminal 20 and that operates a device in the information processing system 1. A device in the information processing system 1 is, for example, the information processing terminal 20 (or the information processing terminal 10) or the content execution device 40.

情報処理システム1における装置の動作とは、例えば、コンテンツの再生、データ通信、またはアクチュエータの動作等である。コンテンツの再生とは、例えば、音源の再生、画像(動画または静止画)の表示、または3Dオブジェクトの表示等である。データ通信とは、例えば、情報処理端末20と情報処理装置30との通信、または情報処理装置30とコンテンツ実行装置40との通信である。データ通信においては、例えば、情報処理端末20の端末情報(例えば、機器ID、位置情報、加速度センサ計測値またはカメラ撮影画像等)を情報処理装置30に提供する。また、データ通信において、例えば、情報処理端末20からのデータ通信によってコンテンツ実行装置40(例えば、音響機器または映像機器等)を制御してもよい。また、アクチュエータの動作とは、モータまたはエアシリンダ、エアバルブ等のアクチュエータの動作であり、例えば、モータ等によって駆動される動物形状のオブジェクトもしくはドア等を動かしたり、空気によって膨らむバルーンを膨らませたりする動作である。情報処理システム1においては、これらの装置が動作することにより利用者にコンテンツが提供される。 The operation of the device in the information processing system 1 is, for example, the reproduction of content, data communication, or the operation of an actuator. The reproduction of content is, for example, the reproduction of a sound source, the display of an image (moving or still image), or the display of a 3D object. The data communication is, for example, the communication between the information processing terminal 20 and the information processing device 30, or the communication between the information processing device 30 and the content execution device 40. In the data communication, for example, the terminal information of the information processing terminal 20 (for example, the device ID, the position information, the acceleration sensor measurement value, or the camera image, etc.) is provided to the information processing device 30. In the data communication, for example, the content execution device 40 (for example, an audio device or a video device, etc.) may be controlled by the data communication from the information processing terminal 20. In addition, the operation of the actuator is the operation of an actuator such as a motor, an air cylinder, or an air valve, for example, the operation of moving an animal-shaped object or a door driven by a motor, etc., or the operation of inflating a balloon that is inflated by air. In the information processing system 1, the content is provided to the user by the operation of these devices.

なお、以下の実施例においては、コンテンツの実行として、情報処理端末20およびコンテンツ実行装置40における音源の再生を例示する。しかし、情報処理システム1におけるコンテンツの実行はこれに限定されるものではない。 In the following embodiment, the execution of content is exemplified by playing a sound source in the information processing terminal 20 and the content execution device 40. However, the execution of content in the information processing system 1 is not limited to this.

情報処理端末10および情報処理端末20は、利用者によって保持されて可搬(携帯)される装置であって、例えば、スマートフォン、タブレットPCまたはヘッドマウント型、メガネ型もしくは腕時計型のウエアラブル装置等である。また、情報処理装置30は、ネットワーク9を介して情報処理端末10および情報処理端末20と通信可能に接続される装置であって、例えば、サーバ装置である。なお、本実施形態における利用者とは、情報処理端末10、情報処理端末20または情報処理装置30の利用者であって、それぞれ別の利用者であっても、あるいは同一の利用者であってもよい。また、利用者は専用のオペレータであっても、あるいは専用のオペレータ以外の一般の利用者であってもよい。 The information processing terminal 10 and the information processing terminal 20 are devices that are held and carried (carried) by users, and are, for example, smartphones, tablet PCs, or head-mounted, glasses-type, or wristwatch-type wearable devices. The information processing device 30 is a device that is communicatively connected to the information processing terminal 10 and the information processing terminal 20 via the network 9, and is, for example, a server device. Note that the user in this embodiment refers to the user of the information processing terminal 10, the information processing terminal 20, or the information processing device 30, and may be different users or the same user. The user may be a dedicated operator, or a general user other than a dedicated operator.

情報処理端末10は、取得部11、表示部12、アンカー配置部13、アンカー情報提供部14、コンテンツ設定部15およびコンテンツ情報提供部16を有する。情報処理端末20は、取得部21、座標情報算出部22、座標情報提供部23およびコンテンツ実行部24を有する。また、情報処理装置30は、アンカー情報記憶部31、アンカー検出部32、音響特性記憶部33、残響特性算出部34、音源調整部35およびコンテンツ制御部36を有する。また、コンテンツ実行装置40は、コンテンツ実行部41を有する。本実施形態における情報処理システム1の上記各機能部は、本実施形態における情報処理プログラム(ソフトウェア)によって実現される機能モジュールであるものとして説明する。 The information processing terminal 10 has an acquisition unit 11, a display unit 12, an anchor placement unit 13, an anchor information provision unit 14, a content setting unit 15, and a content information provision unit 16. The information processing terminal 20 has an acquisition unit 21, a coordinate information calculation unit 22, a coordinate information provision unit 23, and a content execution unit 24. The information processing device 30 has an anchor information storage unit 31, an anchor detection unit 32, an acoustic characteristic storage unit 33, a reverberation characteristic calculation unit 34, a sound source adjustment unit 35, and a content control unit 36. The content execution device 40 has a content execution unit 41. The above-mentioned functional units of the information processing system 1 in this embodiment will be described as functional modules realized by the information processing program (software) in this embodiment.

取得部11および取得部21は、空間をスキャンするセンサにおいてスキャンされたスキャンデータを取得する。空間をスキャンするセンサとは、空間に存在する物体の形状をスキャンするセンサであり、例えば、空間に存在する物体までの距離を測距する測距センサである。測距センサとしては、例えば、LiDAR(Light Detection And Ranging)技術を用いたセンサを用いることができる。LiDARにおいては、例えば、レーザー光が用いられる。LiDARは、紫外線、赤外線、または近赤外線を用いるものであってもよい。LiDARは、センサから物体までの距離を計測(測距)することによって空間に存在する物体の形状を3次元で計測することができる。物体の形状を3次元で計測するとは、空間に存在する物体の形状を空間における座標情報として表現することである。空間における座標情報とは、空間における基準となる点(座標)からの相対的な2次元または3次元の座標値である。例えば、空間に存在する物体の表面形状は、座標値の集合(点群データ)として表現することができる。座標値の集合は、例えば、線、面または立体として表現されてもよい。座標情報は空間の表面形状を示す情報であり、空間情報という場合がある。 The acquisition unit 11 and the acquisition unit 21 acquire scan data scanned by a sensor that scans a space. The sensor that scans a space is a sensor that scans the shape of an object present in the space, for example, a distance measurement sensor that measures the distance to an object present in the space. For example, a sensor using LiDAR (Light Detection and Ranging) technology can be used as the distance measurement sensor. In LiDAR, for example, laser light is used. LiDAR may use ultraviolet light, infrared light, or near infrared light. LiDAR can measure the shape of an object present in a space in three dimensions by measuring the distance from the sensor to the object (distance measurement). Measuring the shape of an object in three dimensions means expressing the shape of an object present in a space as coordinate information in the space. The coordinate information in the space is a two-dimensional or three-dimensional coordinate value relative to a reference point (coordinate) in the space. For example, the surface shape of an object present in a space can be expressed as a set of coordinate values (point cloud data). A set of coordinate values may be expressed, for example, as a line, a surface, or a solid. Coordinate information is information that indicates the surface shape of a space, and is sometimes called spatial information.

なお、空間をスキャンしたスキャンデータは、例えば、情報処理端末10または情報処理端末20が有する図示しないステレオカメラで撮影された撮影画像等であってもよい。また、空間をスキャンしたスキャンデータは、情報処理端末10または情報処理端末20が有する図示しない位置センサまたは加速度センサによって取得される情報を含んでいてもよい。 The scan data obtained by scanning the space may be, for example, images captured by a stereo camera (not shown) possessed by the information processing terminal 10 or the information processing terminal 20. The scan data obtained by scanning the space may also include information acquired by a position sensor or acceleration sensor (not shown) possessed by the information processing terminal 10 or the information processing terminal 20.

表示部12は、カメラにおいて撮影された撮影画像を表示器(例えば、液晶等のディスプレイ)に表示させる。表示部12は、例えば、スマートフォンのカメラにおいて撮影された撮影画像をスマートフォンのディスプレイに表示させることにより、利用者が撮影結果を確認出来るようにする。また、表示部12は、取得部11において取得されたスキャンデータに基づき算出された座標情報に基づく物体の形状を表示するようにしてもよい。 The display unit 12 displays the image captured by the camera on a display (e.g., a display such as an LCD). For example, the display unit 12 displays the image captured by the smartphone camera on the smartphone display, allowing the user to check the capture results. The display unit 12 may also display the shape of an object based on coordinate information calculated based on the scan data acquired by the acquisition unit 11.

アンカー配置部13は、取得部11において取得されたスキャンデータに基づき、表示部12において表示された撮影画像に仮想的なアンカーを配置する操作(UI:User Interface)を利用者に提供する。仮想的なアンカーとは、空間に仮想的に設置(配置)されたマーク(目印)であり、空間内の特定の位置を表す位置情報(座標値)を有する。本実施形態におけるアンカーは、例えば、音源等のコンテンツを配置する位置を示すマーク等である。マークの形状は、例えば、球体、立方体、またはアイコン画像等であり、表示部12において表示されて、利用者が目視できるものであればよい。利用者は、アンカー配置部13から提供されたUIを操作してアンカーを配置することができる。なお、本実施形態においては、情報処理端末10のアンカー配置部13がアンカーを配置するためのUIを提供する場合を例示したが、アンカーを配置するためのUIは、情報処理端末20において提供するようにしてもよい。すなわち、情報処理端末20の利用者がアンカーを配置できるようにしてもよい。 The anchor placement unit 13 provides the user with an operation (UI: User Interface) for placing a virtual anchor in the captured image displayed on the display unit 12 based on the scan data acquired by the acquisition unit 11. A virtual anchor is a mark (marker) virtually installed (placed) in space, and has position information (coordinate values) that indicates a specific position in the space. The anchor in this embodiment is, for example, a mark indicating a position where content such as a sound source is placed. The shape of the mark is, for example, a sphere, a cube, or an icon image, and may be displayed on the display unit 12 and visible to the user. The user can place the anchor by operating the UI provided by the anchor placement unit 13. Note that in this embodiment, the case where the anchor placement unit 13 of the information processing terminal 10 provides a UI for placing the anchor is exemplified, but the UI for placing the anchor may be provided by the information processing terminal 20. In other words, the user of the information processing terminal 20 may be able to place the anchor.

空間に存在する物体は、カメラにおいて撮影されるとともに取得部11において取得されたスキャンデータに基づきその形状が取得される。したがって、表示部12に表示された撮影画像に含まれる物体は、その形状を示す座標情報が特定されている。アンカー配置部13は、撮影画像を表示部12に表示して、利用者が撮影画像にアンカーを配置できるUIを提供することにより、利用者が空間の座標値を意識することなく、アンカーが設置された座標値を取得することができる。利用者は、表示部12に表示された撮影画像を確認しながら、アンカーを配置する位置を設定することが可能となる。 Objects in space are photographed by the camera, and their shapes are acquired based on the scan data acquired by the acquisition unit 11. Therefore, objects included in the photographed image displayed on the display unit 12 have coordinate information indicating their shapes identified. The anchor placement unit 13 displays the photographed image on the display unit 12 and provides a UI that enables the user to place an anchor in the photographed image, thereby enabling the user to obtain the coordinate values at which the anchor is placed without being aware of the spatial coordinate values. The user can set the position at which the anchor is placed while checking the photographed image displayed on the display unit 12.

アンカー配置部13は、表示部12において表示された撮影画像を用いてアンカーを配置する位置を修正する操作を利用者にさらに提供する。アンカーの配置位置は表示部12に表示される2次元の撮影画像を確認しながら決定されるため、表示画面の奥行き方向においては、配置位置が不明瞭となる場合がある。例えば、アンカー配置部13は、一度配置されたアンカーの位置を、奥行き方向に予め定められた距離(例えば、1mまたは50cm等)移動させることにより、アンカーを配置する位置を修正することが可能となる。アンカーを配置する位置を修正することにより、再度アンカーを配置し直す場合に比べてアンカー配置の効率化を図ることが可能となる。 The anchor placement unit 13 further provides the user with an operation to correct the position of the anchor by using the captured image displayed on the display unit 12. Since the position of the anchor is determined while checking the two-dimensional captured image displayed on the display unit 12, the placement position may be unclear in the depth direction of the display screen. For example, the anchor placement unit 13 can correct the position of the anchor by moving the position of an anchor that has been placed once in the depth direction by a predetermined distance (e.g., 1 m or 50 cm, etc.). By correcting the position of the anchor, it is possible to improve the efficiency of anchor placement compared to the case of repositioning the anchor again.

アンカー情報提供部14は、アンカー配置部13において配置されたアンカーに係るアンカー情報を情報処理装置30に提供する。アンカーに係るアンカー情報には、例えば、空間における座標情報が含まれる。空間における座標情報とは、空間をスキャンしたスキャンデータに基づく座標情報であり、例えば、空間に存在する特徴量の大きい物体からの相対的な位置を示す座標情報である。空間の特徴量とは、例えば、空間に存在する色データの分布(ヒストグラム)、物体の形状または色データのベクトルデータである。空間を認識する場合において、特徴量が近似している場所は、同一の場所であると認識することができる。特徴量が大きい物体の位置は周辺との特徴量の差異が大きくなるため、座標情報における物体の位置の誤差を小さくすることができる。一方、特徴量の少ない物体の位置は周辺との特徴量の差異が小さくなるため、座標情報における物体の位置の誤差が大きくなる。空間に存在する特徴量の大きい物体からの相対的な位置を座標情報とすることにより、例えば、特徴量の小さい物体の位置にアンカーを配置する場合においても座標情報における物体の位置の誤差を小さくすることが可能となる。なお、上述した座標情報は、空間をスキャンしたスキャンデータに基づく座標情報であるため、空間に存在する物体からの相対的な位置情報となる。しかし、座標情報には、例えば、電波を発する基準点(ビーコン)からの相対距離から算出される座標情報、測位衛星から取得される電波から算出される経度、緯度および高度からなる絶対的な座標情報等が含まれていてもよい。例えば、2つの算出方法に基づく座標情報を用いることにより、座標情報を二重にチェックすることができるので座標情報の信頼性を向上させることができる。 The anchor information providing unit 14 provides the information processing device 30 with anchor information related to the anchor placed by the anchor placement unit 13. The anchor information related to the anchor includes, for example, coordinate information in space. The coordinate information in space is coordinate information based on scan data obtained by scanning the space, and is, for example, coordinate information indicating a relative position from an object with a large feature value that exists in the space. The feature value of the space is, for example, a distribution (histogram) of color data existing in the space, the shape of the object, or vector data of color data. When recognizing the space, a place with similar feature values can be recognized as the same place. Since the position of an object with a large feature value has a large difference in feature value from the surroundings, the error of the object's position in the coordinate information can be reduced. On the other hand, the position of an object with a small feature value has a small difference in feature value from the surroundings, and therefore the error of the object's position in the coordinate information is large. By using the relative position from an object with a large feature value existing in the space as coordinate information, it is possible to reduce the error of the object's position in the coordinate information, for example, even when placing an anchor at the position of an object with a small feature value. The above-mentioned coordinate information is based on scan data obtained by scanning a space, and is therefore relative position information from an object in the space. However, the coordinate information may also include, for example, coordinate information calculated from the relative distance from a reference point (beacon) that emits radio waves, absolute coordinate information consisting of longitude, latitude, and altitude calculated from radio waves obtained from a positioning satellite, etc. For example, by using coordinate information based on two calculation methods, the coordinate information can be double-checked, thereby improving the reliability of the coordinate information.

なお、本実施形態において、「提供」という場合、プッシュ型の送信であってもプル型の送信であってもよい。また、本実施形態において、「取得」という場合、プル型の受信であってもプッシュ型の受信であってもよい。 In this embodiment, "provision" may refer to either push-type transmission or pull-type transmission. In this embodiment, "acquisition" may refer to either pull-type reception or push-type reception.

コンテンツ設定部15は、情報処理装置30に提供されたアンカー情報に対してコンテンツを配置するコンテンツ配置操作の操作画面(UI)を利用者に提供する。また、コンテンツ設定部15は、コンテンツ配置操作において配置されるコンテンツが開始されるための開始条件を設定する開始条件設定操作の操作画面(UI)を利用者に提供する。利用者は、コンテンツ設定部15から提供されたUIを操作してコンテンツ配置操作をすることができる。なお、本実施形態においては、情報処理端末10のコンテンツ設定部15がコンテンツ配置操作をするためのUIを提供する場合を例示したが、コンテンツ配置操作をするためのUIは、情報処理端末20において提供するようにしてもよい。すなわち、情報処理端末20の利用者がコンテンツを配置できるようにしてもよい。 The content setting unit 15 provides the user with an operation screen (UI) for a content placement operation for placing content in relation to anchor information provided to the information processing device 30. The content setting unit 15 also provides the user with an operation screen (UI) for a start condition setting operation for setting a start condition for starting the content to be placed in the content placement operation. The user can perform content placement operations by operating the UI provided by the content setting unit 15. Note that, in the present embodiment, an example has been given of a case in which the content setting unit 15 of the information processing terminal 10 provides a UI for performing content placement operations, but the UI for performing content placement operations may be provided by the information processing terminal 20. In other words, the user of the information processing terminal 20 may be able to place content.

コンテンツ配置操作とは、アンカー情報に対して実行されるコンテンツ(イベント)を配置する操作であって、例えば、配置されたアンカーに対して、再生するコンテンツを割り当てる操作である。コンテンツの割り当てには、例えば、予め作成されているまたは新たに作成された音源のプレイリストを選択して割り当てる(対応付ける)操作等が含まれる。プレイリストとは、1または複数の音源ファイルを用いて、再生される音源を決めておくことであり、プレイリスト名を付与しておくことにより再生される音源を識別しやすくすることができる。コンテンツ配置操作を利用者に提供することにより、例えば、アンカーに対するコンテンツの割り当てを変更するだけで実行されるコンテンツの内容を変更することが可能となり、コンテンツ配置の操作性を向上させることが可能となる。なお、配置するコンテンツは、上述の通り、画像の再生等のコンテンツの再生、データ通信、またはアクチュエータの動作等であってもよい。コンテンツ配置操作においては、例えば、動物形状のオブジェクトの近傍に配置されたアンカーに対して、オブジェクトを駆動するアクチュエータを動作させるコンテンツを配置してもよい。 The content placement operation is an operation of placing content (event) to be executed for anchor information, for example, an operation of assigning content to be played to a placed anchor. Content allocation includes, for example, an operation of selecting and assigning (associating) a playlist of sound sources that has been created in advance or that has been created newly. A playlist is a process of determining the sound source to be played using one or more sound source files, and by assigning a playlist name, it is possible to easily identify the sound source to be played. By providing the content placement operation to the user, for example, it becomes possible to change the content to be executed simply by changing the content assignment to the anchor, thereby improving the operability of content placement. Note that the content to be placed may be content playback such as image playback, data communication, or actuator operation, as described above. In the content placement operation, for example, content that operates an actuator that drives an animal-shaped object may be placed on an anchor placed near the object.

コンテンツが実行されるための開始条件とは、情報処理端末20等においてコンテンツの提供が実行されるための条件であり、本実施形態においては、情報処理端末20が設置されたアンカーのジオフェンスに入ったか否かを判断するための条件である。ジオフェンスは、例えば、アンカーと情報処理端末20の距離、情報処理端末20のカメラの撮影方向、情報処理端末20の高度(アンカーとの相対的な高度差、または海面を基準とする絶対高度等)、アンカーの表示時間、または情報処理端末20の停止時間等によって設定することができる。また、ジオフェンスには、アンカーと情報処理端末20の距離が近付いているのか、あるいは遠ざかっているのか等の条件が含まれていてもよい。また、ジオフェンスには、複数の情報処理端末20においてアンカーが撮影されていることが含まれていてもよい。また、ジオフェンスには、図示しない加速度センサ等から取得される利用者の挙動が含まれていてもよい。 The start condition for content execution is a condition for content provision to be executed in the information processing terminal 20 or the like, and in this embodiment, is a condition for determining whether the information processing terminal 20 has entered the geofence of the anchor where the information processing terminal 20 is installed. The geofence can be set, for example, by the distance between the anchor and the information processing terminal 20, the shooting direction of the camera of the information processing terminal 20, the altitude of the information processing terminal 20 (relative altitude difference with respect to the anchor, or absolute altitude based on sea level, etc.), the display time of the anchor, or the stop time of the information processing terminal 20. The geofence may also include a condition such as whether the distance between the anchor and the information processing terminal 20 is approaching or receding. The geofence may also include the fact that the anchor is photographed by multiple information processing terminals 20. The geofence may also include the behavior of the user acquired from an acceleration sensor (not shown) or the like.

コンテンツ設定部15は、コンテンツとしての音源の配置に際して、音源の調整をするためのUIを利用者に提供する。音源の調整とは、音源から再生される音の再生態様を空間に応じて調整(設定)することをいう。音源の再生態様とは、例えば、音量、周波数特性、または残響特性である。 The content setting unit 15 provides the user with a UI for adjusting the sound source when placing the sound source as content. Adjusting the sound source means adjusting (setting) the playback mode of the sound played from the sound source according to the space. The playback mode of the sound source is, for example, the volume, frequency characteristics, or reverberation characteristics.

<ラウドネス調整>

空間において音源から発せられて利用者が聴覚する音の大きさ(ラウドネス)は、音源から利用者までの距離、または空間に存在する対象物による音の反射等に影響を受ける。したがって、音源の再生においては適切な音の大きさとなるように音源を調整する必要がある。コンテンツ設定部15は、適切な音の大きさを設定するためのUIを提供する。

<Loudness adjustment>

The loudness of a sound emitted from a sound source in a space and heard by a user is affected by the distance from the sound source to the user, or the reflection of the sound by objects in the space. Therefore, when playing back a sound source, it is necessary to adjust the sound source so that the sound is at an appropriate volume. The content setting unit 15 provides a UI for setting an appropriate sound volume.

<周波数特性調整>

空間において音源から発せられて利用者が聴覚する音の周波数特性は、空間に存在する対象物による音の反射等によって変化する。したがって、より良い表現のためには適切な周波数特性となるように音源を調整することが望ましい。周波数特性調整とは、音源から発せられる音の周波数分布を調整することである。周波数特定調整には、例えば、特定の周波数を境より高い(または低い)音域をまとめて調整するシェルビング型の調整、または特定の周波数を中心としてその付近の音域を調整するピークディップ型の調整が含まれる。コンテンツ設定部15は、適切な周波数特性を設定するためのUIを提供する。

<Frequency characteristic adjustment>

The frequency characteristics of the sound emitted from a sound source in a space and heard by the user change due to the reflection of the sound by objects in the space. Therefore, it is desirable to adjust the sound source to have appropriate frequency characteristics for better expression. Frequency characteristic adjustment is to adjust the frequency distribution of the sound emitted from the sound source. Frequency specific adjustment includes, for example, shelving type adjustment that adjusts the range of sounds higher (or lower) than a specific frequency as a boundary, or peak-dip type adjustment that adjusts the range of sounds around a specific frequency. The content setting unit 15 provides a UI for setting appropriate frequency characteristics.

<残響特性調整>

空間において音源から発せられて利用者が聴覚する音の残響特性は、空間に存在する対象物による音の反射等によって異なる。したがって、音源の再生においては適切な残響特性となるように音源を調整する必要がある。コンテンツ設定部15は、適切な残響特性を設定するためのUIを提供する。なお、残響特性の具体的な調整方法は後述する。

<Reverberation characteristic adjustment>

The reverberation characteristics of a sound emitted from a sound source in a space and heard by a user vary depending on the reflection of the sound by objects present in the space. Therefore, it is necessary to adjust the sound source so that the reverberation characteristics are appropriate when playing the sound source. The content setting unit 15 provides a UI for setting appropriate reverberation characteristics. A specific method for adjusting the reverberation characteristics will be described later.

なお、コンテンツ設定部15は、上記以外の音源の再生態様を設定出来るようにしてもよい。例えば、コンテンツ設定部15は、音源の再生時間、再生速度等を設定出来るようにしてもよい。また、コンテンツがアクチュエータの動作である場合、コンテンツ設定部15は、アクチュエータの動作範囲または動作速度等を設定出来るようにしてもよい。 The content setting unit 15 may be able to set the playback mode of the sound source other than the above. For example, the content setting unit 15 may be able to set the playback time, playback speed, etc. of the sound source. Furthermore, if the content is the operation of an actuator, the content setting unit 15 may be able to set the motion range or motion speed, etc. of the actuator.

また、コンテンツの実行態様には、上述した、アンカーと情報処理端末20の距離、情報処理端末20のカメラの撮影方向、情報処理端末20の高度、アンカーの表示時間、または情報処理端末20の停止時間等によってコンテンツの実行態様が変化するものが含まれていてもよい。再生条件を設定することにより、音源を用いて様々な演出をすることが可能となる。 The content execution mode may also include a mode in which the content execution mode changes depending on the distance between the anchor and the information processing terminal 20, the shooting direction of the camera of the information processing terminal 20, the altitude of the information processing terminal 20, the display time of the anchor, or the stop time of the information processing terminal 20, as described above. By setting the playback conditions, it becomes possible to perform various effects using the sound source.

コンテンツ情報提供部16は、コンテンツ設定部15においてコンテンツの配置操作がされたコンテンツの配置情報と、開始条件設定操作において設定された開始条件とを情報処理装置30に提供する。配置情報と開始条件を情報処理装置30に提供することにより、情報処理装置30においてこれらの情報を記憶しておくことが可能となる。情報処理装置30においてこれらの情報を記憶しておくことにより、記憶された情報を読み出して利用することが可能となる。なお、アンカーの配置またはコンテンツの設定は複数の情報処理端末10において実行されてもよい。複数の情報処理端末10においてアンカーの配置等が実行された場合、一の情報処理端末10におけるアンカーの配置等の実行結果は情報処理装置30に保存されて他の情報処理端末10にも反映される。 The content information providing unit 16 provides the information processing device 30 with content placement information for which the content placement operation has been performed in the content setting unit 15, and the start conditions set in the start condition setting operation. By providing the placement information and start conditions to the information processing device 30, it becomes possible to store this information in the information processing device 30. By storing this information in the information processing device 30, it becomes possible to read and use the stored information. Note that anchor placement or content setting may be performed in multiple information processing terminals 10. When anchor placement or the like is performed in multiple information processing terminals 10, the execution result of anchor placement or the like in one information processing terminal 10 is stored in the information processing device 30 and is reflected in the other information processing terminals 10.

座標情報算出部22は、取得部21において取得された対象物までの距離に基づき対象物の空間における座標情報を算出する。取得部21は、上述のように空間をスキャンして空間に存在する対象物までの距離を取得する。座標情報算出部22は、対象物の表面までの複数の距離から対象物の表面の座標情報を算出することにより、対象物の形状を測定することができる。 The coordinate information calculation unit 22 calculates coordinate information of the object in space based on the distance to the object acquired by the acquisition unit 21. The acquisition unit 21 scans the space as described above to acquire the distance to the object existing in the space. The coordinate information calculation unit 22 can measure the shape of the object by calculating coordinate information of the object's surface from multiple distances to the object's surface.

ここで、座標情報算出部22における座標情報の具体的な算出例を図11~図14を用いて説明する。図11は、取得部11または取得部21において取得された測定空間における点群データを示している。図11は、測定空間が箱形(立方体)である場合を例示している。箱形の測定空間は6つの面において構成される。測定空間における面は、点群データの三次元におけるそれぞれの座標軸において密集点を計算することにより算出することができる。それぞれの座標軸における密集点は、点群データのそれぞれの座標軸における分布を得ることにより算出することができる。 Here, specific examples of calculation of coordinate information in the coordinate information calculation unit 22 will be described with reference to Figs. 11 to 14. Fig. 11 shows point cloud data in a measurement space acquired by the acquisition unit 11 or acquisition unit 21. Fig. 11 illustrates a case where the measurement space is box-shaped (cubic). The box-shaped measurement space is made up of six faces. The faces in the measurement space can be calculated by calculating dense points on each coordinate axis in three dimensions of the point cloud data. The dense points on each coordinate axis can be calculated by obtaining the distribution on each coordinate axis of the point cloud data.

<ヒストグラムの算出>

図12は、図11における点群データのx座標軸におけるヒスとグラムを示している。ヒストグラムは点群データのx軸における分布である。図12において、x軸座標の点群データは、大凡-4.5と3.3においてピークを有している。すなわち、測定空間においてx軸に2つの面が存在していることを示している。

<Histogram calculation>

Fig. 12 shows a histogram of the point cloud data in Fig. 11 on the x-axis. The histogram is the distribution of the point cloud data on the x-axis. In Fig. 12, the point cloud data on the x-axis coordinate has peaks at approximately -4.5 and 3.3. This indicates that there are two planes on the x-axis in the measurement space.

<曲線当てはめの算出>

図13は、図12のヒストグラムの正の値に対して曲線当てはめを行った場合の算出例である。ヒストグラムに対して曲線当てはめを行うことにより、そのピークをその座標軸における壁として算出することができる。図13は、大凡3.3においてピークを有しており、この点がx座標軸における1つの面(壁)であることが算出される。図13においては、曲線当てはめとして平滑化スプラインの手法を用いている。平滑化スプラインとは、ノイズを含んで観測した観測値から、2階微分に基づく平滑度とのバランスを取りながらスプライン曲線を使用して関数を推定する手法である。図13は、3次元スプライン曲線を用いて算出している。なお、図13は、曲線当てはめとして平滑化スプラインの手法を用いたが、例えば、曲線当てはめとしてガウス関数を使用した手法を用いてもよい。

Curve fitting calculations

FIG. 13 is a calculation example in which curve fitting is performed on the positive values of the histogram in FIG. 12. By performing curve fitting on the histogram, the peak can be calculated as a wall on the coordinate axis. FIG. 13 has a peak at approximately 3.3, and it is calculated that this point is one surface (wall) on the x-coordinate axis. In FIG. 13, a smoothing spline method is used for curve fitting. The smoothing spline is a method of estimating a function using a spline curve while balancing the smoothness based on the second derivative from an observed value that includes noise. FIG. 13 is calculated using a three-dimensional spline curve. Note that FIG. 13 uses a smoothing spline method for curve fitting, but for example, a method using a Gaussian function for curve fitting may be used.

座標情報算出部22は、上述した方法により、それぞれの座標軸において2つの面を算出して、6面における箱形の座標情報を算出することができる。座標情報には、座標情報算出部22において算出された測定空間における座標情報に対する、コンテンツの提供を受ける利用者の位置と、後述するアンカー検出部32において検出されたアンカーの位置情報とが含まれていてもよい。図14は、測定空間に対して利用者の位置(Listener)とアンカーの位置(Sound)をプロットしたものを例示している。 The coordinate information calculation unit 22 can calculate two planes on each coordinate axis by the above-mentioned method, and calculate the coordinate information of a box shape on six planes. The coordinate information may include the position of the user receiving the content relative to the coordinate information in the measurement space calculated by the coordinate information calculation unit 22, and the position information of the anchor detected by the anchor detection unit 32 described below. Figure 14 shows an example of a plot of the user's position (Listener) and the anchor's position (Sound) in the measurement space.

なお、図11~図14においては6面で構成される測定空間における座標情報を算出する場合を説明したが、測定空間はいり複雑な形状であってもよい。例えば、測定空間は、部屋の中に柱や梁を有する形状であってもよい。また、測定空間はドーム型天井等、曲面を有するものであってもよい。 Note that although the calculation of coordinate information in a measurement space consisting of six surfaces has been described in Figures 11 to 14, the measurement space may have a more complex shape. For example, the measurement space may have a shape that includes pillars and beams within a room. The measurement space may also have a curved surface, such as a dome-shaped ceiling.

座標情報提供部23は、座標情報算出部22において算出された座標情報を情報処理装置30に対して提供する。後述する情報処理装置30は、座標情報提供部23から提供された対象物の座標情報からアンカーを検出することができる。 The coordinate information providing unit 23 provides the coordinate information calculated by the coordinate information calculating unit 22 to the information processing device 30. The information processing device 30, which will be described later, can detect the anchor from the coordinate information of the object provided by the coordinate information providing unit 23.

コンテンツ実行部24は、ジオフェンスの中に、取得部21を含む情報処理端末20が入ったときに、利用者に対するコンテンツの提供を実行する。コンテンツ実行部24は、例えば、情報処理端末20の図示しないスピーカにおいて音源を再生する。 When the information processing terminal 20 including the acquisition unit 21 enters the geofence, the content execution unit 24 executes the provision of content to the user. For example, the content execution unit 24 plays a sound source on a speaker (not shown) of the information processing terminal 20.

なお、本実施形態では、音源の提供において、OSC(Open Sound Control)のプロトコルを用いるようにしてもよい。コンテンツ実行部24においてOSCのプロトコルを用いることにより、音源の提供をリアルタイムで実行することが可能となる。例えば、音源がライブ音源である場合、OSCのプロトコルを用いることにより、複数の情報処理端末20においてライブ音源をリアルタイムで共有することが可能となる。また、本実施形態では、音源の提供において、立体音響を実現するための音源フォーマット(例えば、Ambisonics)を用いてもよい。コンテンツ実行部24において立体音響を実現するための音源フォーマットを用いることにより、容易に立体音響の音源を提供することが可能となる。また、本実施形態では、音源の提供において、ゲーム開発用のプラットフォーム(例えば、Wwise等)を用いてもよい。コンテンツ実行部24においてゲーム開発用のプラットフォームを用いることにより、ゲームにおけるイベントの提供を容易にすることができる。また、本実施形態では、音源の提供において、頭部伝達関数(HRTF:Head Related Transfer Function)を用いた音源の再生を行ってもよい。頭部伝達関数とは、耳殻、人頭および肩までふくめた周辺物によって生じる音の変化を伝達関数として表現したものである。コンテンツ実行部24において、頭部伝達関数を用いて音源から両耳までの音の変化の特性を数値化することにより、音源の方向感や音源までの距離感を認識することが可能となる。音源の調整においては、調整結果を上述したOSC等として表現することができる。 In this embodiment, the OSC (Open Sound Control) protocol may be used to provide the sound source. By using the OSC protocol in the content execution unit 24, it is possible to provide the sound source in real time. For example, if the sound source is a live sound source, by using the OSC protocol, it is possible to share the live sound source in real time among multiple information processing terminals 20. In addition, in this embodiment, a sound source format (e.g., Ambisonics) for realizing stereophonic sound may be used to provide the sound source. By using a sound source format for realizing stereophonic sound in the content execution unit 24, it is possible to easily provide a stereophonic sound source. In addition, in this embodiment, a platform for game development (e.g., Wwise, etc.) may be used to provide the sound source. By using a platform for game development in the content execution unit 24, it is possible to easily provide events in the game. Furthermore, in this embodiment, when providing a sound source, the sound source may be reproduced using a head related transfer function (HRTF). A head related transfer function is a transfer function that expresses the change in sound caused by surrounding objects including the auricle, the human head, and even the shoulders. In the content execution unit 24, the head related transfer function is used to quantify the characteristics of the change in sound from the sound source to both ears, making it possible to recognize the sense of direction of the sound source and the sense of distance to the sound source. When adjusting the sound source, the adjustment results can be expressed as the above-mentioned OSC, etc.

アンカー情報記憶部31は、アンカー配置部13において配置されたアンカーに係るアンカー情報を読み出し可能に記憶する。アンカー情報には、上述の通り、アンカーの位置情報等を含めることができる。また、アンカー情報記憶部31は、複数のアンカー情報を記憶することができる。アンカー情報記憶部31に記憶された複数のアンカー情報は、アンカー検出部32から読み出されて、空間に配置された複数のアンカーの検出に利用される。なお、アンカー情報記憶部31に記憶されたアンカー情報は、情報処理端末20に提供されてもよい。本実施形態においては、アンカーの検出はアンカー検出部32において行う場合を例示するが、アンカーの検出は情報処理端末20で行うようにしてもよい。 The anchor information storage unit 31 readably stores anchor information related to the anchors placed by the anchor placement unit 13. As described above, the anchor information can include position information of the anchor. The anchor information storage unit 31 can store multiple pieces of anchor information. The multiple pieces of anchor information stored in the anchor information storage unit 31 are read by the anchor detection unit 32 and used to detect multiple anchors placed in space. The anchor information stored in the anchor information storage unit 31 may be provided to the information processing terminal 20. In this embodiment, the anchor detection is performed by the anchor detection unit 32, but the anchor detection may be performed by the information processing terminal 20.

アンカー検出部32は、座標情報提供部23から提供された座標情報と、アンカー情報記憶部31に記憶されて予め空間に仮想的に配置されたアンカーの位置情報とに基づき、空間に仮想的に配置されたアンカーを検出する。ここで、座標情報および位置情報は、空間において3次元または2次元で表される点の座標である。また、座標情報および位置情報は、上述した空間の特徴量であってもよい。空間の特徴量は、空間に存在する色データの分布(ヒストグラム)、物体の形状または色データのベクトルデータ等である。アンカー検出部32は、空間のスキャンデータに基づき空間に仮想的に配置されたアンカーを検出することができるため、測位衛星による測位が困難な状況においても空間に配置されたアンカーを検出することができる。これにより、空間に配置されたコンテンツの提供条件の精度を向上させるとともに、3次元で設定されるジオフェンスを用いたコンテンツの提供が可能となる。 The anchor detection unit 32 detects an anchor virtually placed in space based on the coordinate information provided by the coordinate information providing unit 23 and the position information of the anchor stored in the anchor information storage unit 31 and virtually placed in space in advance. Here, the coordinate information and the position information are coordinates of a point expressed in three dimensions or two dimensions in space. The coordinate information and the position information may be the above-mentioned feature amount of space. The feature amount of space is a distribution (histogram) of color data existing in the space, the shape of an object, or vector data of color data, etc. The anchor detection unit 32 can detect an anchor virtually placed in space based on the scan data of the space, and therefore can detect an anchor placed in space even in a situation where positioning by a positioning satellite is difficult. This improves the accuracy of the provision conditions of the content placed in the space and makes it possible to provide content using a geofence set in three dimensions.

<座標距離によるアンカーの検出>

例えば、アンカー検出部32は、アンカー情報記憶部31に記憶されたアンカーの位置情報と座標情報提供部23から提供された座標情報とを比較して、座標情報に含まれる1点と位置情報とが予め定められた距離以内であるか否かでアンカーを検出するようにしてもよい。

<Anchor detection by coordinate distance>

For example, the anchor detection unit 32 may compare the position information of the anchor stored in the anchor information storage unit 31 with the coordinate information provided by the coordinate information providing unit 23, and detect the anchor based on whether a point included in the coordinate information and the position information are within a predetermined distance.

<特徴量によるアンカーの検出>

また、アンカー検出部32は、座標情報提供部23から提供された座標情報から特徴量を算出し、アンカー情報記憶部31に記憶されたアンカー配置時における特徴量と近似するか否かでアンカーを検出するようにしてもよい。

<Detecting anchors using features>

In addition, the anchor detection unit 32 may calculate features from the coordinate information provided by the coordinate information provision unit 23, and detect an anchor based on whether or not the features are similar to the features stored in the anchor information storage unit 31 at the time the anchor was placed.

アンカー検出部32は、アンカー情報記憶部31に記憶された複数のアンカー情報を逐次参照してアンカーを検出するようにしてもよい。アンカー検出部32が複数のアンカー情報を参照することにより、配置するアンカーの追加または削除を容易にすることができる。 The anchor detection unit 32 may detect anchors by sequentially referring to multiple pieces of anchor information stored in the anchor information storage unit 31. By the anchor detection unit 32 referring to multiple pieces of anchor information, it is possible to easily add or delete anchors to be placed.

また、アンカー検出部32は、予め想定されるアンカーの検出順序に基づいてアンカーを検出するようにしてもよい。例えば、アンカーAの次にアンカーBの検出が予想される場合、アンカー検出部32は、アンカーAを検出した後に、アンカーBの検出を優先的に行うことにより、アンカー検出の負荷を軽減し、検出時間の短縮を図ることができる。 The anchor detection unit 32 may also detect anchors based on a pre-estimated order of anchor detection. For example, if anchor B is expected to be detected after anchor A, the anchor detection unit 32 may detect anchor A and then preferentially detect anchor B, thereby reducing the load of anchor detection and shortening the detection time.

また、アンカー検出部32は、1人の利用者において既に検出されたアンカーであって、当該アンカーに対応したコンテンツが既に提供されている場合、既に検出されたアンカーを検出対象から外すようにしてもよい。既に検出されたアンカーを検出対象から外すことにより、アンカーに対応付けられたコンテンツの重複提供の防止することが可能となる。 In addition, when an anchor has already been detected for one user and content corresponding to that anchor has already been provided, the anchor detection unit 32 may exclude the already detected anchor from the detection target. By excluding the already detected anchor from the detection target, it is possible to prevent duplicate provision of content associated with the anchor.

また、アンカー検出部32は、1つのアンカーが1人の利用者または異なる利用者によって複数回検出された場合、検出回数を計数するようにしてもよい。検出回数を計数することにより、検出回数に応じて提供されるコンテンツを替えることが可能となる。なお、コンテンツの提供は、後述するコンテンツ制御部36において制御することができる。 The anchor detection unit 32 may also count the number of detections when one anchor is detected multiple times by one user or by different users. Counting the number of detections makes it possible to change the content provided depending on the number of detections. The provision of content can be controlled by the content control unit 36, which will be described later.

また、アンカー検出部32は、図示しないGNSS(Global Navigation Satellite System)センサまたは加速度センサから取得された計測値にさらに基づきアンカーを検出するようにしてもよい。これらのセンサの計測値との組合せでアンカーを検出することにより、アンカーの検出精度を向上させることができる。例えば、屋外においては、GNSSセンサにおいて正確な現在位置を測位することが出来る場合がある。また、加速度センサを用いることにより、情報処理端末20の移動を記録して、移動前との比較によって正確な現在位置を検出することが出来る場合がある。 The anchor detection unit 32 may also detect the anchor based on measurement values acquired from a Global Navigation Satellite System (GNSS) sensor or an acceleration sensor (not shown). By detecting the anchor in combination with the measurement values of these sensors, the detection accuracy of the anchor can be improved. For example, outdoors, the GNSS sensor may be able to accurately determine the current position. Furthermore, by using an acceleration sensor, it may be possible to record the movement of the information processing terminal 20 and detect the current position accurately by comparing it with the position before the movement.

音響特性記憶部33は、空間に存在する対象物の表面に係る音響特性を予め記憶する。対象物の表面に係る音響特性とは、音源から発せられた音が対象物の表面で反射するときの音響特性(反射特性という場合がある)である。音響特性記憶部33において記憶される音響特性とは、例えば、音の反射率(吸音率または減衰率ともいう場合がある)である。例えば、金属等の硬い材料の表面においては材料の内部に透過する音が小さいため反射率が高く、多孔質等の材料の表面においては内部に透過する音が大きいため反射率が低い。また、音響特性記憶部33において記憶される音響特性には、対象物の表面形状が含まれていてもよい。凹凸のある表面形状においては反射した音同士が干渉して特定の周波数の反射特性が変化する場合がある。また、音響特性記憶部33において記憶される音響特性には、周波数毎の音響特性が含まれていてもよい。対象物表面における音の反射率は、音の周波数ごとに異なる。例えば、周波数が高い音は多孔質の材料において反射率が低く、周波数が低い音は反射率が高い。音響特性記憶部33において、空間に存在する対象物の表面に係る音響特性を予め記憶しておくことにより、音源から発せられた音が対象物の表面において反射して利用者の位置に届くまでの音の変化を算出することが可能となる。 The acoustic characteristic storage unit 33 stores in advance the acoustic characteristics related to the surface of an object existing in a space. The acoustic characteristics related to the surface of an object are the acoustic characteristics (sometimes called reflection characteristics) when a sound emitted from a sound source is reflected on the surface of the object. The acoustic characteristics stored in the acoustic characteristic storage unit 33 are, for example, the reflectance of sound (sometimes called sound absorption rate or attenuation rate). For example, the reflectance is high on the surface of a hard material such as metal because the sound that penetrates the inside of the material is small, and the reflectance is low on the surface of a material such as porous material because the sound that penetrates the inside is large. The acoustic characteristics stored in the acoustic characteristic storage unit 33 may also include the surface shape of the object. In a surface shape with irregularities, the reflected sounds may interfere with each other, causing the reflection characteristics of a specific frequency to change. The acoustic characteristics stored in the acoustic characteristic storage unit 33 may also include acoustic characteristics for each frequency. The reflectance of sound on the surface of an object differs for each frequency of sound. For example, a porous material has a low reflectance for a high-frequency sound, and a high reflectance for a low-frequency sound. By storing in advance in the acoustic characteristics storage unit 33 the acoustic characteristics related to the surface of an object present in space, it is possible to calculate the changes in sound that occur when sound is emitted from a sound source, reflected by the surface of the object, and reaches the user's position.

残響特性算出部34は、座標情報算出部22において算出された座標情報に基づき、空間における残響特性を算出する。残響特性とは、音源から発せられて、空間に存在する対象物の表面において反射して時間差をもって利用者に到達する音の特性である。残響特性算出部34において算出される残響特性を以下に例示する。なお、以下に示す残響特性は、一定の音量から所定時刻に音量が0に変化するインパルス音源に対して利用者の位置において聴覚することができる音の変化(インパルス応答)を例示するが、残響特性算出部34において算出される残響特性はこれに限定されるものではない。 The reverberation characteristic calculation unit 34 calculates the reverberation characteristics in the space based on the coordinate information calculated by the coordinate information calculation unit 22. The reverberation characteristics are characteristics of a sound that is emitted from a sound source, reflected on the surface of an object in the space, and reaches the user with a time difference. The reverberation characteristics calculated by the reverberation characteristic calculation unit 34 are exemplified below. Note that the reverberation characteristics shown below are examples of changes in sound that can be heard at the user's position in response to an impulse sound source whose volume changes from a constant volume to zero at a specified time (impulse response), but the reverberation characteristics calculated by the reverberation characteristic calculation unit 34 are not limited to this.

<残響時間>

残響時間とは、空間における音の響きの長さを示す特性である。残響時間とは、音源を再生して空間に音を放射させ、音量が定常状態に達した後音源を停止させ(インパルス音源)、観測地点(利用者の位置)において音の強さが60dB減衰するまでの時間(インパルス応答)である。残響時間は次式により算出することができる。

<Reverberation time>

Reverberation time is a characteristic that indicates the length of time that sound reverberates in a space. Reverberation time is the time (impulse response) until the intensity of the sound at the observation point (user's position) attenuates by 60 dB after a sound source is played and emitted into the space and the sound source is stopped after the volume reaches a steady state (impulse sound source). Reverberation time can be calculated using the following formula:

<初期残響時間>

初期残響時間とは、残響減衰の初期の10dB部分の減衰傾斜から求めた残響時間である。初期残響時間は、人間が感じる残響感を表す特性である。初期残響時間に用いる減衰波形は残響時間と同様である。

<Early reverberation time>

The initial reverberation time is the reverberation time calculated from the attenuation slope of the initial 10 dB part of the reverberation decay. The initial reverberation time is a characteristic that represents the sense of reverberation felt by humans. The decay waveform used for the initial reverberation time is the same as the reverberation time.

<時間重心>

次式によって表される特性である。

<Time center of gravity>

This characteristic is expressed by the following formula.

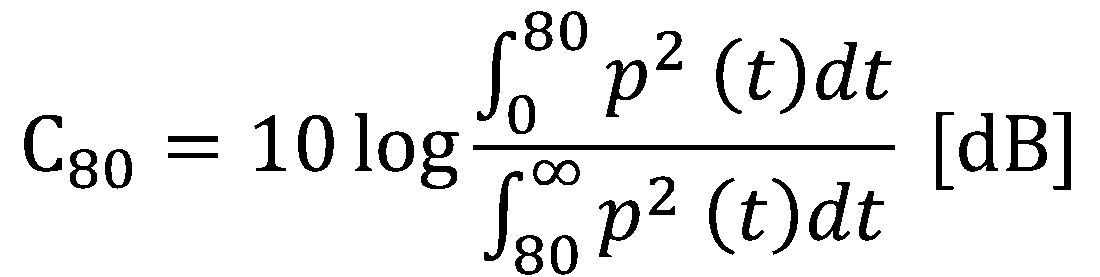

<Clarity>

ここで、図7を用いて、Clarityの算出方法を説明する。図7は、実施形態における、(A)インパルス音源、(B)インパルス音源による音の減衰、および(C)インパルス応答の一例を説明する図である。

<Clarity>

Here, a method for calculating Clarity will be described with reference to Fig. 7. Fig. 7 is a diagram illustrating an example of (A) an impulse sound source, (B) sound attenuation by the impulse sound source, and (C) an impulse response in an embodiment.

図7(A)において、x軸は時間の経過(t)、およびy軸は音源における音圧(p)を表す。インパルス音源は、定常状態の音圧p1から時刻t0において音圧0(再生停止)に変化する。図7(B)において、y軸は利用者の位置(測定位置)における音圧(E)を表す。音圧Eは時刻t0から測定が開始される。音圧Eは時間の経過とともに減衰していく。 In Figure 7 (A), the x-axis represents the passage of time (t), and the y-axis represents the sound pressure (p) at the sound source. The impulse sound source changes from a steady-state sound pressure p1 to a sound pressure of 0 (playback stopped) at time t0. In Figure 7 (B), the y-axis represents the sound pressure (E) at the user's position (measurement position). Measurement of sound pressure E begins at time t0. Sound pressure E decays over time.

図7(C)において、y軸は、次式において算出される、音源から直接測定位置に到達する直接音と、対象物において反射してから測定位置に到達する残響音との比(対数)であり、C80と呼ばれる特性である。 In FIG. 7(C), the y-axis is the ratio (logarithm) of the direct sound that reaches the measurement position directly from the sound source to the reverberant sound that reaches the measurement position after reflecting off the target object, calculated using the following formula, and is a characteristic called C80.

<直接音全エネルギー比>

直接音全エネルギー比は、次式において算出される、直接音と全体(直接音+残響音)のエネルギー比である。直接音全エネルギー比は、主に人の声における明瞭度として用いられる。

<Direct sound total energy ratio>

The direct sound total energy ratio is the energy ratio of the direct sound to the whole sound (direct sound + reverberation sound) calculated by the following formula. The direct sound total energy ratio is mainly used as an indicator of the clarity of the human voice.

なお、上述した残響特性は、音源が再生される空間において実測されたものであってもよく、空間における座標情報が類似している他の空間における残響特性を記憶しておき、対象物の空間における形状と音響特性記憶部33に記憶された音響特性から類推して算出するようにしてもよい。例えば、空間の種類(例えば、コンサートホール、教会、コンクリートに囲まれた部屋、廊下等)における残響特性を予め記憶しておき、座標情報算出部で算出された座標情報に基づき記憶された残響特性を修正することにより、空間における残響特性を算出するようにしてもよい。 The above-mentioned reverberation characteristics may be measured in the space in which the sound source is reproduced, or may be calculated by storing the reverberation characteristics in other spaces with similar coordinate information in the space and inferring them from the shape of the object in the space and the acoustic characteristics stored in the acoustic characteristics storage unit 33. For example, the reverberation characteristics for a type of space (e.g., a concert hall, a church, a room surrounded by concrete, a corridor, etc.) may be stored in advance, and the reverberation characteristics in the space may be calculated by modifying the stored reverberation characteristics based on the coordinate information calculated by the coordinate information calculation unit.

次に、残響特性算出部34における残響特性算出の一例を説明する。残響特性の算出算出は、例えば、Allen and BerkleyによるMirror image method(以下、「MI法」と省略する場合がある)を用いることができる。MI法においては、以下のパラメータが用いられる。

音速[m/s]

サンプリングレート[Hz]

アンカー位置の座標(x,y,z)[m]

利用者位置の座標(x,y,z)[m]

部屋の寸法(x,y,z)[m]

部屋の残響時間[m]、もしくは各壁における反射係数

Next, an example of the calculation of reverberation characteristics in the reverberation characteristics calculation unit 34 will be described. The calculation of reverberation characteristics can be performed, for example, using the Mirror Image Method by Allen and Berkley (hereinafter, sometimes abbreviated as the "MI method"). In the MI method, the following parameters are used.

Speed of sound [m/s]

Sampling rate [Hz]

Anchor position coordinates (x, y, z) [m]

User position coordinates (x, y, z) [m]

Room dimensions (x, y, z) [m]

Reverberation time of the room [m] or reflection coefficient at each wall

ここで、音速は計測した部屋の温度によって算出することができる。

音速=331.5+0.6t[m/s](t:摂氏、1気圧)

また、サンプリングレートは実際のデバイス内で使用されているサンプリングレートを使用する。

また、アンカー位置、利用者位置、および部屋の寸法は、上述した方法において算出される。

Here, the speed of sound can be calculated based on the temperature of the room in which the measurement is performed.

Speed of sound = 331.5 + 0.6 t [m/s] (t: Celsius, 1 atm)

The sampling rate used is the one actually used in the device.

Additionally, the anchor location, user location, and room dimensions are calculated in the manner described above.

部屋の残響時間[m]、もしくは各壁における反射係数は、ある一点のアンカー位置、利用者位置から算出された残響時間から算出することができる。残響時間の算出は、インパルス応答の計測と、計測されたインパルス応答に基づく残響時間の算出によって行うことができる。 The reverberation time of a room [m] or the reflection coefficient of each wall can be calculated from the reverberation time calculated from a single anchor position or user position. The reverberation time can be calculated by measuring the impulse response and calculating the reverberation time based on the measured impulse response.

<インパルス応答の計測>

座標情報の算出により形状を推定した部屋内(測定空間)でインパルス応答の計測を行う。 インパルス応答の測定は、上述したインパルス応答を測定するものであり、具体的にはTSP(Time Stretched Pulse)信号を使った測定、ピンクノイズを用いた測定、バルーンを用いた測定、または手拍子を用いた測定等で行うことができる。

<Impulse response measurement>

The impulse response is measured in a room (measurement space) whose shape has been estimated by calculating coordinate information. The impulse response is measured as described above, and specifically, it can be measured using a TSP (Time Stretched Pulse) signal, pink noise, a balloon, or clapping.

<残響時間の算出>

インパルス応答の計測において得られたインパルス応答から、残響時間を算出する。 残響時間の算出には、例えば、ISO3382-2:2008において規定された算出方法を用いることができる。

<Calculating reverberation time>

The reverberation time is calculated from the impulse response obtained in the measurement of the impulse response. For example, the calculation method specified in ISO3382-2:2008 can be used to calculate the reverberation time.

残響特性算出部34は、上述の方法によって得られたパラメータに基づきMI法において残響特性を算出する。なお、残響特性算出部34は、MI法以外の方法において残響特性を算出するようにしてもよい。例えば、残響特性算出部34は、取得部21によって得られるセンサ情報も用いて、各壁の材質をディープラーニングによる画像認識技術を用いて推定し、その材質などの情報を用いて反射係数を計算するようにしてもよい。建築材料はその形状等の外見によって材質等が特定できる場合がある。残響特性算出部34は、センサ情報と反射係数との対応をディープラーニングにより学習することにより、残響特性を推測することができる。 The reverberation characteristics calculation unit 34 calculates the reverberation characteristics using the MI method based on the parameters obtained by the above-mentioned method. The reverberation characteristics calculation unit 34 may calculate the reverberation characteristics using a method other than the MI method. For example, the reverberation characteristics calculation unit 34 may also use the sensor information obtained by the acquisition unit 21 to estimate the material of each wall using image recognition technology based on deep learning, and calculate the reflection coefficient using information such as the material. In some cases, the material of a building material can be identified by its appearance such as its shape. The reverberation characteristics calculation unit 34 can estimate the reverberation characteristics by learning the correspondence between the sensor information and the reflection coefficient using deep learning.

音源調整部35は、残響特性算出部34において算出部された残響特性に基づき、音源を調整する。音源の調整とは、上述の通り、音量調整、周波数特性調整、または残響特性調整等である。音源調整部35は、音源を調整することにより、音源が再生される空間の形状等により異なる残響特性等に応じて、提供する音源を容易に調整することが可能となる。なお、音源調整部35による音源の調整は、実行するか否か(有効化/無効化)の設定をできるようにしてもよい。例えば、音源調整部35は、有効化の設定がされている場合は、残響特性が算出されたときに自動的に音源を調整し、一方、無効化の設定がされている場合は手動で音源の調整を実行できるようにしてもよい。 The sound source adjustment unit 35 adjusts the sound source based on the reverberation characteristics calculated by the reverberation characteristics calculation unit 34. As described above, sound source adjustment includes volume adjustment, frequency characteristic adjustment, reverberation characteristic adjustment, and the like. By adjusting the sound source, the sound source adjustment unit 35 can easily adjust the sound source to be provided according to the reverberation characteristics that differ depending on the shape of the space in which the sound source is reproduced. Note that the sound source adjustment by the sound source adjustment unit 35 may be set to be performed or not (enabled/disabled). For example, when the sound source adjustment unit 35 is set to be enabled, it may automatically adjust the sound source when the reverberation characteristics are calculated, while when the sound source adjustment unit 35 is set to be disabled, it may be possible to manually adjust the sound source.

音源を調整することにより、例えば、コンテンツを提供する提供者が意図した残響感または音量において音源を再生することが可能となる。また、音源を調整することにより、例えば、イベントホールにおける音源の再生において、あたかも教会にいると思わせる残響感を利用者に与えることができる。 By adjusting the sound source, for example, it is possible to play the sound source with the reverberation or volume intended by the content provider. Also, by adjusting the sound source, for example, when playing a sound source in an event hall, it is possible to give the user a reverberation feeling that makes them feel as if they are in a church.

コンテンツ制御部36は、配置情報または開始条件に従い、開始条件が満たされたときにコンテンツの提供を制御する。コンテンツ制御部36は、予め設定された開始条件に応じて、予め定められたコンテンツの実行態様においてコンテンツの提供を制御するようにしてもよい。例えば、コンテンツ制御部36は、情報処理端末20の識別情報(予め登録されている利用者の性別、年齢、使用言語、国籍もしくは宗教等の属性情報、または情報処理端末20から取得される機器情報等)に応じて音源の再生態様等のコンテンツの実行態様を変更してコンテンツを提供するようにしてもよい。識別情報は、例えば利用者のアカウント情報に紐付けられて取得されてもよい。コンテンツ実行部24は、識別情報に応じて変更されたコンテンツを実行することにより、多様なコンテンツを実行することが可能となる。 The content control unit 36 controls the provision of content when the start condition is satisfied according to the placement information or the start condition. The content control unit 36 may control the provision of content in a predetermined content execution mode according to a preset start condition. For example, the content control unit 36 may provide content by changing the content execution mode, such as the sound source playback mode, according to the identification information of the information processing terminal 20 (pre-registered attribute information of the user such as gender, age, language used, nationality, or religion, or device information acquired from the information processing terminal 20). The identification information may be acquired, for example, linked to the user's account information. The content execution unit 24 is able to execute a variety of content by executing the content changed according to the identification information.

コンテンツ実行装置40は、利用者に対してコンテンツを提供する情報処理端末20とは異なる装置であって、例えば、音源の再生、またはアクチュエータの動作等を行う装置である。コンテンツ実行部41は、コンテンツ制御部36からの指示により、コンテンツの実行を制御する。コンテンツ実行部41は、例えば、コンテンツ実行部24と連携してコンテンツの提供を制御するものであってもよい。 The content execution device 40 is a device different from the information processing terminal 20 that provides content to a user, and is, for example, a device that plays a sound source or operates an actuator. The content execution unit 41 controls the execution of content according to instructions from the content control unit 36. The content execution unit 41 may, for example, cooperate with the content execution unit 24 to control the provision of content.

なお、情報処理システム1が有する上述した各機能部は、機能の一例を示したものであり、情報処理システム1が有する機能を限定したものではない。例えば、情報処理端末10,情報処理端末20または情報処理装置30は、上記全ての機能部を有している必要はなく、一部の機能部を有するものであってもよい。また、情報処理システム1は、上記以外の他の機能を有していてもよい。 Note that the above-mentioned functional units possessed by the information processing system 1 are merely examples of functions, and do not limit the functions possessed by the information processing system 1. For example, the information processing terminal 10, the information processing terminal 20, or the information processing device 30 do not need to have all of the above-mentioned functional units, and may have only some of the functional units. Furthermore, the information processing system 1 may have other functions in addition to those described above.

例えば、情報処理端末10が有する機能部は、情報処理装置30において実現されてもよい。同様に、情報処理端末20が有する機能部は、情報処理装置30において実現されてもよい。また、情報処理装置30が有する機能部は、情報処理端末10または情報処理端末20において実現されてもよい。例えば、アンカー検出部32の機能は、情報処理端末20において実現されるものであってもよい。 For example, the functional units of the information processing terminal 10 may be realized in the information processing device 30. Similarly, the functional units of the information processing terminal 20 may be realized in the information processing device 30. Furthermore, the functional units of the information processing device 30 may be realized in the information processing terminal 10 or the information processing terminal 20. For example, the function of the anchor detection unit 32 may be realized in the information processing terminal 20.

また、上記各機能部は、上述の通り、ソフトウェアによって実現されるものとして説明した。しかし上記機能部の中で少なくとも1つ以上の機能部は、ハードウェアによって実現されるものであってもよい。 As mentioned above, each of the above functional units has been described as being realized by software. However, at least one of the above functional units may be realized by hardware.

また、上記何れかの機能部は、1つの機能部を複数の機能部に分割して実施してもよい。また、上記何れか2つ以上の機能部を1つの機能部に集約して実施してもよい。図1は、情報処理システム1が有する機能を機能ブロックで表現したものであり、例えば、各機能部がそれぞれ別個のプログラムファイル等で構成されていることを示すものではない。 Furthermore, any of the above functional units may be implemented by dividing one functional unit into multiple functional units. Furthermore, any two or more of the above functional units may be implemented by consolidating them into one functional unit. FIG. 1 shows the functions of information processing system 1 as functional blocks, and does not indicate, for example, that each functional unit is composed of a separate program file, etc.

また、情報処理端末10,情報処理端末20または情報処理装置30は、1つの筐体によって実現される装置であっても、ネットワーク等を介して接続された複数の装置から実現されるシステムであってもよい。例えば、情報処理端末10,情報処理端末20または情報処理装置30は、その機能の一部または全部をクラウドコンピューティングシステムによって提供されるクラウドサービス等、他の仮想的な装置によって実現するものであってもよい。すなわち、情報処理端末10,情報処理端末20または情報処理装置30は、上記各機能部のうち、少なくとも1以上の機能部を他の装置において実現するようにしてもよい。 In addition, the information processing terminal 10, the information processing terminal 20, or the information processing device 30 may be a device realized by a single housing, or a system realized by multiple devices connected via a network or the like. For example, the information processing terminal 10, the information processing terminal 20, or the information processing device 30 may realize some or all of its functions by other virtual devices, such as a cloud service provided by a cloud computing system. In other words, the information processing terminal 10, the information processing terminal 20, or the information processing device 30 may realize at least one or more of the above-mentioned functional units in other devices.

次に、図2~図5を用いて、アンカーの設置方法を説明する。図2~図5は、実施形態におけるアンカーの設置方法を説明する図である。 Next, a method for installing an anchor will be described with reference to Figures 2 to 5. Figures 2 to 5 are diagrams for explaining a method for installing an anchor in an embodiment.

図2において、表示画面1000は、表示部12において表示される。表示画面1000は、アンカー設定画面を示すアイコン1001、アンカー設置ボタン1002、退出ボタン1003、セーブボタン1004、プレイリストに名前を付ける命名ボタン1005を有する。 In FIG. 2, a display screen 1000 is displayed on the display unit 12. The display screen 1000 has an icon 1001 indicating an anchor setting screen, an anchor installation button 1002, an exit button 1003, a save button 1004, and a naming button 1005 for naming the playlist.

表示画面1000は、情報処理端末10に表示される表示画面であり、情報処理端末10のカメラで撮影された撮影画像が表示されている。アンカー設置ボタン1002は、表示画面1000で表示されている撮影範囲のいずれかにアンカーを設置するためのボタンである。例えば、アンカー設置ボタン1002を操作することにより、表示画面1000の中心位置、あるいは表示画面1000の中で図示しないカーソル位置等にアンカーを設置することができる。利用者は、アンカー設置ボタン1002を操作することにより、図3で説明するアンカーを配置のための画面に遷移させることができる。 Display screen 1000 is a display screen displayed on information processing terminal 10, and displays an image captured by the camera of information processing terminal 10. Anchor installation button 1002 is a button for installing an anchor anywhere in the shooting range displayed on display screen 1000. For example, by operating anchor installation button 1002, an anchor can be installed at the center position of display screen 1000, or at a cursor position (not shown) within display screen 1000. By operating anchor installation button 1002, a user can transition to a screen for placing an anchor, which is described in FIG. 3.

退出ボタン1003は、表示画面1000で示す設定を終了するボタンであり、セーブボタン1004は、現在の設定を保存するボタンである。また、命名ボタン1005は、プレイリストに名前を付けるためのボタンである。利用者は、命名ボタン1005を操作することにより、テキストボックス等から名前を入力することが可能となる。 The exit button 1003 is a button for ending the settings shown on the display screen 1000, and the save button 1004 is a button for saving the current settings. The name button 1005 is a button for naming the playlist. By operating the name button 1005, the user can input a name in a text box or the like.

図3において、表示画面2000は、表示部12において表示される。表示画面2000は、試し置ボタン2001を有する。表示画面2000は、表示画面1000に表示されている撮影範囲を移動させて、拡大した撮影画像である。試し置ボタン2001は、アンカーを試し置きするためのボタンである。利用者は、試し置ボタン2001を操作することにより、表示画面2000の略中央にアンカーを設置することができる。なお、試し置とは、設置位置を確定する前のアンカーの設置を意味し、利用者は、自身で設置したアンカーとアンカーに設定した音源を試行的に体験することができる。 In FIG. 3, display screen 2000 is displayed on display unit 12. Display screen 2000 has a trial placement button 2001. Display screen 2000 is a captured image that is enlarged by moving the shooting range displayed on display screen 1000. Trial placement button 2001 is a button for trial placement of an anchor. By operating trial placement button 2001, a user can place an anchor approximately in the center of display screen 2000. Note that trial placement refers to placement of an anchor before the placement position is confirmed, and a user can trial experience the anchor that he or she placed and the sound source set to the anchor.

図4は、実施形態における情報処理端末において用いられる表示装置の第3の表示例を示す図である。 Figure 4 shows a third display example of a display device used in an information processing terminal in an embodiment.

図4において、表示画面1000は、表示部12において表示される。表示画面3000は、アンカー位置修正ボタン3001、アンカー位置決定ボタン3002およびアンカー3003を有する。アンカー位置修正ボタン3001は、試し置ボタン2001で設置したアンカー3003の位置を修正するためボタンである。利用者は、アンカー位置修正ボタン3001を操作することにより、設置されたアンカー3003の位置を、奥側または手前側に修正することができる。アンカー3003の位置を奥側に修正した場合、アンカー3003の大きさが小さくなって表示され、一方、アンカー3003の位置を手前側に修正した場合、アンカー3003の大きさが大きくなって表示される。なお、アンカー3003の表示サイズは図示しない設定操作によって変更できるようにしてもよい。 In FIG. 4, the display screen 1000 is displayed on the display unit 12. The display screen 3000 has an anchor position correction button 3001, an anchor position determination button 3002, and an anchor 3003. The anchor position correction button 3001 is a button for correcting the position of the anchor 3003 set by the trial placement button 2001. By operating the anchor position correction button 3001, the user can correct the position of the set anchor 3003 to the rear or front side. When the position of the anchor 3003 is corrected to the rear side, the size of the anchor 3003 is displayed smaller, whereas when the position of the anchor 3003 is corrected to the front side, the size of the anchor 3003 is displayed larger. The display size of the anchor 3003 may be changed by a setting operation not shown.

アンカー位置決定ボタン3002は、アンカー3003の設置位置を決定するためのボタンである。利用者は、アンカー位置決定ボタン3002を操作することにより、図5で説明するアンカーの設置を終了するための画面に遷移させることができる。 The anchor position determination button 3002 is a button for determining the installation position of the anchor 3003. By operating the anchor position determination button 3002, the user can transition to a screen for completing the installation of the anchor, which is described in FIG. 5.

図5において、表示画面1000は、表示部12において表示される。表示画面4000は、終了ボタン4001およびアンカー4002を有する。利用者は、終了ボタン4001を操作することにより、アンカーの設置を終了する。 In FIG. 5, the display screen 1000 is displayed on the display unit 12. The display screen 4000 has an end button 4001 and an anchor 4002. The user ends the installation of the anchor by operating the end button 4001.

次に、図6を用いて、空間における音の反射を説明する。図6は、実施形態における空間における音の反射の一例を説明する図である。 Next, the reflection of sound in a space will be explained using FIG. 6. FIG. 6 is a diagram illustrating an example of the reflection of sound in a space in an embodiment.

図6において、音源は部屋Rの内部においてアンカー位置Oに配置されているものとする。アンカー位置Oは、は上述した手順において設置したアンカーの空間における位置である。情報処理端末20の取得部21は、空間をスキャンして空間に存在する対象物までの距離を取得する。利用者位置Sは利用者が音源を聴覚する位置であり、アンカー位置Oにおけるジオフェンスの内部である。 In FIG. 6, the sound source is assumed to be located at anchor position O inside room R. Anchor position O is the position in space of the anchor installed in the above-mentioned procedure. The acquisition unit 21 of the information processing terminal 20 scans the space to acquire the distance to an object existing in the space. User position S is the position where the user hears the sound source, and is inside the geofence at anchor position O.

アンカー位置Oの音源から発せられた音は、利用者位置Sに直接到達する直接音と、部屋Rの壁面に反射して利用者位置Sに到達する反射音(残響音)とに別れる。図6においては反射点Fにおいて1回反射して利用者位置Sに到達する残響音を例示しているが、残響音の到達経路は音源からの音の拡散方向に応じて複数存在する。 The sound emitted from the sound source at anchor position O is divided into direct sound that reaches the user position S directly and reflected sound (reverberant sound) that reaches the user position S after reflecting off the walls of room R. Figure 6 shows an example of reverberant sound that reaches the user position S after reflecting once at reflection point F, but there are multiple paths that reverberant sound can take depending on the direction in which the sound diffuses from the sound source.

直接音は、L1の距離において利用者位置Sに到達する。一方、残響音は、L2+L3の距離において利用者位置Sに到達する。したがって、利用者位置Sに到達するまでの時間差は、到達するまでの距離に応じて変化する。また、利用者位置Sに到達する残響音は、部屋Rの内側の音響特性に応じて変化する。アンカー位置Oにおいてパルス音源を再生させて利用者位置Sにおいて音の変化(音圧等)をアコースティックアナライザ等により測定することにより、部屋Rにおける残響特性を測定することができる。なお、残響特性の測定においては、人型ダミーの耳の位置にマイクを配置したダミーヘッドを用いることができる。ダミーヘッドを用いることにより、例えば、測定空間において人間が知覚する音響特性を測定することができる。 Direct sound reaches user position S at a distance of L1. On the other hand, reverberant sound reaches user position S at a distance of L2 + L3. Therefore, the time difference until the sound reaches user position S changes depending on the distance. Also, the reverberant sound that reaches user position S changes depending on the acoustic characteristics inside room R. By playing a pulse sound source at anchor position O and measuring the change in sound (sound pressure, etc.) at user position S using an acoustic analyzer or the like, the reverberation characteristics in room R can be measured. Note that a dummy head with microphones placed at the ear positions of a human dummy can be used to measure the reverberation characteristics. By using a dummy head, for example, the acoustic characteristics perceived by humans in the measurement space can be measured.

次に、図8を用いて、情報処理端末10のハードウェア構成を説明する。図8は、実施形態における情報処理端末10のハードウェア構成の一例を示すブロック図である。なお、情報処理端末20および情報処理装置30のハードウェア構成は、情報処理端末10に準ずるものとして、説明を省略する。 Next, the hardware configuration of the information processing terminal 10 will be described with reference to FIG. 8. FIG. 8 is a block diagram showing an example of the hardware configuration of the information processing terminal 10 in an embodiment. Note that the hardware configurations of the information processing terminal 20 and the information processing device 30 are similar to that of the information processing terminal 10, and therefore will not be described.

情報処理端末10は、CPU(Central Processing Unit)101、RAM(Random Access Memory)102、ROM(Read Only Memory)103、I/O機器104、および通信I/F(Interface)105を有する。情報処理端末10は、図1で説明した情報処理プログラムを実行する装置である。 The information processing terminal 10 has a CPU (Central Processing Unit) 101, a RAM (Random Access Memory) 102, a ROM (Read Only Memory) 103, an I/O device 104, and a communication I/F (Interface) 105. The information processing terminal 10 is a device that executes the information processing program described in FIG. 1.