CN109460764B - 一种结合亮度特征与改进帧间差分法的卫星视频船舶监测方法 - Google Patents

一种结合亮度特征与改进帧间差分法的卫星视频船舶监测方法 Download PDFInfo

- Publication number

- CN109460764B CN109460764B CN201811324612.0A CN201811324612A CN109460764B CN 109460764 B CN109460764 B CN 109460764B CN 201811324612 A CN201811324612 A CN 201811324612A CN 109460764 B CN109460764 B CN 109460764B

- Authority

- CN

- China

- Prior art keywords

- target

- ship

- frame

- image

- video

- Prior art date

- Legal status (The legal status is an assumption and is not a legal conclusion. Google has not performed a legal analysis and makes no representation as to the accuracy of the status listed.)

- Active

Links

Images

Classifications

-

- G—PHYSICS

- G06—COMPUTING OR CALCULATING; COUNTING

- G06V—IMAGE OR VIDEO RECOGNITION OR UNDERSTANDING

- G06V10/00—Arrangements for image or video recognition or understanding

- G06V10/20—Image preprocessing

- G06V10/255—Detecting or recognising potential candidate objects based on visual cues, e.g. shapes

-

- G—PHYSICS

- G06—COMPUTING OR CALCULATING; COUNTING

- G06T—IMAGE DATA PROCESSING OR GENERATION, IN GENERAL

- G06T7/00—Image analysis

- G06T7/20—Analysis of motion

- G06T7/207—Analysis of motion for motion estimation over a hierarchy of resolutions

-

- G—PHYSICS

- G06—COMPUTING OR CALCULATING; COUNTING

- G06V—IMAGE OR VIDEO RECOGNITION OR UNDERSTANDING

- G06V10/00—Arrangements for image or video recognition or understanding

- G06V10/40—Extraction of image or video features

- G06V10/46—Descriptors for shape, contour or point-related descriptors, e.g. scale invariant feature transform [SIFT] or bags of words [BoW]; Salient regional features

- G06V10/462—Salient features, e.g. scale invariant feature transforms [SIFT]

-

- G—PHYSICS

- G06—COMPUTING OR CALCULATING; COUNTING

- G06T—IMAGE DATA PROCESSING OR GENERATION, IN GENERAL

- G06T2207/00—Indexing scheme for image analysis or image enhancement

- G06T2207/10—Image acquisition modality

- G06T2207/10016—Video; Image sequence

-

- G—PHYSICS

- G06—COMPUTING OR CALCULATING; COUNTING

- G06T—IMAGE DATA PROCESSING OR GENERATION, IN GENERAL

- G06T2207/00—Indexing scheme for image analysis or image enhancement

- G06T2207/30—Subject of image; Context of image processing

- G06T2207/30232—Surveillance

Landscapes

- Engineering & Computer Science (AREA)

- Multimedia (AREA)

- Physics & Mathematics (AREA)

- General Physics & Mathematics (AREA)

- Theoretical Computer Science (AREA)

- Computer Vision & Pattern Recognition (AREA)

- Image Analysis (AREA)

- Image Processing (AREA)

Abstract

本发明属于卫星遥感领域,公开了一种结合亮度特征与改进帧间差分法的卫星视频船舶监测方法,包括如下步骤:(1)卫星视频单帧潜在目标获取:在利用差分形态学轮廓重建的视频帧亮目标提取的基础上,去除植被噪声,获取视频帧中的潜在船舶目标;(2)间隔帧船舶运动状态判别:通过改进的帧间差分法对不同视频帧之间进行差值运算,从潜在船舶目标中提取出动态船舶目标;(3)卫星视频动态船舶轨迹跟踪:利用自适应颜色模型对动态船舶目标进行轨迹跟踪。本发明对帧间差分算法进行了改进,可以在较小的计算量以及背景发生变化的前提下识别出船舶目标及其运动状态,并利用自适应的颜色模型跟踪其运动轨迹。

Description

技术领域

本发明涉及一种结合亮度特征与改进帧间差分法的卫星视频船舶监测方法。

背景技术

随着遥感卫星技术的发展,新推出的高分辨率卫星正在从图像采集向视频采集的方向发展。卫星视频图像的应用已成为遥感领域一个热门的研究课题。由于视频卫星技术的发展年限比较短,现有研究的主要方面是运动车辆检测以及地物分类。而目前运动目标检测的算法主要有背景差分法、光流法和帧间差分法三种算法,但是对于视频数据的应用,三种算法都有一定的缺陷。

背景差分法虽然较为简单,但是场景中若有遮挡、光线等背景变化以及噪声过大,则会产生很大的误差;尤其是在背景运动情况下,背景差分法则会检测出大量的虚假目标。光流法的缺点是计算量较大,该算法并不是特别适合基于遥感视频卫星数据的目标实时检测。帧间差分法对速度较慢的目标不够敏感,且对环境噪声十分敏感。为了更好的检测运动速度较慢的目标,有学者对帧间差分法进行了改进,提出了累积帧间差分算法(AFD),提高了速度较慢的目标的检测精度。但是采用AFD算法进行“慢速”目标检测时也有一定的缺陷,在检测运动目标的时候会检测空洞、虚假目标等问题。

发明内容

本发明的目的是提供一种结合亮度特征与改进帧间差分法的卫星视频船舶监测方法,以便可以在较小的计算量以及背景发生变化的前提下识别出待检船舶目标及其运动状态。

为了实现上述目的,本发明提供一种结合亮度特征与改进帧间差分法的卫星视频船舶监测方法,包括如下步骤:

(1)卫星视频单帧潜在目标获取:在利用差分形态学轮廓重建的视频帧亮目标提取的基础上,去除植被噪声,获取视频帧中的潜在船舶目标;

(11)基于差分形态学轮廓重建从卫星视频图像中提取亮目标;

(12)利用植被指数从卫星视频图像中提取植被;

(13)叠加步骤(11)和步骤(12)的提取结果,通过形态学处理该提取结果从卫星视频图像中获取潜在船舶目标;

(2)间隔帧船舶运动状态判别:通过改进的帧间差分法对不同视频帧之间进行差值运算,从潜在目标中提取出动态目标;

(3)卫星视频动态船舶轨迹跟踪:利用自适应颜色模型对动态目标进行轨迹跟踪;

步骤(11)中所述提取亮目标的算法如下:

提取出多光谱图像中各像元在不同波段上的最大值,并将其作为该图像的亮度图像:

B(x,y)=max1≤k≤K(bandk(x,y))

其中,B(x,y)表示像元(x,y)的亮度值,bandk(x,y)表示像元在第k波段上的光谱值,K为多光谱图像波段总数;

针对亮度图像白高帽变换的结果进行差分形态学轮廓重建:

DMPW_TH(d,s)=|MPW_TH(d,(s+Δs))-MPW_TH(d,s)|

其中,表示对亮度图像B进行形态学重建操作,d和s分别代表所选的线性结构元素的方向与尺度,Δs为线性结构元素的尺度增长步长,且满足smin≤s≤smax;由于建筑物在尺度的大小和方向上相对其他地物类别更具多样性,因此,在不同尺度和方向上对白高帽变换结果进行形态轮廓差分的均值处理结果为亮度目标指数:

其中,D和S分别表示形态轮廓差分重建中结构元素的方向数和尺度数;

取BTI结果中的前20%为亮度目标;

步骤(12)中所述提取植被的算法如下:

GBVI=G(x,y)-B(x,y);

随后对GBVI结果以10为阈值进行二值化处理,即经过GBVI的计算后,像素值小于10则标记为0,大于等于10则标记为1,以此得到植被提取结果;

其中,G(x,y)为(x,y)像素点的绿波段对应的亮度值,B(x,y)为(x,y)像素点的蓝波段对应的亮度值,GBVI为植被波段差值指数;

步骤(13)中所述形态学处理为形态学闭操作;还对形态学闭操作后图像中的白色连通区域的大小进行筛选;

步骤(2)中提取动态所述船舶目标的过程如下:

对视频图像的帧数采取降维处理,通过取每秒的第一帧图像来形成新的连续的视频图像;随后通过重复所述步骤(11)-(13)对新形成的视频图像逐帧进行潜在目标的提取,将降维后的视频数据的每一帧提取出的潜在船舶目标数量进行记录并对比,找出具有相同数目且数目最小的帧图像,并确定这个数目就是研究区域的潜在船舶目标数目;

为了使目标移动一定的距离,对选取出来的目标数目最小且时间距离最远的两帧图像进行差分计算,生成新的目标位置图,并计算所有潜在船舶目标质心;

根据生成的新目标位置图所记录的目标质心,与选取出的时间距离最远且具有相同目标数目的两帧图像中时间序列在前的那一帧图像中的目标质心对比,通过设置一定的距离阈值来确定目标是否发生位移,若质心的距离小于6个像素,则认定该质心所对应的目标是运动的;

随后再将前后两帧图像进行质心匹配,通过设置一定的阈值,来区分剩下目标的运动状态:首先判断运动速度较慢的目标,如果质心匹配的最小距离小于该连通区域目标框对角线的长度,且大于6个像素,则判断为运动的目标;最小距离小于等于6个像素,则判断为静止的目标,剩下则为噪声点;至此,可以在前帧图像上标记出所有船舶目标的运动状态;

将该质心与降维后的视频图像的第一帧进行目标质心的搜索与匹配,计算两帧图像中质心之间的距离,若最小距离小于300个像素,则认定为同一目标,以此方式标记出降维后的视频图像的第一帧图像中的船舶目标运动状态,得到原始视频图像中第一帧图像上船舶目标的最终运动状态。

进一步地,筛选时,将大小为300-5000像素标记为潜在船舶目标区域。

进一步地,所述步骤(3)中的轨迹跟踪算法使用所选目标对象区域基于RGB的联合概率密度函数以及围绕目标对象区域邻域的RGB的联合概率密度函数,在第一帧中将目标对象与背景分离;

选中的目标对象的下一个颜色特征用目标对象的颜色进行建模,即基于像素颜色的量化特征,其对应于量化的RGB颜色空间中的值,然后采用物体颜色模型在其他帧中分离目标对象和背景,同时利用Mean-Shift算法跟踪目标的位置。

通过上述技术方案,可以实现以下有益的技术效果:

本发明对帧间差分算法进行了改进,可以在较小的计算量以及背景发生变化的前提下识别出待检目标及其运动状态。

本发明基于结合亮度特征与改进帧间差分法的卫星视频船舶监测方法进行研究,首先,基于差分形态学轮廓重建进行亮目标的提取,利用植被指数、形态学处理等操作,提取出潜在船舶目标。再通过改进的帧间差分法对不同视频帧之间进行差值运算,提取出运动船舶目标,并利用自适应颜色模型对其进行轨迹跟踪。为了验证所提出的模型,本发明采用加拿大温哥华(49°17'N 123°7'W)其海港区域,2015年7月2日国际空间站(ISS)的视频数据以及美国圣地亚哥(32°42'N 117°10'W)其港口区域的吉林一号卫星数据进行实验验证。实验结果表明,本发明提出的模型所提取的船舶航行轨迹与通过目视解译的船舶运动轨迹基本吻合。

本发明实施例的其它特征和优点将在随后的具体实施方式部分予以详细说明。

附图说明

附图是用来提供对本发明实施例的进一步理解,并且构成说明书的一部分,与下面的具体实施方式一起用于解释本发明实施例,但并不构成对本发明实施例的限制。在附图中:

图1是本发明一个实施例的流程图;

图2是本发明一个实施例中国际空间站数据第一帧图像亮目标提取结果图;

图3是本发明一个实施例中国际空间站数据第一帧图像植被提取结果图;

图4是本发明一个实施例中国际空间站数据第一帧图像潜在船舶目标、陆地、海洋提取结果图;

图5是本发明一个实施例中国际空间站数据第一帧图像潜在船舶目标提取结果图;

图6是本发明一个实施例中国际空间站数据船舶运动状态判断结果图;

图7是本发明一个实施例中吉林一号数据船舶运动状态判断结果图;

图8是本发明一个实施例中量化RGB颜色空间图;

图9是本发明一个实施例中国际空间站数据船舶运动轨迹跟踪图;

图10是本发明一个实施例中吉林一号数据船舶运动轨迹跟踪图;

图11是本发明一个实施例中改进的帧间差分法举例图。

具体实施方式

以下结合附图对本发明实施例的具体实施方式进行详细说明。应当理解的是,此处所描述的具体实施方式仅用于说明和解释本发明实施例,并不用于限制本发明实施例。

在本发明的一个实施例中,目标为船舶,如图1所示,首先根据亮度特征以及植被光谱特征对目标进行提取,随后通过形态学处理等操作,对潜在船舶目标进行提取,再利用改进的帧间差分算法确定船舶的运动状态,最后利用自适应的颜色模型对船舶轨迹进行跟踪,得到船舶的运动轨迹图。

第一步:差分形态学轮廓重建提取亮目标

根据建筑物通常在其邻域范围内表现出较亮的光谱特征,采用了差分形态学轮廓重建的算法对亮目标进行提取,该方法是利用了多方向、多尺度的形态学操作来表现出亮目标的结构特征和光谱特征,并用一系列线性的结构元素进行形态学操作,对高帽变换的结果进行差分形态学轮廓重建。由于船舶也表现出了高亮的光谱特性,所以利用该方法可以将潜在目标提取出来,之后再通过形态学操作以及阈值的选取区分出船舶目标。一些用于本实验中建筑物提取的关键形态学操作总结如下:

(1)重建:重建滤波是一种重要的形态学滤波器,对于图像处理非常有用,因为它们不会引入不连续性,并因此保留了输入图像中的形状。

(2)粒度测量:描述图像中目标的大小和尺寸。粒状体已经被引入遥感城市地区的图像分类。这种多尺度形态学特征,是建立在随着结构元素尺寸不断增加的操作符基础上。

(3)方向性:大部分现有的形态学操作使用的是圆盘状结构元素。但是,圆盘状结构元素没有考虑方向信息,而方向信息是对于区分具有相似光谱特征的对象来说是至关重要的,比如建筑物和道路的光谱相近,但建筑物具有各向同性而道路相较之下具有各向异性。

本发明中所采用的具体算法如下:

提取出多光谱图像中各像元在不同波段上的最大值,并将其作为该图像的亮度图像:

B(x,y)=max1≤k≤K(bandk(x,y))

| 64 | 69 | 73 | 76 | 90 |

| 58 | 66 | 72 | 77 | 86 |

| 54 | 61 | 71 | 76 | 83 |

| 51 | 56 | 65 | 72 | 80 |

| 45 | 51 | 59 | 67 | 80 |

band1(x,y)

| 64 | 68 | 73 | 75 | 89 |

| 58 | 66 | 72 | 77 | 86 |

| 53 | 60 | 71 | 75 | 82 |

| 51 | 56 | 65 | 72 | 80 |

| 45 | 51 | 59 | 67 | 80 |

band2(x,y)

band3(x,y)

| 66 | 71 | 75 | 78 | 92 |

| 60 | 68 | 74 | 79 | 88 |

| 56 | 63 | 73 | 78 | 85 |

| 53 | 58 | 67 | 74 | 82 |

| 48 | 53 | 61 | 70 | 82 |

B(x,y)

其中,B(x,y)表示像元(x,y)的亮度值,bandk(x,y)表示像元在第k波段上的光谱值,K为多光谱图像波段总数。

针对亮度图像白高帽变换的结果进行差分形态学轮廓重建(DMP):

DMPW_TH(d,s)=|MPW_TH(d,(s+Δs))-MPW_TH(d,s)|

其中,表示对亮度图像B进行形态学开重建操作,d和s分别代表所选的线性结构元素的方向与尺度,Δs为线性结构元素的尺度增长步长,且满足smin≤s≤smax。由于建筑物在尺度的大小和方向上相对其他地物类别更具多样性,因此,在不同尺度和方向上对白高帽变换结果进行形态轮廓差分的均值处理结果为亮度目标指数:

BTI

其中,MPW_TH(d,s)D和S分别表示形态轮廓差分重建中结构元素的方向数和尺度数。经研究发现,D值的增加并不能提高房屋提取的精度。

上述计算中的一些重要参数设置:

| d值 | 依次为0、30、60、90、120、150 |

| 初始s值 | 依次为3、7、9、11 |

| Δs | 8 |

| D | 6 |

| S | 4 |

取得BTI结果中的前20%为亮度目标,得到结果如图2,其中,白色区域为亮目标。

| 0 | 0 | 0 | 0 | 0 |

| 0 | 0 | 0 | 0 | 0 |

| 0 | 0 | 0 | 1 | 1 |

| 0 | 0 | 1 | 1 | 1 |

| 0 | 0 | 0 | 0 | 0 |

标记为1的为亮目标,标记为0的是非亮目标。

从图2中可以看出,利用现有的算法得出来的亮目标提取结果与目视解译的结果基本一样。

第二步:基于植被指数特征的植被提取

根据现有学者的研究,虽然基于植被的光谱特征对植被区域的提取有着较好的效果,但是由于本模型处理的是真彩色的视频卫星数据,而且视频数据的亮度较暗,尤其植被的颜色特征较暗,导致植被的纹理特征也不是很清晰,所以传统的基于植被的光谱特性或纹理特性的提取方式对于该视频数据的响应并不是很好。针对该视频卫星数据的这一特征,最终采用了较为简单的植被提取方式,根据植被的光谱特性,在可见光波段中,G波段和B波段之间有较大的差值,由于可见光的波段特性,只有表现出绿色的地物类别才会具有这一特性,针对研究区域的特征,发现了该波段比值提取植被的算法是可行的。

GBVI=G(x,y)-B(x,y)

其中G(x,y)为(x,y)像素点的绿波段对应的亮度值,B(x,y)为(x,y)像素点的蓝波段对应的亮度值,GBVI则是定义的植被波段差值指数。

| 114 | 108 | 120 | 132 | 136 |

| 147 | 161 | 155 | 146 | 125 |

| 211 | 211 | 198 | 159 | 122 |

| 228 | 219 | 199 | 155 | 111 |

| 229 | 207 | 170 | 126 | 87 |

G(x,y)

| 115 | 109 | 121 | 133 | 137 |

| 148 | 162 | 156 | 147 | 126 |

| 200 | 200 | 187 | 149 | 116 |

| 218 | 208 | 188 | 144 | 105 |

| 217 | 194 | 157 | 113 | 79 |

B(x,y)

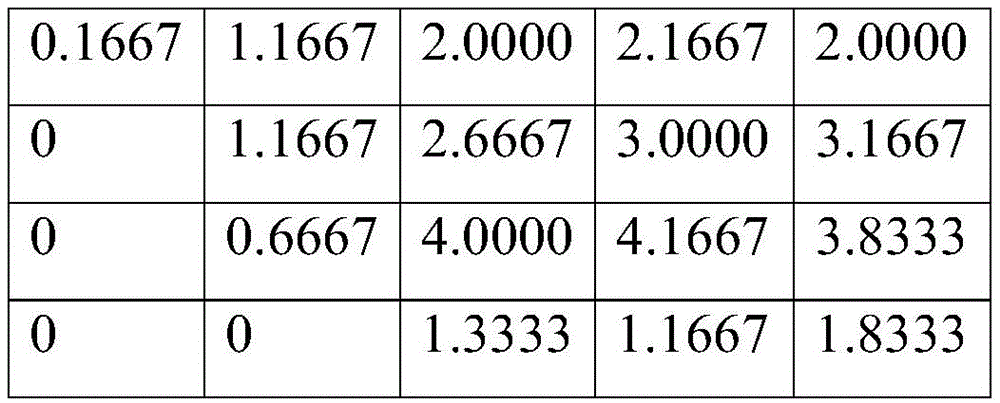

GBVI

随后对GBVI结果以10为阈值进行二值化处理,即经过GBVI的计算后,像素值小于10则标记0值,大于等于10则标记为1,以此来减少噪声的干扰,得到结果如图3,其中白色区域为植被区域,黑色区域为非植被区域。

| 0 | 0 | 0 | 0 | 0 |

| 0 | 0 | 0 | 0 | 0 |

| 1 | 1 | 1 | 1 | 0 |

| 1 | 1 | 1 | 1 | 0 |

| 1 | 1 | 1 | 1 | 1 |

标记为1的为植被区域,标记为0的是非植被区域。

从图3可以看出,利用现有的算法得出来的植被提取结果与目视解译的结果基本一样。

第三步:获取潜在的船舶目标

经过上述两个步骤,我们对同一帧图像的两个结果进行叠加,并利用半径大小为25的圆形结构元素进行形态学闭操作,得到结果如图4,其中较小的白色连接区域为潜在船舶目标,较大的白色连接区域为陆地,较大的黑色的连接区域为海洋。

随后对白色连通区域的大小进行筛选,其中大小为300—5000像素标记为潜在船舶区域,标记结果如图5白色区域。

第四步:基于改进的帧间差分算法确定运动船舶

经过亮目标以及植被提取后,通过阈值选择以及掩膜等处理,便可精确的定位船舶的质心。但是此时还并不能区分正在行驶的船舶或者静止的船舶,根据现有学者的研究,本发明采用改进帧间差分法来确定船舶的运动状态。由于采用的视频卫星数据的时间分辨率较高,如果采用相邻两帧进行差分,由于船舶的速度较低,船舶目标在两帧图像的位移并不明显,甚至可能是传感器在“凝视”时所产生的噪声,都会影响精度;基于这些原因,本发明对视频图像的帧数采取了降维处理,通过取每秒的第一帧图像,形成一定的时间间隔来形成新的“连续”的视频数据。随后通过上述一二三步对新形成的视频数据逐帧进行潜在船舶目标的提取,由于事先不知道船舶目标的数量,而且对每一帧提取出的潜在船舶目标可能包含噪声点,所以通过以下方式来尽可能的减少噪声的干扰:将降维后的视频数据的每一帧提取出的船舶数量进行记录并对比,找出具有相同数目,且数目最小的帧图像,并确定这个数目就是研究区域的潜在船舶目标数目。

为了使船舶尽可能的移动较大的距离,选取筛选出来的目标数目最小且时间距离最远的两帧图像,进行差分计算,生成新的船舶位置图,并计算所有潜在船舶区域的质心。根据生成的新的标记图所记录的船舶质心,与选取出的时间距离较远且具有相同船舶数目的两帧图像中的时间序列在前那一帧图像中的船舶质心对比,进行质心之间的匹配,通过设置一定的距离阈值来确定船舶是否发生位移,若质心距离小于6个像素,则认定该质心所对应的船舶是运动的。此操作只能确定前后两帧图像上完全分离的船舶运动状态。

随后再将前后两帧图像进行质心匹配,通过设置一定的阈值,来区分剩下船舶的运动状态。首先判断运动速度较慢的船舶,如果质心匹配的最小距离小于该连通区域目标框对角线的长度,且大于6个像素则判断为运动的船舶;最小距离小于等于6个像素则判断为静止的船舶,剩下则为噪声点。至此,可以在前帧图像上标记出所有船舶目标的运动状态。

通过上述步骤所在前帧图像上标记出的船舶运动状态的质心并不一定是原始视频数据第一帧图像的船舶质心,此时需要将该质心与降维后的视频图像的第一帧进行船舶质心的搜索与匹配,计算两帧图像中质心之间的距离,若最小距离小于300个像素,则认定为同一艘船舶,以此方式标记出降维后的视频图像的第一帧图像中的船舶运动状态,由于原始视频数据降维方式为取每秒的第一帧图像,所以通过以上步骤可以得到原始视频数据第一帧图像上船舶的最终运动状态。验证数据最终判断结果如下,其中标记为1的是判断为正在移动的船舶,标记为2的是静止的船舶。参见图6-7。

如图11所示,以从3艘船舶中提取运动的船舶为例(标记为1、2、3代表对应的三艘船舶),为了使目标移动一定的距离,对选取出来的时间距离最远的两帧图像,即第Tmin帧影像(图a)和第Tmax帧影像(图b),进行差分计算,生成新的目标位置图,即Dvalue图像(图c),并计算所有潜在目标质心;

根据生成的新目标位置Dvalue图(图c)所记录的目标质心,与选取出的时间距离最远且具有相同目标数目的两帧图像中时间序列在前的Tmin帧图像(图a)中的目标质心对比,通过设置一定的距离阈值来确定目标是否发生位移,若质心的欧几里德距离小于6个像素,则认定该质心所对应的目标是运动的;例如图a中标记为1的船舶,经过Tmin帧影像(图a)和Tmax帧影像(图b)差值后,可以完整的存在于Dvalue图(图c)中,所以船舶1的质心在两张图上基本是不发生移动,则Tmin帧影像(图a)中的船舶1的质心,与Dvalue图(图c)中船舶的质心分别进行匹配,存在满足质心距离小于6个像素要求的连通区域,则船舶1判断为运动的船舶。

随后再将Tmin帧影像与Tmax帧影像进行质心匹配,通过设置一定的阈值,来区分剩下目标的运动状态:首先判断运动速度较慢的目标,如果质心匹配的最小距离小于该连通区域目标框对角线的长度,且大于6个像素,则判断为运动的目标;例如,Tmin帧影像(图a)中标记为2的船舶,由于运动速度较慢等原因,经过与Tmax帧影像(图b)进行差值后,无法与Tmax帧影像(图b)标记为2的船舶区分,会在Dvalue图(图c)会形成粘连区域,从而会生成一个新的质心,在Tmin帧影像(图a)与Dvalue图(图c)中对应的质心难以匹配,所以对Tm n帧影像与Tmax帧影像中的质心进行匹配,Tmin帧影像(图a)标记为2的船舶质心与Tmax帧影像(图b)标记为2的船舶质心之间的欧几里德距离满足小于Tmin帧影像(图a)中标记为2的船舶连通区域最小外接矩形的对角线长度且大于6个像素,所以船舶2为运动的船舶。

若船舶是静止的,则该船舶在Tmin帧影像与Tmax帧影像上的位置质心基本不变,为了提高识别精度,可以设定Tmin帧影像与Tmax帧影像之间质心最小距离小于等于6个像素,则判断为静止的目标,剩下则为噪声点;例如Tmin帧影像(图a)中标记为3的船舶,因为是静止的船舶,所以在Tmax帧影像(图b)中同样的位置有类似的船舶区域,差值后,经过形态学操作以及连通区域面积大小筛选后,在Dvalue图(图c)中不存在对应的区域,那么对Tmin帧影像(图a)中3号船舶的质心与Tmax帧影像(图b)中的质心进行匹配,进过计算对应的欧几里德距离可以发现,Tmin帧影像(图a)中3号船舶的质心与Tmax帧影像(图b)中3号船舶的质心之间的欧几里德距离小于6个像素,则判断为3号船舶为静止的船舶。

至此,可以在Tmin帧图像上标记出所有目标的运动状态;

因为Tmin帧图像不一定为降维后的第一帧影像,所以将Tmin帧图像中连通区域的质心与降维后的视频图像的第一帧T1图像进行目标质心的搜索与匹配,计算Tmin帧图像与T1帧图像中连通区域质心之间的欧几里德距离,若最小距离小于300个像素,则认定为同一目标,以此方式标记出降维后的视频图像的第一帧T1图像中的目标运动状态,因为采用取每秒第一帧图像的方式进行降维,所以降维后第一帧影像即为原始数据的第一帧影像,从而得到原始视频图像中第一帧图像上目标的最终运动状态。

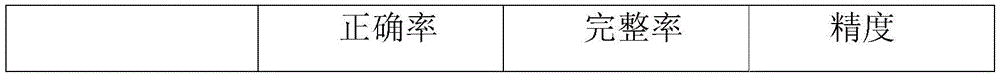

将本发明判断的船舶运动状态结果与目视解译视频数据判断船舶运动状态做对比,可以发现,加拿大温哥华(49°17'N 123°7'W)其海港区域2015年7月2日国际空间站(ISS)的视频数据的潜在船舶目标以及船舶运动状态判断完全正确;美国圣地亚哥(32°42'N 117°10'W)其港口区域的吉林一号卫星数据判断结果中,将两处陆地区域分别误判成动态和静态的船舶,且误将一艘动态船舶判断为静态船舶。判断结果及精度统计如下表。

船舶运动状态统计结果

潜在船舶目标判断结果精度统计

运动船舶目标判断结果统计

正确率=TP/(TP+FP) (1)

完整率=TP/(TP+FN) (2)

精度=TP/(TP+FP+FN) (3)

TP:算法检测到的目标

FN:算法未检测到的目标

FP:算法检测出错误的目标

第五步基于自适应颜色模型的船舶轨迹跟踪

自适应颜色模型的船舶轨迹跟踪算法使用了所选对象区域基于RGB的联合概率密度函数以及围绕目标对象的邻域的RGB的联合概率密度函数,在第一帧中将对象与背景分离。选中的目标对象的下一个颜色特征用目标对象的颜色建模,然后采用物体颜色模型在其他帧中分离目标物体和背景,同时利用Mean-Shift算法跟踪物体的位置,开发自适应颜色模型以克服追踪过程中物体外观的变化带来的问题。具体算法如下:

5.1对象选择

最初,通过在感兴趣的对象周围绘制矩形,用户手动选择感兴趣的对象。为了准确检测目标对象,使用目标对象附近的背景色,需要使选择外部矩形使围绕物体的区域中的背景像素数量与物体矩形内的像素数量大致相同。等式(5-1)用于定义围绕目标对象矩形区域的宽度:

其中w和h是对象窗口的宽度和高度,d是对象矩形周围区域的宽度。

5.2特征提取

在所引用的跟踪器中,用于建模对象的特征是基于像素颜色的量化特征,其对应于量化的RGB颜色空间中的值。提取基于像素的量化特征用于对象像素和周围背景像素。图8显示量化的R,G,B色彩空间。由于目标船舶在图像中显示为高亮,与低亮的海洋背景有着较大的色差,在所选择的模型中,选择R,G和B通道的4位编码,使得总的直方图大小为16*16*16=4096,这种颜色深度和直方图大小的降低是为了提高计算效率和降低维度。为了表示目标外观,使用来自下一部分的分离对象的量化的R,G,B像素值。

5.3对象背景分离

目标背景分离方法用于检测对象。使用内部矩形内的区域的量化的R,G,B直方图来获得对象区域的基于量化的RGB的联合概率密度函数(pdf)和区域之间的量化的R,G,B直方图外部和内部矩形用于获取周围背景联合概率密度函数。使用围绕对象的对象区域/背景区域的对数似然比(LLR)结果来确定对象像素。在对象的边界矩形内考虑像素的对数似然性可以通过以下方式获得:

其中Ho(i)是目标对象矩形中像素的特征值的直方图,并且Hb(i)是来自对象周围的区域的像素的直方图,其中所呈现的计算指标的范围从1到4096的直方图元素。ε是一个很小的非零值,用于避免数值不稳定,从而避免被零除或取零的对数,这里将ε设置为0.01。

如果来自上一步的对数似然函数被用于检测对象像素,则结果可能为图像的位置。其中,对象颜色包含正值,背景颜色包含负值,并且由对象和背景共享的颜色倾向于零。对象的二进制掩码获得函数为:

其中τ0是决定最可靠对象像素的阈值。在函数中,τ0的值设定为0.8,以获得可靠的物体像素。一旦模型在第一帧中选择了目标对象区域,则使用公式(5-2)和公式(5-3)按顺序获得对象的对数似然映射和二进制掩码。

5.4对象颜色建模和更新

在第一帧中,通过使用由等式(5-3)得到的分离对象的量化RGB值来自动开发对象颜色模型。然而,量化的色彩空间实质上可以容许目标对象色彩和照明的微小变化,但是对于物体色彩或场景照明的广泛变化来说还是具有一定的缺陷。因此有一个可靠的对象跟踪颜色模型更新对象是必要的。每个帧中的对象颜色建模在计算上是复杂耗时的,此处定义标准以指示需要对象颜色适应的帧。假设S0是分离对象内像素的平均R-G-B颜色,S0的更改是显示对象颜色适应的需要。在检测对象之后的每个输入帧中呈现的计算中,计算分离对象内的像素的平均RGB颜色。当前帧中的S0与最后一帧相比偏差大于0.05*256时(这里偏差设置为15)表示对象颜色正在变化并且进行对象颜色适配。

5.5对象定位器

对象定位化开始于先前跟踪的帧中检测到的二进制对象的质心。为了找到目标对象像素,从对象矩形中提取特征并用对象颜色模型进行测试。采用mean-shift算法跟踪目标对象,进行mean-shift算法跟踪之后的主要思想是将空间中的点视为概率密度函数,其中空间中最密集的区域对应于作为目标对象位置的局部最大值,物体的位移由物体像素的质心位移给出,在每个目标对象矩形的迭代中心移动到检测到的二进制对象的质心。目标对象矩形被迭代地移位和测试,直到对象完全放置在矩形内(均值偏移收敛)。通过使用等式(5-4)和(5-5),在每次迭代中物体质心重新定位:

其中xi和yi表示对象矩形中每个检测到的对象像素在视频帧图像坐标中的位置;Xnew和Ynew在每次迭代中重新定位的目标对象的质心,n是检测到的对象像素的数量。在实验过程中,小于5像素的质心运动被认为是完全收敛。

由于该算法不能在第一帧图像中自动选择船舶目标区域,所以将通过上述一二三四步得到的视频数据第一帧图像中提取出的船舶区域为运动船舶初始的目标区域。然后利用自适应的颜色模型算法对每个运动的船舶进行轨迹跟踪,得到每个船舶在每帧视频数据中的质心,将同一艘船舶的质心连接形成轨迹。队中的船舶轨迹跟踪结果如图9和10。

从图9和10中本发明自动检测到的的船舶轨迹与目视解译视频数据的结果对比,可以发现通过本发明所得到的船舶轨迹结果与船舶实际轨迹是吻合的。

信息提取是遥感数据应用的一个重要环节,遥感制图、灾害应急、城市规划、变化检测、军事安全等方面,都离不开遥感数据的信息提取。随着遥感技术的发展,视频卫星技术正在逐步发展,视频卫星数据也慢慢的应用到研究和生产领域中。本发明提出了一种新的基于视频卫星数据的应用方向,通过差分形态学轮廓重建提取潜在目标,随后利用改进的帧间差分法确定目标的运动状态,最后通过自适应的颜色模型对动态船舶目标进行轨迹跟踪。

本发明采用加拿大温哥华(49°17'N 123°7'W)其海港区域,2015年7月2日国际空间站(ISS)的视频数据以及美国圣地亚哥(32°42'N 117°10'W)其港口区域的吉林一号卫星数据,进行了潜在动态船舶获取以及船舶轨迹的提取,结果表明,本发明对卫星视频船舶轨迹的提取结果与通过目视解译的船舶运动轨迹基本吻合,证明了本发明的可行性。

以上结合附图详细描述了本发明实施例的可选实施方式,但是,本发明实施例并不限于上述实施方式中的具体细节,在本发明实施例的技术构思范围内,可以对本发明实施例的技术方案进行多种简单变型,这些简单变型均属于本发明实施例的保护范围。

另外需要说明的是,在上述具体实施方式中所描述的各个具体技术特征,在不矛盾的情况下,可以通过任何合适的方式进行组合。为了避免不必要的重复,本发明实施例对各种可能的组合方式不再另行说明。

此外,本发明实施例的各种不同的实施方式之间也可以进行任意组合,只要其不违背本发明实施例的思想,其同样应当视为本发明实施例所公开的内容。

Claims (3)

1.一种结合亮度特征与改进帧间差分法的卫星视频船舶监测方法,其特征在于,包括如下步骤:

(1)卫星视频单帧潜在目标获取:在利用差分形态学轮廓重建的视频帧亮目标提取的基础上,去除植被噪声,获取视频帧中的潜在船舶目标;

(11)基于差分形态学轮廓重建从卫星视频图像中提取亮目标;

(12)利用植被指数从卫星视频图像中提取植被;

(13)叠加步骤(11)和步骤(12)的提取结果,通过形态学处理该提取结果从卫星视频图像中获取潜在船舶目标;

(2)间隔帧船舶运动状态判别:通过改进的帧间差分法对不同视频帧之间进行差值运算,从潜在目标中提取出动态目标;

(3)卫星视频动态船舶轨迹跟踪:利用自适应颜色模型对动态目标进行轨迹跟踪;

步骤(11)中所述提取亮目标的算法如下:

提取出多光谱图像中各像元在不同波段上的最大值,并将其作为该图像的亮度图像:

B(x,y)=max1≤k≤K(bandk(x,y))

其中,B(x,y)表示像元(x,y)的亮度值,bandk(x,y)表示像元在第k波段上的光谱值,K为多光谱图像波段总数;

针对亮度图像白高帽变换的结果进行差分形态学轮廓重建:

DMPW_TH(d,s)=|MPW_TH(d,(s+Δs))-MPW_TH(d,s)|

其中,表示对亮度图像B进行形态学重建操作,d和s分别代表所选的线性结构元素的方向与尺度,Δs为线性结构元素的尺度增长步长,且满足smin≤s≤smax;由于建筑物在尺度的大小和方向上相对其他地物类别更具多样性,因此,在不同尺度和方向上对白高帽变换结果进行形态轮廓差分的均值处理结果为亮度目标指数:

其中,D和S分别表示形态轮廓差分重建中结构元素的方向数和尺度数;取BTI结果中的前20%为亮度目标;

步骤(12)中所述提取植被的算法如下:

GBVI=G(x,y)-B(x,y);

随后对GBVI结果以10为阈值进行二值化处理,即经过GBVI的计算后,像素值小于10则标记为0,大于等于10则标记为1,以此得到植被提取结果;

其中,G(x,y)为(x,y)像素点的绿波段对应的亮度值,B(x,y)为(x,y)像素点的蓝波段对应的亮度值,GBVI为植被波段差值指数;

步骤(13)中所述形态学处理为形态学闭操作;还对形态学闭操作后图像中的白色连通区域的大小进行筛选;

步骤(2)中所述提取动态船舶目标的过程如下:

对视频图像的帧数采取降维处理,通过取每秒的第一帧图像来形成新的连续的视频图像;随后通过重复所述步骤(11)-(13)对新形成的视频图像逐帧进行潜在目标的提取,将降维后的视频数据的每一帧提取出的潜在船舶目标数量进行记录并对比,找出具有相同数目且数目最小的帧图像,并确定这个数目就是研究区域的潜在船舶目标数目;

为了使目标移动一定的距离,对选取出来的目标数目最小且时间距离最远的两帧图像进行差分计算,生成新的目标位置图,并计算所有潜在船舶目标质心;

根据生成的新目标位置图所记录的目标质心,与选取出的时间距离最远且具有相同目标数目的两帧图像中时间序列在前的那一帧图像中的目标质心对比,通过设置一定的距离阈值来确定目标是否发生位移,若质心的距离小于6个像素,则认定该质心所对应的目标是运动的;

随后再将前后两帧图像进行质心匹配,通过设置一定的阈值,来区分剩下目标的运动状态:首先判断运动速度较慢的目标,如果质心匹配的最小距离小于该连通区域目标框对角线的长度,且大于6个像素,则判断为运动的目标;最小距离小于等于6个像素,则判断为静止的目标,剩下则为噪声点;至此,可以在前帧图像上标记出所有船舶目标的运动状态;

将该质心与降维后的视频图像的第一帧进行目标质心的搜索与匹配,计算两帧图像中质心之间的距离,若最小距离小于300个像素,则认定为同一目标,以此方式标记出降维后的视频图像的第一帧图像中的船舶目标运动状态,得到原始视频图像中第一帧图像上船舶目标的最终运动状态。

2.根据权利要求1所述的结合亮度特征与改进帧间差分法的卫星视频船舶监测方法,其特征在于,筛选时,将大小为300-5000像素标记为潜在船舶目标区域。

3.根据权利要求2所述的结合亮度特征与改进帧间差分法的卫星视频船舶监测方法,其特征在于,所述步骤(3)中的轨迹跟踪算法使用所选目标对象区域基于RGB的联合概率密度函数以及围绕目标对象区域邻域的RGB的联合概率密度函数,在第一帧中将目标对象与背景分离;

选中的目标对象的下一个颜色特征用目标对象的颜色进行建模,即基于像素颜色的量化特征,其对应于量化的RGB颜色空间中的值,然后采用物体颜色模型在其他帧中分离目标对象和背景,同时利用Mean-Shift算法跟踪目标的位置。

Priority Applications (1)

| Application Number | Priority Date | Filing Date | Title |

|---|---|---|---|

| CN201811324612.0A CN109460764B (zh) | 2018-11-08 | 2018-11-08 | 一种结合亮度特征与改进帧间差分法的卫星视频船舶监测方法 |

Applications Claiming Priority (1)

| Application Number | Priority Date | Filing Date | Title |

|---|---|---|---|

| CN201811324612.0A CN109460764B (zh) | 2018-11-08 | 2018-11-08 | 一种结合亮度特征与改进帧间差分法的卫星视频船舶监测方法 |

Publications (2)

| Publication Number | Publication Date |

|---|---|

| CN109460764A CN109460764A (zh) | 2019-03-12 |

| CN109460764B true CN109460764B (zh) | 2022-02-18 |

Family

ID=65609721

Family Applications (1)

| Application Number | Title | Priority Date | Filing Date |

|---|---|---|---|

| CN201811324612.0A Active CN109460764B (zh) | 2018-11-08 | 2018-11-08 | 一种结合亮度特征与改进帧间差分法的卫星视频船舶监测方法 |

Country Status (1)

| Country | Link |

|---|---|

| CN (1) | CN109460764B (zh) |

Families Citing this family (9)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| CN110111364B (zh) * | 2019-04-30 | 2022-12-27 | 腾讯科技(深圳)有限公司 | 运动检测方法、装置、电子设备及存储介质 |

| CN110702869A (zh) * | 2019-11-01 | 2020-01-17 | 无锡中科水质环境技术有限公司 | 基于视频图像解析的鱼类应激回避行为水质监测方法 |

| CN111387966B (zh) * | 2020-03-20 | 2022-08-26 | 中国科学院深圳先进技术研究院 | 信号波重构方法及心率变异性信息的检测设备 |

| CN111553928B (zh) * | 2020-04-10 | 2023-10-31 | 中国资源卫星应用中心 | 一种辅以Openstreetmap信息的城市道路高分遥感自适应提取方法 |

| CN111739059A (zh) * | 2020-06-20 | 2020-10-02 | 马鞍山职业技术学院 | 基于帧差法的运动物体检测方法与轨迹跟踪方法 |

| CN112270661B (zh) * | 2020-10-19 | 2024-05-07 | 北京宇航系统工程研究所 | 一种基于火箭遥测视频的空间环境监测方法 |

| CN112489055B (zh) * | 2020-11-30 | 2023-04-07 | 中南大学 | 融合亮度-时序特征的卫星视频动态车辆目标提取方法 |

| CN115294486B (zh) * | 2022-10-08 | 2023-01-13 | 彼图科技(青岛)有限公司 | 一种基于无人机和人工智能的违章垃圾识别和判定方法 |

| CN115760613B (zh) * | 2022-11-15 | 2024-01-05 | 江苏省气候中心 | 一种结合卫星影像和光流法的蓝藻水华短时预测方法 |

Citations (12)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| CN102081801A (zh) * | 2011-01-26 | 2011-06-01 | 上海交通大学 | 多特征自适应融合船舶跟踪和航迹检测方法 |

| CN103839267A (zh) * | 2014-02-27 | 2014-06-04 | 西安科技大学 | 一种基于形态学建筑物指数的建筑物提取方法 |

| CN103971127A (zh) * | 2014-05-16 | 2014-08-06 | 华中科技大学 | 一种前视雷达成像海面目标关键点检测识别方法 |

| CN104463914A (zh) * | 2014-12-25 | 2015-03-25 | 天津工业大学 | 一种改进的Camshift目标跟踪方法 |

| CN104751478A (zh) * | 2015-04-20 | 2015-07-01 | 武汉大学 | 一种基于多特征融合的面向对象的建筑物变化检测方法 |

| CN105096338A (zh) * | 2014-12-30 | 2015-11-25 | 天津航天中为数据系统科技有限公司 | 运动目标提取方法及装置 |

| CN105608458A (zh) * | 2015-10-20 | 2016-05-25 | 武汉大学 | 一种高分辨率遥感影像建筑物提取方法 |

| CN106650663A (zh) * | 2016-12-21 | 2017-05-10 | 中南大学 | 建筑物真伪变化的判定方法及含此方法的伪变化去除方法 |

| CN107092890A (zh) * | 2017-04-24 | 2017-08-25 | 山东工商学院 | 基于红外视频的舰船检测及跟踪方法 |

| CN107465877A (zh) * | 2014-11-20 | 2017-12-12 | 广东欧珀移动通信有限公司 | 跟踪对焦方法及装置和相关介质产品 |

| CN107609534A (zh) * | 2017-09-28 | 2018-01-19 | 北京市遥感信息研究所 | 一种基于码头光谱信息的遥感驻泊船只自动检测方法 |

| CN108052859A (zh) * | 2017-10-31 | 2018-05-18 | 深圳大学 | 一种基于聚类光流特征的异常行为检测方法、系统及装置 |

Family Cites Families (2)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| US20090093959A1 (en) * | 2007-10-04 | 2009-04-09 | Trimble Navigation Limited | Real-time high accuracy position and orientation system |

| US10706551B2 (en) * | 2017-03-30 | 2020-07-07 | 4DM Inc. | Object motion mapping using panchromatic and multispectral imagery from single pass electro-optical satellite imaging sensors |

-

2018

- 2018-11-08 CN CN201811324612.0A patent/CN109460764B/zh active Active

Patent Citations (12)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| CN102081801A (zh) * | 2011-01-26 | 2011-06-01 | 上海交通大学 | 多特征自适应融合船舶跟踪和航迹检测方法 |

| CN103839267A (zh) * | 2014-02-27 | 2014-06-04 | 西安科技大学 | 一种基于形态学建筑物指数的建筑物提取方法 |

| CN103971127A (zh) * | 2014-05-16 | 2014-08-06 | 华中科技大学 | 一种前视雷达成像海面目标关键点检测识别方法 |

| CN107465877A (zh) * | 2014-11-20 | 2017-12-12 | 广东欧珀移动通信有限公司 | 跟踪对焦方法及装置和相关介质产品 |

| CN104463914A (zh) * | 2014-12-25 | 2015-03-25 | 天津工业大学 | 一种改进的Camshift目标跟踪方法 |

| CN105096338A (zh) * | 2014-12-30 | 2015-11-25 | 天津航天中为数据系统科技有限公司 | 运动目标提取方法及装置 |

| CN104751478A (zh) * | 2015-04-20 | 2015-07-01 | 武汉大学 | 一种基于多特征融合的面向对象的建筑物变化检测方法 |

| CN105608458A (zh) * | 2015-10-20 | 2016-05-25 | 武汉大学 | 一种高分辨率遥感影像建筑物提取方法 |

| CN106650663A (zh) * | 2016-12-21 | 2017-05-10 | 中南大学 | 建筑物真伪变化的判定方法及含此方法的伪变化去除方法 |

| CN107092890A (zh) * | 2017-04-24 | 2017-08-25 | 山东工商学院 | 基于红外视频的舰船检测及跟踪方法 |

| CN107609534A (zh) * | 2017-09-28 | 2018-01-19 | 北京市遥感信息研究所 | 一种基于码头光谱信息的遥感驻泊船只自动检测方法 |

| CN108052859A (zh) * | 2017-10-31 | 2018-05-18 | 深圳大学 | 一种基于聚类光流特征的异常行为检测方法、系统及装置 |

Non-Patent Citations (4)

| Title |

|---|

| Fault-Tolerant Building Change Detection From Urban High-Resolution Remote Sensing Imagery;Yuqi Tang 等;《IEEE Geoscience and Remote Sensing Letters》;20130111;第10卷(第5期);1060-1064 * |

| 基于数学形态学的差分图像目标检测算法研究;秦雨萍 等;《舰船电子工程》;20180420;第38卷(第4期);16-18,22 * |

| 基于视频图像分析的船舶走锚识别研究;隗杰;《万方平台: https://d.wanfangdata.com.cn/thesis/ChJUaGVzaXNOZXdTMjAyMTA1MTkSCUQwMTMxNTEyORoIcGloc3dzZ2I%3D》;20180803;1-81 * |

| 面向对象的高分辨率影像城市多特征变化检测研究;汤玉奇;《中国博士学位论文全文数据库 信息科技辑》;20140715(第07期);I140-23 * |

Also Published As

| Publication number | Publication date |

|---|---|

| CN109460764A (zh) | 2019-03-12 |

Similar Documents

| Publication | Publication Date | Title |

|---|---|---|

| CN109460764B (zh) | 一种结合亮度特征与改进帧间差分法的卫星视频船舶监测方法 | |

| Zhang et al. | Object-oriented shadow detection and removal from urban high-resolution remote sensing images | |

| CN103971386B (zh) | 一种动态背景场景下的前景检测方法 | |

| CN104392468B (zh) | 基于改进视觉背景提取的运动目标检测方法 | |

| CN103745203B (zh) | 基于视觉注意和均值漂移的目标检测与跟踪方法 | |

| CN102855622B (zh) | 一种基于显著性分析的红外遥感图像海面船只检测方法 | |

| CN110309781B (zh) | 基于多尺度光谱纹理自适应融合的房屋损毁遥感识别方法 | |

| CN103077539B (zh) | 一种复杂背景及遮挡条件下的运动目标跟踪方法 | |

| CN116403123A (zh) | 基于深度卷积网络的遥感影像变化检测方法 | |

| CN103578083B (zh) | 基于联合均值漂移的单幅图像去雾方法 | |

| CN104182985B (zh) | 遥感图像变化检测方法 | |

| CN105404847A (zh) | 一种遗留物实时检测方法 | |

| CN111027497B (zh) | 基于高分辨率光学遥感影像的弱小目标快速检测方法 | |

| CN104504686A (zh) | 一种采用局部自适应阈值分割的高光谱图像异常探测方法 | |

| CN110660065B (zh) | 一种红外故障检测识别算法 | |

| CN106096604A (zh) | 基于无人平台的多波段融合探测方法 | |

| WO2018076138A1 (zh) | 基于大尺度高分辨率高光谱图像的目标探测方法及装置 | |

| CN102147920A (zh) | 高分辨率遥感影像中的阴影检测方法 | |

| CN105894520B (zh) | 一种基于高斯混合模型的卫星影像自动云检测方法 | |

| CN110866455B (zh) | 一种路面水体检测方法 | |

| CN111080696B (zh) | 一种基于计算机视觉的水下海参识别及定位方法 | |

| CN107301420A (zh) | 一种基于显著性分析的热红外影像目标探测方法 | |

| CN103984945A (zh) | 一种光学遥感影像船只检测方法 | |

| CN102288166A (zh) | 基于视频的多模型结合水面船舶检测方法 | |

| CN106056139A (zh) | 一种基于图像分割的森林火灾烟雾检测方法 |

Legal Events

| Date | Code | Title | Description |

|---|---|---|---|

| PB01 | Publication | ||

| PB01 | Publication | ||

| SE01 | Entry into force of request for substantive examination | ||

| SE01 | Entry into force of request for substantive examination | ||

| GR01 | Patent grant | ||

| GR01 | Patent grant |